在几乎所有的 LLM 面试中,有一个问题总是会被提及:“为大模型提供服务需要多少 GPU 显存?”

这不仅仅是一个随机的问题——它是一个关键指标,反映了你对这些强大模型在生产环境中部署和可扩展性的理解程度。

当你使用 GPT、LLaMA 或任何其他 LLM 时,了解如何估算所需的 GPU 内存是至关重要的。无论你是在处理一个 70 亿参数的模型,还是更大的模型,正确地配置硬件以支持这些模型至关重要。让我们深入探讨一下数学计算,这将帮助你估算有效部署这些模型所需的 GPU 内存。

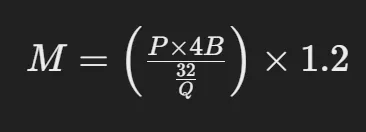

估算 GPU 内存的公式

要估算为大型语言模型提供服务所需的 GPU 内存,可以使用以下公式:

- M 是 GPU 显存,以 GB(千兆字节)为单位。

- P 是模型的参数数量。

- 4B 表示每个参数使用的 4 字节。

- Q 是加载模型的位数(例如,16 位或 32 位)。

- 1.2 考虑了 20% 的额外开销。

分解公式

参数数量(P):

- 这代表了模型的大小。例如,如果你正在使用一个具有 700 亿参数(70B)的 LLaMA 模型,那么这个值就是 700 亿。

每个参数的字节数(4B):

- 每个参数通常需要 4 个字节的内存。这是因为单精度浮点数通常占用 4 个字节(32 位)。但是,如果你使用半精度(16 位),计算将相应调整。

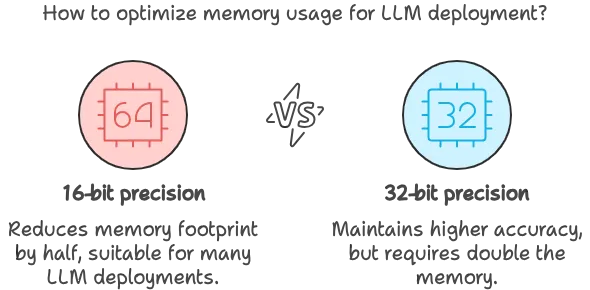

加载模型的位数(Q):

- 根据你是以 16 位还是 32 位精度加载模型,此值会有所不同。16 位精度在许多 LLM 部署中很常见,因为它在保持足够准确性的同时减少了内存使用。

开销(1.2):

- 1.2 的乘数增加了 20% 的额外开销,以考虑推理过程中使用的额外内存。这不仅是一个安全缓冲区;它对于覆盖模型执行期间的激活和其他中间结果所需的内存至关重要。

示例计算

假设你想估算为一个具有 700 亿参数、以 16 位精度加载的 LLaMA 模型提供服务所需的内存:

-

计算参数总字节数:

总字节数 = 参数数量 × 每个参数的字节数 = 70,000,000,000 × 2 字节(因为使用 16 位精度,即每个参数占用 2 字节) = 140,000,000,000 字节 -

考虑 20% 的额外开销:

考虑开销的总字节数 = 总字节数 × 1.2 = 140,000,000,000 × 1.2 = 168,000,000,000 字节 -

将字节转换为 GB:

GPU 内存(GB)= 考虑开销的总字节数 ÷ (1024^3) ≈ 168,000,000,000 ÷ 1,073,741,824 ≈ 156.5 GB

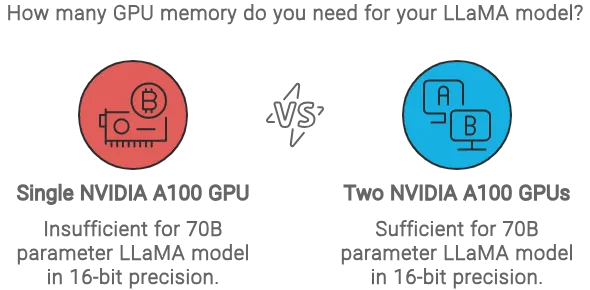

此计算告诉你,你需要大约 156.5 GB 的 GPU 内存才能以 16 位模式为具有 700 亿参数的 LLaMA 模型提供服务。

实际意义

理解和应用这个公式不仅仅是理论上的;它在现实世界中有重要意义。例如,单个具有 80 GB 内存的 NVIDIA A100 GPU 不足以为该模型提供服务。你至少需要两个具有 80 GB 内存的 A100 GPU,才能有效地处理内存负载。

通过掌握这个计算方法,你将在面试中能够自信地回答这个关键问题,更重要的是,在实际部署中避免昂贵的硬件瓶颈。下次你规划部署时,你将确切地知道如何估算有效为你的 LLM 提供服务所需的 GPU 显存。

1755

1755

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?