从零入门CV图像竞赛(2024全球Deepfake攻防挑战赛)

Deepfake是什么?

Deepfake是一种利用深度学习技术,特别是生成对抗网络(GANs)来实现视频、音频等多媒体内容的伪造技术。这项技术可以实现对视频中人物的面部、表情、口型甚至身体动作的精确替换和模仿,让一个人在视频中看起来像另一个人,或者做出他们实际上并未做出的动作和表情。

Deepfake的制作流程大致如下:

- 数据收集:收集大量的目标人物图片和视频资料,用于训练模型。

- 模型训练:使用生成对抗网络(GAN)进行训练。GAN包含两部分,生成器(Generator)和判别器(Discriminator)。生成器的任务是生成逼真的假视频或图片,而判别器的任务是区分生成的假视频或图片和真实的视频或图片。

- 迭代优化:通过不断迭代,生成器生成的假视频或图片越来越难以被判别器识别,最终达到以假乱真的效果。

Deepfake技术具有以下特点:

- 高仿真性:经过精心制作的Deepfake内容可以达到非常高的真实度,对于普通观众来说,很难分辨其真伪。

- 多样性:不仅可以应用于视频,也可以应用于音频、图片等多种媒介。

Deepfake技术带来的潜在问题: - 伦理道德问题:Deepfake可能被用于制作虚假信息、色情内容、侵犯他人隐私等,对个人名誉和社会秩序造成负面影响。

- 安全问题:在政治、经济、社会等领域,Deepfake可能被用作虚假信息传播的工具,误导公众,影响选举和决策过程。

针对Deepfake技术的潜在风险,各国政府、技术社区和社会组织正在努力制定相应的法律法规和对策,以防止其滥用。同时,也在开发检测和识别Deepfake内容的技术,以保护信息的真实性和社会的稳定。

如何区分Deepfake?

区分Deepfake内容与真实内容是一个挑战性的任务,但随着技术的发展,已经有一些方法可以用来检测Deepfake。以下是一些常见的检测Deepfake的方法:

- 视觉不一致性检查:

- 光线和阴影:检查视频中的光线和阴影是否自然,Deepfake内容可能在光线变化和阴影上存在不一致。

- 面部特征:观察面部特征是否在不同角度和表情下保持一致,Deepfake可能在某些角度下出现面部扭曲或异常。

- 眨眼和眼球运动:人类在说话时会自然眨眼和移动眼球,Deepfake可能无法准确模拟这些细节。

- 图像质量分析:

- 分辨率不一致:Deepfake视频可能在某些部分分辨率较低,尤其是当面部被合成到不同背景上时。

- 模糊和锐化:检查图像中是否有不自然的模糊或过度锐化的区域。

- 生物特征检测:

- 心跳和呼吸:通过分析视频中的心跳和呼吸模式,可以检测出与人类生理特征不符的情况。

- 面部微表情:人类的面部微表情很难被Deepfake技术完美复制,检测微表情的不自然可能揭示Deepfake。

- 一致性检查:

- 口型和声音:检查视频中人物的口型是否与声音匹配,Deepfake可能在这方面存在不一致。

- 身体动作:分析身体动作是否协调,Deepfake可能在模拟复杂的身体动作时出现不自然的情况。

- 深度学习检测工具:

- 专门的深度学习模型:已经有一些深度学习模型被训练来专门检测Deepfake内容,这些模型可以识别视频中的异常模式。

- 元数据分析:

- 视频元数据:检查视频文件的元数据,如创建日期、编辑历史等,以查找可能的篡改痕迹。

- 第三方验证:

- 专业机构:对于重要的视频内容,可以提交给专业的检测机构进行验证

需要注意的是,随着Deepfake技术的不断进步,检测Deepfake的难度也在增加。因此,上述方法可能需要结合使用,并且需要不断更新检测工具和技术以应对新的挑战。此外,公众也应提高对Deepfake内容的警觉性,对来源不明的视频内容保持怀疑态度。

基于深度学习的Deepfake检测

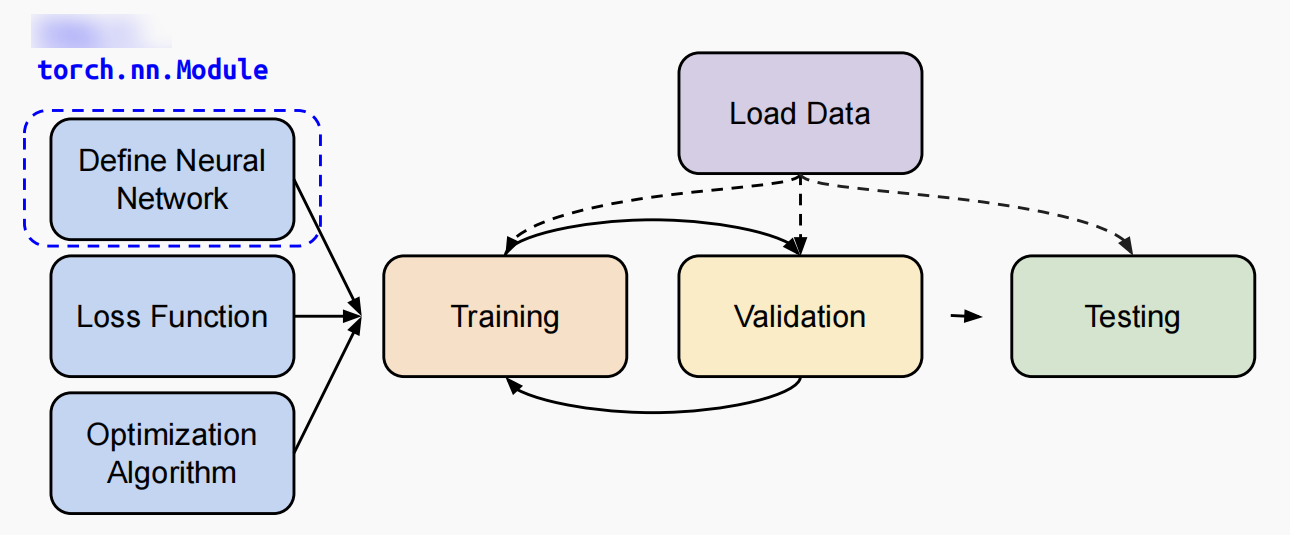

代码流程

- 模型定义:使用

timm库创建一个预训练的resnet18模型。 - 训练/验证数据加载:使用

torch.utils.data.DataLoader来加载训练集和验证集数据,并通过定义的transforms进行数据增强。 - 训练与验证过程:

- 定义了

train函数来执行模型在一个epoch上的训练过程,包括前向传播、损失计算、反向传播和参数更新。 - 定义了

validate函数来评估模型在验证集上的性能,计算准确率。

- 定义了

- 性能评估:使用准确率(Accuracy)作为性能评估的主要指标,并在每个epoch后输出验证集上的准确率。

- 提交:最后,将预测结果保存到CSV文件中,准备提交到Kaggle比赛。

模型网络定义-加载预训练模型

预训练模型是指在特定的大型数据集(如ImageNet)上预先训练好的神经网络模型。这些模型已经学习到了丰富的特征表示,能够识别和处理图像中的多种模式。使用预训练模型的好处是,它们可以在新数据集或新任务上进行微调(Fine-tuning),从而加快训练过程并提高模型性能,尤其是当可用的数据量有限时。

在下面代码中,timm.create_model('resnet18', pretrained=True, num_classes=2)这行代码就是加载了一个预训练的ResNet-18模型,其中pretrained=True表示使用在ImageNet数据集上预训练的权重,num_classes=2表示模型的输出层被修改为有2个类别的输出,以适应二分类任务(例如区分真实和Deepfake图像)。通过model = model.cuda()将模型移动到GPU上进行加速。

import timm

model = timm.create_model('resnet18', pretrained=True, num_classes=2)

model = model.cuda()

训练/验证集数据加载

-

自定义

FFDIDataset类,继承Pytorch的Dataset类。__init__:读取数据集并处理__getitem__:每次返回一个样本__len__:返回数据集大小 -

使用

DataLoader将数据分组。如果设置shuffle=True,Dataloader会自动排列所有样本的索引。我们在训练时经常设置shuffle=True。 -

数据增强操作

数据增强是一种在机器学习和深度学习中提升模型性能的重要技术。它通过应用一系列随机变换来增加训练数据的多样性,从而提高模型的泛化能力。增加数据多样性是数据增强的核心目的。通过对原始图像进行如旋转、缩放、翻转等操作,可以生成新的训练样本,使模型学习到更丰富的特征表示。

transforms.Compose: 这是一个转换操作的组合,它将多个图像预处理步骤串联起来:transforms.Resize((256, 256)):将所有图像调整为256x256像素的大小。transforms.RandomHorizontalFlip():随机水平翻转图像。transforms.RandomVerticalFlip():随机垂直翻转图像。transforms.ToTensor():将PIL图像或Numpy数组转换为torch.FloatTensor类型,并除以255以将像素值范围从[0, 255]缩放到[0, 1]。transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225]):对图像进行标准化,使用ImageNet数据集的均值和标准差。

from torch.utils.data import Dataset, DataLoader

class FFDIDataset(Dataset):

def __init__(self, img_path, img_label, transform=None):

self.img_path = img_path

self.img_label = img_label

if transform is not None:

self.transform = transform

else:

self.transform = None

def __getitem__(self, index):

img = Image.open(self.img_path[index]).convert('RGB')

if self.transform is not None:

img = self.transform(img)

return img, torch.from_numpy(np.array(self.img_label[index]))

def __len__(self):

return len(self.img_path)

train_loader = torch.utils.data.DataLoader(

FFDIDataset(train_label['path'], train_label['target'],

transforms.Compose([

transforms.Resize((256, 256)),

transforms.RandomHorizontalFlip(), # 随机水平翻转

transforms.RandomVerticalFlip(), # 随机垂直翻转

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

])

), batch_size=bs_value, shuffle=True, num_workers=4, pin_memory=True, collate_fn=collate_fn, drop_last=False

)

val_loader = torch.utils.data.DataLoader(

FFDIDataset(val_label['path'], val_label['target'],

transforms.Compose([

transforms.Resize((256, 256)),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

])

), batch_size=bs_value

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?