数据抓取 如果你想从网页上抓点数据,比如排行榜、新闻啥的,那BeautifulSoup这工具可得好好学学。

它就像个智能小助手,能帮你把网页里乱七八糟的代码捋清楚,轻松拿到想要的信息。 ## 先把工具装起来 这玩意儿不是Python自带的,得自己动手装一下。打开命令行,敲两行代码就行:

pip install BeautifulSoup4 -i https://pypi.tuna.tsinghua.edu.cn/simple

pip install bs4 -i https://pypi.tuna.tsinghua.edu.cn/simple

装完了还能测试下好不好使,在Python里输入几行简单的命令,要是能输出"Hello",那就成了。

解析器选哪个? 用BeautifulSoup得配个解析器,就像开车得有方向盘一样。

常见的有这么几种:

- Python标准库:不用额外装,速度一般,对付普通网页够用

- lxml HTML解析器:速度快,解析能力强,但得装个C语言库

- lxml XML解析器:专门对付XML文件的,同样要装C语言库

- html5lib:容错性最好,跟浏览器解析方式一样,但速度慢点 一般情况下,用lxml就挺合适,又快又好用。

基本操作很简单 网页里的内容都是用各种标签包起来的,比如`<p>`、`<div>`、`<a>`这些。BeautifulSoup能轻松找到这些标签,还能提取里面的内容。

比如想找`<li>`标签,直接用`soup.li`就行,要是有好多个,它会返回第一个。想看看标签里的文字,加个`.string`就行,像`soup.li.string`。

标签里的属性也能轻松拿到,比如链接地址`href`,用`soup.li.a.attrs['href']`或`soup.li.a.get('href')`都能搞定,后者更不容易出错。 有时候还需要找子节点、父节点或者兄弟节点,比如用`children`找所有子节点,`parent`找父节点,`next_sibling`找下一个兄弟节点,这些都很方便。

高级点的查找方法 如果想找一堆符合条件的标签,`find_all()`方法就派上用场了。

比如想找所有的`<li>`标签,用`soup.find_all('li')`,返回的是个列表,想拿第几个就加个索引。 还能根据属性来找,比如找class是`lavalamp-item`的标签,用`soup.find_all(class_='lavalamp-item')`就行,注意这里class后面加了个下划线,因为class是Python的关键字,不加会出错。 想只拿标签里的文本,除了用`string`,还能用`get_text()`方法,它能把所有文本都取出来,连子孙节点里的都不放过。

CSS选择器更好用 要是你懂点CSS选择器,那用`soup.select()`会更顺手。id选择器用`#`开头,类选择器用`.`开头,元素选择器直接写标签名。

比如想找id是`nav`的div标签用soup.select("#nav")`;想找class是`lavalamp-item`下面的`<a>`标签,用`soup.select(".lavalamp-item > a")`。 用Chrome浏览器还能偷懒,右键选中元素,点"copy"再点"copy selector",就能直接得到CSS选择器,不用自己写了。

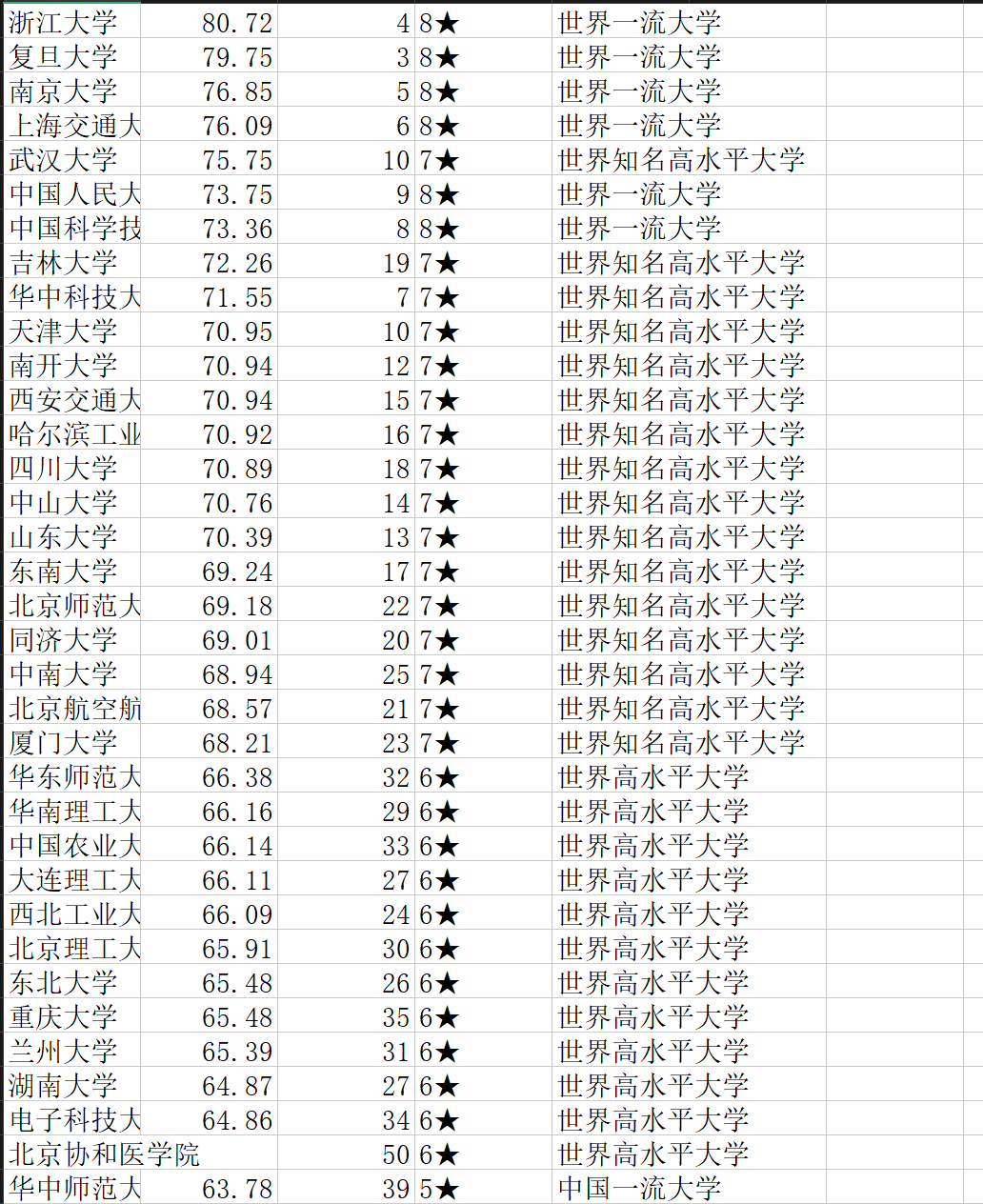

实际案例看看效果 爬取大学排名 想爬中国大学排名?先获取网页内容,然后用BeautifulSoup解析。找到表格里的行和列,把学校名称、总分、排名这些信息提取出来,最后存成CSV文件,几步就搞定。

import requests

from bs4 import BeautifulSoup

import csv

def get_html(url, time=3): # get请求通用函数,去掉了user-agent简化代码

try:

r = requests.get(url, timeout=time) # 发送请求

r.encoding = r.apparent_encoding # 设置返回内容的字符集编码

r.raise_for_status() # 返回的状态码不等于200抛出异常

return r.text # 返回网页的文本内容

except Exception as error:

print(error)

from bs4 import BeautifulSoup

def parser(html): # 解析函数

soup = BeautifulSoup(html, "lxml") # html转换为soup对象

out_list = [] # 解析函数输出数据的列表

for row in soup.select("table>tbody>tr"): # 循环遍历tr

td_html = row.select("td") # 获取td

row_data = [

td_html[1].text.strip(), # 学校名称

td_html[2].text.strip(), # 总分

td_html[3].text.strip(), # 全国排名

td_html[4].text.strip(), # 星级

td_html[5].text.strip(), # 办学层次

]

out_list.append(row_data) # 将解析的每行数据插入到输出列表中

return out_list

import requests

from bs4 import BeautifulSoup

import csv

def get_html(url, time=3): # get请求通用函数,去掉了user-agent简化代码

try:

r = requests.get(url, timeout=time) # 发送请求

r.encoding = r.apparent_encoding # 设置返回内容的字符集编码

r.raise_for_status() # 返回的状态码不等于200抛出异常

return r.text # 返回网页的文本内容

except Exception as error:

print(error)

def parser(html): # 解析函数

soup = BeautifulSoup(html, "lxml") # html转换为soup对象

out_list = [] # 解析函数输出数据的列表

for row in soup.select("table>tbody>tr"): # 循环遍历tr

td_html = row.select("td") # 获取td

row_data = [

td_html[1].text.strip(), # 学校名称

td_html[2].text.strip(), # 总分

td_html[3].text.strip(), # 全国排名

td_html[4].text.strip(), # 星级

td_html[5].text.strip(), # 办学层次

]

out_list.append(row_data) # 将解析的每行数据插入到输出列表中

return out_list

def save_csv(item, path): # 数据存储,将list数据写入文件

with open(path, "w+", newline='', encoding="utf-8") as f: # 创建utf8编码文件

csv_write = csv.writer(f) # 创建写入对象

csv_write.writerows(item) # 一次性写入多行

if __name__ == "__main__":

url = "http://www.bspider.top/gaosan/"

html = get_html(url) # 获取网页数据

out_list = parser(html) # 解析网页,输出列表数据

save_csv(out_list, "school.csv") # 数据存储

爬取百度新闻 爬百度新闻的热点要闻也差不多,找到新闻标题和链接所在的标签,提取出来存成CSV,很快就能拿到一堆新闻信息。 总的来说,BeautifulSoup是个抓取网页数据的好工具,操作简单,功能强大,稍微学学就能上手,想从网页上抓点数据的话,赶紧试试吧!

import requests

from bs4 import BeautifulSoup

import csv

def get_html(url, time=10): # get请求通用函数,去掉了user-agent简化代码

try:

r = requests.get(url, timeout=time) # 发送请求

r.encoding = r.apparent_encoding # 设置返回内容的字符集编码

r.raise_for_status() # 返回的状态码不等于200抛出异常

return r.text # 返回网页的文本内容

except Exception as error:

print(error)

from bs4 import BeautifulSoup

def parser(html): # 解析函数

soup = BeautifulSoup(html, "lxml") # html转换为soup对象

out_list = []

for row in soup.select("#pane-news ul>li"):

print(row)

row_list = [

row.text.replace(' ', '').replace("\n", ""), # 新闻标题

row.select("a")[0].attrs["href"].replace(' ', '').replace("\n", "") # 详情链接

]

out_list.append(row_list)

return out_list

import requests

from bs4 import BeautifulSoup

import csv

def get_html(url, time=10):

try:

r = requests.get(url, timeout=time)

r.encoding = r.apparent_encoding

r.raise_for_status()

return r.text

except Exception as error:

print(error)

def parser(html):

soup = BeautifulSoup(html, "lxml")

out_list = []

for row in soup.select("#pane-news ul>li"):

row_list = [

row.text.replace(' ', '').replace("\n", ""),

row.select("a")[0].attrs["href"].replace(' ', '').replace("\n", "")

]

out_list.append(row_list)

return out_list

def save_csv(item, path):

with open(path, "a+", newline='', encoding="utf-8") as f:

csv_write = csv.writer(f)

csv_write.writerows(item)

if __name__ == "__main__":

url = "http://www.bspider.top/baidunews/"

html = get_html(url)

out_list = parser(html)

save_csv(out_list, "news3.csv")

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?