一、引言

我们知道使用一个 Dockerfile 模板文件可以定义一个单独的应用容器,如果需要定义多个容器就需要服务编排。服务编排有很多种技术方案,今天给大家介绍 Docker 官方产品 Docker-Compose

Dockerfile 可以定义一个单独的应用容器;而 docker-compose 则允许用户在一个模板(YAML 格式)中定义一组相关联的应用容器(被称为一个 project,即项目),例如一个 Web 服务容器再加上后端的数据库服务容器(LNMP)等

Docker-Compose 项目由 Python 编写,调用 Docker 服务提供的 API 来对容器进行管理。因此,只要所操作的平台支持 Docker API,就可以在其上利用 Compose 来进行编排管理

二、docker-compose简介

-

compose是一个用于定义及允许多个Docker容器的工具,主要是通过一个YAML文件进行服务配置

-

使用Docker Compose不再需要使用Shell脚本来启动容器

-

Docker Compose非常适合组合使用多个容器进行开发的场景

-

docker-compose 是现在单机上完成容器集群编排的管理 单机容器编排

-

docker-compose.yml compose模板文件

-

工程(项目) project lnmp

-

服务 nginx MySQL PHP

-

容器 container 容器名 --name 主机名 -h 镜像 image:tage 端口 -p 网络 --natework

三、YAML简介

3.1 yaml文件概述

YAML(语言)的设计目标,就是方便人类读写,它实质上是一种通用的数据串行化格式

它的基本语法规则如下:

- 大小写敏感

- 使用缩进表示层级关系

- 缩进时不允许使用Tab键,只允许使用空格

- 缩进的空格数目不重要,只要相同层级的元素左侧对齐即可

#表示注释

3.2 YAML支持的数据结构

- 对象,键值对的集合

- 数组,一组按次序排列的值,又称序列

- 纯量,单个的,不可再分的值

3.3 YAML文件格式及编写注意事项

YAML 是一种标记语言,它可以很直观的展示数据序列化格式,可读性高。类似于 XML数据描述语言,语法比 XML简单的很多。YAML 数据结构通过缩进来表示,连续的项目通过减号来表示,键值对用冒号分隔,数组用中括号 [ ] 括起来,hash 用花括号 {}括起来。

YAML 用于配置和管理 yaml 是一个简洁 的非标记性语言,人性化较易读内容格式

3.3.1 使用 YAML 时需要注意下面事项:

①大小写敏感·

②通过缩进表示层级关系

③不支持制表符 tab 键缩进,只能使用空格缩进·缩进的空格数目不重要,只要相同层级左对齐,通常开头缩进2个空格·

④ 用#号注释

⑤符号字符后缩进1个空格,如冒号 : 、逗号 , 、横杠-

⑥如果包含特殊字符用单引号()引起来会作为普通字符串处理,双引号(""):特殊字符作为本身想表示的意思name:"Hi,\nTom"

四、docker compose配置常用字段

| 字段 | 描述 |

| build | 指定dockerfile文件名 |

| dockerfile | 构建镜像上下文路径 |

| context | 可以是dockerfile的路径,或者指向git仓库的url地址 |

| image | 指定镜像 |

| command | 执行命令,覆盖容器启动后默认执行的命令 |

| container_name | 指定容器名称,由于容器名称是唯一的,如果指定自定义名称,则无法scale指定容器数量 |

| deploy | 指定部署和运行服务相关配置,智能在swarm模式使用 |

| environment | 添加环境变量 |

| networks | 加入网络,引用顶级networks下条目 |

| network_mode | 设置容器的网络模式,入host,bridge |

| ports | 暴露容器端口,与-p相同,但端口不能低于60 |

| volumes | 挂载一个宿主机目录或命令卷到容器,命名卷要在顶级volumes定义卷名称 |

| volumes_from | 版本,从一个主机或容器挂载卷,可选参数:ro和:rw,仅版本2支持 |

| hostname | 容器主机名 |

| sysctls | 在容器内设置内核参数 |

| links | 连接到另外一个容器,-服务名称【服务别名】 |

| privileged | 用来给容器root权限,注意是不安全的,true | false |

| restart | 设置重启策略, no,always,nounless-st-failure,oped |

五、dockercompose常用命令

| 字段 | 描述 |

| build | 重新构建服务 |

| ps | 列出容器 |

| up | 创建和启动容器 |

| exec | 在容器里面执行命令 |

| scale | 指定一个服务容器启动数量 |

| top | 显示容器进程 |

| logs | 查看容器输出 |

| down | 删除容器、网络、数据卷和镜像 |

| stop/start/restart | 停止/启动/重启服务 |

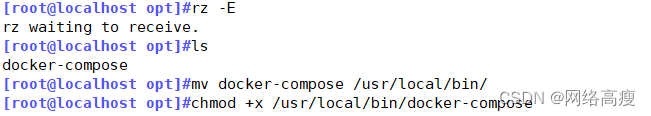

5.1 docker--compose安装部署

#注意必须是在安装docker的基础上

curl -L https://github.com/docker/compose/releases/download/1.21.1/docker-compose-`uname -s`-`uname -m` -o /usr/local/bin/docker-compose

#下载安装包单独安装DockerCompose

chmod +x /usr/local/bin/docker-compose

#docker-compose添加执行权限

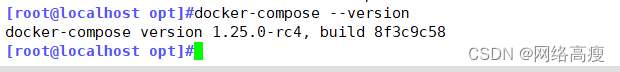

docker-compose --version

#查看docker-compose版本

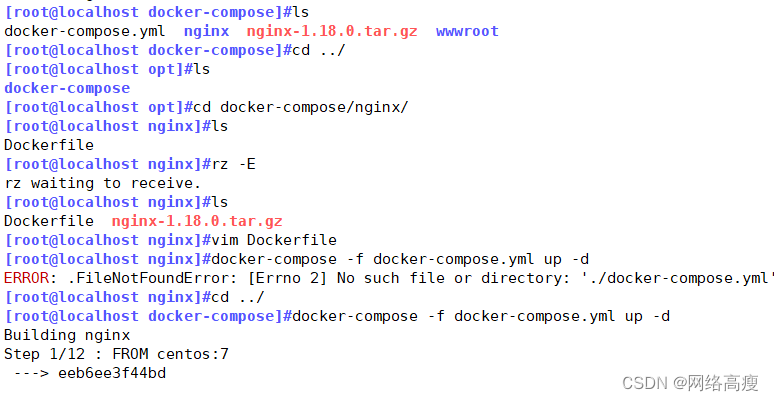

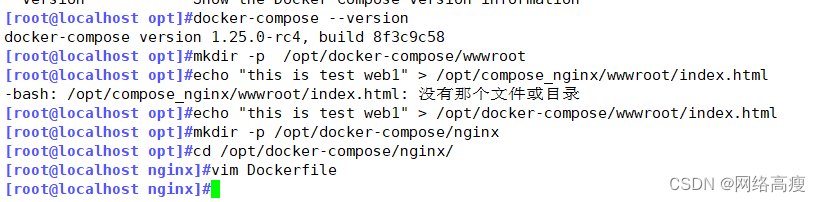

六、docker-compose部署nginx

6.1 准备依赖文件

①首先创建一个docker-compose的文件夹其中创建nginx文件夹用于nginx的镜像生成和wwwroot文件夹用于存放自定义编写的nginx主页文件

mkdir -p /opt/docker-compose

mkdir -p /opt/docker-compose/wwwroot

echo "<h1>this is test web</h1>" > /opt/compose_nginx/wwwroot/index.html

#创建自定义主页内容

mkdir -p /opt/docker-compose/nginx

②然后让nginx的编译安装包放入/opt/docker-compose/nginx

③进入目录编写nginx的Dockerfile文件实现nginx镜像生成

cd /opt/docker-compose/nginx

vim Dockerfile

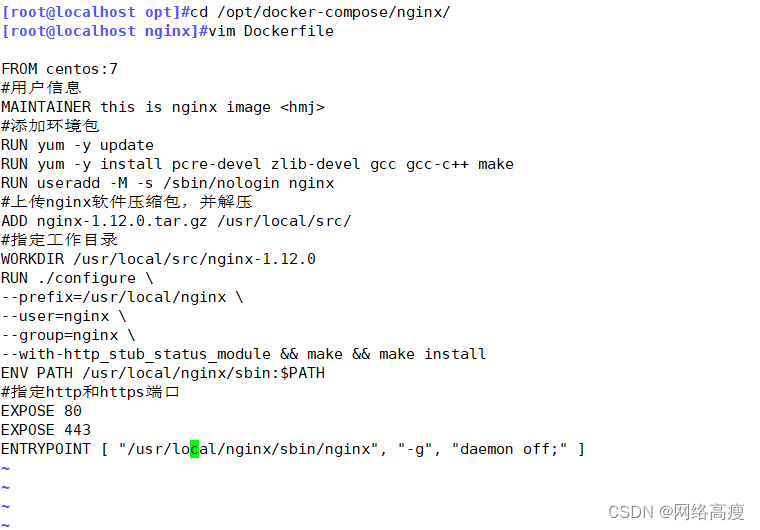

#文件内容如下:

FROM centos:7

#定义基于镜像centos:7

MAINTAINER this is nginx image <nginx>

#用户信息,镜像维护用户为nginx

RUN yum -y install pcre-devel zlib-devel gcc gcc-c++ make

#安装编译nginx需要的编译工具

RUN useradd -M -s /sbin/nologin nginx

#创建nginx用户

ADD nginx-1.18.0.tar.gz /opt/

#将nginx包复制到镜像的/opt/目录下,docker会自动解压

WORKDIR /opt/nginx-1.18.0

#定义后面命令的执行路径是解压后的nginx包目录

RUN ./configure \

--prefix=/usr/local/nginx \

--user=nginx \

--group=nginx \

--with-http_stub_status_module && make && make install

#编译安装nginx

ENV PATH /usr/local/nginx/sbin:$PATH

#定义变量PATH

EXPOSE 80

EXPOSE 443

#指定http和https的端口

ENTRYPOINT [ "/usr/local/nginx/sbin/nginx", "-g", "daemon off;" ]

#关闭nginx在后台运行,保存退出。

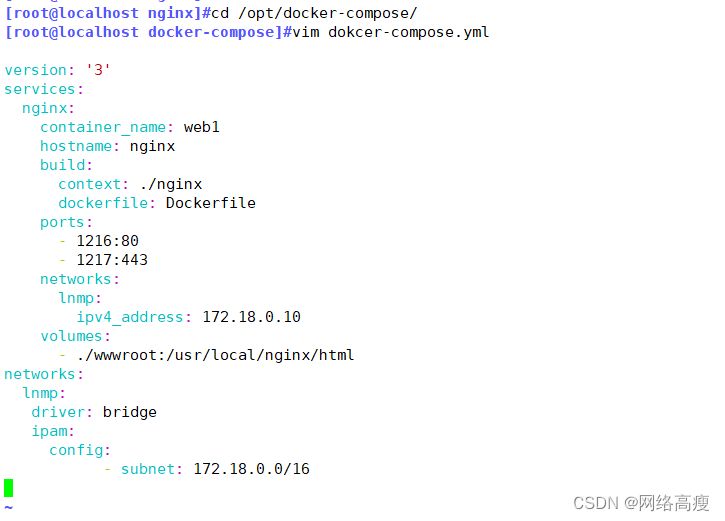

④进入/opt/docker-compose目录编写docker-compose.yml文件

cd /opt/docker-compose

vim docker-compose.yml

#文件内容如下:

version: '3'

#docker-compose版本为3

services:

#使用services定义服务

nginx:

#容器名为nginx

container_name: web1

#使用dockerfile来构建镜像

hostname: nginx-test

#主机名为nginx-test

build:

context: ./nginx

#指定Dockerfile文件所在位置

dockerfile: Dockerfile

#指定文件名

ports:

#映射端口

- 1216:80

- 1217:443

networks:

lnmp:

ipv4_address: 172.18.0.10

#加入网络设置此容器ip

volumes:

- ./wwwroot:/usr/local/nginx/html

#设置数据卷挂载

networks:

#设置网络为自定义网络

lnmp:

driver: bridge

#网络模式

ipam:

config:

- subnet: 172.18.0.0/16

#设置自定义网络的网段,设置完后保存退出

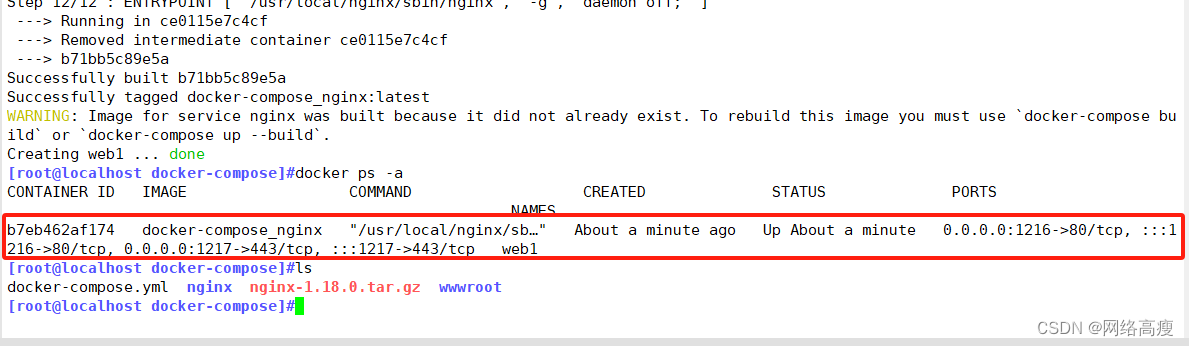

⑤编写完毕docker-compose.yml文件后进行镜像创建并启动容器

docker-compose -f docker-compose.yml up -d

#创建并启动容器,-f指定yml文件,-d表示在后台运行

docker ps -a

#可以看到容器在运行及映射端口

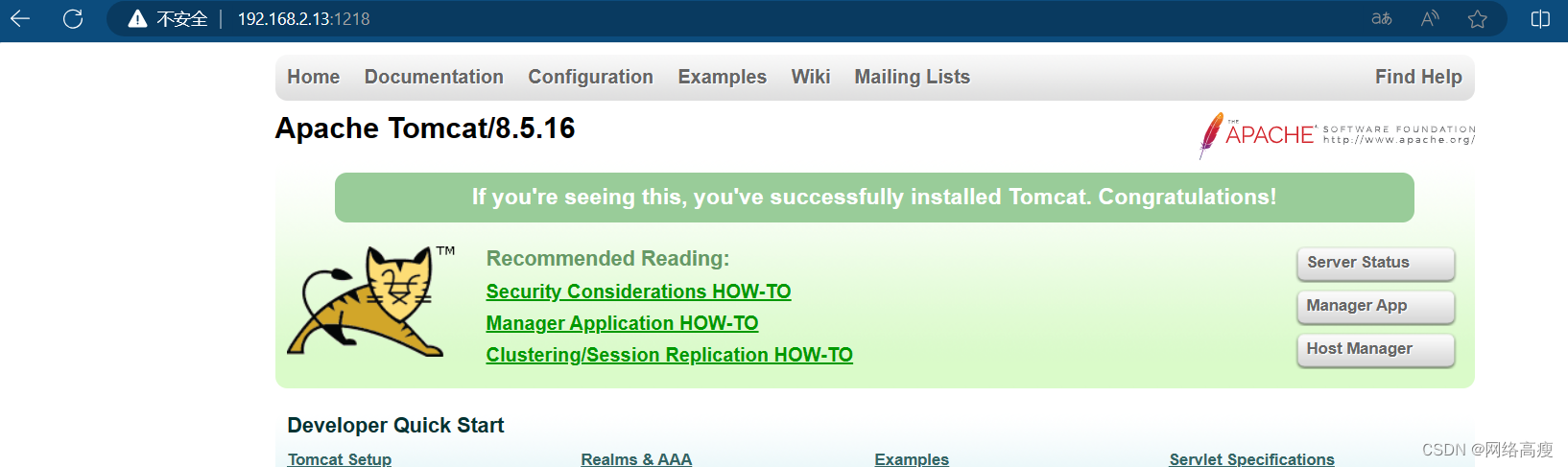

浏览器访问映射端口进行测试成功。

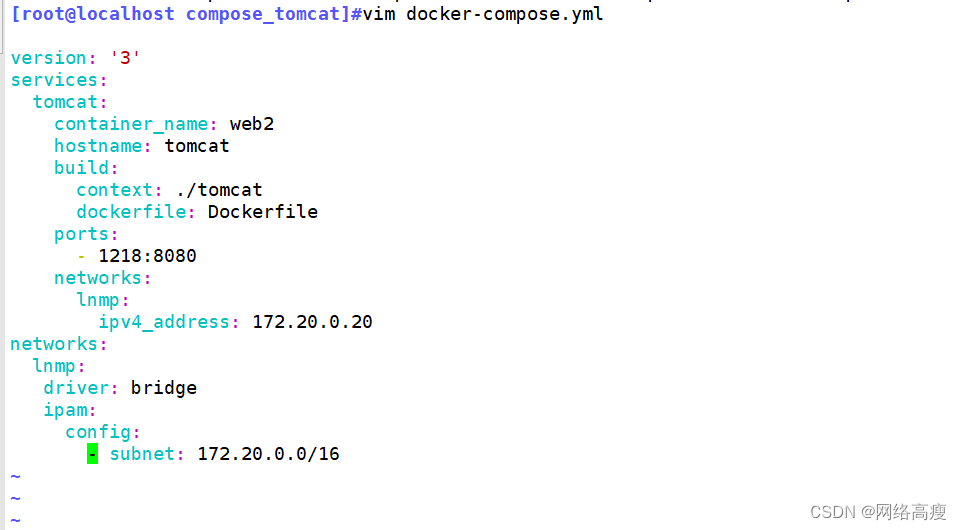

七、docker-compose部署Tomcat

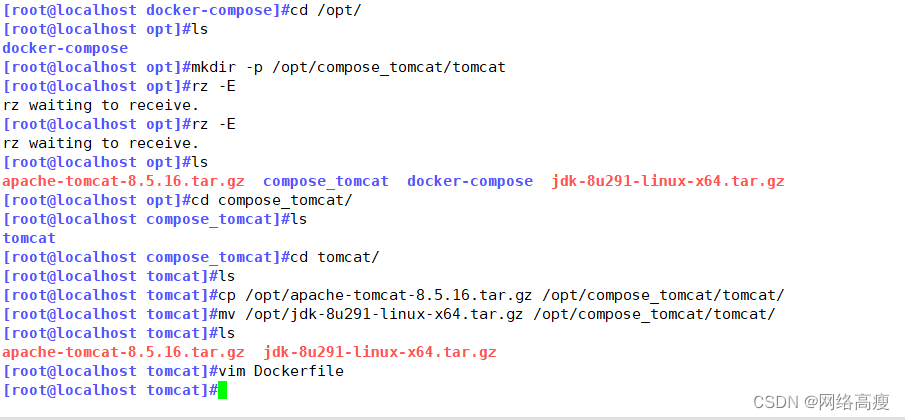

①首先创建一个tomcat的docker_compose文件夹

mkdir -p /opt/compose_tomcat/tomcat

②将tomcat编译安装的jdk包和tomcat包放入tomcat文件夹中

③进入tomcat文件夹编写Dockerfile文件

cd /opt/compose_tomcat/tomcat

vim Dockerfile

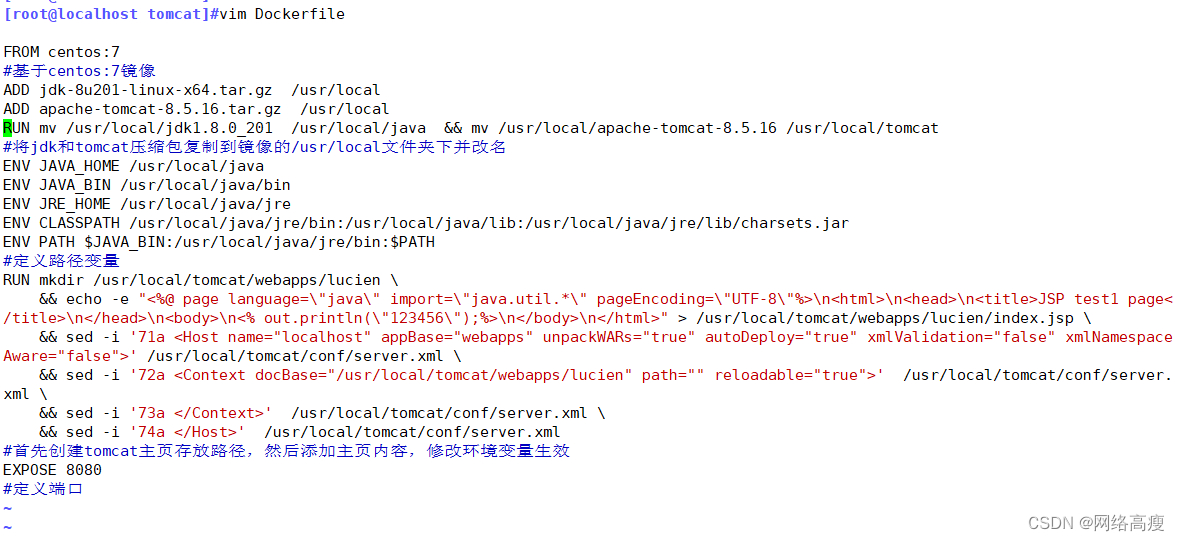

#文件内容如下

FROM centos:7

#基于centos:7镜像

ADD jdk-8u201-linux-x64.tar.gz /usr/local

ADD apache-tomcat-9.0.16.tar.gz /usr/local

RUN mv /usr/local/jdk1.8.0_201 /usr/local/java && mv /usr/local/apache-tomcat-9.0.16 /usr/local/tomcat

#将jdk和tomcat压缩包复制到镜像的/usr/local文件夹下并改名

ENV JAVA_HOME /usr/local/java

ENV JAVA_BIN /usr/local/java/bin

ENV JRE_HOME /usr/local/java/jre

ENV CLASSPATH /usr/local/java/jre/bin:/usr/local/java/lib:/usr/local/java/jre/lib/charsets.jar

ENV PATH $JAVA_BIN:/usr/local/java/jre/bin:$PATH

#定义路径变量

RUN mkdir /usr/local/tomcat/webapps/lucien \

&& echo -e "<%@ page language=\"java\" import=\"java.util.*\" pageEncoding=\"UTF-8\"%>\n<html>\n<head>\n<title>JSP test1 page</title>\n</head>\n<body>\n<% out.println(\"123456\");%>\n</body>\n</html>

八、docker consul容器服务更新与发现

8.1 什么是服务更新与发现(consul)

服务注册与发现是微服务架构中不可或缺的重要组件。起初服务都是单节点的,不保障高可用性,也不考虑服务的压力承载,服务之间调用单纯的通过接口访问。直到后来出现了多个节点的分布式架构,起初的解决手段是在服务前端负载均衡,这样前端必须要知道所有后端服务的网络位置,并配置在配置文件中。这里就会有几个问题:

●如果需要调用后端服务A-N,就需要配置N个服务的网络位置,配置很麻烦

●后端服务的网络位置变化,都需要改变每个调用者的配置

既然有这些问题,那么服务注册与发现就是解决这些问题的。后端服务A-N可以把当前自己的网络位置注册到服务发现模块,服务发现就以K-V的方式记录下来,K一般是服务名,V就是IP:PORT。

服务发现模块定时的进行健康检查,轮询查看这些后端服务能不能访问的了。前端在调用后端服务A-N的时候,就跑去服务发现模块问下它们的网络位置,然后再调用它们的服务。这样的方式就可以解决上面的问题了,前端完全不需要记录这些后端服务的网络位置,前端和后端完全解耦!

consul是服务管理软件支持多数据中心、分布式高可用的、服务发现和配置共享,他有两种运行模式server 和 client。 每个数据中心官方建议需要3或5个server节点以保证数据安全,同时保证server-leader的选举能够正确的进行。

在client模式下,所有注册到当前节点的服务会被转发到server节点,本身是不持久化这些信息。

在server模式下,功能和client模式相似,唯一不同的是,它会把所有的信息持久化到本地,这样遇到故障,信息是可以被保留的。

server-leader是所有server节点的老大,它和其它server节点不同的是,它需要负责同步注册的信息给其它的server节点,同时也要负责各个节点的健康监测。

安装consul是用于服务注册,也就是容器本身的一些信息注册到consul里面,其他程序可以通过consul获取注册的相关服务信息,这就是服务注册与发现。

8.2 consul 部署规划

① 实验目的🧪

通过consul部署实现自动发现注册服务端(后端服务器),并可检查容器运行状态自动注册还可注销 docker 容器的服务到服务配置中心

② 实验环境及拓扑

| 服务器功能 | 服务器ip | 服务器部署程序 |

| consul服务器 | 192.168.2.13 | 运行consul服务、nginx服务、consul-template守护进程 |

| registrator服务器 | 192.168.2.14 | 运行registrator容器、运行nginx容器 |

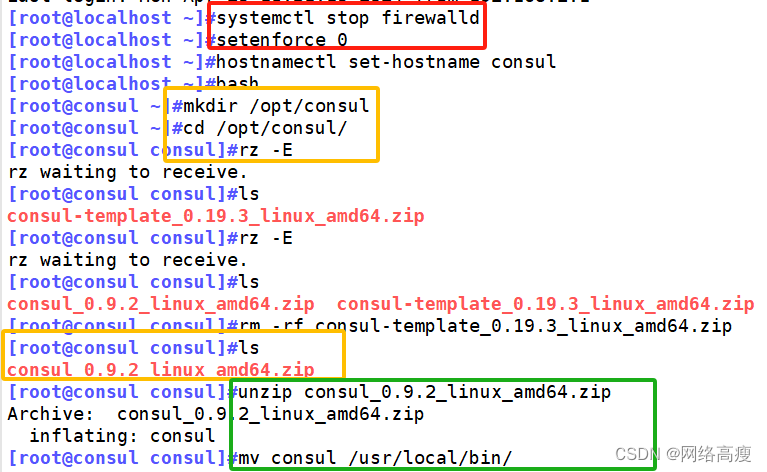

------------------------------------------------------ consul服务器 --------------------------------------------------------

systemctl stop firewalld.service

setenforce 0

1. 建立 Consul 服务

mkdir /opt/consul

cd /opt/consulrz -E

rz waiting to receive.

[root@localhost consul]#ls

consul_0.9.2_linux_amd64.zip

unzip consul_0.9.2_linux_amd64.zip

mv consul /usr/local/bin///设置代理,在后台启动 consul 服务端

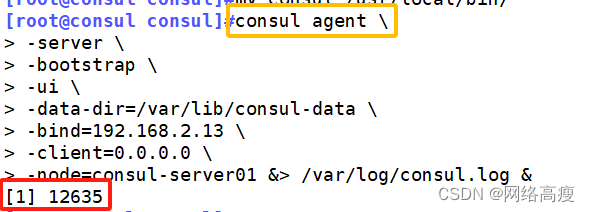

consul agent \

-server \

-bootstrap \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.2.13 \

-client=0.0.0.0 \

-node=consul-server01 &> /var/log/consul.log &

----------------------------------------------------------------------------------------------------------

-server: 以server身份启动。默认是client。

-bootstrap :用来控制一个server是否在bootstrap模式,在一个数据中心中只能有一个server处于bootstrap模式,当一个server处于 bootstrap模式时,可以自己选举为 server-leader。

-bootstrap-expect=2 :集群要求的最少server数量,当低于这个数量,集群即失效。

-ui :指定开启 UI 界面,这样可以通过 http://localhost:8500/ui 这样的地址访问 consul 自带的 web UI 界面。

-data-dir :指定数据存储目录。

-bind :指定用来在集群内部的通讯地址,集群内的所有节点到此地址都必须是可达的,默认是0.0.0.0。

-client :指定 consul 绑定在哪个 client 地址上,这个地址提供 HTTP、DNS、RPC 等服务,默认是 127.0.0.1。

-node :节点在集群中的名称,在一个集群中必须是唯一的,默认是该节点的主机名。

-datacenter :指定数据中心名称,默认是dc1。

----------------------------------------------------------------------------------------------------------

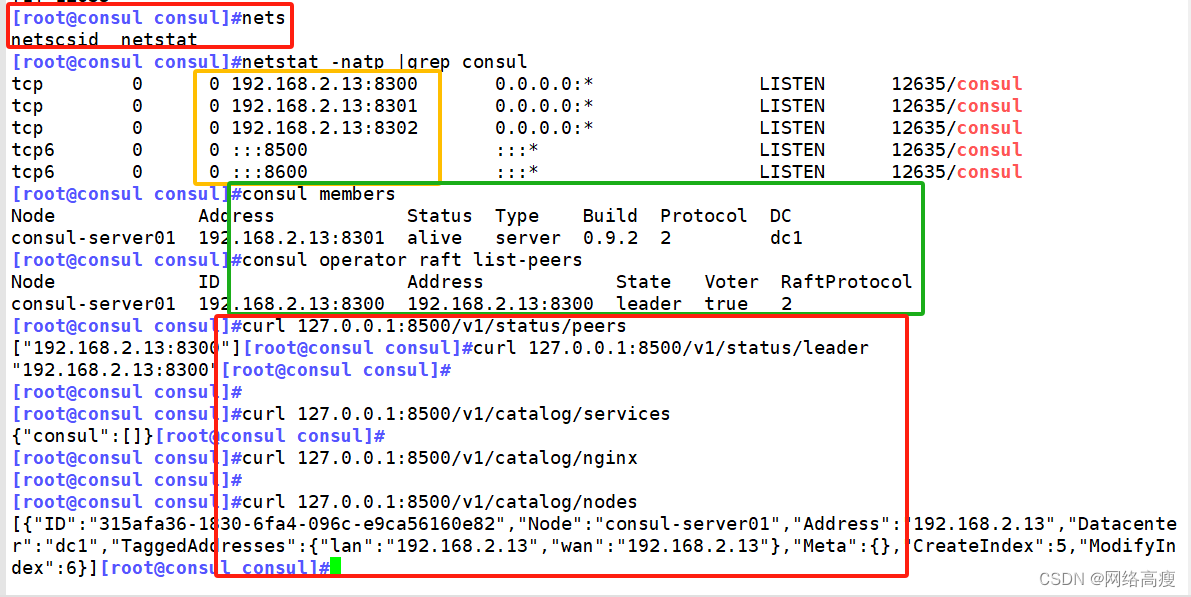

netstat -natp | grep consul

启动consul后默认会监听5个端口:

8300:replication、leader farwarding的端口

8301:lan cossip的端口

8302:wan gossip的端口

8500:web ui界面的端口

8600:使用dns协议查看节点信息的端口2. 查看集群信息

#查看members状态

consul members

Node Address Status Type Build Protocol DC

consul-server01 192.168.10.23:8301 alive server 0.9.2 2 dc1#查看集群状态

consul operator raft list-peersconsul info | grep leader

leader = true

leader_addr = 192.168.10.23:83003. 通过 http api 获取集群信息

curl 127.0.0.1:8500/v1/status/peers #查看集群server成员

curl 127.0.0.1:8500/v1/status/leader #集群 server-leader

curl 127.0.0.1:8500/v1/catalog/services #注册的所有服务

curl 127.0.0.1:8500/v1/catalog/nginx #查看 nginx 服务信息

curl 127.0.0.1:8500/v1/catalog/nodes #集群节点详细信息

---------------------------------------------------- registrator服务器 -----------------------------------------------------

//容器服务自动加入 Nginx 集群

1. 安装 Gliderlabs/Registrator

Gliderlabs/Registrator 可检查容器运行状态自动注册,还可注销 docker 容器的服务到服务配置中心。目前支持 Consul、Etcd 和 SkyDNS2。版本要低不能太高

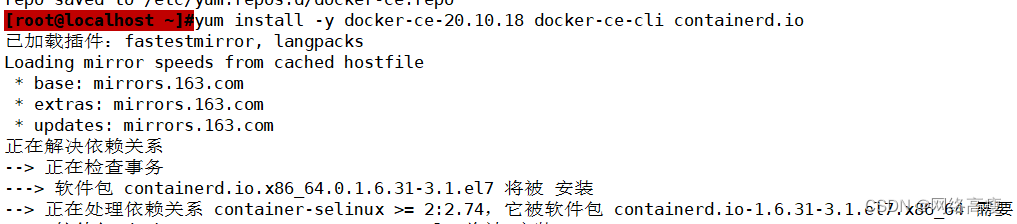

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce-20.10.18 docker-ce-cli containerd.io

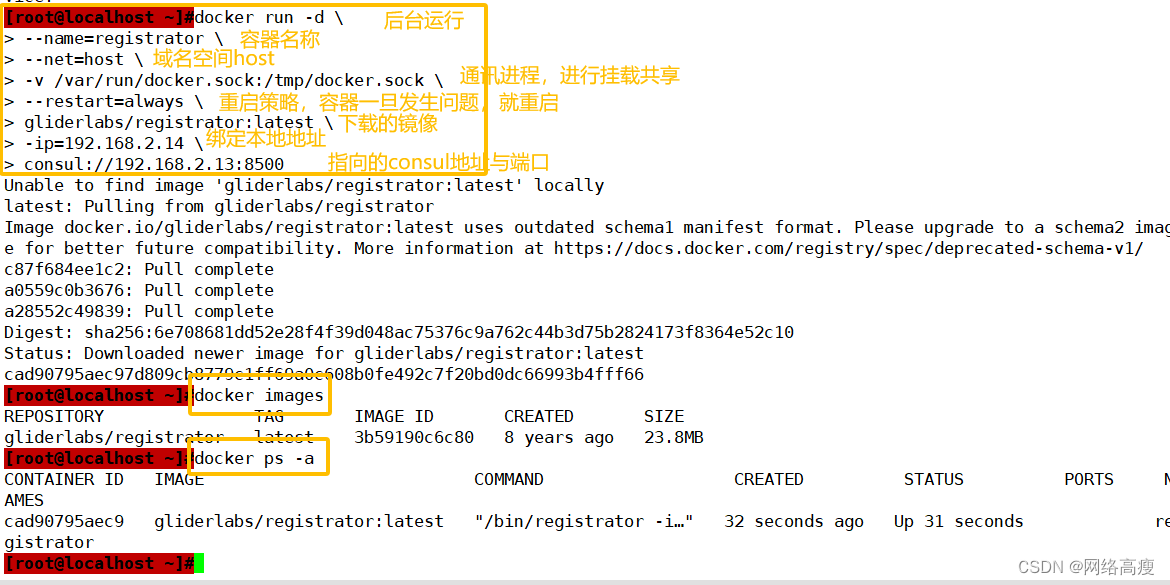

docker run -d \

--name=registrator \

--net=host \

-v /var/run/docker.sock:/tmp/docker.sock \

--restart=always \

gliderlabs/registrator:latest \

--ip=192.168.2.14 \

consul://192.168.2.15:8500如果出现问题可能是docker版本高的原因

#consul :指定consul服务器的IP和端口。

systemctl restart docker

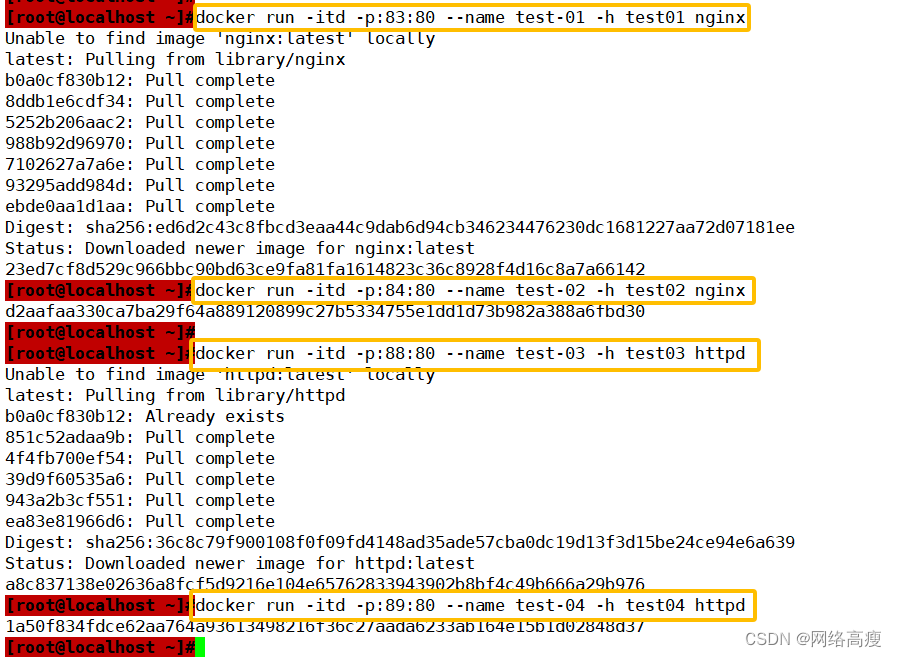

docker run -itd -p:81:80 --name test-01 -h test01 nginx

docker run -itd -p:82:80 --name test-02 -h test02 nginx

docker run -itd -p:83:80 --name test-03 -h test03 httpd

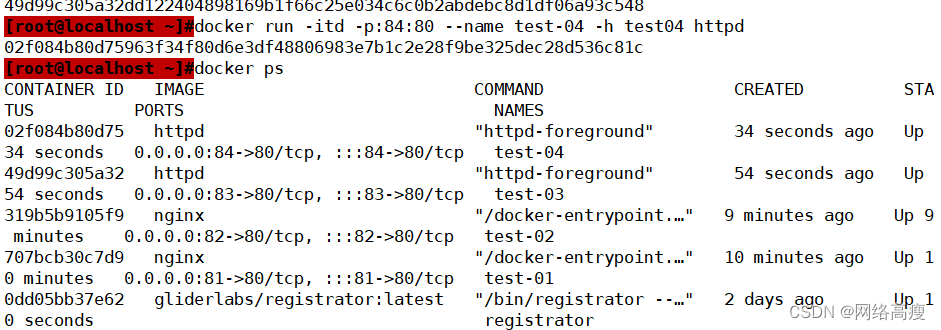

docker run -itd -p:84:80 --name test-04 -h test04 httpd#创建2个nginx容器,2个httpd容器测试发现功能是否正常

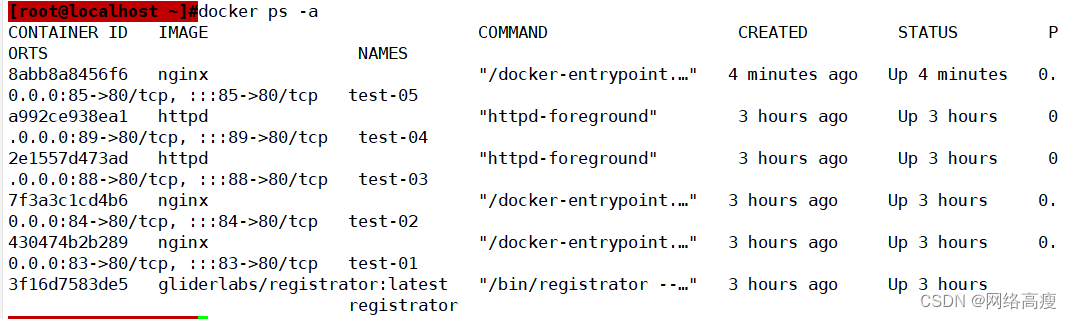

docker ps

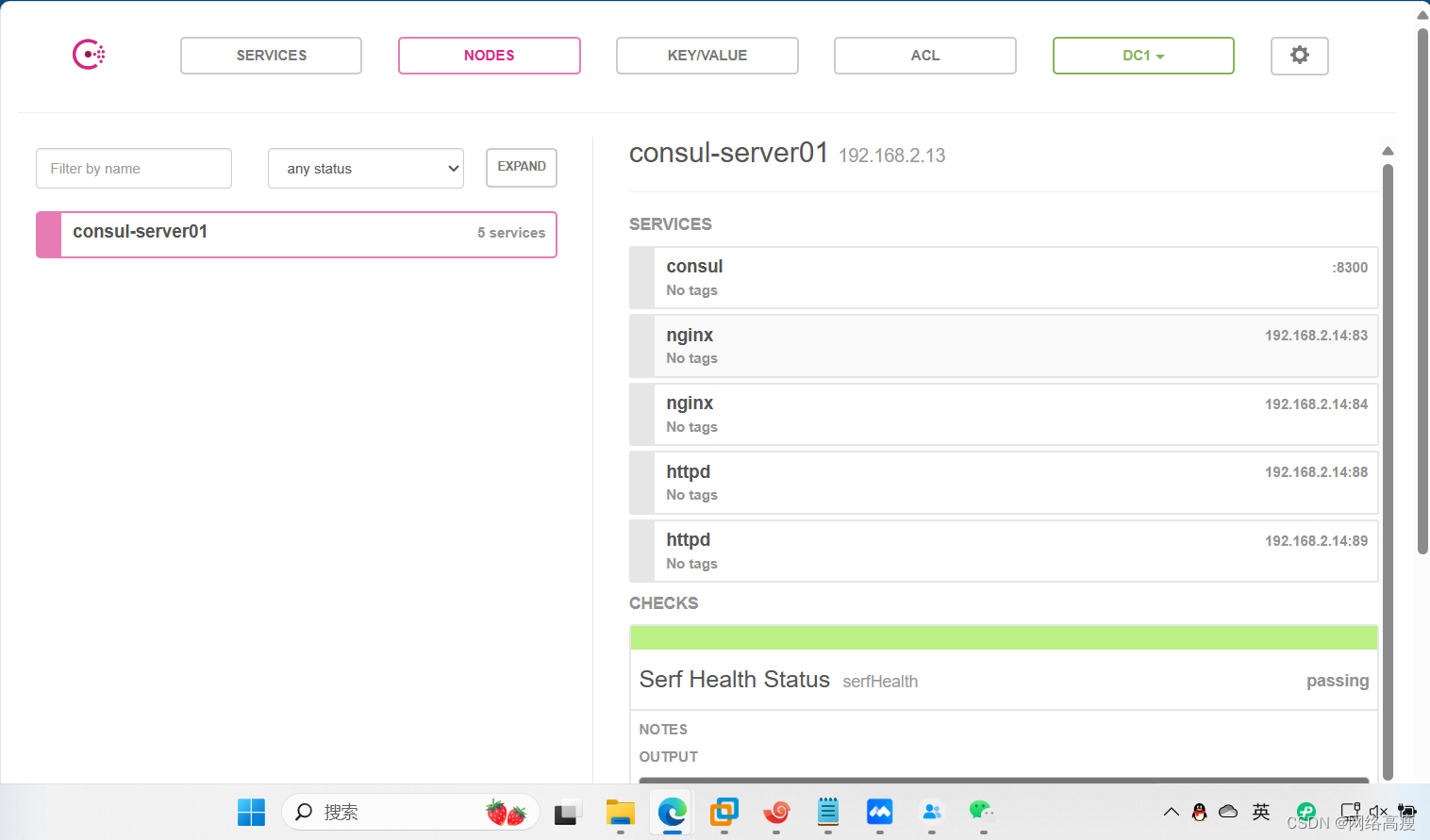

真机访问http://192.168.2.14:8500

此时应该可以发现5个服务

③consul集群添加consul-template 以实现容器自动加入

Consul-Template是一个守护进程,用于实时查询Consul集群信息,并更新文件系统上任意数量的指定模板,生成配置文件,更新完成以后,可以查询Consul中的服务目录,Key、Key-values等

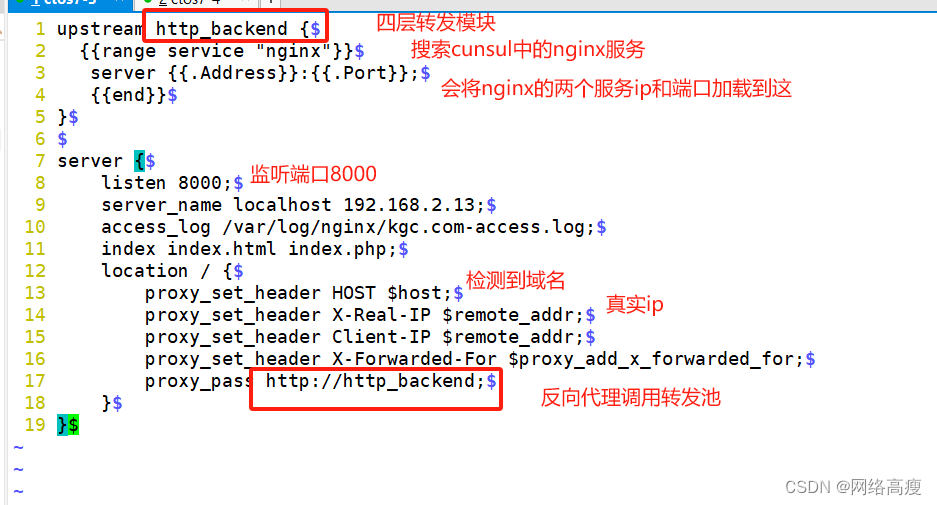

1. 准备 template nginx 模板文件

//在consul服务器上操作

vim /opt/consul/nginx.ctmpl

#定义nginx upstream一个简单模板

upstream http_backend {

{{range service "nginx"}}

server {{.Address}}:{{.Port}};

{{end}}

}#定义一个server,监听8000端口,反向代理到upstream

server {

listen 8000;

server_name localhost 192.168.2.13;

access_log /var/log/nginx/kgc.com-access.log; #修改日志路径

index index.html index.php;

location / {

proxy_set_header HOST $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header Client-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_pass http://http_backend;

}

}

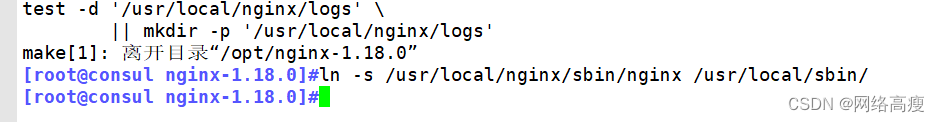

2. 编译安装nginx

yum -y install pcre-devel zlib-devel gcc gcc-c++ make

useradd -M -s /sbin/nologin nginx

tar zxvf nginx-1.18.0.tar.gz -C /opt/

cd /opt/nginx-1.18.0/

./configure --prefix=/usr/local/nginx --user=nginx --group=nginx && make -j 2&& make installln -s /usr/local/nginx/sbin/nginx /usr/local/sbin/

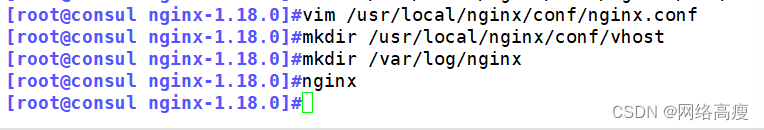

3. 配置 nginx

vim /usr/local/nginx/conf/nginx.conf

......

http {

include mime.types;

include vhost/*.conf; #添加虚拟主机目录

default_type application/octet-stream;

......//创建虚拟主机目录

mkdir /usr/local/nginx/conf/vhost//创建日志文件目录

mkdir /var/log/nginx

//启动nginx

nginx

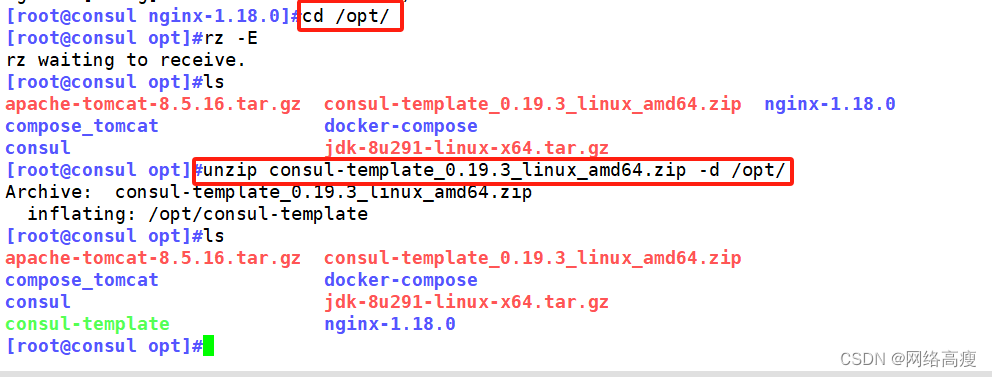

4. 配置并启动 template

cd /opt/

rz consul-template_0.19.3_linux_amd64.zip

unzip consul-template_0.19.3_linux_amd64.zip -d /opt/

mv consul-template /usr/local/bin///在前台启动 template 服务,启动后不要按 ctrl+c 中止 consul-template 进程。

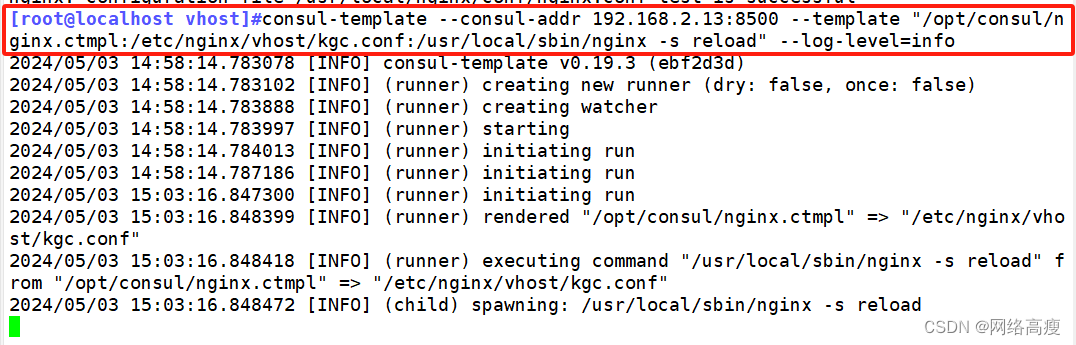

consul-template --consul-addr 192.168.10.23:8500 \

--template "/opt/consul/nginx.ctmpl:/usr/local/nginx/conf/vhost/kgc.conf:/usr/local/nginx/sbin/nginx -s reload" \

--log-level=info//另外打开一个终端查看生成配置文件

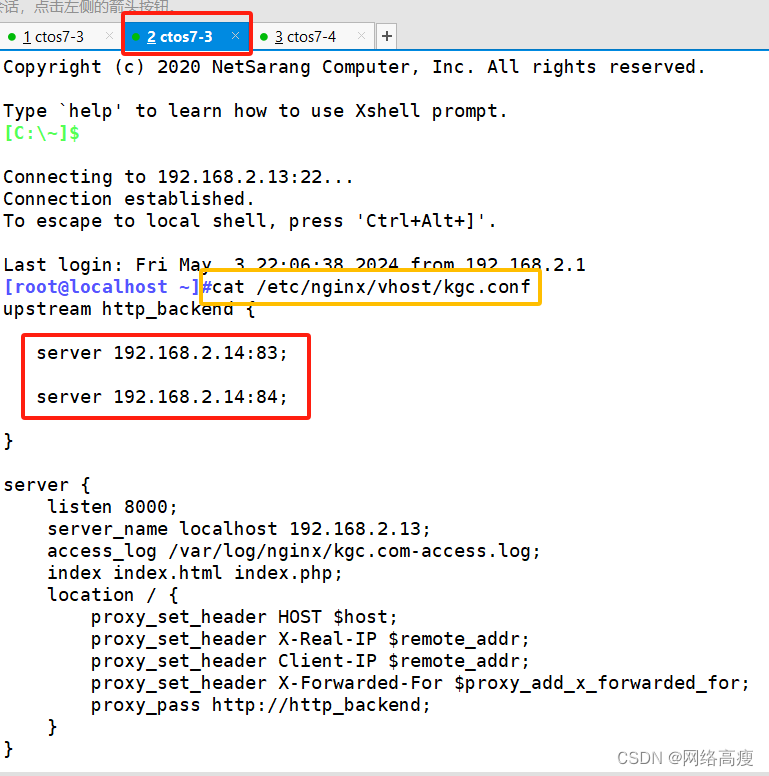

cat /etc/nginx/vhost/kgc.conf

upstream http_backend {

server 192.168.10.13:83;server 192.168.10.13:84;

}

server {

listen 8000;

server_name 192.168.10.23;

access_log /var/log/nginx/kgc.cn-access.log;

index index.html index.php;

location / {

proxy_set_header HOST $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header Client-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_pass http://http_backend;

}

}

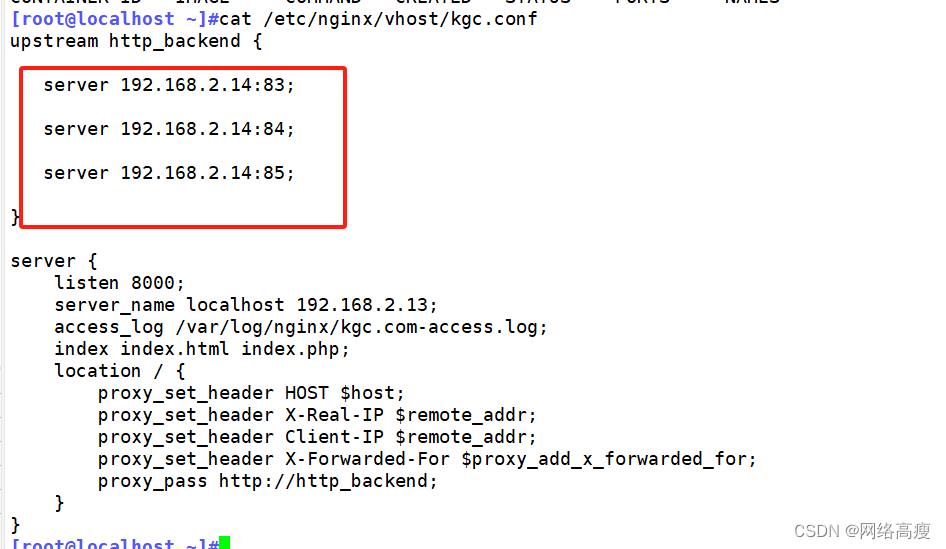

再打开一个终端查看

8.2.4 验证template-nginx负载结果

切换到192.168.2.14

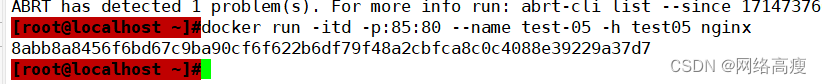

docker run -itd -p:85:80 --name test-05 -h test05 nginx

#服务端:即192.168.2.14

docker ps

#查看启动的容器信息

docker exec -it 6ac6f22d5b9d bash 进入一个容器

echo "this is test1 web" > /usr/share/nginx/html/index.html

exit

docker exec -it 1be8511f8525 bash

echo "this is test2 web" > /usr/share/nginx/html/index.html

exit

#分别进入2个微服务容器即2个nginx和2个http,更换主页内容

浏览器访问:http://192.168.30.11:8000/并不断刷新,会有2种结果是更换后的nginx主页内容

8.3 服务段server组成的高可用集群 接口的使用 (服务端与客户端怎么通信)

启动consul后默认会监听5个端口:

8300:replication、leader farwarding的端口 主从之间同步数据的端口

8301:lan cossip的端口 客户端内部通信端口

8302:wan gossip的端口 服务端外网通信端口

8500:web ui界面的端口 图形化界面端口

8600:使用dns协议查看节点信息的端口

7.5 consul-template 自动更改nginx变量配置文件

4519

4519

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?