机器学习

特征工程

数据的特征提取

字典特征提取–DictVectorizer类

from sklearn.feature_extraction import DictVectorizer

dict = DictVectorizer(sparse=False)

# 调用fit_transform(),返回sparse矩阵,参数是字典或字典迭代器

data = dict.fit_transform([{'city': '北京','temperature':100},{'city': '上海','temperature':60},{'city': '深圳','temperature':30}])

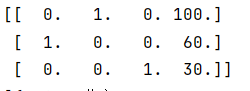

print(data)

print(type(data))

# 调用inverse_transform(),返回转换之前的数据格式

data=dict.inverse_transform(data)

print(data)

print(type(data))

类型是<class ‘numpy.ndarray’>

类型是<class ‘list’>

文本(英文)特征提取

from sklearn.feature_extraction.text import CountVectorizer

cv = CountVectorizer()

# 调用fit_transform

data = cv.fit_transform(["life is short,i like python","life is too long,i dislike python"])

# 返回值:单词列表,统计所有文章中所有的词,重复的只看做一次,单个字母不统计:没有分类依据

print(cv.get_feature_names())

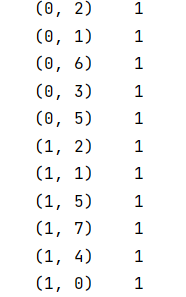

print(data)

print(data.toarray())

cv.get_feature_names()返回单词列表

data返回对应单词列表的使用情况

data.toarray()返回的是每一行再单词表中出现的情况

文本(中文)特征提取

导入jieba包

对中文的分词处理

def cutword():

con1 = jieba.cut("今天很残酷,明天更残酷,后天很美好,但绝对大部分是死在明天晚上,所以每个人不要放弃今天。")

con2 = jieba.cut("我们看到的从很远星系来的光是在几百万年之前发出的,这样当我们看到宇宙时,我们是在看它的过去。")

con3 = jieba.cut("如果只用一种方式了解某样事物,你就不会真正了解它。了解事物真正含义的秘密取决于如何将其与我们所了解的事物相联系")

cn1 = list(con1)

cn2 = list(con2)

cn3 = list(con3)

c1 = ' '.join(cn1)

c2 = ' '.join(cn2)

c3 = ' '.join(cn3)

return c1,c2,c3

CountVectorizer法

统计次出现的频数

def hanzivec():

c1,c2,c3 = cutword()

print(c1,c2,c3)

cv = CountVectorizer()

data = cv.fit_transform([c1,c2,c3])

print(cv.get_feature_names())

print(data.toarray())

TfidfVectorizer法

统计词出现的重要程度

def tfidfvec():

c1, c2, c3 =cutword()

cv = TfidfVectorizer()

data = cv.fit_transform([c1, c2, c3])

print(cv.get_feature_names())

print(data.toarray())

数据的特征预处理

1.归一化处理

def mm():

# 处理值范围是a,b

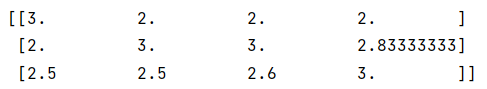

mm = MinMaxScaler(feature_range=(2,3))

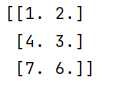

data = mm.fit_transform([[90,2,10,40],[60,4,15,45],[75,3,13,46]])

# 每一列的最大值变成b,最小值变成a,其他的变成比例分配

print(data)

2.标准化处理

def ss():

ss = StandardScaler()

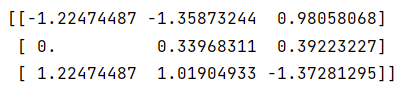

data = ss.fit_transform([[ 1., -1., 3.],[ 2., 4., 2.],[ 3., 6., -1.]])

# σ为标准差,每一列的每一个数变成(x-mean)/σ

print(data)

3.缺失值处理(同pandas)

def im():

im = SimpleImputer(strategy='mean')

data = im.fit_transform([[1, 2], [np.nan, 3], [7, 6]])

#缺省值填该列的mean值

print(data)

数据降维

(1)特征选择

from sklearn.feature_selection import VarianceThreshold

def vt():

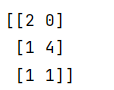

vt = VarianceThreshold(threshold=0.0)

data = vt.fit_transform([[0, 2, 0, 3], [0, 1, 4, 3], [0, 1, 1, 3]])

print(data)

(2)主成分分析

from sklearn.decomposition import PCA

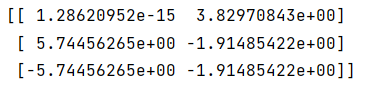

def pa():

pa = PCA(n_components=0.95)

data = pa.fit_transform([[2,8,4,5],[6,3,0,8],[5,4,9,1]])

print(data)

7490

7490

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?