对应的B站讲解视频在这里:B站讲解视频

上一篇博客介绍了在本地部署GPU的方法,但是真正实践时存在很多问题,运行代码时依旧不能使用。

这里介绍一个使用conda在虚拟环境部署cuda的方法,高校便捷的让你使用gpu加速训练代码。话不多说,开始上步骤。

不管是miniconda还是anaconda都可以。

首先在命令行输入

conda create -n gpu python=3.7 cudatoolkit=11.3 cudnn

这是创建虚拟环境的第一条命令。其中需要注意的是python的环境。由于我的电脑30系显卡,所以安装的cuda的版本要大于11,好像有个代码可以查看环境里能安装的cuda版本,忘记了。我的电脑没有11.2的,所以安装11.3的。另外记住是cudatoolkit。另外cudnn的版本不需要指定,系统会自动适配。

其实问题大多出现在版本上,大家结合自己电脑尽量选择合适版本(python、cudatoolkit)。

接着我们分别安装TensorFlow和pytorch

TensorFlow的版本我们看这个网址进行匹配:添加链接描述

像cuda11.3版本直接匹配tf的最高版本,安装时不指定版本号就行。

pip install tensorFlow -i https://mirrors.aliyun.com/pypi/simple/

#依次输入以下命令,每次命令输入完按回车

python

import tensorflow as tf

tf.test.gpu.is_available()

如果输出True就成功了!,如果输出False就是使用gpu失败。

pytorch的版本及安装命令看这个网址:https://pytorch.org/

进入网址后通过选择不同的配置,最后一行会显示给你的安装命令

我配置完是这个命令,直接在命令行输入就行了。

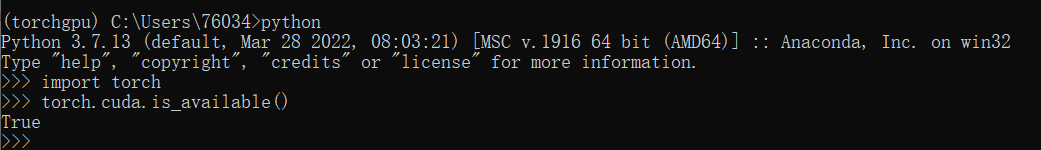

测试:

这就是torch测试的完整命令。此时我们通过新建一个cmd窗口看看gpu的使用情况。输入nvidia-smi

可以看到最下面是python在使用。

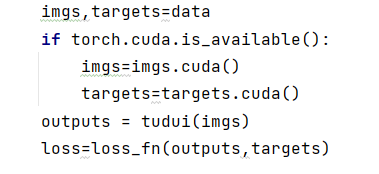

另外补充一下,如何在代码里使用cuda。

使用cuda只需要三个地方。模型,损失函数和数据。下面是示例图片。

结束!

3630

3630

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?