TensorFlow用张量这种数据结构来表示所有的数据。你可以把一个张量想象成一个n维的数组或列表。一个张量有一个静态类型和动态类型的维数。张量可以在图中的节点之间流通。

在TensorFlow系统中,张量的维数来被描述为阶。但是张量的阶和矩阵的阶并不是同一个概念。张量的阶(有时是关于顺序或度数或者是n维)是张量维数的一个数量描述。比如,下面的张量就是2阶。

#!/usr/bin/env python

# coding=utf-8

import tensorflow as tf

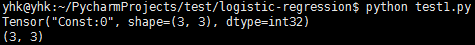

t=tf.constant([[1,2,3],[4,5,6],[7,8,9]])

print t

print t.get_shape()

你可以认为一个二阶张量就是我们平常所说的矩阵,一阶张量可以认为是一个向量。对于一个二阶张量你可以用语句t[i,j] 来访问其中的任何元素。而对于三阶张量你可以用t[i,j,k]来访问其中的任何元素。

注意:矩阵的阶表示矩阵大小,比如n阶矩阵就是n*n的矩阵;而张量的阶其实是维数的意思。

tf.Tensor.get_shape()

返回一个tensor的shape。不需要启动Session,就可以返回tensor的shape信息。这可以帮助我们调试,提早发现错误信息。

#!/usr/bin/env python# coding=utf-8

import tensorflow as tf

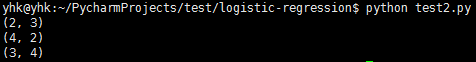

c=tf.constant([[1.0,2.0,3.0],[4.0,5.0,6.0]])

print c.get_shape()

d=tf.constant([[1.0,0.0], [0.0,1.0], [1.0,0.0], [0.0,1.0]])

print d.get_shape()

e=tf.matmul(c,d,transpose_a=True, transpose_b=True)

print e.get_shape()

tf.reduce_sum(input_tensor, reduction_indices=None, keep_dims=False, name=None)

根据tensor的维度计算元素的和。

#!/usr/bin/env python

# coding=utf-8

import tensorflow as tf

x=tf.constant([[1,1,1],[1,1,1]])

sum_all=tf.reduce_sum(x)

sum_0=tf.reduce_sum(x,0)

sum_1=tf.reduce_sum(x,1)

sum_dims=tf.reduce_sum(x,1,keep_dims=True)

sum_0_1=tf.reduce_sum(x,[0,1])

sess=tf.Session()

print sess.run([sum_all,sum_0,sum_1,sum_dims,sum_0_1])

sess.close()

tf.reduce_mean(input_tensor, reduction_indices=None, keep_dims=False, name=None)

根据tensor的维度计算元素的均值

#!/usr/bin/env python

# coding=utf-8

import tensorflow as tf

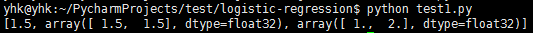

x=tf.constant([[1.,1.],[2.,2.]])

mean_all=tf.reduce_mean(x)

mean_0=tf.reduce_mean(x,0)

mean_1=tf.reduce_mean(x,1)

sess=tf.Session()

print sess.run([mean_all,mean_0,mean_1])

sess.close()

1540

1540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?