MLE(maximum likelihood estimation最大似然估计):

之前用于训练HMM参数(A和B矩阵)所用的Baum-Welch算法和嵌入式训练时基于最大化训练数据的似然度的。MLE的替代方案是不再将最佳模型和数据相匹配,而是从其他模型中区分出最佳模型。鉴别性训练包括MMIE(最大互信息估计准则,Woodland and Povey, 2002)使用NN/SVM分类器,MCE(最小分类错误准则,Chou et al., 1993;McDermott and Hazen, 2004),MBR(最小贝叶斯风险估计准则,Doumpiotis et al., 2003a)。

- Maximum Mutual Information Estimation(最大互信息估计)

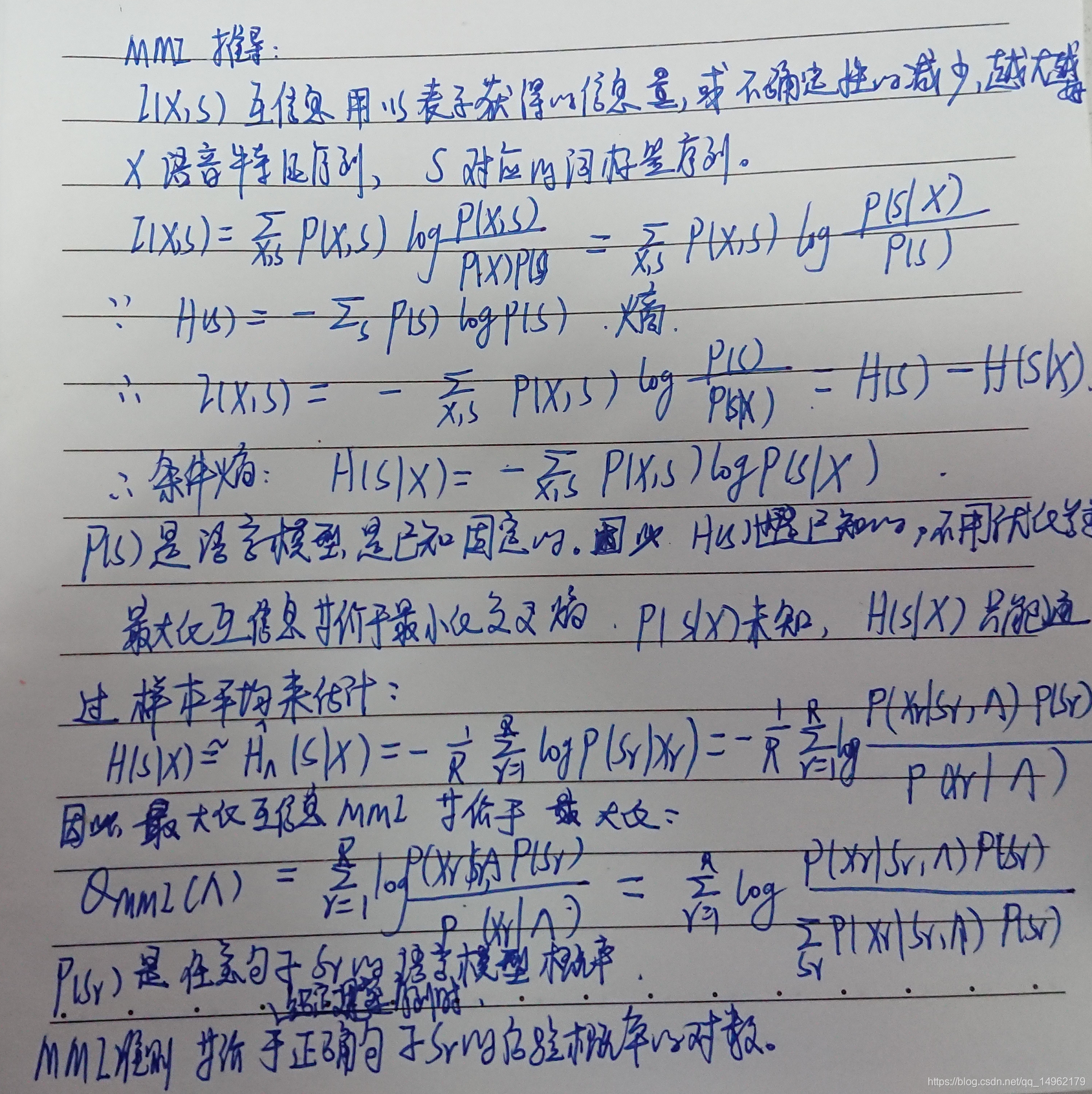

MMIE准则原理:

在O给定的情况下,描述对W的平均不确定性的度量是条件熵H(W|O),写作:

H ( W ∣ O ) = − ∑ W , O p ( W , O ) l o g p ( W ∣ O ) = − E [ l o g p ( W ∣ O ) ] H(W|O)=-\sum\limits_{W,O} {p(W,O)logp(W|O)} =-E[logp(W|O)] H(W∣O)=−W,O∑p(W,O)logp(W∣O)=−E[logp(W∣O)]

目标是降低这个不确定度。在实际语音识别声学建模过程中,通常使用一个参数化的模型/\来近似求的真实后验概率P(W|O).

H ∧ ( W ∣ O ) = − E [ log p ∧ ( W ∣ O ) ] {H_ \wedge }(W|O) = - E[\log {p_ \wedge }(W|O)] H∧(W∣O)=−E[logp∧(W∣O)]

最小化 H ∧ ( W ∣ O ) H_ \wedge (W|O) H∧(W∣O)的过程就是最大化互信息 I ∧ ( W ; O ) I_ \wedge (W;O) I∧(W;O)的过程,这种情况下的MMI准则实质上等价于条件最大似然准则(Conditional Maiximum Likelihood)

1609

1609

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?