1、时间复杂度解释一下

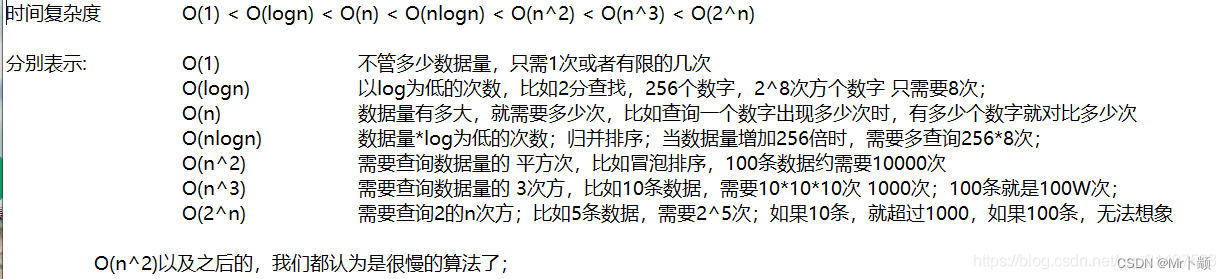

算法的时间复杂度,用来度量算法的运行时间,记作: T(n) = O(f(n))。它表示随着 输入大小n 的增大,算法执行需要的时间的增长速度可以用 f(n) 来描述。

当 T(n) = c,c 为一个常数的时候,我们说这个算法的时间复杂度为 O(1);如果 T(n)

不等于一个常数项时,直接将常数项省略。

因为高次项对于函数的增长速度的影响是最大的,所以我们直接忽略低次项。

因为函数的阶数对函数的增长速度的影响是最显著的,所以我们忽略与最高阶相乘的常数。

比如 T(n) = 29 ,此时时间复杂度为 O(1)。

比如 T(n) = n + 29,此时时间复杂度为 O(n)。

比如T(n) = n^3 + n^2 + 29,此时时间复杂度为 O(n^3)。

比如T(n) = 3n^3,此时时间复杂度为 O(n^3)。

for (int i = 2; i < n; i++) {

i *= 2;

printf("%i\n", i);

}

假设循环次数为t,必有2^t < n

t = log(2)(n),即 T(n) = log(2)(n),可见时间复杂度为 O(log(2)(n)),即 O(log n)。

加入 T(n) = T(n - 1) + T(n - 2) 是一个斐波那契数列,通过归纳证明法可以证明,当 n >= 1 时 T(n) < (5/3)^n,同时当 n > 4 时 T(n) >= (3/2)^n。

所以该方法的时间复杂度可以表示为 O((5/3)^n),简化后为 O(2^n)。

239

239

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?