一、现象描述

背景: 某客户使用SSE 来实时流式返回数据,很ChatGPT 流式返回数据一样,简单来讲就是客户端请求一次,服务端每1秒回复一次。

但是服务器上log又是秒级回复,猜测是被中间节点缓存了响应,等响应完全才回复给客户端

找不出问题甩锅网络—当前开发现状

二、故障分析

按照常规套路,理清链路:

PC-F5-WAF-APISIX-POD

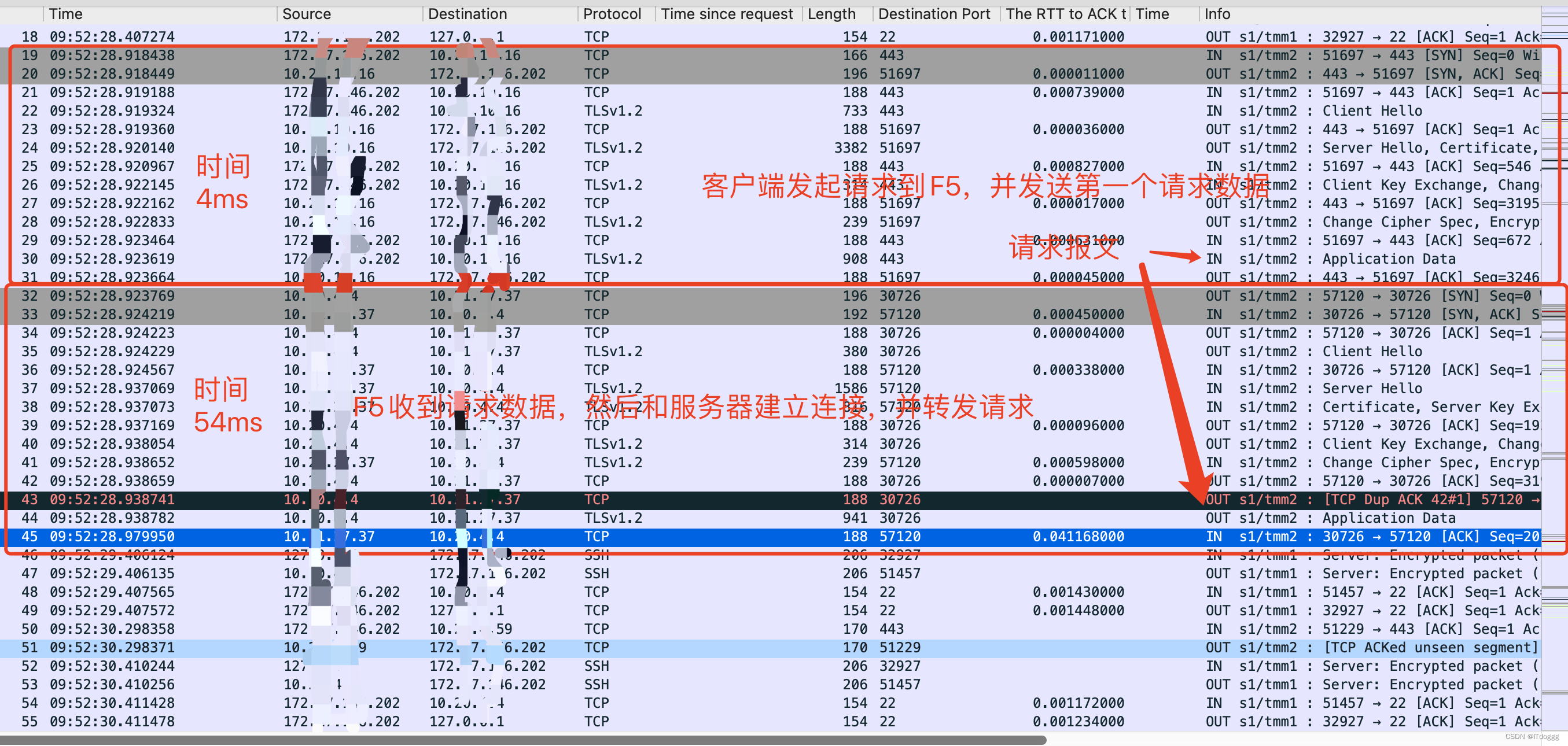

首先F5没有缓存机制,可以排除F5,但是F5有特殊抓包命令,可以抓前后全部数据,

从数据包可以看到,F5请求转发非常快,

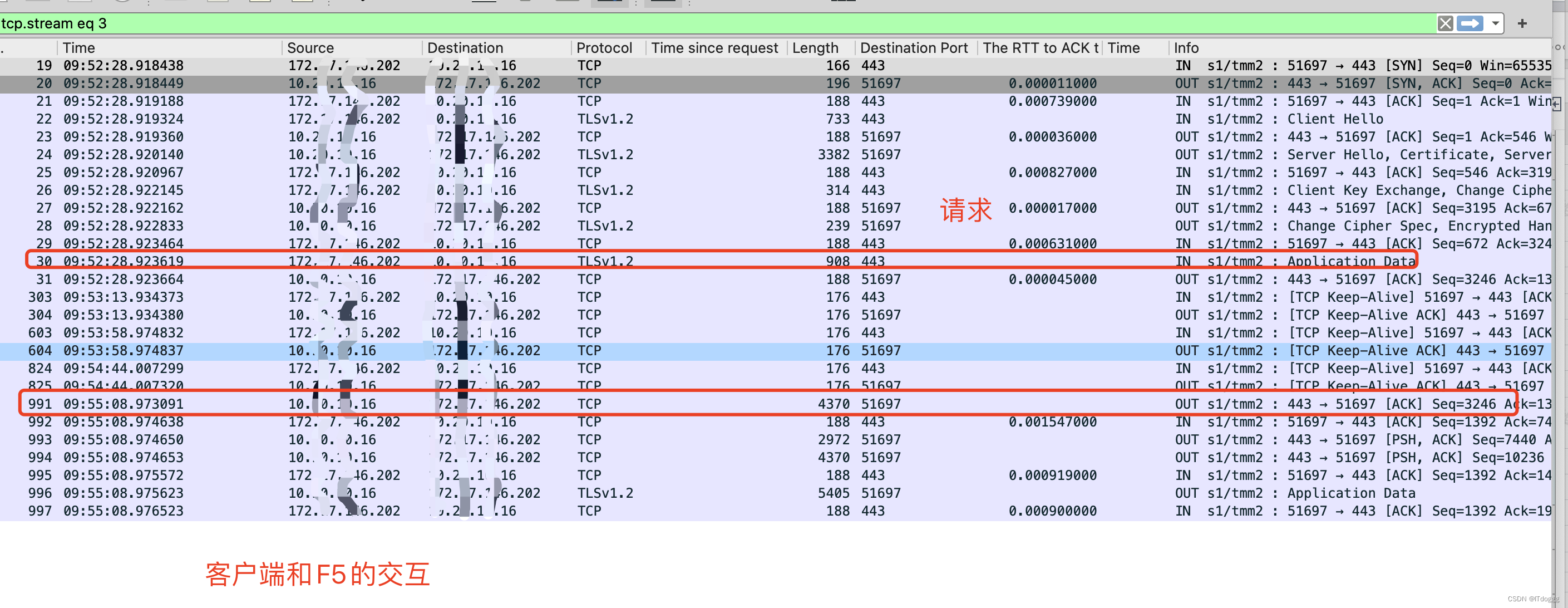

从上图看,数据包30是请求包。响应包是991。中间隔了2分40秒。

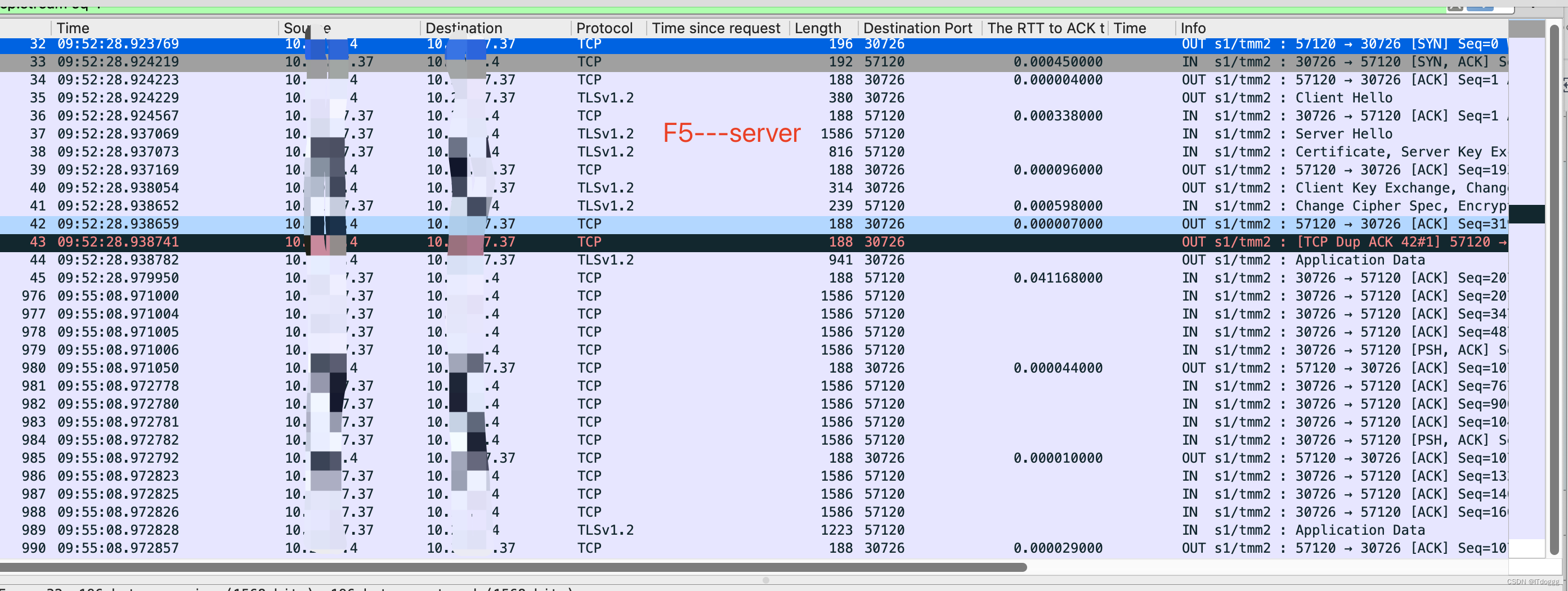

再对应一下F5和waf之间的交互

如上图,时间对的上,那么问题基本就在waf和apsix上了;

经过排查应用配置resonse header主动关闭apisix缓存机制

‘Content-Type’: ‘text/event-stream’,

‘Connection’: ‘keep-alive’,

‘Cache-Control’: ‘no-cache’,

‘X-Accel-Buffering’: ‘no’

};

参考:https://www.nginx.com/resources/wiki/start/topics/examples/x-accel/#x-accel-buffering

关闭后,发现还是不行,再看看waf,waf需要挂逼http响应处理。

整体解决:

1,apisix需要主动回复 ‘X-Accel-Buffering’: 'no’给waf;

2,waf需要关闭http 响应处理,两者结合起来才能生效;

备注:

1,waf代理模式部署,底层也是ng

2,从f5-client和f5-server 数据包发现,当服务器响应时间比较长是,客户端浏览器会发送tcp keep-alive数据给F5,因为F5是全代理模式,所以F5不会把这种状态包传给服务器,所以不要被这种状态包F5没转发,所误导。

18万+

18万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?