文章目录

专家混合模型是属于LLM模型架构层面的概念。混合推理模型属于模型应用层面,在快速响应和复杂推理之间切换。一个智能体=多个工作流的组合,智能体可以拆解为多个子任务,而每个子任务可能是一个工作流。

1 专家混合模型(MoE)

专家混合模型(Mixture of Experts, MoE)是一种特殊的神经网络架构,它通过将输入数据分配给多个“专家”子网络来处理复杂问题。每个专家负责学习输入数据的一个特定方面或模式,而一个门控网络决定如何将输入分配给这些专家,并最终结合他们的输出。

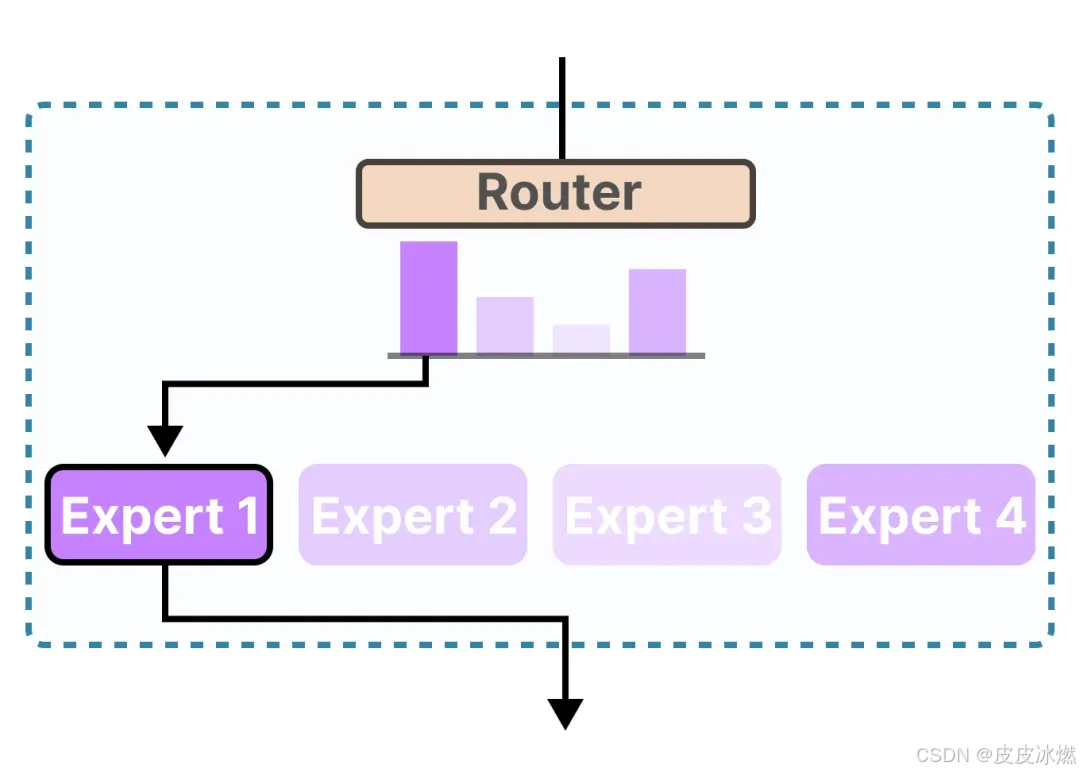

专家混合模型(Mixture of Experts, MoE)的两个主要组成部分——专家(Experts)和路由器(Router)。

专家混合模型(MoE)是一种通过使用多个不同的子模型(或“专家”)来提升LLM质量的技术。

MoE的两个主要组成部分为:

(1)专家(Experts):每个前馈神经网络层(FFNN)现在都有一组可以选择的“专家”。这些“专家”通常本身也是前馈神经网络(FFNN)。

(2)路由器或门控网络(Router或Gate Network):决定哪些token被发送到哪些专家。

最后还有一个组合策略

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?