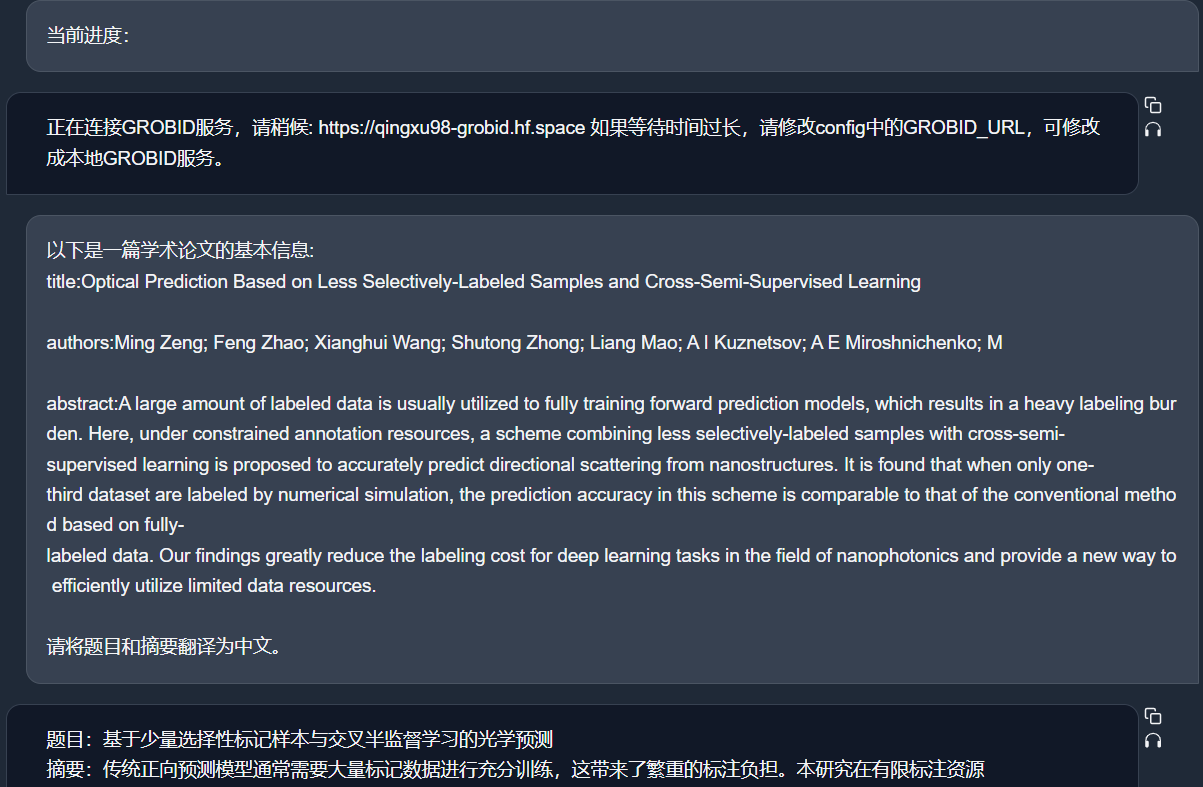

GPT 学术优化 (GPT Academic)试用

官方介绍:

为GPT/GLM等LLM大语言模型提供实用化交互接口,特别优化论文阅读/润色/写作体验,模块化设计,支持自定义快捷按钮&函数插件,支持Python和C++等项目剖析&自译解功能,PDF/LaTex论文翻译&总结功能,支持并行问询多种LLM模型,支持chatglm3等本地模型。接入通义千问, deepseekcoder, 讯飞星火, 文心一言, llama2, rwkv, claude2, moss等。

功能如下:

| 功能(⭐= 近期新增功能) | 描述 |

|---|---|

| ⭐接入新模型 | 百度千帆与文心一言, 通义千问Qwen,上海AI-Lab书生,讯飞星火,LLaMa2,智谱GLM4,DALLE3, DeepseekCoder |

| ⭐支持mermaid图像渲染 | 支持让GPT生成流程图、状态转移图、甘特图、饼状图、GitGraph等等(3.7版本) |

| ⭐Arxiv论文精细翻译 (Docker) | [插件] 一键以超高质量翻译arxiv论文,目前最好的论文翻译工具 |

| ⭐实时语音对话输入 | [插件] 异步监听音频,自动断句,自动寻找回答时机 |

| ⭐AutoGen多智能体插件 | [插件] 借助微软AutoGen,探索多Agent的智能涌现可能! |

| ⭐虚空终端插件 | [插件] 能够使用自然语言直接调度本项目其他插件 |

| 润色、翻译、代码解释 | 一键润色、翻译、查找论文语法错误、解释代码 |

| 自定义快捷键 | 支持自定义快捷键 |

| 模块化设计 | 支持自定义强大的插件,插件支持热更新 |

| 程序剖析 | [插件] 一键剖析Python/C/C++/Java/Lua/...项目树 或 自我剖析 |

| 读论文、翻译论文 | [插件] 一键解读latex/pdf论文全文并生成摘要 |

| Latex全文翻译、润色 | [插件] 一键翻译或润色latex论文 |

| 批量注释生成 | [插件] 一键批量生成函数注释 |

| Markdown中英互译 | [插件] 看到上面5种语言的README了吗?就是出自他的手笔 |

| PDF论文全文翻译功能 | [插件] PDF论文提取题目&摘要+翻译全文(多线程) |

| Arxiv小助手 | [插件] 输入arxiv文章url即可一键翻译摘要+下载PDF |

| Latex论文一键校对 | [插件] 仿Grammarly对Latex文章进行语法、拼写纠错+输出对照PDF |

| 谷歌学术统合小助手 | [插件] 给定任意谷歌学术搜索页面URL,让gpt帮你写relatedworks |

| 互联网信息聚合+GPT | [插件] 一键让GPT从互联网获取信息回答问题,让信息永不过时 |

| 公式/图片/表格显示 | 可以同时显示公式的tex形式和渲染形式,支持公式、代码高亮 |

| 启动暗色主题 | 在浏览器url后面添加/?__theme=dark可以切换dark主题 |

| 多LLM模型支持 | 同时被GPT3.5、GPT4、清华ChatGLM2、复旦MOSS伺候的感觉一定会很不错吧? |

| 更多LLM模型接入,支持huggingface部署 | 加入Newbing接口(新必应),引入清华Jittorllms支持LLaMA和盘古α |

| ⭐void-terminal pip包 | 脱离GUI,在Python中直接调用本项目的所有函数插件(开发中) |

| 更多新功能展示 (图像生成等) …… | 见本文档结尾处 …… |

1.基础安装

仓库地址:https://github.com/binary-husky/gpt_academic

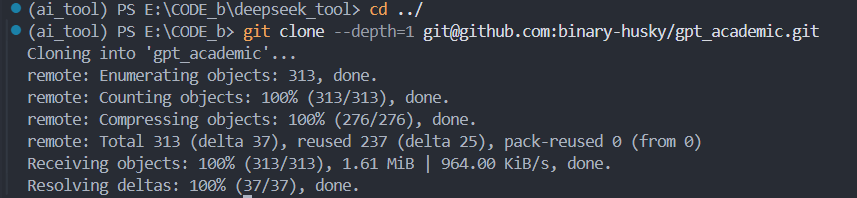

克隆仓库:

git clone --depth=1 https://github.com/binary-husky/gpt_academic.git

或者用ssh:

git clone --depth=1 git@github.com:binary-husky/gpt_academic.git

或者用网盘:百度网盘 请输入提取码

打开仓库。

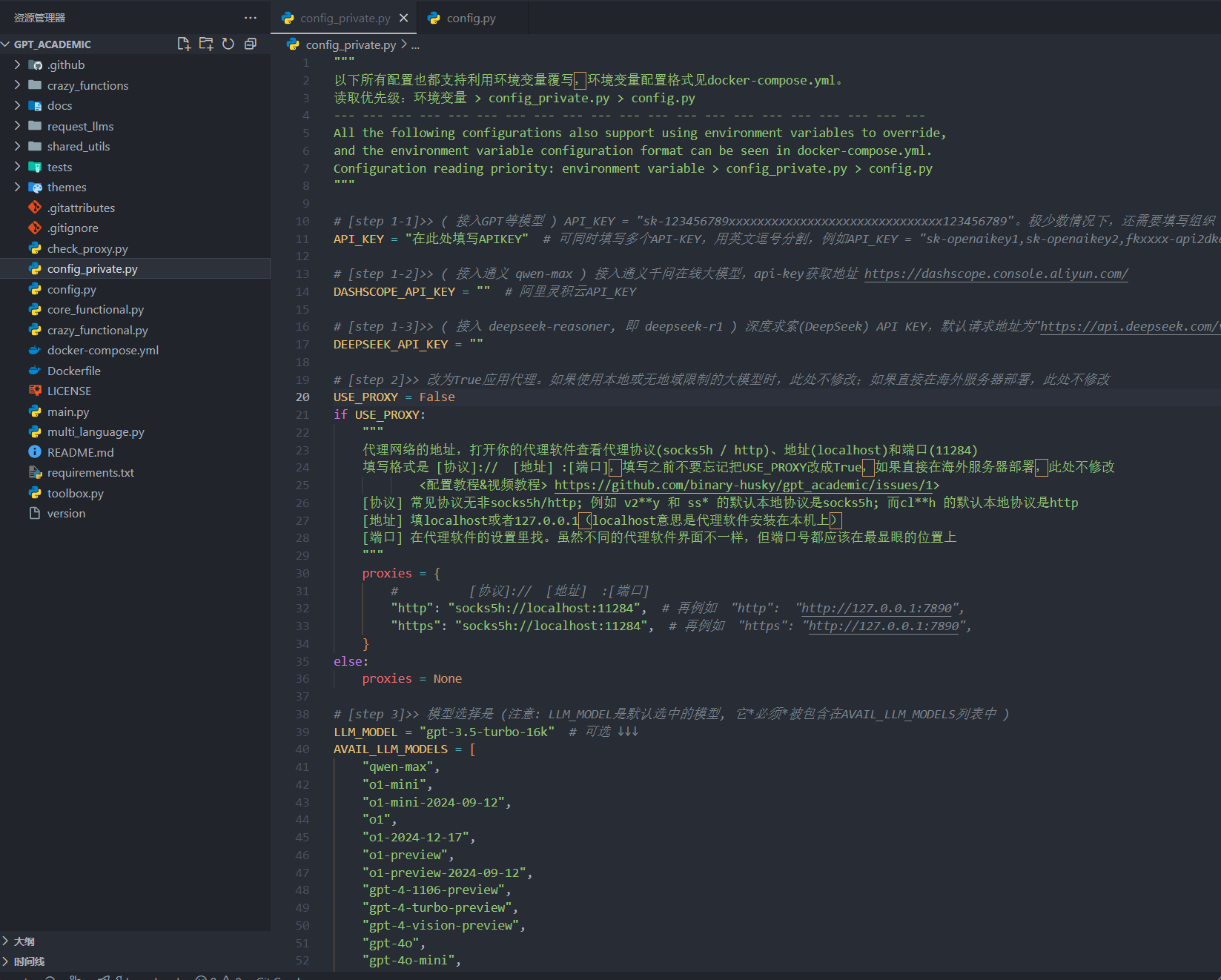

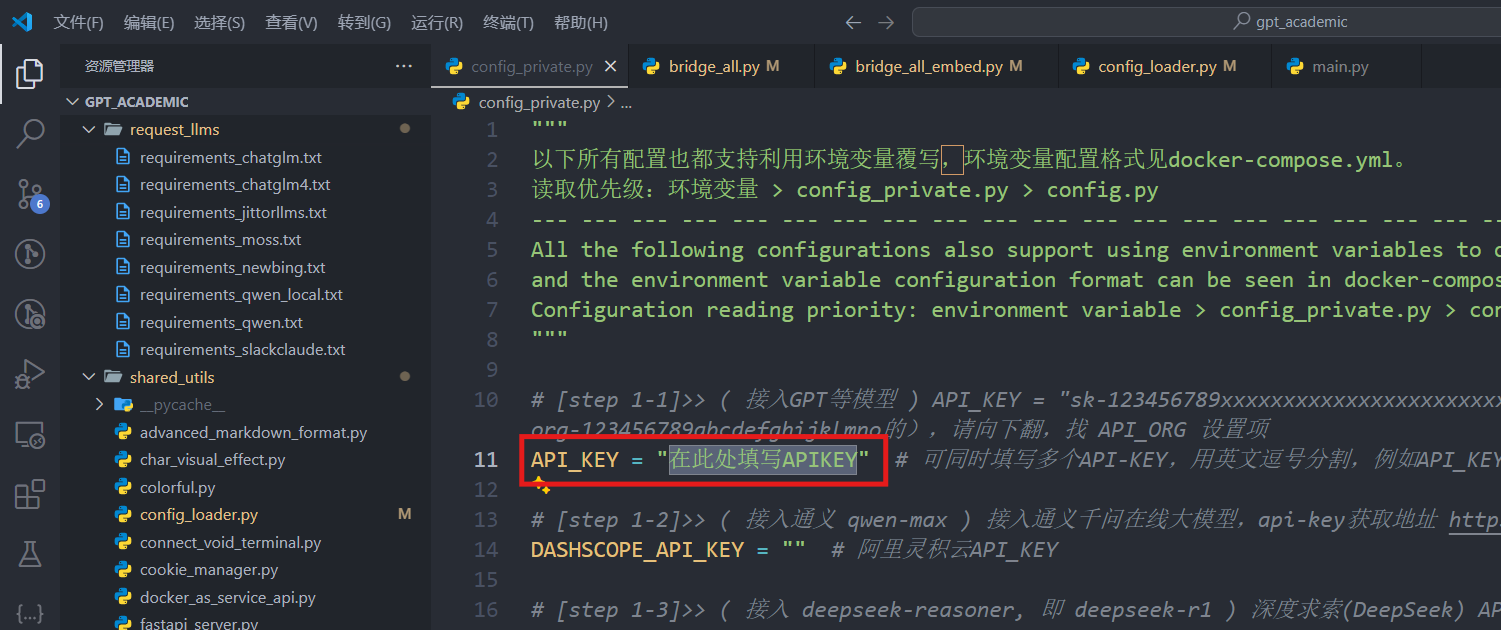

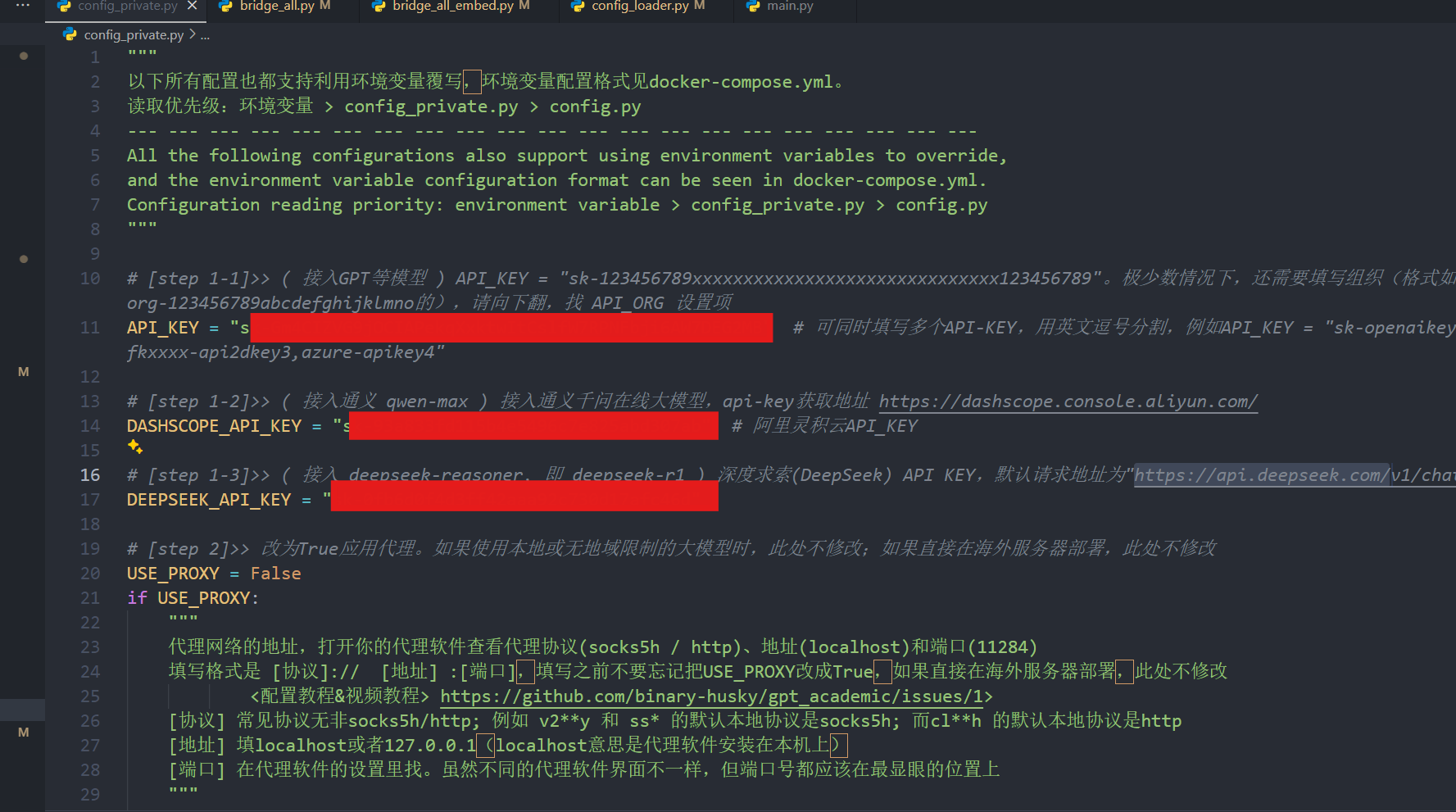

新建文件config_private.py,并把config.py的内容全部粘贴过去

创建虚拟环境并安装:

conda create -n gpt_academic python=3.10 -y

conda activate gpt_academic

python -m pip install -r requirements.txt

运行:

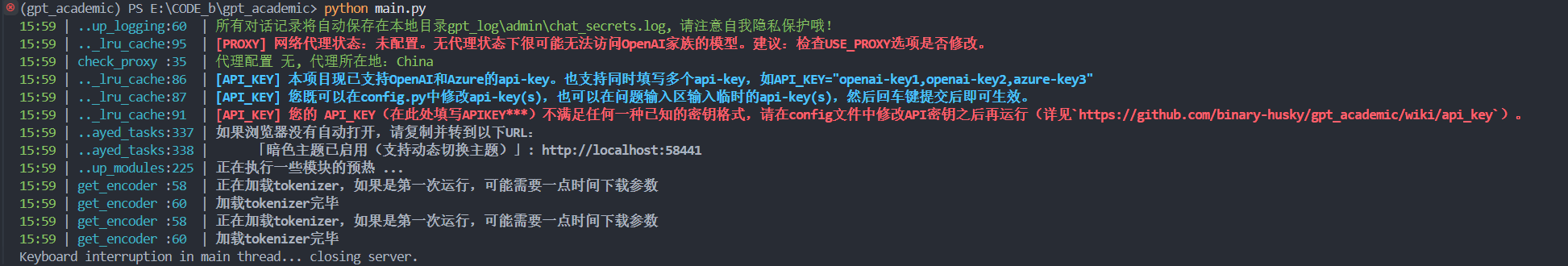

python main.py

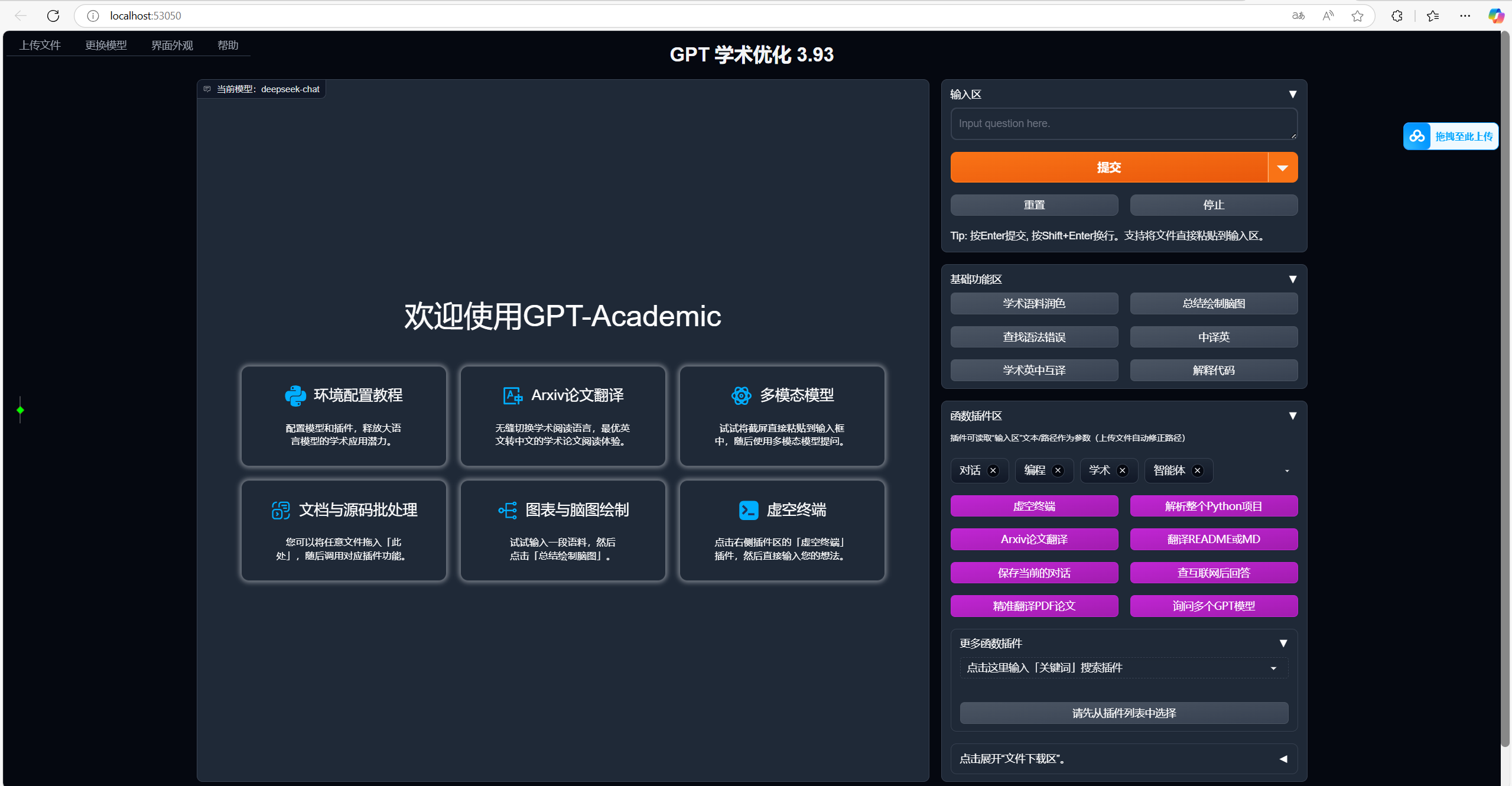

当看到网页打开,便成功了。当然此时还不能用,因为还没有配置api。

关闭:

进入终端,按ctrl+c结束运行。

2.便捷调用各种模型对话

2.1便捷调用各种模型对话

由于国内不能用openai官方api,咱们用中转站的,比如简易api,首页 - AI大模型API中转站接口平,ChatGPT API,DeepSeek API,Claude API接口中转站,OpenAI API Key获取

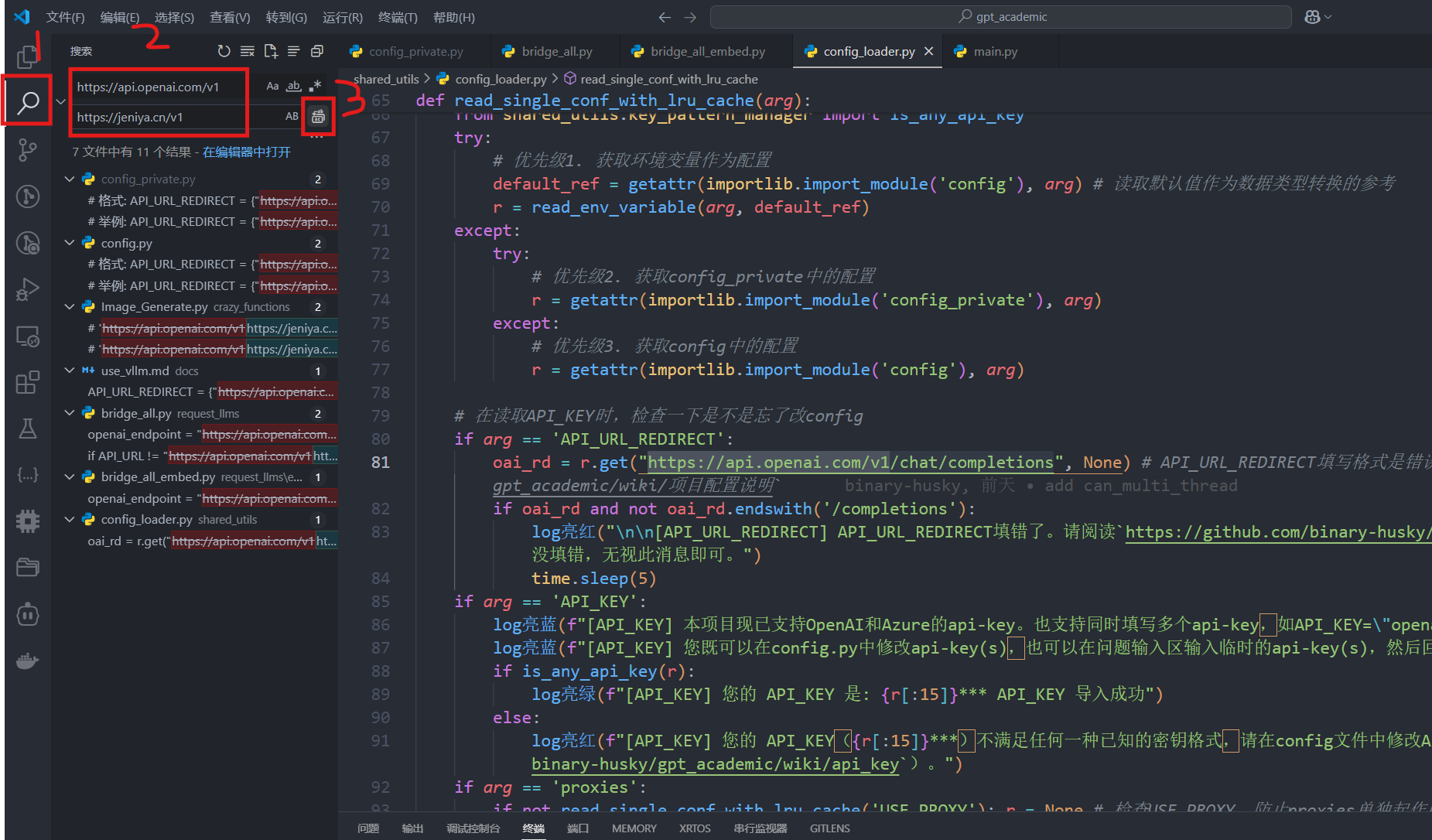

把该工程的https://api.openai.com/v1全部替换为https://jeniya.cn/v1

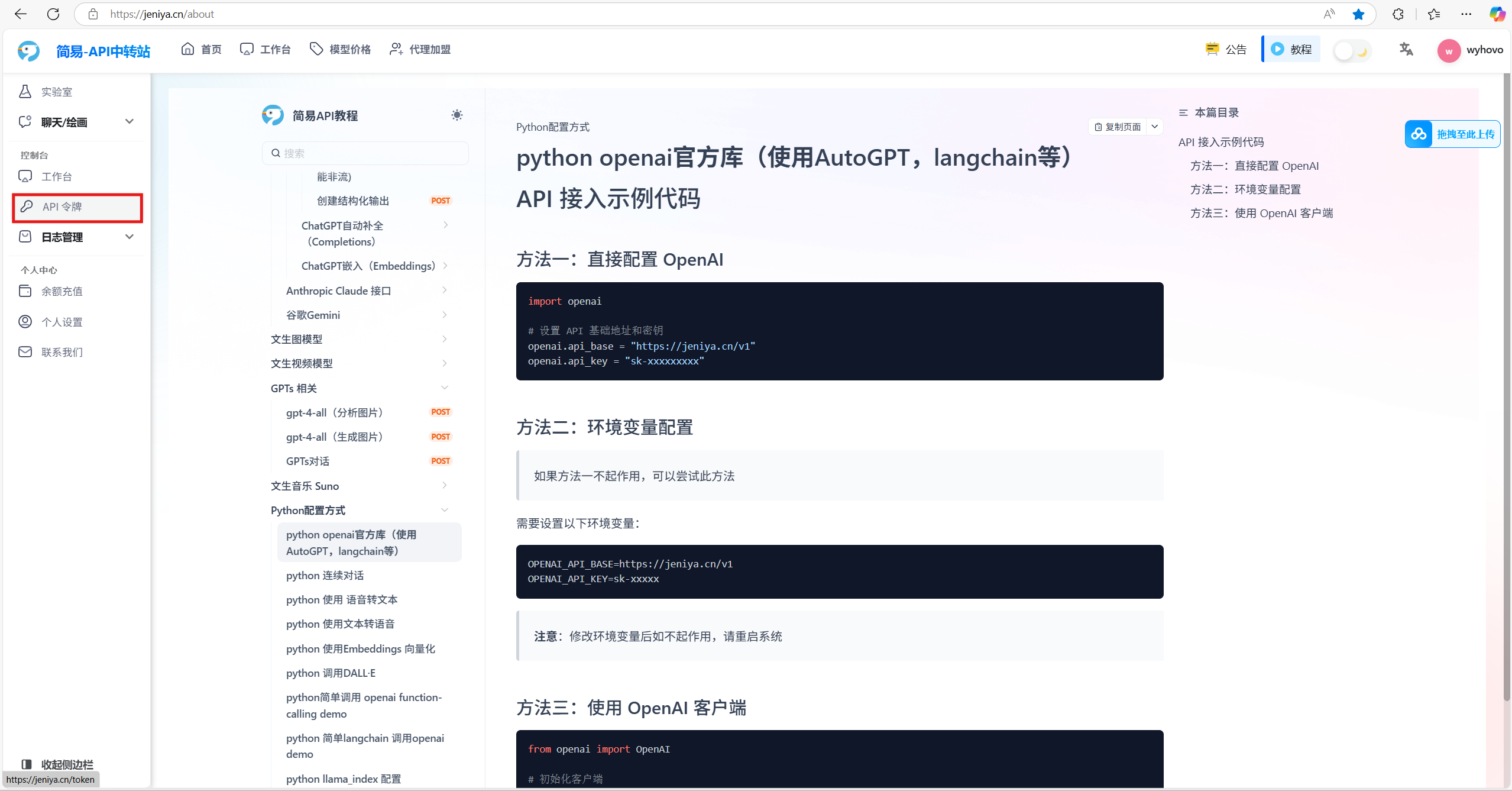

进入网站首页 - AI大模型API中转站接口平,ChatGPT API,DeepSeek API,Claude API接口中转站,OpenAI API Key获取,登录注册,点击API令牌,再点击添加令牌,并复制

粘贴到API_KEY里面

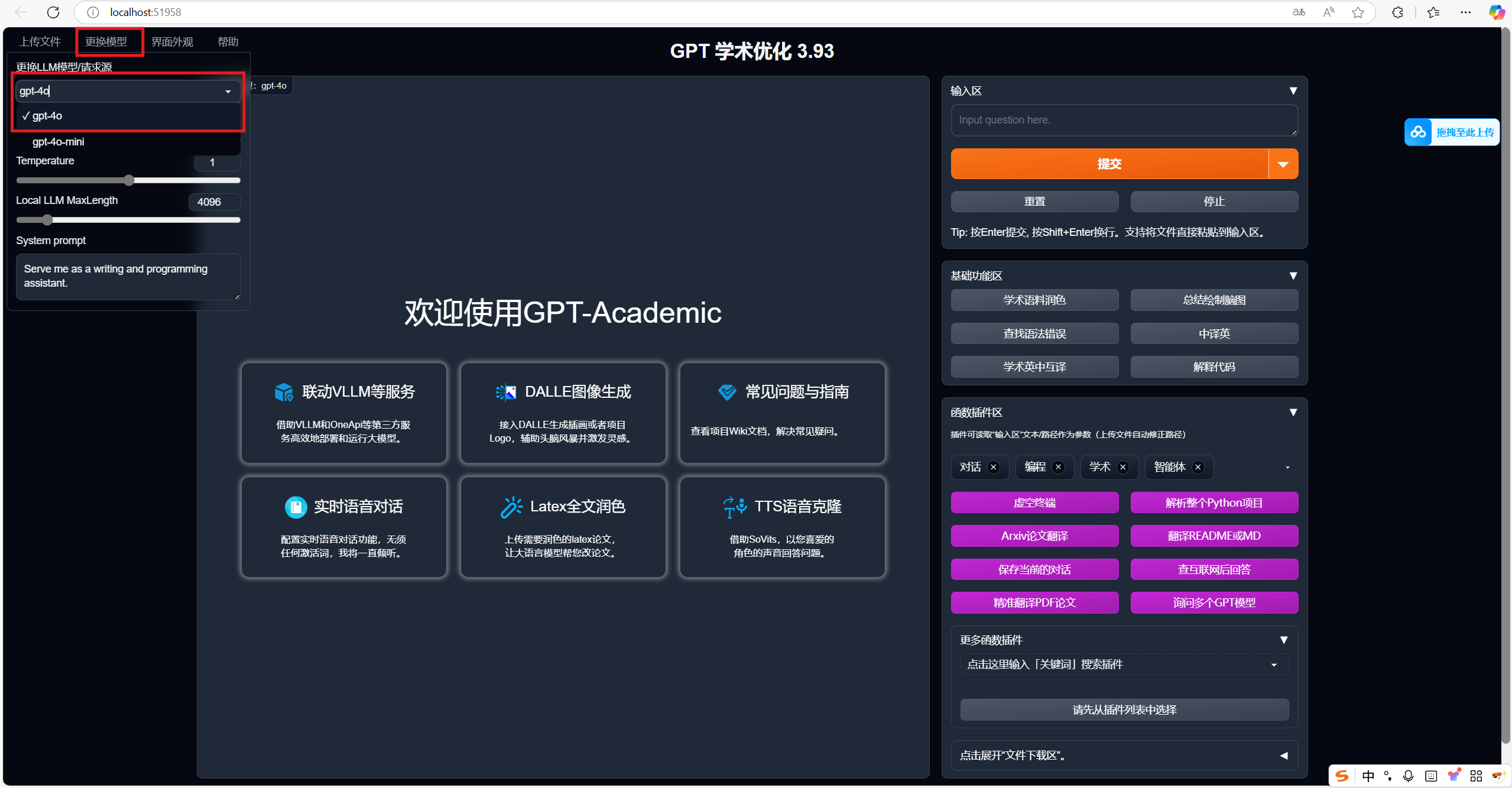

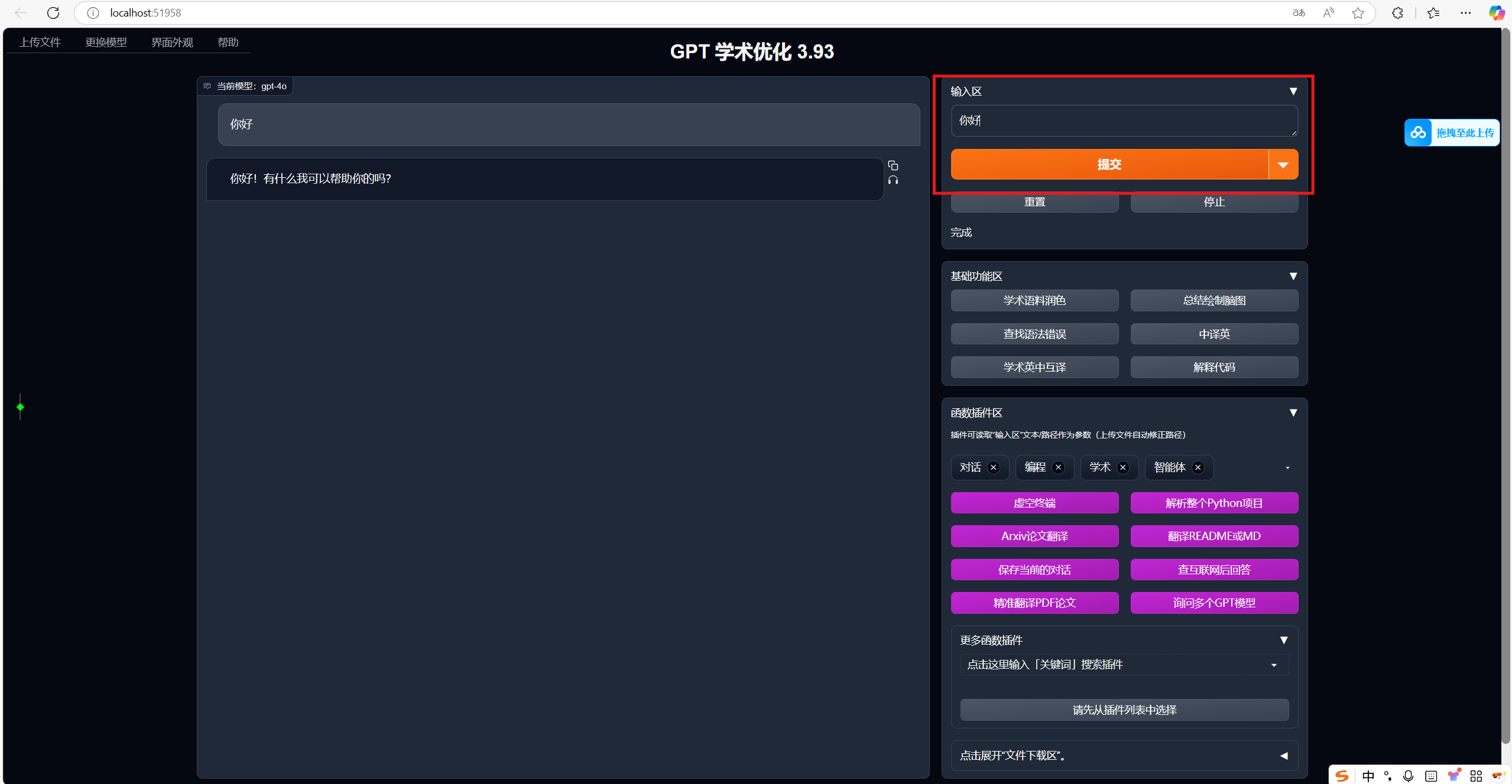

再次运行程序,在左上角把模型切换为gpt-4o

发送你好,有回复,成功!

下面同理去阿里云登录 - 欢迎登录阿里云,安全稳定的云计算服务平台、https://api.deepseek.com/获取api并填入配置中

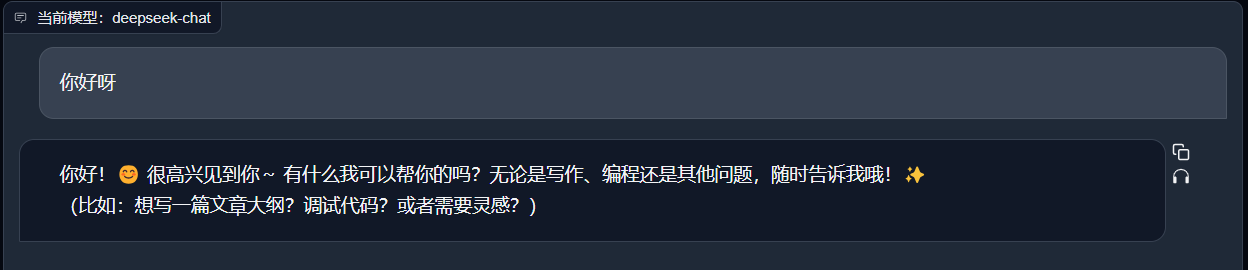

重新运行程序,尝试deepseek的v3(即deepseek-chat)模型,调用成功!

2.2联网搜索

点击提交右边的下拉箭头,改为查互联网后回答即可

尝试问一下最近的新闻:

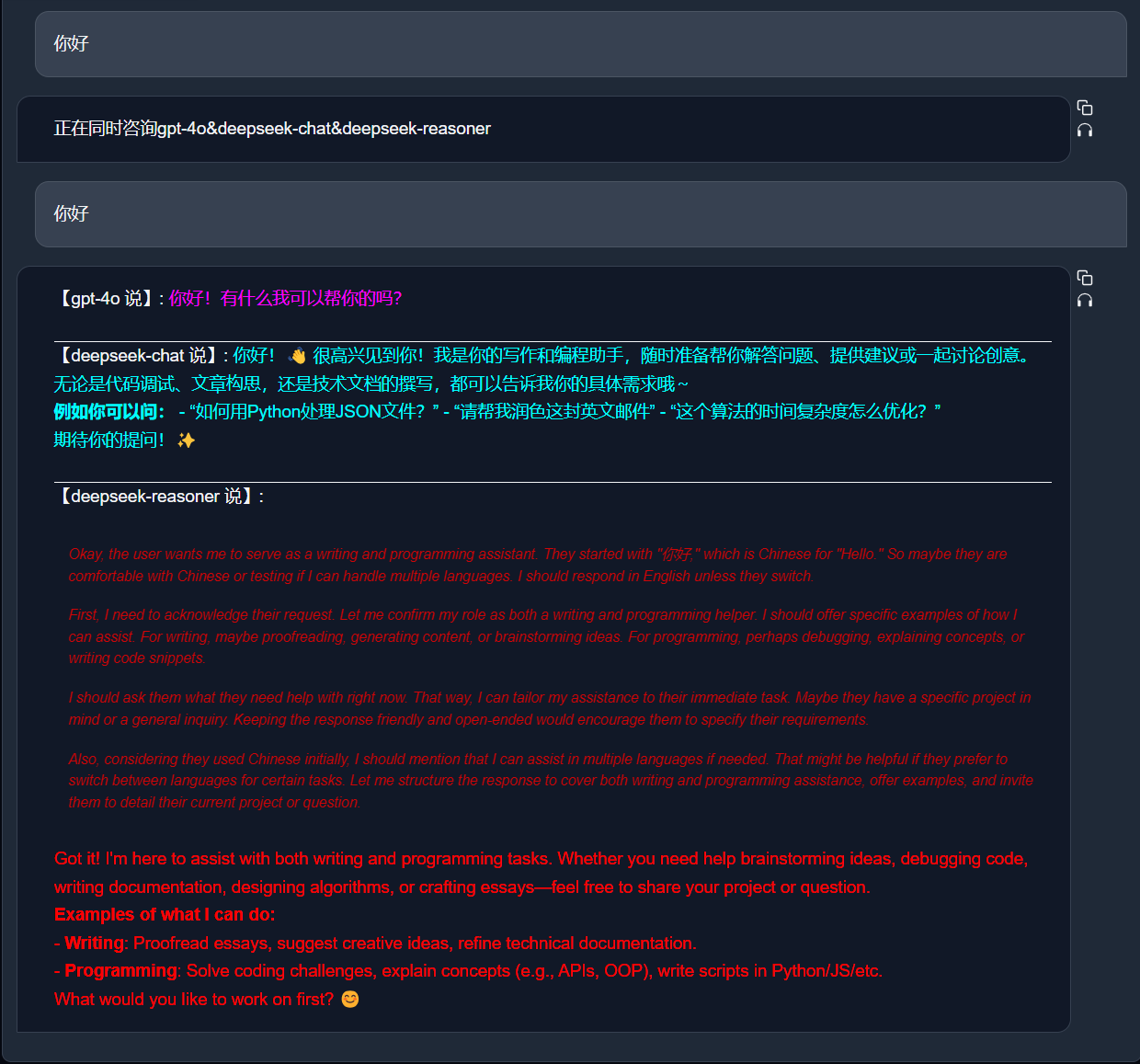

2.3多模型对话

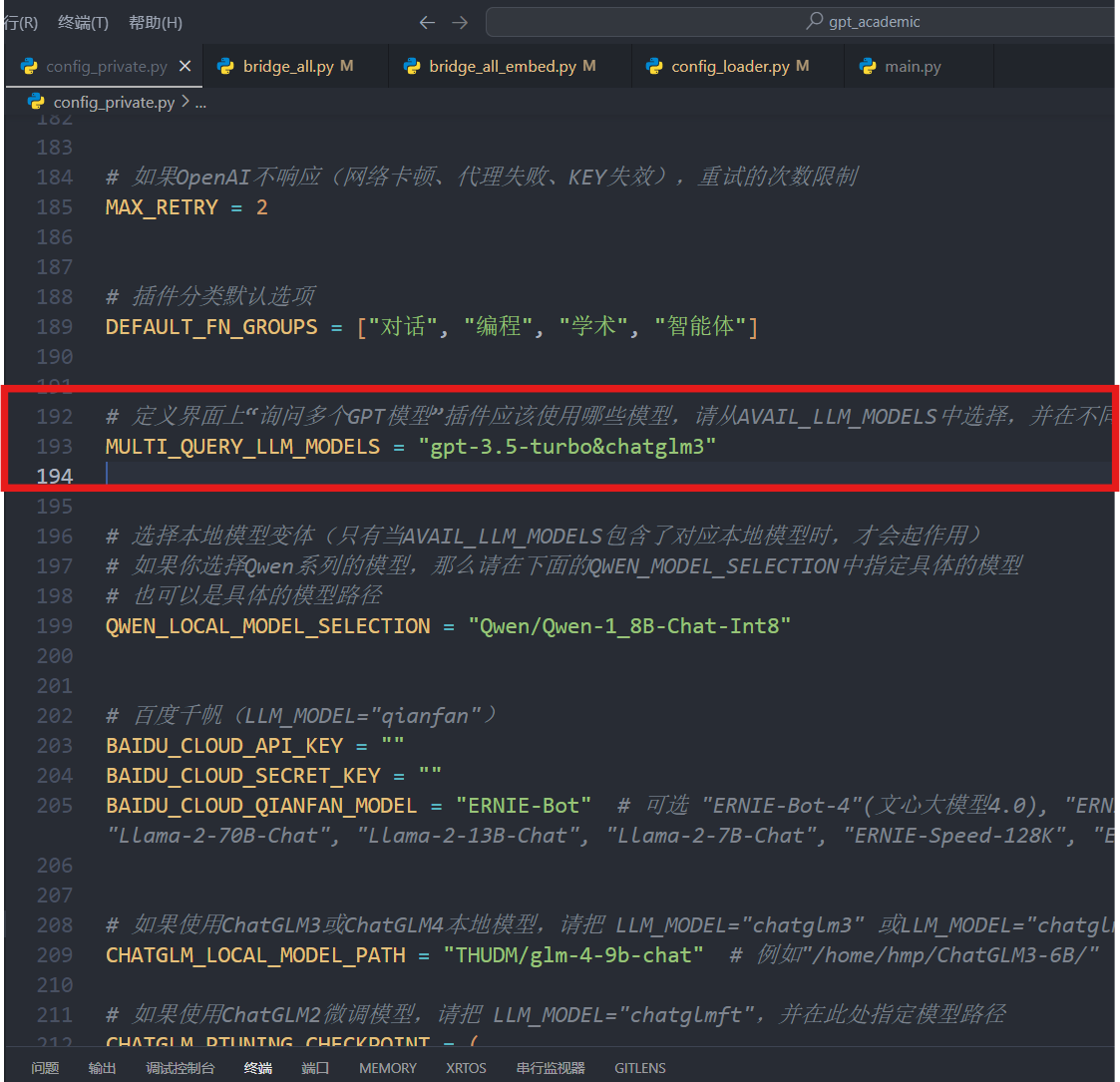

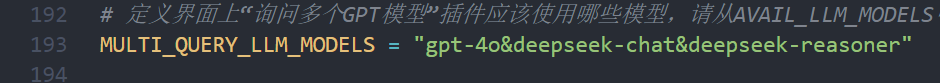

首先在配置文件中调整多模型对话的模型选择

比如我改为:gpt-4o&deepseek-chat&deepseek-reasoner

重启,提交改为多模型对话

成功!

2.4智能召回RAG

将问答数据记录到向量库中,作为长期参考。可以不断积累知识,提升系统的性能。

说白了就是你使用这个模式,发的每一个对话都会被“记忆”下来,达到长期记忆的功能

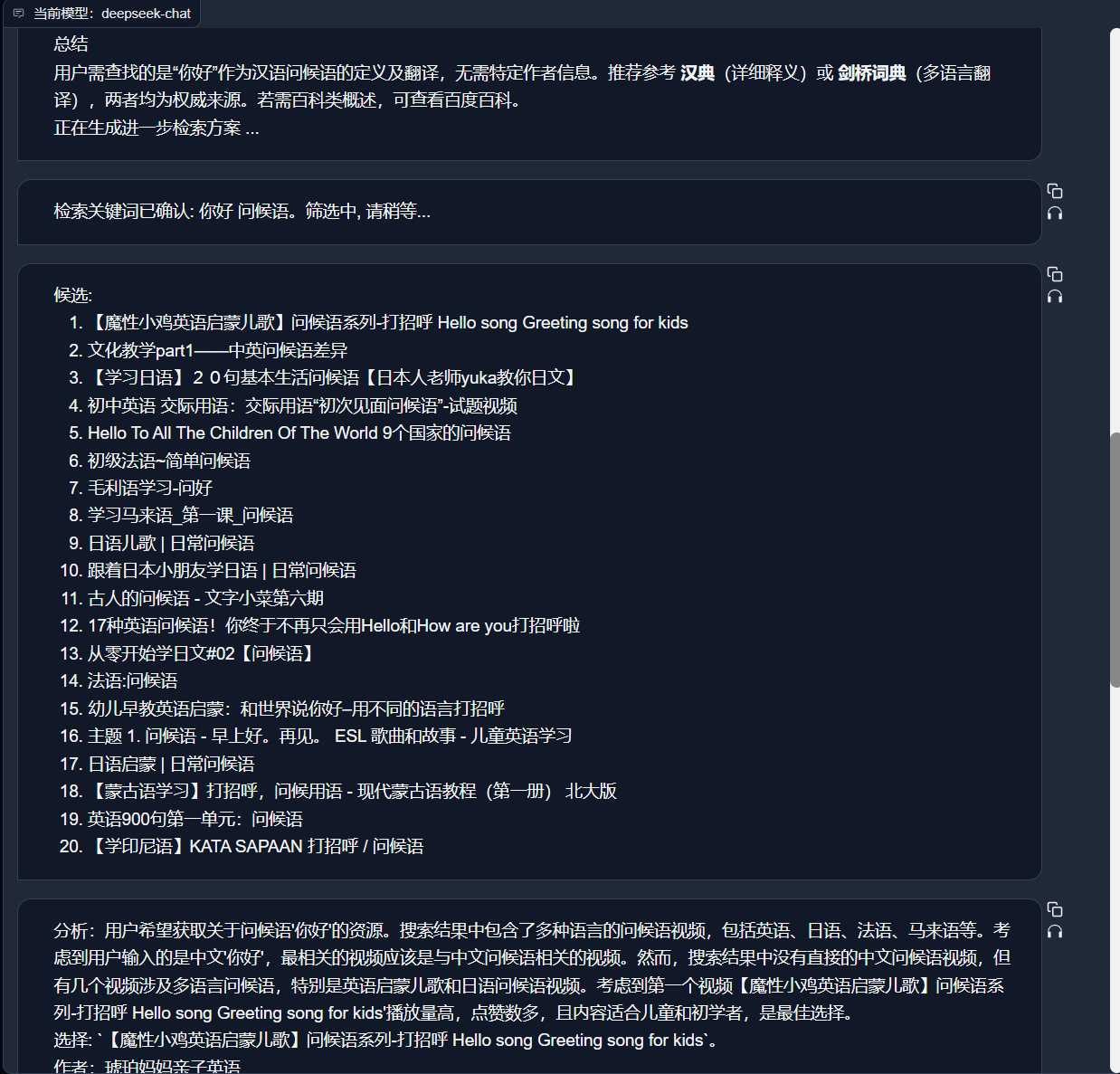

2.5多媒体查询

自动查找相关的多媒体资料

比如我发一个你好

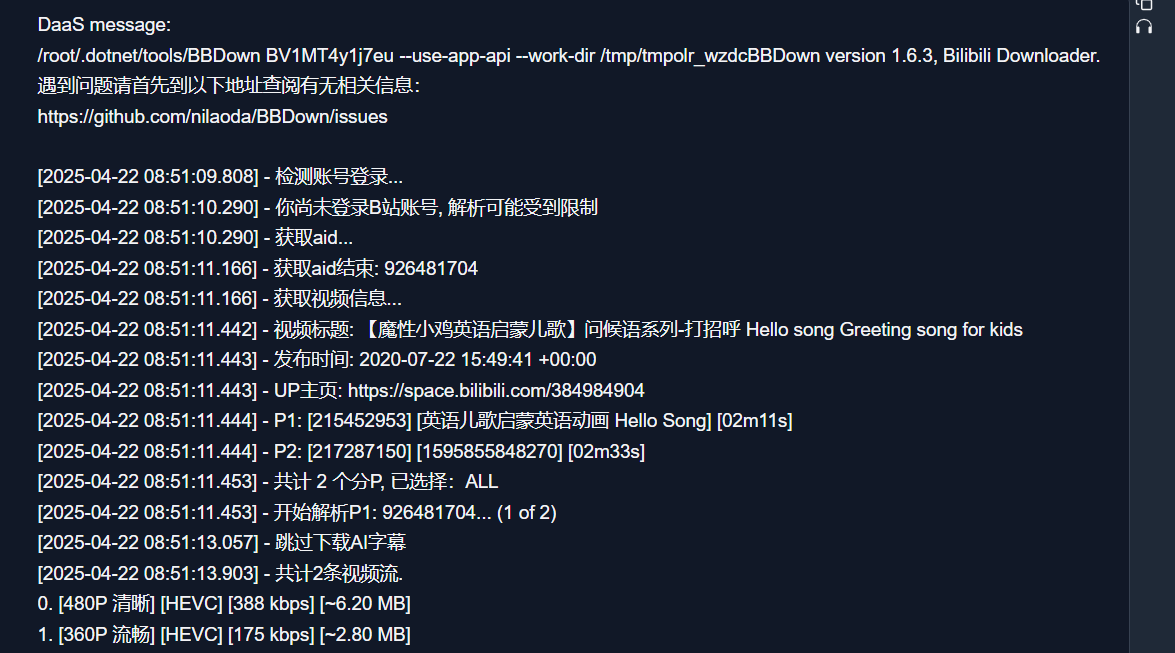

返回了相应的多媒体资料

然后自动下载了。。。

3.学术优化基本功能

在右侧的基础功能区里面,直接用就行了

正常在文本输入框里面输入内容,点击这几个选项可以实现功能

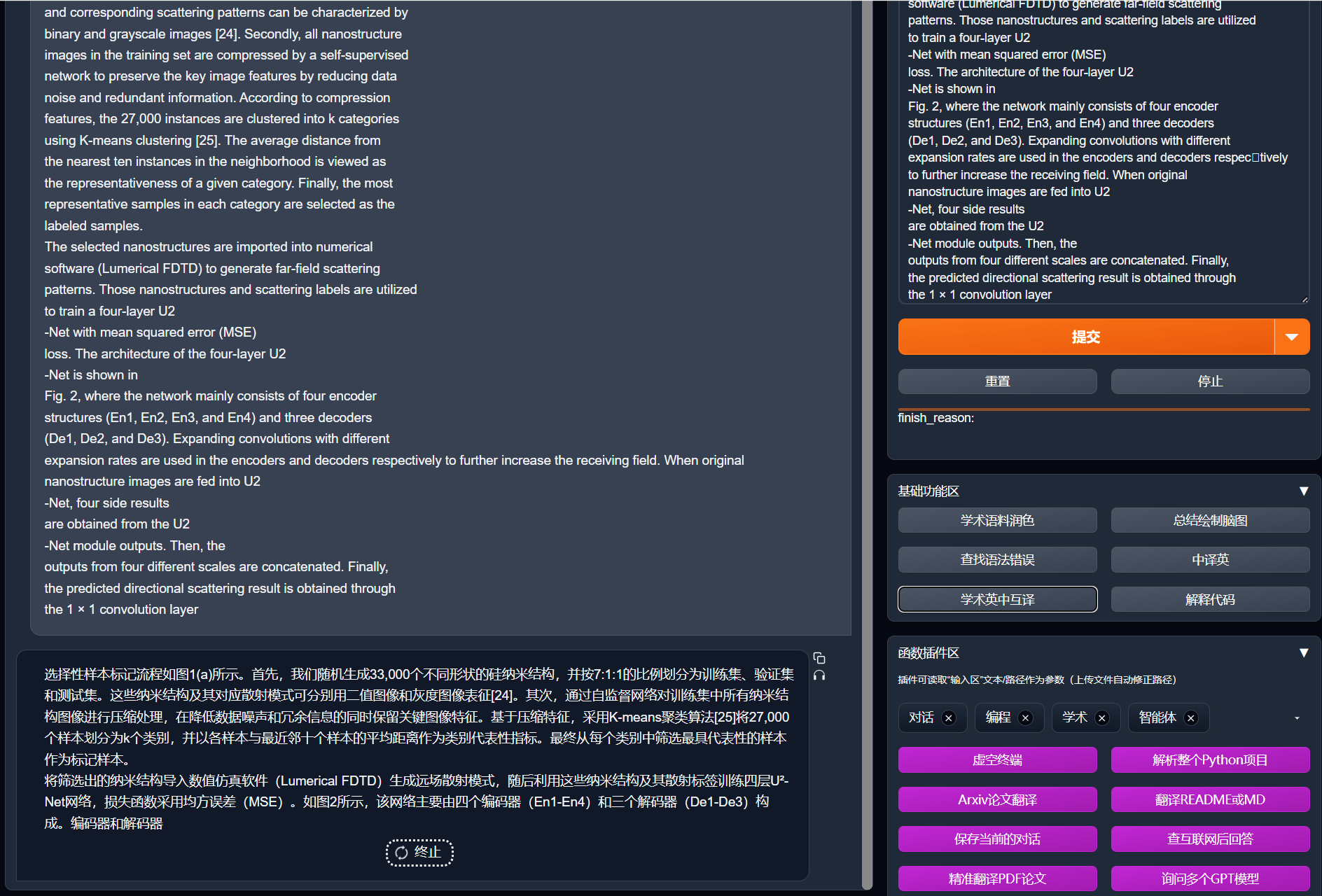

总结绘制脑图可以直接显示mermaid代码块的预览

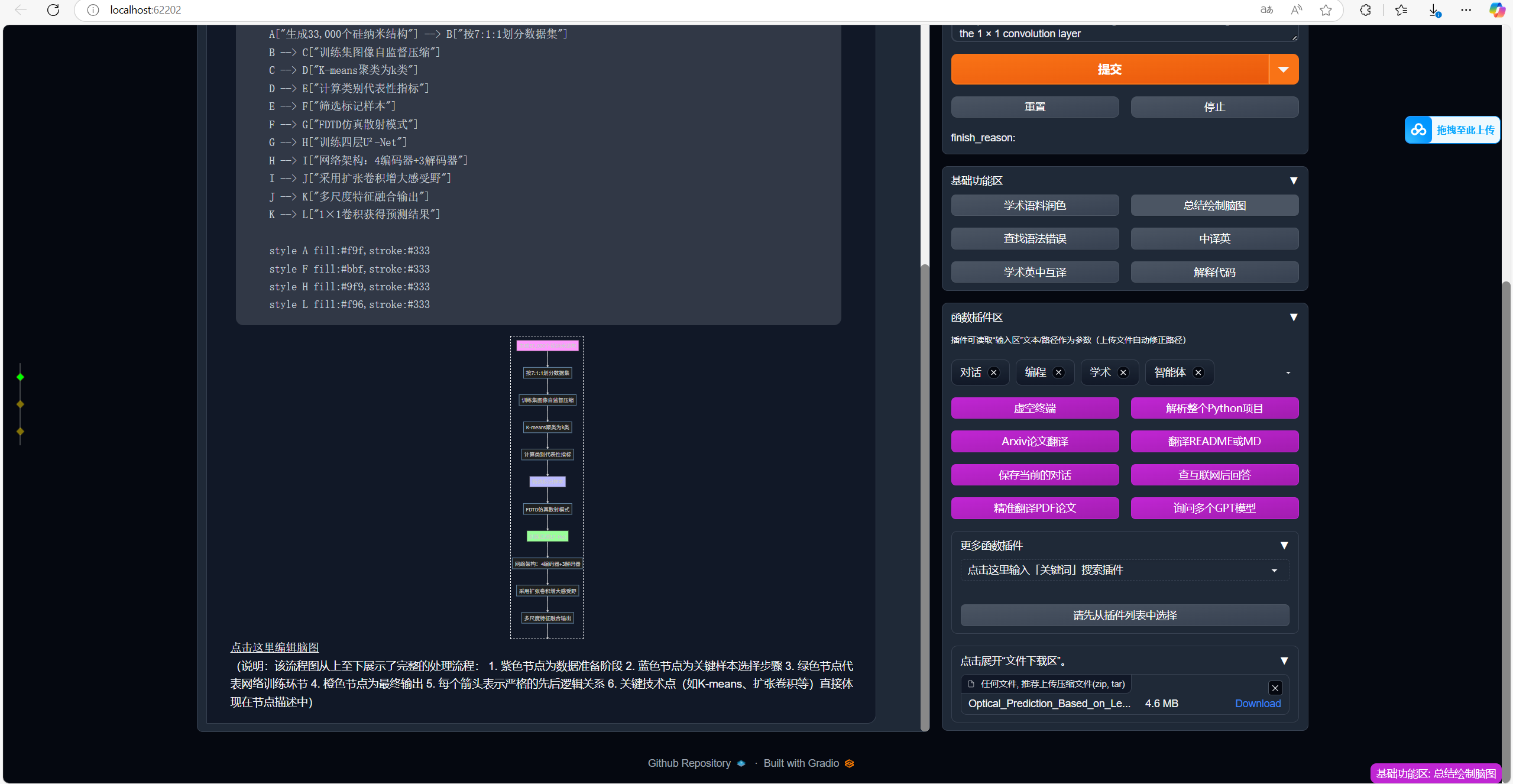

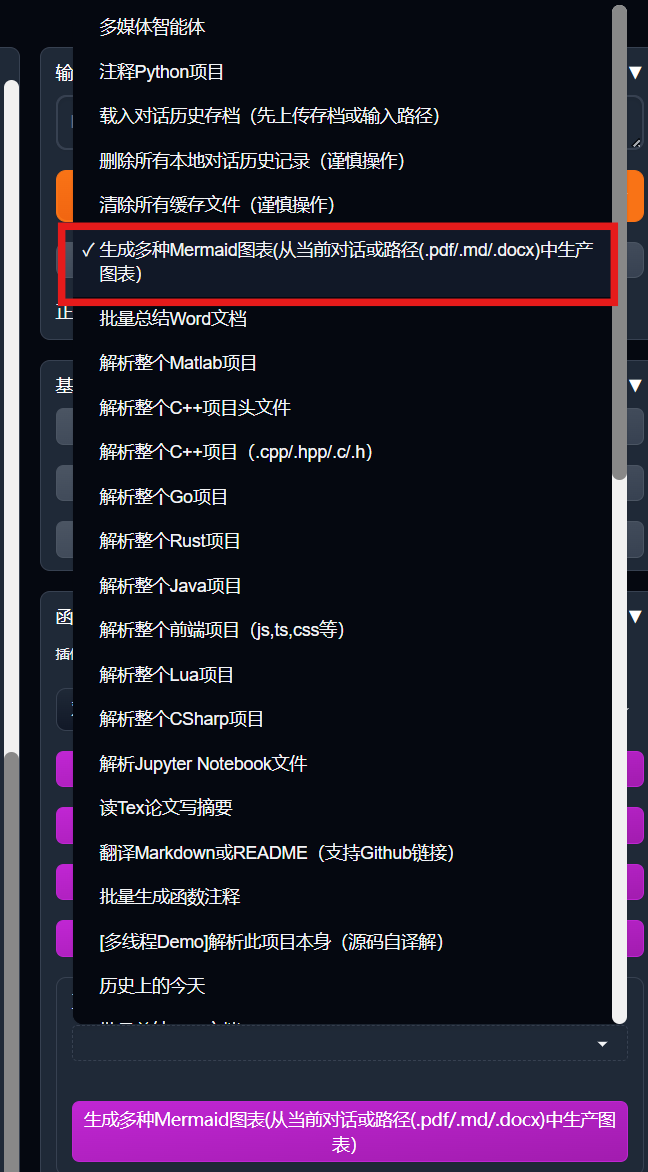

4.丰富的插件

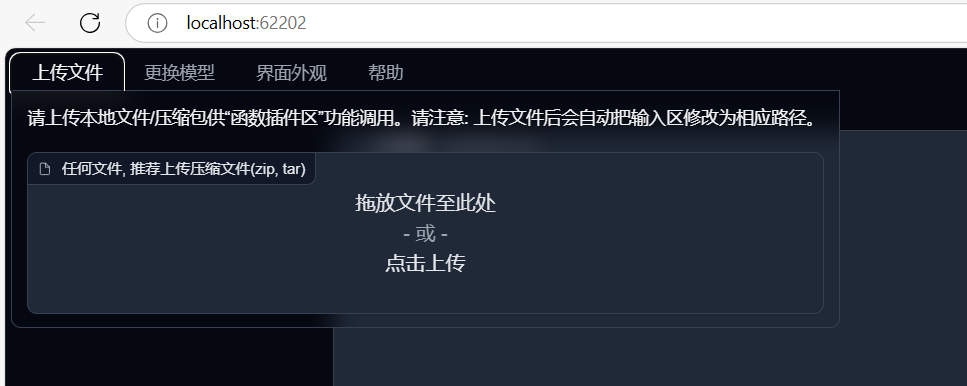

只有插件可以上传文件,这是目前最大的问题。

上传文件在最左上角,拖动或者点击上传

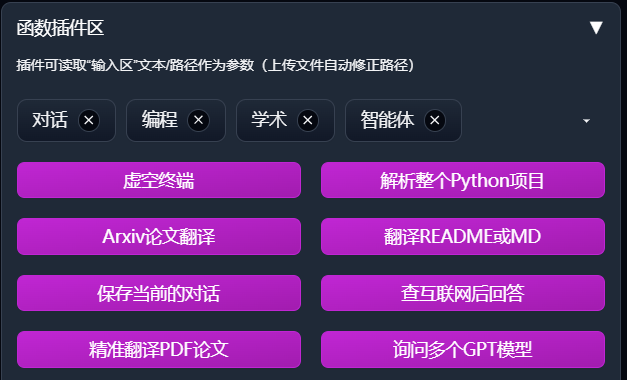

首先函数插件区提供了8个最基础的插件

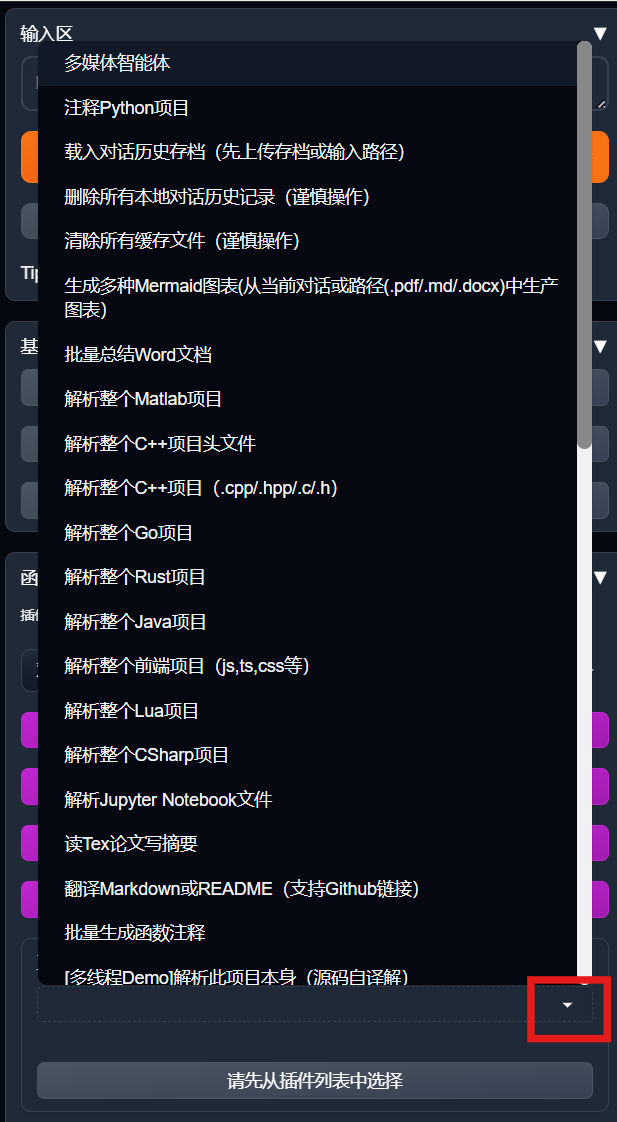

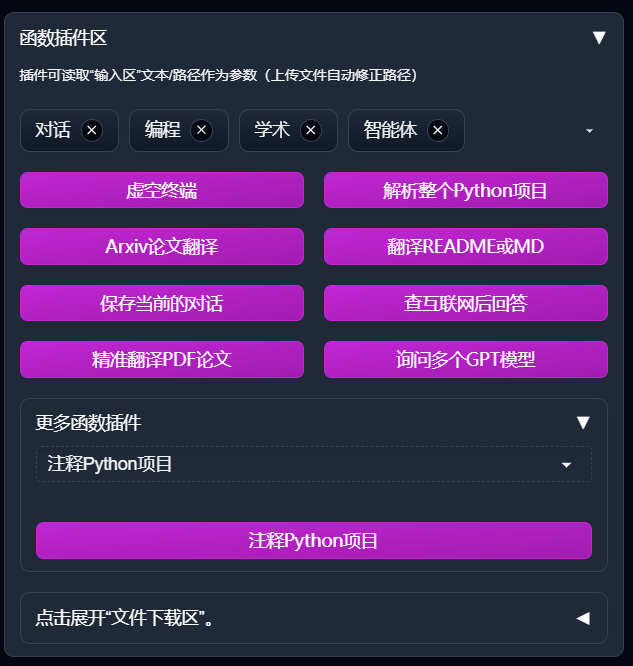

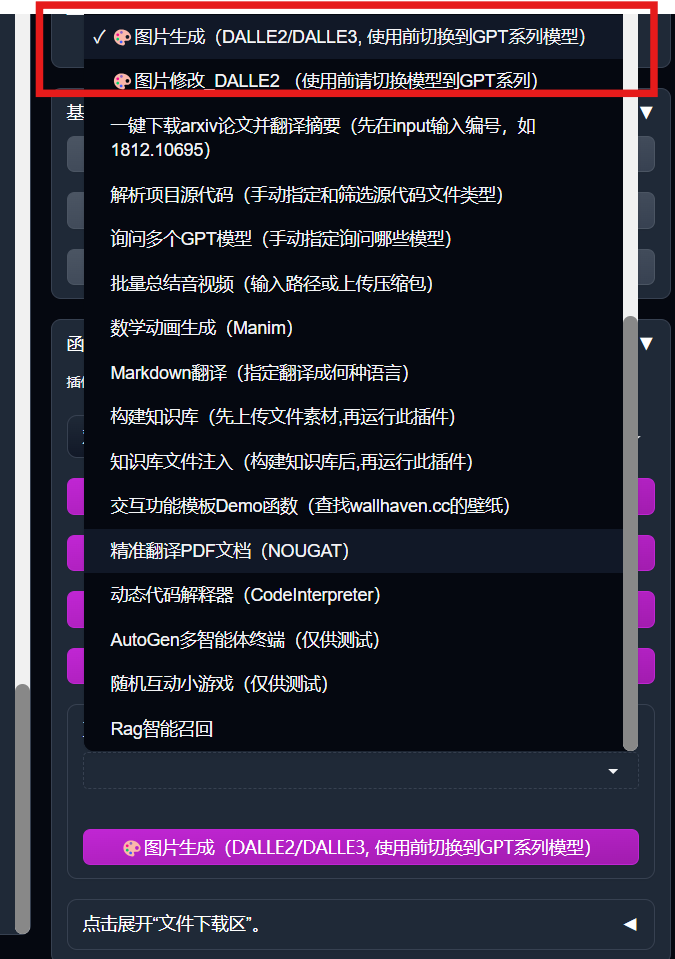

点击下拉框会出现更多插件

点击后,插件会被添加到界面上:

下面讲述一些有特色的插件,其他的也可以使用一下。

4.1AI智能体——虚空终端(插件整合)

用自然语言描述需要做什么,会自动检查需要用哪些插件,然后自动完成。

比如:

「请调用插件,为我翻译PDF论文,论文我刚刚放到上传区了」

「请调用插件翻译PDF论文,地址为https://openreview.net/pdf?id=rJl0r3R9KX」

「把Arxiv论文翻译成中文PDF,arxiv论文的ID是1812.10695,记得用插件!」

「生成一张图片,图中鲜花怒放,绿草如茵,用插件实现」

「用插件翻译README,Github网址是https://github.com/facebookresearch/co-tracker」

「我不喜欢当前的界面颜色,修改配置,把主题THEME更换为THEME="High-Contrast"」

「请调用插件,解析python源代码项目,代码我刚刚打包拖到上传区了」

「请问Transformer网络的结构是怎样的?」

如果使用「调用插件xxx」、「修改配置xxx」、「请问」等关键词,意图可以被识别的更准确。

建议使用 GPT3.5 或更强的模型,弱模型可能无法理解想法。

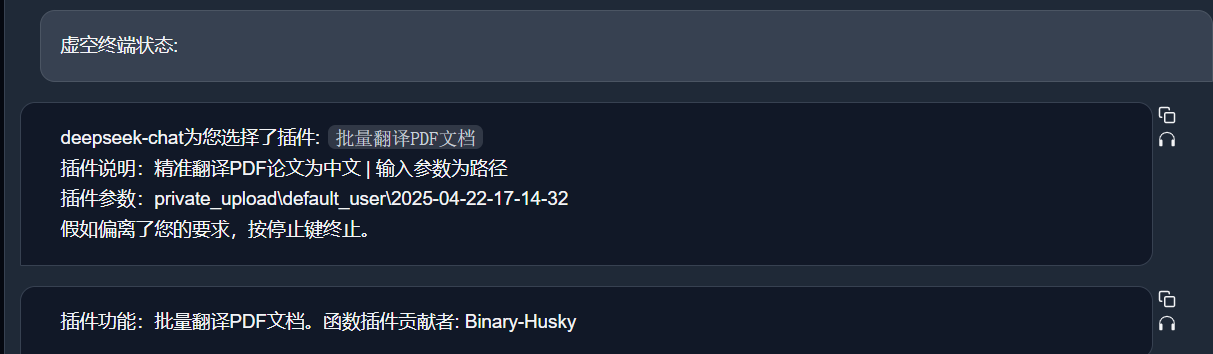

上传文件后,输入:请调用插件,为我翻译PDF论文,论文我刚刚放到上传区了。然后点击虚空终端:

可以看到,虚空终端正在搜索应该使用什么插件

然后自动完成任务。

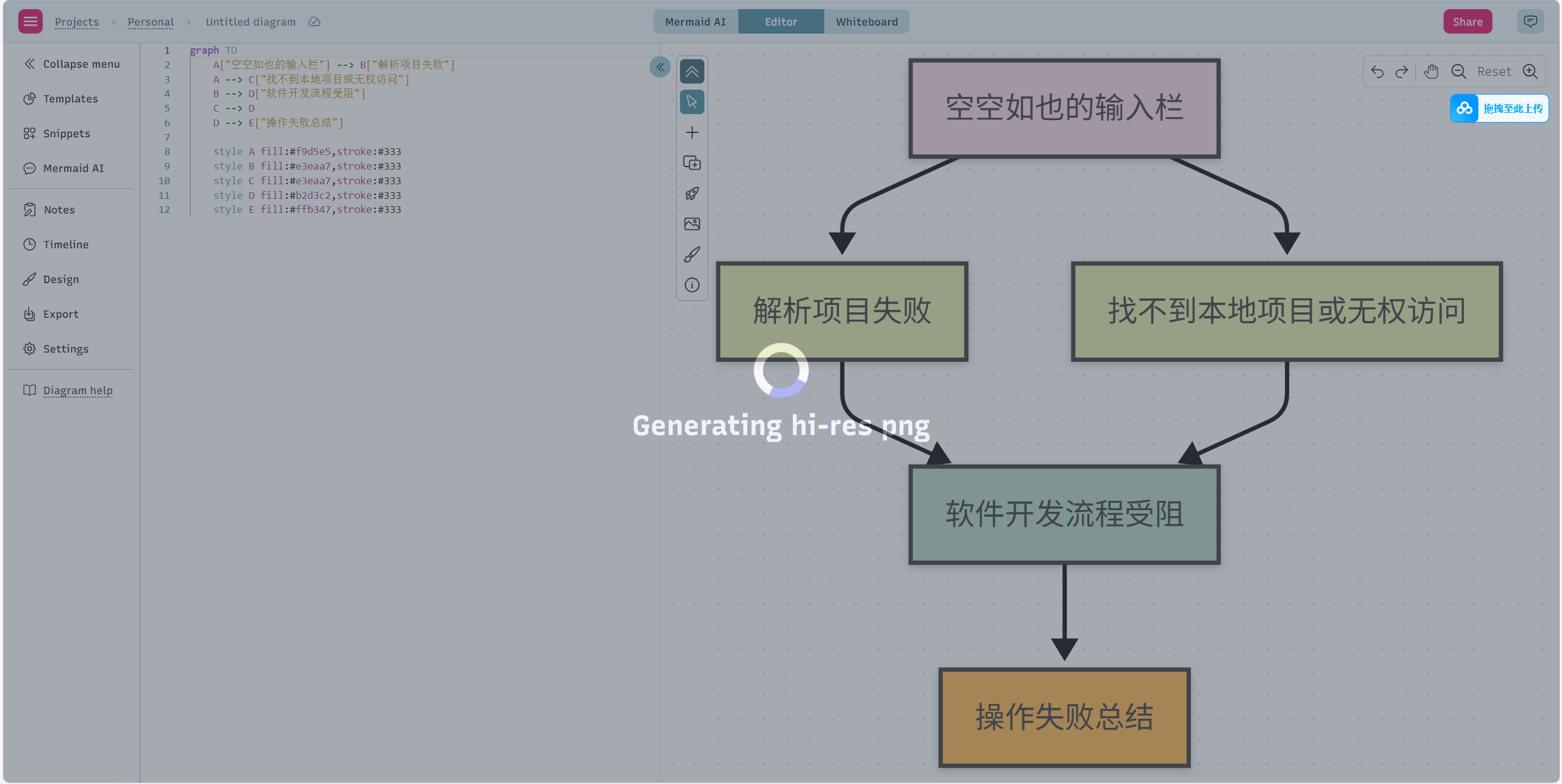

4.2 图表生成

这个插件可以生成多种图表:

同时给了相应链接可以微调和下载图像

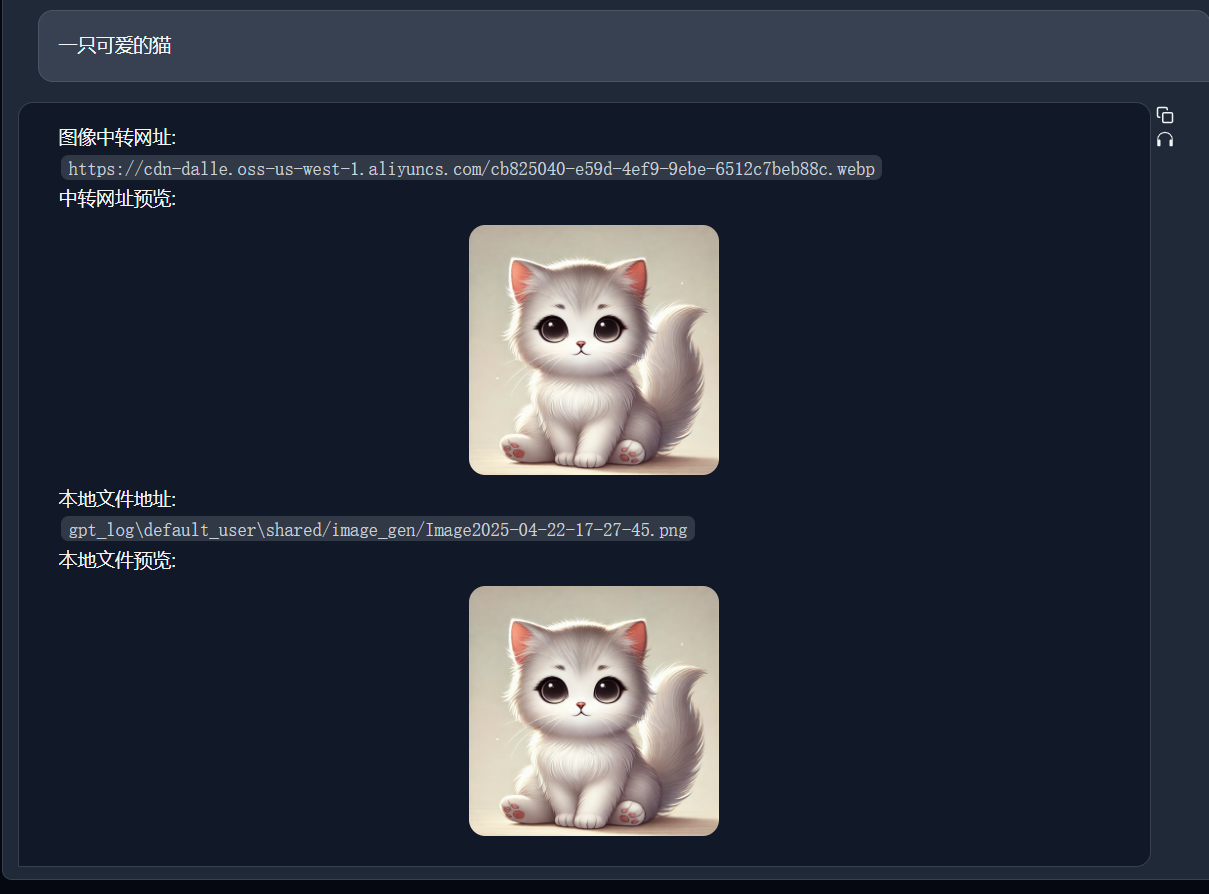

4.3图像生成

点击图像生成

输入提示,即文生图

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?