一、多维特征

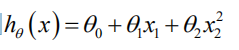

例子:

我们探讨了单变量/特征的回归模型,现在我们对房价模型增加更多的特征,

例如房间数楼层等,构成一个含有多个变量的模型,模型中的特征为(X1,X2,…Xn)

n 代表特征的数量

X(i)代表第 i 个训练实例,是特征矩阵中的第 i 行,是一个向量(vector)。

例如:

Xj(i) 代表特征矩阵中第 i 行的第 j 个特征,也就是第 i 个训练实例的第 j 个特征。

例如:X2(2)=3,X3(2)=2

hθ(x)=θ0X0+θ1X1+…θnXn,X0=1

二、梯度下降算法

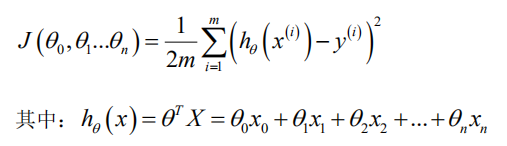

与单变量线性回归类似,在多变量线性回归中,我们也构建一个代价函数,则这个代价

函数是所有建模误差的平方和,即:

我们的目标和单变量线性回归问题中一样,是要找出使得代价函数最小的一系列参数。

多变量线性回归的批量梯度下降算法为:

我们开始随机选择一系列的参数值,计算所有的预测结果后,再给所有的参数一个新的

值,如此循环直到收敛。

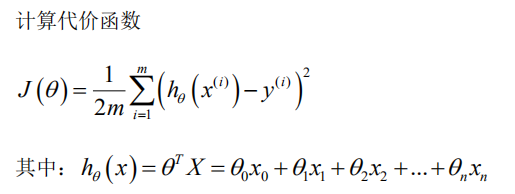

- python代码示例:

题目:

代码:

def computeCost(X, y, theta):

inner = np.power(((X * theta.T) - y), 2)

return np.sum(inner) / (2 * len(X))

三、梯度下降算法实践1—特征缩放

在我们面对多维特征问题的时候,我们要保证这些特征都具有相近的尺度,这将帮助梯

度下降算法更快地收敛。

以房价问题为例,假设我们使用两个特征,房屋的尺寸和房间的数量,尺寸的值为 0-

2000 平方英尺,而房间数量的值则是 0-5,以两个参数分别为横纵坐标,绘制代价函数的等

高线图能,看出图像会显得很扁,梯度下降算法需要非常多次的迭代才能收敛。

于是,我们令

四、梯度下降算法实践2—学习率

梯度下降算法收敛所需要的迭代次数根据模型的不同而不同,我们不能提前预知,我们

可以绘制迭代次数和代价函数的图表来观测算法在何时趋于收敛。

也有一些自动测试是否收敛的方法,例如将代价函数的变化值与某个阀值(例如 0.001)

进行比较,但通常看上面这样的图表更好。

梯度下降算法的每次迭代受到学习率的影响,如果学习率 α 过小,则达到收敛所需的迭

代次数会非常高;如果学习率 α 过大,每次迭代可能不会减小代价函数,可能会越过局部最

小值导致无法收敛。

通常可以考虑尝试些学习率:

α=0.01,0.03,0.1,0.3,1,3,10

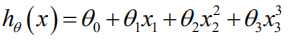

五、特征和多项式回归

例子:预测房价问题

线性回归并不适用于所有数据,有时我们需要曲线来适应我们的数据,比如一个二次方

模型

注:如果我们采用多项式回归模型,在运行梯度下降算法前,特征缩放非常有必要。

284

284

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?