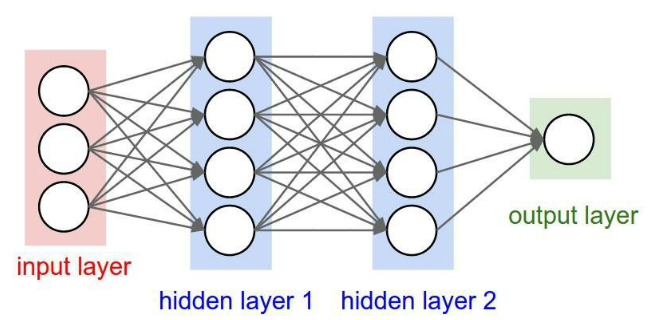

一、神经网络:

增加少量隐层(浅层神经网络),增加中间层(深度神经网络,DNN)。神经网络应用在分类问题中效果好,LR或Linear SVM,线性分割都可用于分类。

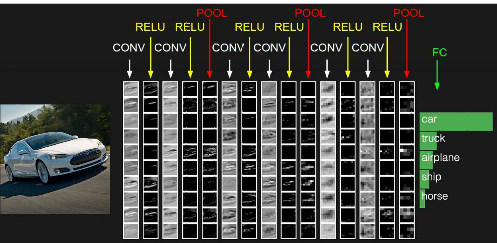

二、卷积神经网络(CNN):

卷积神经网络依旧保存了层级结构,但层的功能和形式发生了变化。

分别有:数据输入层、卷积计算层、激励层、池化层、全连接层

1、数据输入层(Input layer)

(1)去均值:把输入数据各个维度都中心化到0(只计算训练集上的均值)(对应下图2的平移)

(2)归一化:幅度归一化到同样的范围(RGB的范围本身

本文介绍了卷积神经网络(CNN)的基本结构和工作原理,包括数据输入层、卷积计算层、激励层(ReLU)、池化层和全连接层。讨论了ReLU的优缺点,以及CNN在处理高维数据和分类问题中的优势。此外,还提到了CNN的典型应用如LeNet、AlexNet等,并提及常用的CNN框架如Caffe、Torch和TensorFlow。

本文介绍了卷积神经网络(CNN)的基本结构和工作原理,包括数据输入层、卷积计算层、激励层(ReLU)、池化层和全连接层。讨论了ReLU的优缺点,以及CNN在处理高维数据和分类问题中的优势。此外,还提到了CNN的典型应用如LeNet、AlexNet等,并提及常用的CNN框架如Caffe、Torch和TensorFlow。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

742

742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?