Nginx负载均衡

概述

客户端发送多个请求到服务器,服务器处理请求,有一些可能要与数据库进行交互,服务器处理完毕后,再将结果返回给客户端。

这种架构模式对于早期的系统相对单一,并发请求相对较少的情况下是比较适合的,成本也低。但是随着信息数量的不断增长,访问量和数据量的飞速增长,以及系统业务的复杂度增加,这种架构会造成服务器相应客户端的请求日益缓慢,并发量特别大的时候,还容易造成服务器直接崩溃。很明显这是由于服务器性能的瓶颈造成的问题,那么如何解决这种情况呢?

我们首先想到的可能是升级服务器的配置,比如提高 CPU 执行频率,加大内存等提高机器的物理性能来解决此问题,但是我们知道摩尔定律的日益失效,硬件的性能提升已经不能满足日益提升的需求了。最明显的一个例子,天猫双十一当天,某个热销商品的瞬时访问量是极其庞大的,那么类似上面的系统架构,将机器都增加到现有的顶级物理配置,都是不能够满足需求的。那么怎么办呢?

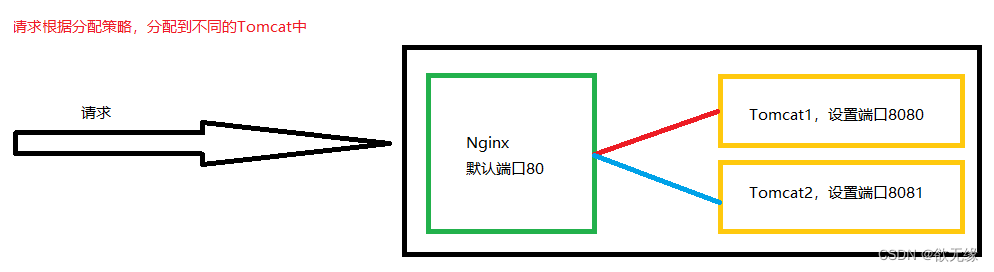

上面的分析我们去掉了增加服务器物理配置来解决问题的办法,也就是说纵向解决问题的办法行不通了,那么横向增加服务器的数量呢?这时候集群的概念产生了,单个服务器解决不了,我们增加服务器的数量,然后将请求分发到各个服务器上,将原先请求集中到单个服务器上的情况改为将请求分发到多个服务器上,将负载分发到不同的服务器,也就是我们所说的负载均衡。

实现效果

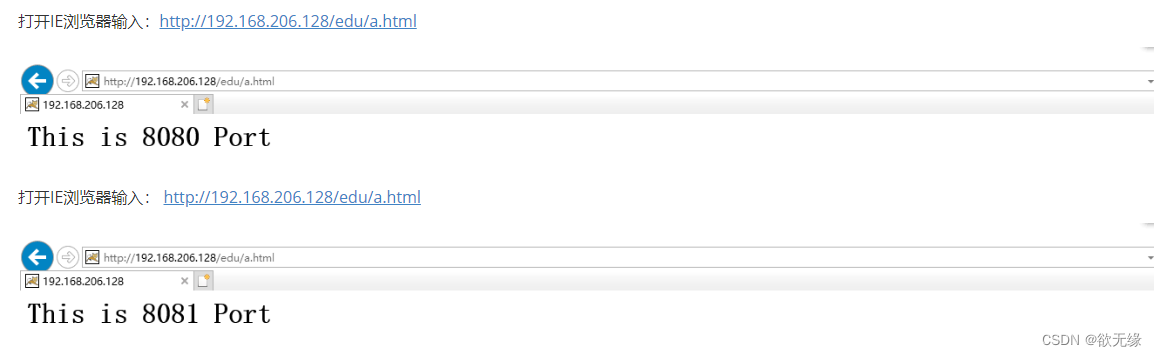

浏览器地址栏输入地址 http://192.168.206.128/edu/a.html,负载均衡效果,将请求平均到 8080 和 8081 端口中。

实现思路

实现步骤

第一步:修改Nginx的配置文件

vi /usr/local/softwore/nginx/conf/nginx.conf

upstream myserver {

server 192.168.206.128:8080;

server 192.168.206.128:8081;

}

server {

listen 80;

server_name 192.168.206.128;

#charset koi8-r;

#access_log logs/host.access.log main;

location / {

proxy_pass http://myserver;

}

/usr/local/softwore/nginx/sbin/nginx

第二步:在Tomcat2的webapps文件夹中,创建一个edu文件夹,在里边创建a.html

创建:

mkdir -p /usr/local/softwore/tomcat2/webapps/edu

echo "<h1>This is 8081 Port</h1>" > /usr/local/softwore/tomcat2/webapps/edu/a.html

启动:

/usr/local/softwore/tomcat1/bin/startup.sh

/usr/local/softwore/tomcat2/bin/startup.sh

第三步:测试效果

打开IE浏览器输入:http://192.168.206.128/edu/a.html

打开IE浏览器输入: http://192.168.206.128/edu/a.html

关闭服务

/usr/local/softwore/nginx/sbin/nginx -s quit

/usr/local/softwore/tomcat1/bin/shutdown.sh

/usr/local/softwore/tomcat2/bin/shutdown.sh

分配策略

轮询(默认):

每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器 down 掉,能自动剔除。

weight:

weight 代表权重,默认为1,权重越高被分配的客户端越多,weight 和访问比率成正比,用于后端服务器性能不均的情况。 例如:

ip_hash:

每个请求按访问 ip 的 hash 结果分配,这样每个访客固定访问一个后端服务器,可以解决 session 的问题。 例如:

fair(第三方):

按后端服务器的响应时间来分配请求,响应时间短的优先分配。例如:

5479

5479

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?