上周回顾:

(上周还没开始)

本周计划:

本周阅读论文《Deep-Learning Full-Waveform Inversion Using Seismic Migration Images》.

这篇论文是发表于2022的一篇较新的关于DL-FWI的论文, 作者在论文中提出了一些比较新颖的观点和质疑. 这篇论文主基调很符合近几年DL-FWI的味道, 很浓重的与传统物理先验知识结合的味道, 这对于我来说就比较有挑战, 毕竟我更多做的是纯数据驱动的实验.

但是有挑战就有尝试的意义! 我现在想接触更多地球科学固有的一些处理地震数据手段, 比如这篇论文就提到了RTM (Reverse-time migration), 这似乎是很有意思的一种对于叠前多炮数据进行预处理的方式.

这周的计划就是阅读这篇论文.

目标是基本了解这篇论文想干的事情, 知道个大概.

然后试探去了解一些新的地震记录的处理方式.

完成情况

大概谈谈这篇论文的内容(目前只读了摘要和引言, 方法论浅显了解了一些)

- 作者希望利用共源图像域记录的逆时偏移(RTM)图像作为CNN的数据引擎, 从而重建背景速度.

- 然后作者希望通过在迭代神经网络中输入重建的速度模型, RTM图像, 正则化项来拟合更高分辨率的速度模型.

而后作者在引言中对于DL参与的FWI进行了细分, 分为:

- 弱关联DL模型的FWI, 主要来说, 这些FWI主要利用DL的自动微分工具(Adam)来实现目标, 因为这个过程与传统FWI的伴随状态方法是类似的.

- 第二种是DIP (Deep image prior), DIP把深度网络作为传统FWI的某个中间步骤的组件, 这一点和王师姐的《Fast convex set projection with deep prior for seismic interpolation》很像呢, 虽然那篇不是讲FWI.

-

- 第三个就是我目前真正意义上咱们搞得的DL-FWI, 基于网络来实现端到端的数据驱动FWI, 当然, 作者在这里也把它细分为 (1. 后处理的端到端学习方法; 2. 完全的端到端; 3. 迭代的端到端). 作者这里采样的就属于迭代的端到端.

- 关于这三种方法, 作者也做出了评述, 后处理的端到端存在信息丢失的问题; 完全端到端可能由于传统FWI但是泛化性弱, 及其依赖大数据; 而迭代端到端是作者的认为最好的手段 (所以没说太多不足).

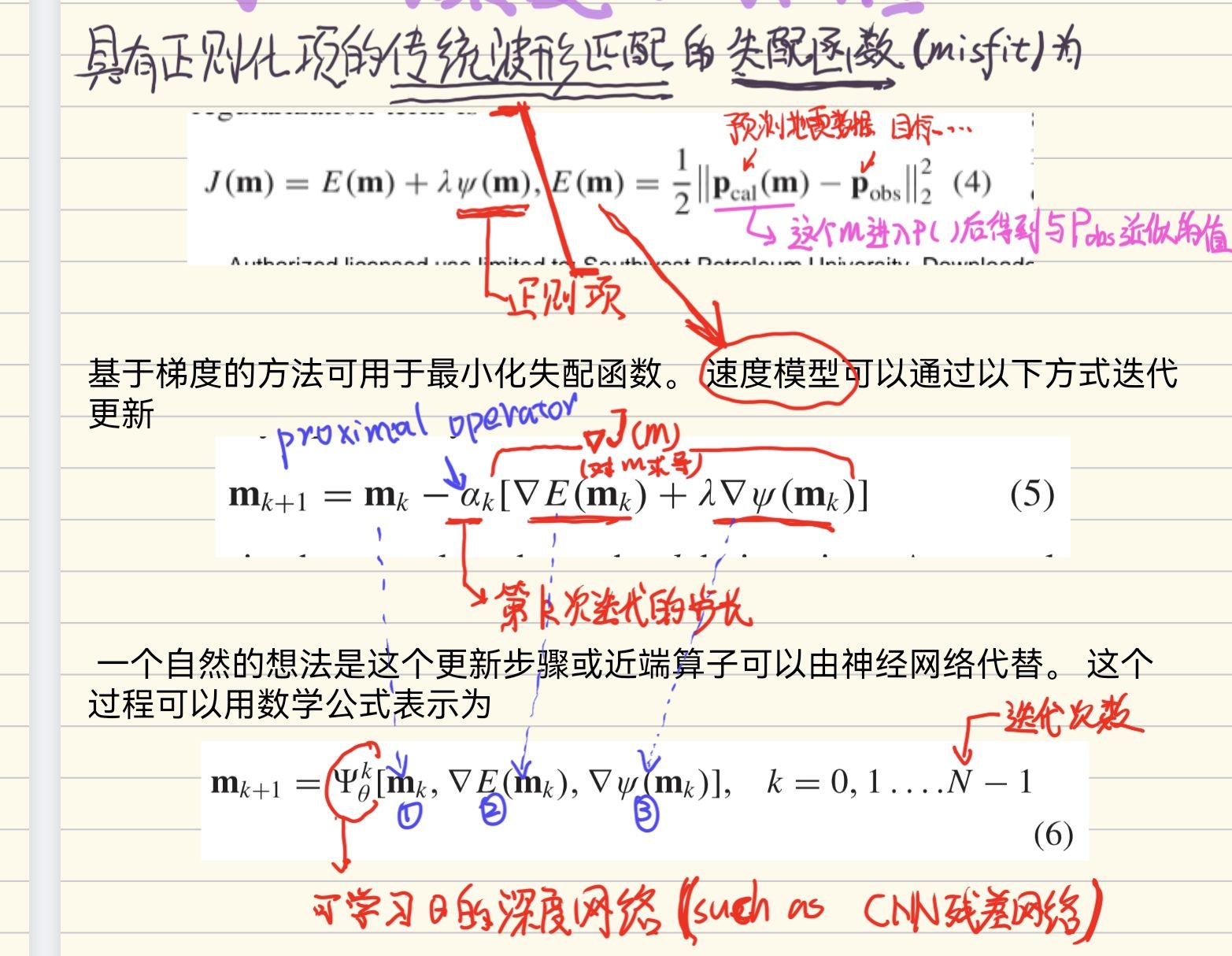

在方法论部分, 作者介绍了波形的失配函数(misfit)和最小化迭代更新的过程 [上式4], 简单来说, 式4就是附带了正则项的拟合速度模型的最小化公式.

迭代神经网络目标就是把失配函数的 [对速度模型求梯度下降的迭代过程] 的给神经网络化 [如式6], 这个过程中网络会接受如图的三种参数: 1.初值速度模型; 2.预测目标与真实速度模型的均方误差的梯度; 3.正则项的梯度. 而这些参数和传统梯度下降是一致的. 从这个角度来看, 迭代神经网络类似于一种DIP方法.

后续提到了叠前RTM图像的DLFWI, 但是因为本周忙于设置DL-FWI培训一事, 这部分研究被搁置了, 目前只能说有点眉目了, 但是还没到能写出来的地步, 亟待代码验证. 毕竟RTM还是有点麻烦的一件事, 我之前是完全不了解的.

(备注: 多亏了之前正演的培训, 网上有关RTM的代码我似乎能follow, 下周可以试试)

存在的主要问题

目前存在的问题就是感觉脱离了一些基础知识看一些有物理先验的FWI论文还是有点难度的, 需要边读边去了解些FWI的额外知识, 无法否认自己还是一个很纯的小白, 很多东西还要学.

RTM是目前想去了解的东西, 这些将会是下周的目标.

下一步工作

试着了解下RTM的原理.

RTM代码的复现.

正演的Python代码复现.

1403

1403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?