问题

1. 我们通过应用程序或者类库来实现 系统之间的相互访问。比如经常使用HTTP客户端从WEB服务器上获取信息,或者通过WebService来执行远程调用。然而有时候一个通用协议并没有覆盖一些场景。比如无法使用通用的HTTP服务器来处理大文件、电子邮件、近实时消息比如财务数据和多人游戏数据。我们需要一个合适的协议来处理一些特殊场景。例如可以实现一个优化的Ajax聊天应用、流媒体传输或者大文件传输的HTTP服务器,你甚至可以自己设计和实现一个新的协议来准确实现你的需求。

2. 以最低的代价提供更大吞吐量和稳定的网络通信需求是永远存在的,且这些需求是渴望被满足。

解决方案

Netty是一个提供异步事件驱动的网络应用框架,用以快速开发高性能高可靠性的网络服务器和客户端程序。换句话说Netty是一个NIO框架,使用它可以简单快速开发网络应用程序,比如客户端和服务端协议。Netty大大简化了网络程序的开发过程比如TCP和UDP的Socket开发。

理念

Netty是一个致力于创建高性能网络应用的先进框架。

1. 你不需要以专业网络专家的身份用netty去构建网络应用

2. 使用Netty可以比用JAVA原生的API更简单地开发应用。

3. Netty的设计理念和设计实例都很棒,例如Netty让你的应用从逻辑上与网络层解耦,让你无需花费更多的时间去关心网络层。

特性

| 类别 | 特性实现 |

| 设计 | 为多种网络传输类型提供统一的API,包括堵塞IO和非堵塞IO 简单但高效的线程模型 真实的无连接的数据包Socket的支持 逻辑组件通过链接的链式方式使用,使每个组件可以重复使用 |

| 易用性 | 丰富的JAVA文档和大量的代码实例 仅仅依赖JAVA1.6,部分特性依赖JAVA1.7或其他额外的JAR包 |

| 性能 | 相比使用JAVA原生API,有更大的吞吐量和低延时性 引进了池的概念和重复利用额理念来减少资源的消耗 最大限度的减少内存拷贝 |

| 健壮性 | 不会因为连接的缓慢、连接的损耗产生OOM 在优质的网络环境中消除Netty应用的不公平的读写比 |

| 安全性 | 完成对SSL/TLS和StartSSL的支持 可以在Applet或者OSGI等这些受限制的环境中运行 |

| 社区驱动 | 社区成立早且活跃度高、版本更新频繁 |

核心组件

1. Channels

与某个模型的连接,例如硬件设备、文件、网络Socket,抽象地可以是程序组件中一次或者多次不同的IO操作。可以将Channel想象成一个货车,用来装载和卸载货物的货车,这个火车可以打开或者关闭,打开连接或者关闭连接。

2. Callbacks

回调可以这么理解,定义一个方法,这个方法的引用被另一个方法所持有,这样做的好处就是另一个方法可以在一个恰当的时候回头调用这个方法。

例如当有一个新连接建立的时候,实现了ChannelHandler接口的channelActive()方法将被回调执行。

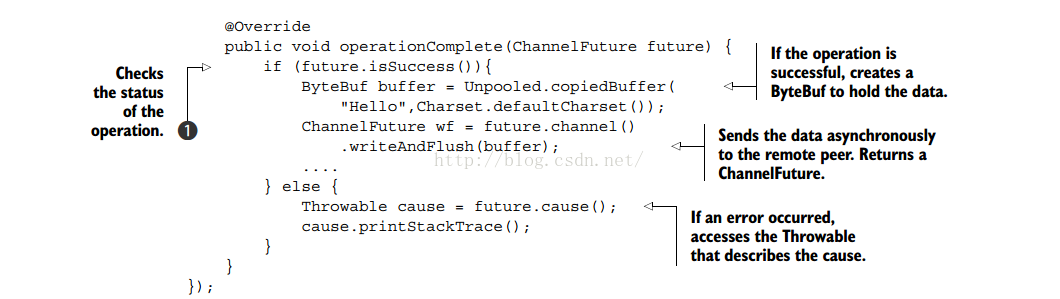

3. Futures

Future提供了另外一种方法来通知其他的组件已经有一个操作完成了。Future的角色就像一个异步操作的结果的占位符,先占着地方,等操作结束了,操作返回了一个结果集,再用这个结果集将刚才的Future占好位置填充好。

4. Events and Handlers

Netty使用不同的事件来通知状态的改变或者操作状态的改变。这将使我们更加方便地根据返回的事件的类型的不同触发相对应的事件处理。一般对应的事件处理包括:

1> 日记处理

2>数据传输

3>流信息控制

4>应用程序逻辑处理

Netty是一个网络框架,所以事件是按照他们关联的输入输出流来区分的,事件可能是因为输入数据或者某些状态的改变而被触发,包括:

1>活跃或者不活跃的连接

2>数据读取

3>用户事件

4>错误事件

POM依赖

5.0版本

<dependency>

<groupId>io.netty</groupId>

<artifactId>netty-all</artifactId>

<version>5.0.0.Alpha2</version>

</dependency>

Client/Server概述

所有的Netty服务器都需要遵循以下几个原则:

1> 至少有一个ChannelHandler。当服务器端接收到客户端的数据后,这个组件的具体实现将做我们应用的业务的逻辑处理。

2>Bootstrapping。启动类代码用来配置一些基本的服务端的参数。最少配置的情况下,需要配置一个端口号告诉服务器端在哪个端口监听哪个连接请求。

Netty客户端:

1> 连接到服务器端

2> 发送一个或多个消息

3> 等待或接收服务器端的返回

4> 关闭连接

723

723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?