现象描述

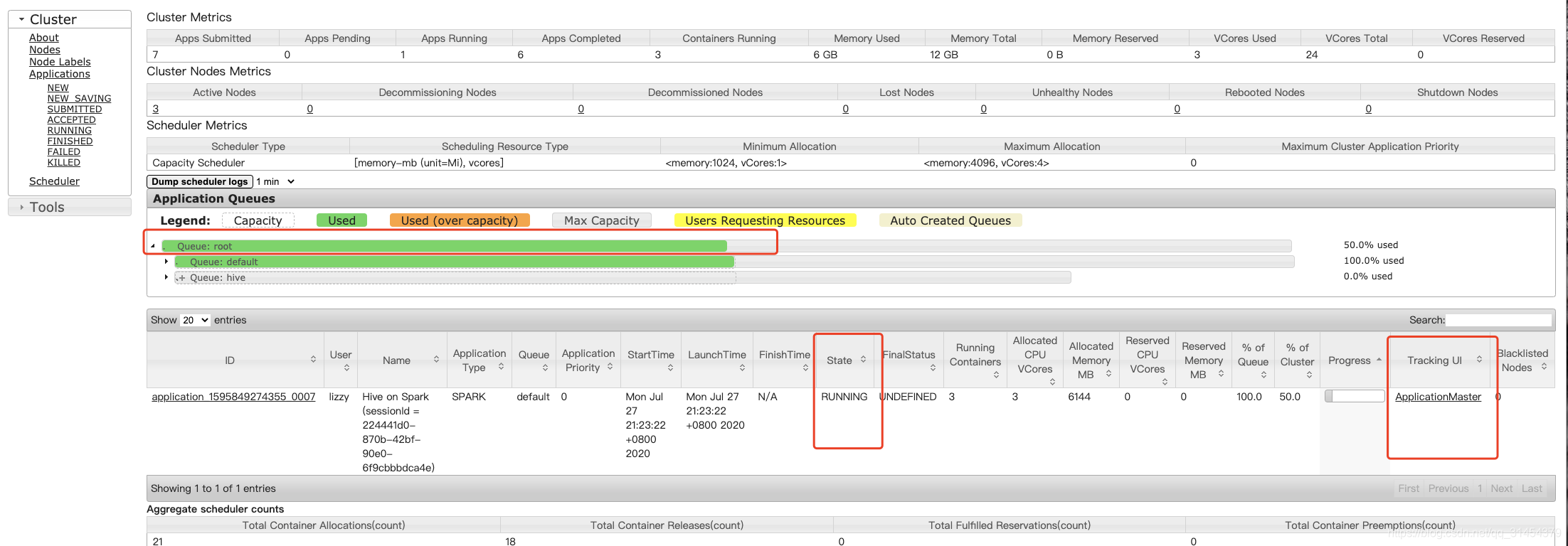

这个任务已经执行完毕,但是任务状态一致是running导致队列资源没有释放

由于是测试服务器,队列资源较少,导致后面任务阻塞。

原因:spark on hive本质是spark-shell.sh,spark-shell.sh会一直占用进程,这样后面提交的hive on spark任务就不需要重复上传spark依赖,加速任务执行速度

解决方法:

- 如果是hive命令行客户端提交的job,退出hive命令行,资源自动释放

- 如果是脚本提交的job,最好在脚本末尾加入 !quit 主动释放资源

1134

1134

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?