BERT模型使用Transformer模型对输入序列的每一个token进行深层的embedding,并使用了2种预训练技巧。

输入

将3种embeddings求和作为模型输入:

Token Embeddings+Segment Embeddings+Position Embeddings

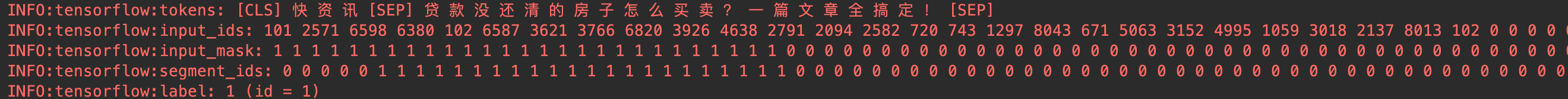

输入样例:

- Token embeddings

采用WordPiece embeddings方法,对input_dis进行embedding

- Segment Embeddings

对segment_ids进行embedding

- Position embeddings

1*128*768的随机数(128为序列长度,768为维度),没有embedding table也没经过embedding_lookup计算。

模型

transformer模型

bert使用transformer模型中的encoder模块作为网络模型。

bert模型结构: L=12, H=768, A=12, Total Parameters=110M

L是layers层数(即12层Multi-Head Attention),H是hidden vector size(每层所使用的全连接维度), A是self-attention的“头数(self-attention 即multi-head attention),即multi-head attention由A个scaled dot-product attention的输出concat构成。

Attention模块

bert中的Attention模块为muti-head Attention,muti-head Attention由多个scaled dot-product attention的结果concat构成。

Scaled Dot-Product Attention中的Q、K、V

将embedding输入到参数分别为![]()

![]()

![]() 的全连接层,输出分别为Q、K、V。

的全连接层,输出分别为Q、K、V。

矩阵运算形式:

矩阵运算形式:

Scaled Dot-Product Attention计算过程

输入:embedding、Q、K、V

输出:Z

矩阵形式计算过程:

矩阵形式计算过程:

Muti-Head Attention

muti-head Attention由多个scaled dot-product attention的结果Z1、Z2... concat,经过全连接层输出Z

整体结构

图中Ei表示输入Token i的词嵌入,Ti表示经过模型之后的Token i结合上下文表示,在分类任务中,取序列前的标签上下文特征C经过Softmax来分类。

预训练

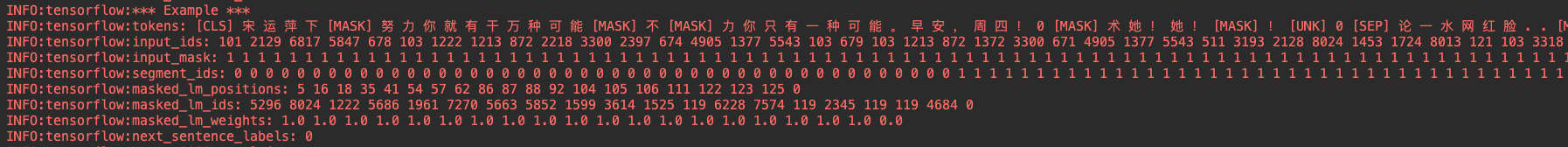

1. Mask LM

第一个任务是把一篇文章中,15% 的词汇遮盖,让模型根据上下文全向地预测被遮盖的词。假如有 1 万篇文章,每篇文章平均有 100 个词汇,随机遮盖 15% 的词汇,模型的任务是正确地预测这 15 万个被遮盖的词汇。通过全向预测被遮盖住的词汇,来初步训练 Transformer 模型的参数。

随机选择句子中15%的WordPiece tokens作为要mask的词

- 80%的时间真的用[MASK]取代被选中的词。比如 my dog is hairy -> my dog is [MASK]

- 10%的时间用一个随机词取代它:my dog is hairy -> my dog is apple

- 10%的时间保持不变: my dog is hairy -> my dog is hairy

解释:为什么要以一定的概率保持不变呢? 这是因为刚才说了,如果100%都用[MASK]来取代被选中的词,那么在fine tuning的时候模型会有一些没见过的词。那么为啥要以一定的概率使用随机词呢?这是因为Transformer要保持对每个输入token分布式的表征,否则Transformer很可能会记住这个[MASK]就是"hairy"。至于使用随机词带来的负面影响,文章中说了,所有其他的token(即非"hairy"的token)共享15%*10% = 1.5%的概率,其影响是可以忽略不计的

2. Next Sentence Prediction

第二个任务是预测下一句是否连续。譬如从上述 1 万篇文章中,挑选 20 万对语句(总共 40 万条语句)。挑选语句对的时候,其中 10 万对语句,是连续的两条上下文语句,另外 10 万对语句,不是连续的语句。然后让 Transformer 模型来识别这 20 万对语句,哪些是连续的,哪些不连续。

预训练数据样例

预训练损失函数

total_loss = masked_lm_loss + next_sentence_lossmasked_lm_loss:

取模型池化前的输出,即encoded sequence tensor,shape为[batch_size, seq_length, hidden_size]

对模型对输出序列做全连接,全连接的参数为网络中的embedding_table,,shape为[hidden_size,vocab_size]

之后经过softmax预测mask的词。

next_sentence_loss:

取模型池化后的输出,即encoded segment tensor,shape为[batch_size, hidden_size] ,经过softmax做2分类。

7622

7622

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?