机器学习笔记之高斯混合模型——模型介绍

引言

上一系列介绍了EM算法,本节将介绍第一个基于EM算法求解的概率生成模型——高斯混合模型(Gaussian Mixture Model,GMM)。

高斯混合模型介绍

示例介绍

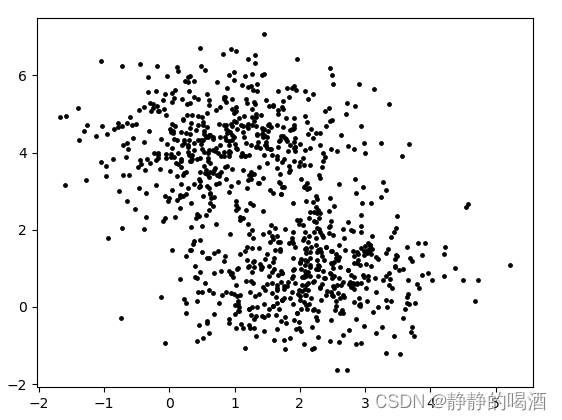

首先观察一张关于样本集合 X \mathcal X X的分布图:

从观察的视角对 X \mathcal X X的分布进行分析,感觉上述样本点明显存在两堆,当然也可以认为是一堆样本,可能是样本没有全部生成完而已。但从常理角度观察 更像是两种不同分布的样本点存在于同一个样本空间中。

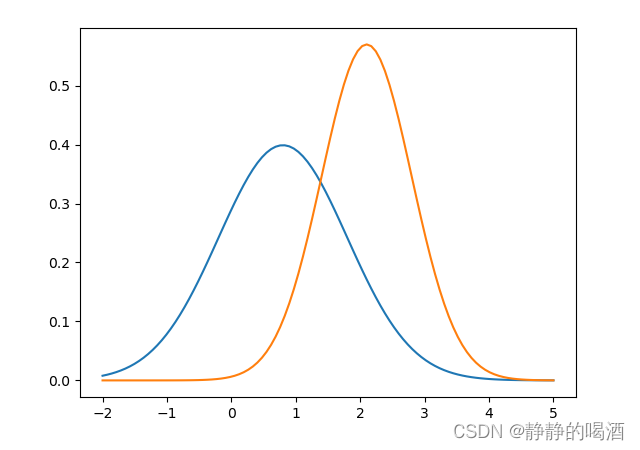

我们假设上述两堆样本点每一堆均服从高斯分布,尝试对上述样本点横坐标的的概率密度函数(Probability Density Function,PDF)进行表示:

该图意义是概率密度函数结果越高,该样本点存在更大的概率被产生出来。

观察上述所有样本点的横坐标,发现 以0.8和2.1这两个位置为中心,横坐标值围绕这两个中心产生的更密集,而其他位置相对稀疏一些。

因此,我们可以认为产生这些样本点的概率模型 P ( X ) P(\mathcal X) P(X)是由两个高斯分布混合在一起得到的混合模型。我们称这个概率模型 P ( X ) P(\mathcal X) P(X)为高斯混合模型。

从几何角度观察高斯混合模型

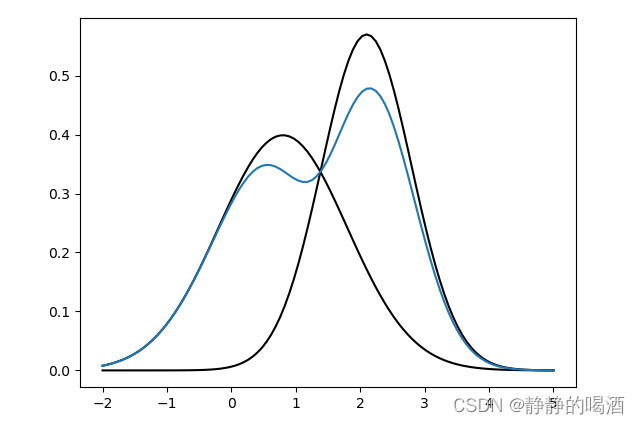

P ( X ) P(\mathcal X) P(X)也自然存在概率密度函数。依然以上述样本点横坐标作为示例,它的概率密度函数大致表示如下:

其中这个蓝色线可看作概率分布 P ( X ) P(\mathcal X) P(X)产生的样本横坐标的概率密度函数。以第 i i i个样本的横坐标 x ( i ) x^{(i)} x(i)为例,它的具体计算方法如下:

x m i x ( i ) = f 1 ( x ( i ) ) f 1 ( x ( i ) ) + f 2 ( x ( i ) ) ⋅ f 1 ( x ( i ) ) + [ 1 − f 1 ( x ( i ) ) f 1 ( x ( i ) ) + f 2 ( x ( i ) ) ] ⋅ f 2 ( x ( i ) ) = [ f 1 ( x ( i ) ) ] 2 + [ f ( x ( i ) ) ] 2 f 1 ( x ( i ) ) + f 2 ( x ( i ) ) \begin{aligned}x_{mix}^{(i)} & = \frac{f_1(x^{(i)})}{f_1(x^{(i)}) + f_2(x^{(i)})} \cdot f_1(x^{(i)}) + \left[1 - \frac{f_1(x^{(i)})}{f_1(x^{(i)}) + f_2(x^{(i)})}\right] \cdot f_2(x^{(i)}) \\ & = \frac{[f_1(x^{(i)})]^2 + [f_(x^{(i)})]^2}{f_1(x^{(i)}) + f_2(x^{(i)})} \end{aligned} xmix(i)=f1(x(i))+f2(x(i))f1(x(i))⋅f1(x(i))+[1−f1(x(i))+f2(x(i))f1(x(i))]⋅f2(x(i))=f1(x(i

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?