SSP: Semantic Space Projection for Knowledge Graph Embedding with Text Descriptions 论文读书笔记

1. Motivation

Knowledge graph embedding 将知识图中的实体和关系表示为低维的连续向量,从而使知识图谱可以适用于机器学习模型。 尽管Knowledge graph embedding已经有大量相关工作,但大多数方法仅仅集中在事实三元组(fact triples)上,而实体和关系的补充文本描述(Textual descriptions)尚未得到充分利用。为此,本文提出了SSP[1] 模型,它结合了知识图三元组和以及实体的文本描述共同学习,能够同时捕获图结构和语义信息。Textual descriptions 的示例如下图所示。

融入文本描述的优势有如下两点:

-

其一:可以发掘实体间的语义相关性。原文的论述为:“the semantic relevance between entities is capable to recognize the true triples, which are difficult to be inferred only with fact triples.” 我的理解为:在模型的学习过程中能够更好的拟合,比如说三元组(Anna Roosevelt, Parents, Franklin Roosevelt), 仅从图结构中并不能学习到一些该fact的特征,但是融合descriptions 的语义信息就能够发掘出语义相关性,因为在实体Anna Roosevelt的description中存在一些像“Roosevelt”和“Daughter of the President”的关键词。

-

其二:精确的语义表述能够提升两个三元组的可区分性。比如,对于一个查询”the profession of Daniel

Sturgeon”,有两个候选答案:“politician”和 “lawyer”。仅从图结构信息很难区分应该返回哪个答案,但是由于Daniel Sturgeon的description中含有大量像“Democratic Party”、 “State Legislature”、甚至是“Politician”的关键词。因此在此模型中头节点Daniel Sturgeon与尾节点politician在关系profession对应的 的超平面上距离更接近。

本文与前面工作相比的优势:

- 前面的工作DKRL[2]和“Jointly”[3] 都是weak-correlation modeling。原文的描述是:“Both DKRL and “Jointly” apply first-order constraints which are weak in capturing the correlation of texts and triples. It’s note worthy that triple embedding is always the main procedure and textual descriptions must interact with triples for better embedding.” 前两篇工作都是将entity vector和text vector 通过某种计算方式直接结合为最终的embedding。而本文则是将更侧重于更强的交互形式,如图2所示,通过将triple的embedding映射到一个语义超平面上,因此embedding的拓扑结构与语义是更贴合的。

- 更重要的一点是该项工作的计算复杂度贴近于TransE

2. Methodology

1). Loss Function

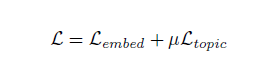

此模型的loss函数分为两部分,前半部分与Trans系列的loss大体相似,不同点在于distance的计算,此处

f

r

f_r

fr函数为score而不是distance,因此是(正例的score-负例score)小于一定阈值时,该值越低loss越大。第二部分为topic-specific,用于训练更新每个entity的semantic vector(此vector会用于

f

r

f_r

fr的计算中,用于将三元组投射到一个semantic 超平面)。semantic vector由预训练的topic模型NMF来初始化。本文在实验部分比较了更新semantic vector和固定这些vector对于模型的影响,分别记为Std.和Joint. 当μ = 0时,即为Std.

该loss为hinge loss,通常被用于最大间隔算法(maximum-margin)。loss

[

x

]

+

[x]_+

[x]+ 表示max{0,x},

γ

γ

γ是margin超参数。

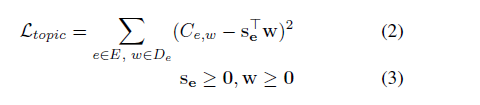

E

E

E为实体集合,

D

e

D_e

De 为实体

e

e

e的description的word集合。

C

e

,

w

C_{e,w}

Ce,w 为

w

w

w 在

e

e

e的description中出现的次数,

s

e

s_e

se为实体

e

e

e的semantic vector, w为词

w

w

w的话题分布(topic distribution)。在优化的过程中也是使用随机梯度下降。

2). Score Function

本文的Score function定义如下:

其中

e

=

h

+

r

−

t

e = h+r-t

e=h+r−t ,

∣

∣

x

∣

∣

2

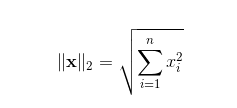

|| x||_2

∣∣x∣∣2 为向量x的l2范数。其中s为上面图2中的semantic 超平面的法向量,

S

T

e

S^Te

STe为e在法向量s上投影的长度,再乘以s即为e在s上的投影, e再减去该投影向量即为e再semantic 超平面上的投影。

这里的定义前半部分我可以理解,计算的是 h+r-t投射到semantic超平面上的距离,取负 转换为score,后半部分为什么是+而不是-,让我很困惑。

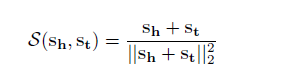

上面的

s

=

S

(

s

h

,

s

t

)

s = S(s_h, s_t)

s=S(sh,st)用于构造语义超平面,定义如下:

其中

s

h

,

s

t

s_h, s_t

sh,st 为头实体和尾实体对应的semantic vector。

3. Experiments

1). Dataset

- FB15K and FB20K,和DKRL[2]工作的数据集一致

- WN18, The textual information of WN18 is the definitions that we extract from the Wordnet.

2). Task

Knowledge Graph Completion

-

评测方案: 通过计算候选三元组的fr score值,得到一个ranking列表。计算原三元组的mean rank 和HIT(rank值不大于10的比例)来进行评测。

-

评测结果

Entity Classification

- 评测方案: 使用embedding vector和semantic vector的拼接向量 (s_e,e) 作为分类的输入特征。

- 评测结果:

587

587

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?