笔者正处于学习阶段,任何问题欢迎指正。

0. 前言

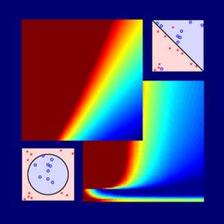

机器学习通过样本输出维度,输入维度,学习方法等可以分成许多类别,这篇文章主要屡一下这些关系,首先看一下我做的思维导图,下面我会对每一种类别进行介绍。

1. 根据输出空间分类

输出空间 Y 是分类器通过输入特征得出的结果,根据输出空间机器学习可以分为四类。

- 二分类问题:

Y∈{1,2} 。如判断一个人是否生病- 多分类问题: Y∈{1,2,⋯,k} ,当 k=2 时就是二分类问题。如判断细胞是哪种癌细胞。

- 回归: Y=[lower,upper]⊂R 。如判断病人需要多久出院。

- 结构学习(structure learning ): Y=structures 。如通过一个句子预测句子的结果(如主谓宾等等)。结果学习对于机器学习是最有挑战的。

2. 根据样本标签分类

对于给定的样本,我们可以根据是否知道样本标签来进行分类。

- 监督学习:知道给定样本的标签,如线性回归,决策树等。(Know all yn )

- 无监督学习:不知道样本的标签,如聚类,密度分析等。(Know no yn )

- 半监督学习:部分样本具有标签,如在药物判断时得到样本的标签往往代价很大,我们只知道部分样本的标签来预测药物有效性。(Know some yn )

- 强化学习:没有样本标签,但是知道一些额外信息。如训练狗时,当人类叫狗坐下,狗会做一个动作但是狗并不知道这个动作对不对,但是人类可以给狗一个反馈信息(如做对了给奖赏做错了给惩罚)不断纠正狗的行为。(不知道 yn 但有额外信息)

3. 根据学习方法分类

分类器处理样本数据的方式也可分为三种形式。

- 批学习(batch learning):一次性使用所有样本进行学习,也被形象的称为填鸭式学习。

- 线上学习(online learning):每次只观测一个样本,并根据预测结果的准确性修正分类器,如PLA,强化学习都是线上学习。

- 主动学习(active learning):机器具有自己提问的能力,通过提问来修正分类器。

4. 根据输入空间分类

样本的输入空间即样本的输入特征,可以对特征的类别进行分类。

- 具体特征(Concrete Feature):一些具体的统计量,如样本是手写数字时,输入空间为黑色区域的对称性,密度等。

- 原始特征(Raw Feature):就是样本的原有特征,如样本是手写数字时,输入空间就是数组的二维矩阵。

- 抽象特征(Abstract Feature):一些难以描述的特征…比如预测一首歌的分数时,输入为歌曲的编号,需要自己提取特征,这通常对机器的负担会比较大。

7772

7772

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?