摘要

世界上许多文化都相信看手相可以用来预测一个人未来的生活。手相学使用的是手的特征,比如手掌的纹路,手的形状,或者指尖的位置。然而,目前对掌纹检测的研究还比较少,很多人采用了传统的图像处理技术。在大多数真实场景中,图像通常不是很好,导致这些方法的性能严重不足。本文提出了一种从人的手掌图像中提取主要掌纹的算法。作者的方法应用深度学习网络(DNNs)来提高性能。这个问题的另一个挑战是缺乏训练数据。为了处理这个问题,作者从头手工制作了一个数据集。从这个数据集,作者比较了现成的方法和作者的方法的性能。此外,基于UNet分割神经网络结构和注意机制知识,作者提出了一种高效的手掌纹检测结构。作者提出了上下文融合模块来捕捉最重要的上下文特征,目的是提高分割精度。实验结果表明,该方法的F1得分最高,约为99.42%,在同一数据集上mIoU为0.584,优于其他方法。

论文创新点

综上所述,作者的主要贡献总结如下:

-

提出利用DNN来解决掌纹检测问题。作者使用深度学习和图像处理技术,而不是像之前的其他论文中那样纯粹的传统图像处理。

-

为这个问题提供高质量的数据集。该数据集由该领域的专业人士仔细注释。

-

提出了作者的模型与上下文融合模块,即使在复杂的掌纹图像也能实现较高的精度。通过这种方法,作者在mIoU评分方面取得了不错的成绩。

框架结构

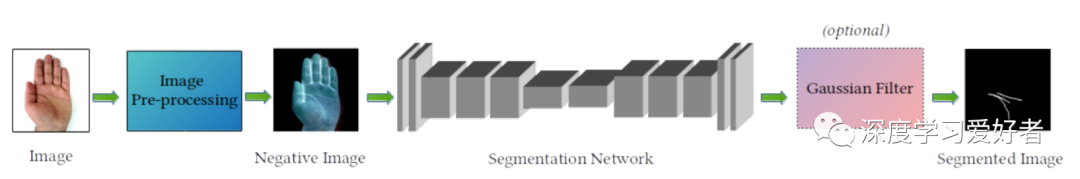

作者的图像分割系统的架构

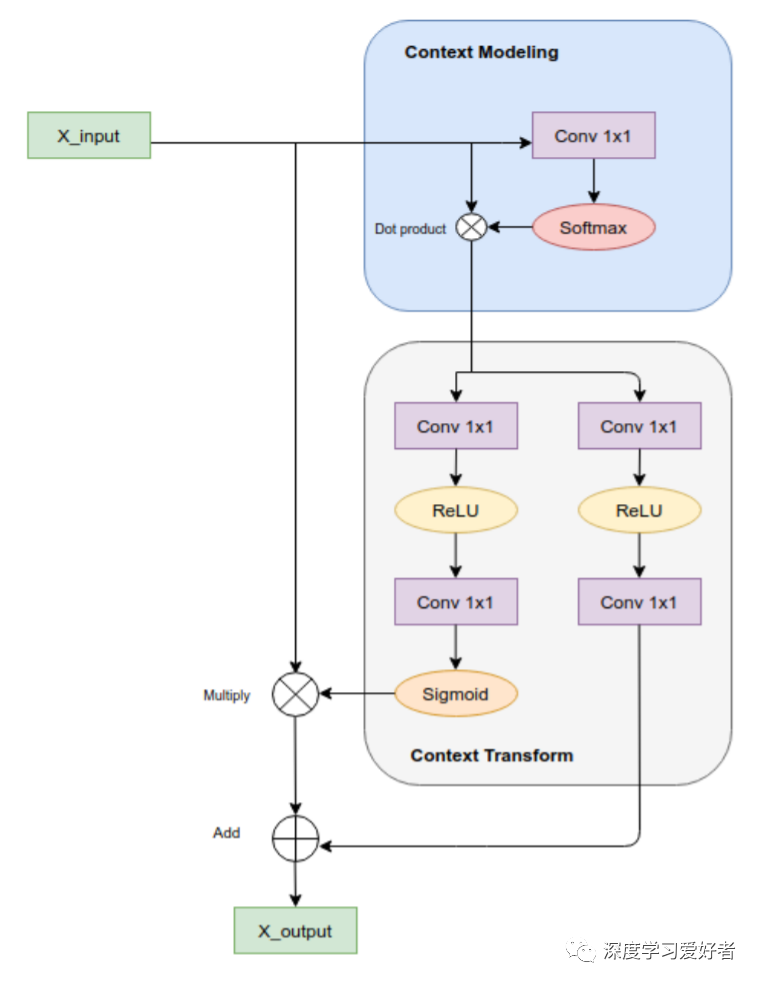

融合局部和全局上下文特征的上下文融合模块

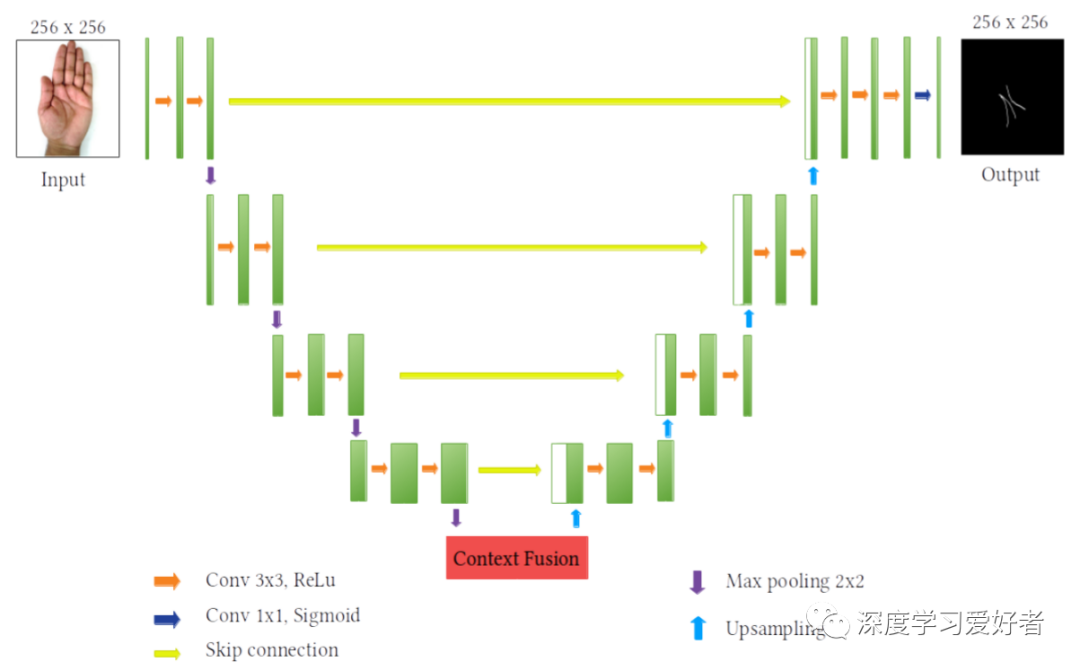

U-Net带有上下文融合模块

实验结果

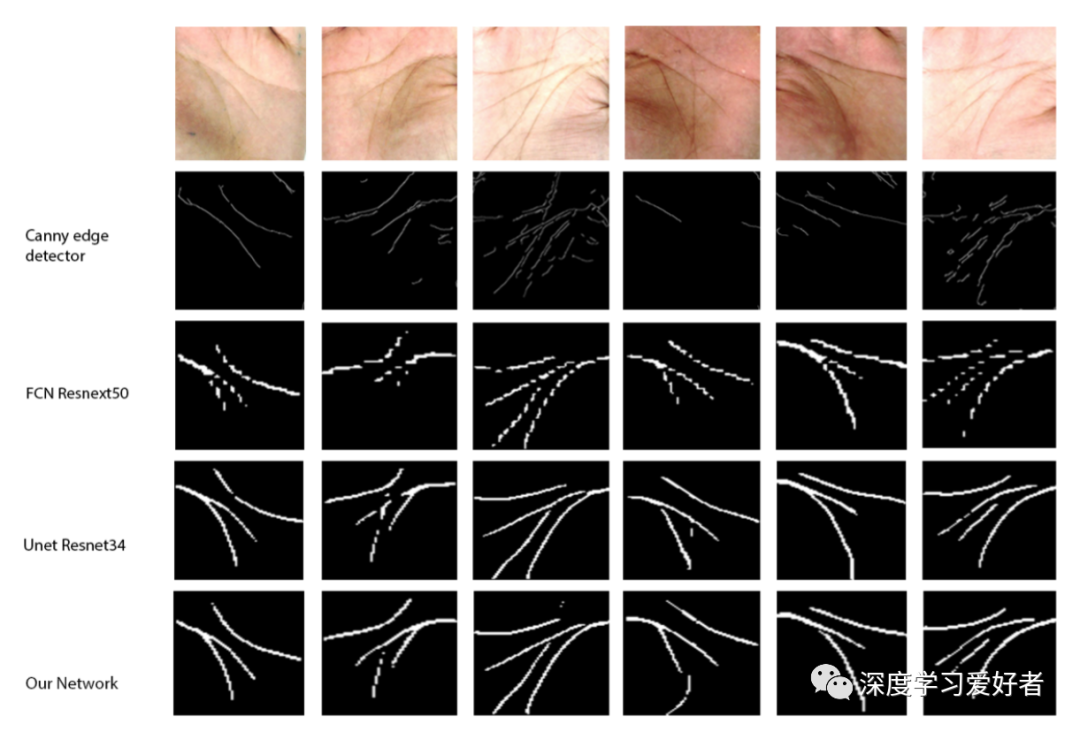

一些模型的输出图像应用于此问题。作者的网络(Unet-CFM)在复杂的掌纹输入中取得了较好的效果。

结论

结论

在本文中,作者应用深度学习技术建立神经网络来解决掌纹分割问题。在作者的数据集上,作者模型的最终mIoU为0.584,F1得分为99.42%。该数据集是人工收集的,将为科学目的公开发布。实验结果表明,该方法在掌纹图像分割任务中比传统的图像处理具有巨大的优势。本研究的未来工作将是研究一种更稳健的方法来处理复杂背景图像的变化;此外,还可以使用CFM的其他功能进行进一步的调查。

论文链接:https://arxiv.org/pdf/2102.12127.pdf

本文提出了一种结合深度学习与上下文融合模块的高效手掌纹分割算法。利用U-Net结构并引入新的上下文融合模块,即使在复杂的图像条件下也能实现高精度分割。实验显示,该方法在F1得分和mIoU指标上表现出色,优于传统图像处理技术。

本文提出了一种结合深度学习与上下文融合模块的高效手掌纹分割算法。利用U-Net结构并引入新的上下文融合模块,即使在复杂的图像条件下也能实现高精度分割。实验显示,该方法在F1得分和mIoU指标上表现出色,优于传统图像处理技术。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?