苦战了18个小时,终于祭出了一片记叙文!

在这里我只想说:在本机装虚拟机搞hadoop跟在云服务器上真的不一样。。。

开始:

Ps: 在看这里的时候,你的java环境应该已经配置了

1.系统环境配置

1.1 下载hadoop,我这里使用3.x版本

下载hadoop地址地址:http://mirror.bit.edu.cn/apache/hadoop/common/

1.2 先关闭防火墙

systemctl stop firewalld.service #停止防火墙

(仅供参考)centos7的方式:

systemctl stop firewalld.service #停止防火墙

systemctl start firewalld.service #开启防火墙

systemctl status firewalld.service #查看防火墙状态

systemctl enable firewalld.service #开机自启 “启用”

systemctl disable firewalld.service #开机自启 “禁用”

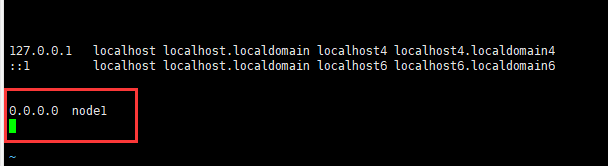

1.3配置系统文件的host

网上几乎所有的文章都没说这个,哎,踩了好久

1.3.1进入host文件

vim /etc/hosts

1.3.2修改添加配置(node1是接下来要用的)

0.0.0.0 node1

2.配置hadoop

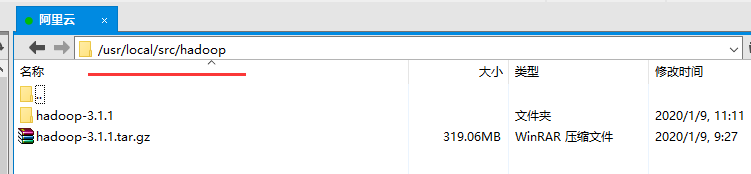

2.1 解压

我把hadoop放到了 /usr/local/src/hadoop 目录下

tar xzvf hadoop-3.1.1.tar.gz

2.2 修改hadoop配置文件

进入hadoop-3.1.1/etc/hadoop中

cd /usr/local/src/hadoop/hadoop-3.1.1/etc/hadoop

2.3修改core-site.xml(写入到configuration标签中)

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://node1:8020</value>

</property>

<!-- 临时文件存储目录 根据自己的目录调整 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/src/hadoop/hadoop-3.1.1/datas/tmp</value>

</property>

<!-- 缓冲区大小,实际工作中根据服务器性能动态调整 -->

<property>

<name>io.file.buffer.size</name>

<value>8192</value>

</property>

<!-- 开启hdfs的垃圾桶机制,删除掉的数据可以从垃圾桶中回收,单位分钟 -->

<property>

<name>fs.trash.interval</name>

<value>10080</value>

</property>

</configuration>

2.4修改 hadoop-env.sh 文件

在文件头部加上以下内容(注意替换java的环境目录)

export HDFS_NAMENODE_USER="root"

export HDFS_DATANODE_USER="root"

export HDFS_SECONDARYNAMENODE_USER="root"

export YARN_RESOURCEMANAGER_USER="root"

export YARN_NODEMANAGER_USER="root"

export JAVA_HOME=/usr/local/src/java/jdk1.8.0_141

如图:

2.5修改hdfs-site.xml(写入到configuration标签中)

注意:修改为自己的文件的存储路径

<configuration>

<!--namenode元数据存放目录-->

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/namenode/namenodedatas</value>

</property>

<!--设置文件的块大小-->

<property>

<name>dfs.blocksize</name>

<value>134217728</value>

</property>

<property>

<name>dfs.namenode.handler.count</name>

<value>10</value>

</property>

<!--datanode数据存放目录-->

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/datanode/datanodeDatas</value>

</property>

<!--通过浏览器访问hdfs的端口-->

<property>

<name>dfs.namenode.http-address</name>

<value>node1:50070</value>

</property>

<!--设置文件的副本数-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<!--设置hdfs的权限访问-->

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

<property>

<name>dfs.namenode.checkpoint.edits.dir</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/nn/snn/edits</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node1:50090</value>

</property>

<!--日志文件的存放路径-->

<property>

<name>dfs.namenode.edits.dir</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/nn/edits</value>

</property>

<property>

<name>dfs.namenode.checkpoint.dir</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/snn/name</value>

</property>

</configuration>

2.6修改mapred-site.xml(写入到configuration标签中)

注意:修改为自己的文件的存储路径

<configuration>

<!--指定框架-->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.map.memory.mb</name>

<value>1024</value>

</property>

<property>

<name>mapreduce.map.java.opts</name>

<value>-Xmx512M</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name>

<value>1024</value>

</property>

<property>

<name>mapreduce.reduce.java.opts</name>

<value>-Xmx512M</value>

</property>

<property>

<name>mapreduce.task.io.sort.mb</name>

<value>256</value>

</property>

<property>

<name>mapreduce.task.io.sort.factor</name>

<value>100</value>

</property>

<property>

<name>mapreduce.reduce.shuffle.parallelcopies</name>

<value>25</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>node1:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>node1:19888</value>

</property>

<property>

<name>mapreduce.jobhistory.intermediate-done-dir</name>

<value>/usr/local/src/hadoop/hadoop-3.1.1/datas/jobhsitory/intermediateDoneDatas</value>

</property>

<property>

<name>mapreduce.jobhistory.done-dir</name>

<value>/usr/local/src/hadoop/hadoop-3.1.1/datas/jobhsitory/DoneDatas</value>

</property>

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/src/hadoop/hadoop-3.1.1</value>

</property>

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/src/hadoop/hadoop-3.1.1/</value>

</property>

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/src/hadoop/hadoop-3.1.1</value>

</property>

</configuration>

2.7yarn-site.xml(写入到configuration标签中)

注意:修改为自己的文件的存储路径

<configuration>

<property>

<name>dfs.namenode.handler.count</name>

<value>100</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>node1:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>node1:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>node1:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>node1:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>node1:8088</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>node1</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

<!-- 设置不检查虚拟内存的值,不然内存不够会报错 -->

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>1024</value>

</property>

<property>

<name>yarn.nodemanager.resource.detect-hardware-capabilities</name>

<value>true</value>

</property>

<property>

<name>yarn.nodemanager.local-dirs</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/nodemanager/nodemanagerDatas</value>

</property>

<property>

<name>yarn.nodemanager.log-dirs</name>

<value>file:///usr/local/src/hadoop/hadoop-3.1.1/datas/nodemanager/nodemanagerLogs</value>

</property>

<property>

<name>yarn.nodemanager.log.retain-seconds</name>

<value>10800</value>

</property>

<property>

<name>yarn.nodemanager.remote-app-log-dir</name>

<value>/usr/local/src/hadoop/hadoop-3.1.1/datas/remoteAppLog/remoteAppLogs</value>

</property>

<property>

<name>yarn.nodemanager.remote-app-log-dir-suffix</name>

<value>logs</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>18144000</value>

</property>

<property>

<name>yarn.log-aggregation.retain-check-interval-seconds</name>

<value>86400</value>

</property>

<!-- yarn上面运行一个任务,最少需要1.5G内存,虚拟机没有这么大的内存就调小这个值,不然会报错 -->

<property>

<name>yarn.app.mapreduce.am.resource.mb</name>

<value>800</value>

</property>

</configuration>

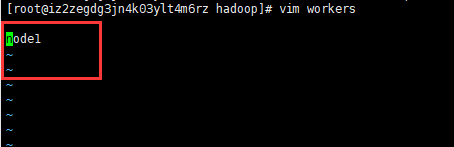

2.8worker文件

node1

2.9刚才在文件中设置很多文件的存储,现在创建文件

直接复制执行就好了

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/tmp

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/nn/snn/edits

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/namenode/namenodedatas

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/datanode/datanodeDatas

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/nn/edits

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/dfs/snn/name

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/jobhsitory/intermediateDoneDatas

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/jobhsitory/DoneDatas

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/nodemanager/nodemanagerDatas

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/nodemanager/nodemanagerLogs

mkdir -p /usr/local/src/hadoop/hadoop-3.1.1/datas/remoteAppLog/remoteAppLogs

3.运行hadoop

3.1先配置ssh的免密登录

直接复制执行就行了

ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

chmod 0600 ~/.ssh/authorized_keys

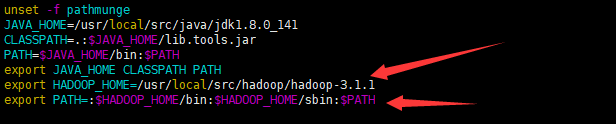

3.2配置环境变量

3.2.1进入目录

vi /etc/profile

3.2.2配置变量

export HADOOP_HOME=/usr/local/src/hadoop/hadoop-3.1.1

export PATH=:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

3.2.3 快速生效

source /etc/profile

3.3 格式化HDFS

为什么要格式化HDFS?

HDFS需要一个格式化的过程来创建存放元数据(image, editlog)的目录

cd /usr/local/src/hadoop/hadoop-3.1.1 //进入目录

bin/hdfs namenode -format //执行格式化命令

Ps:执行格式化中间让你输入 Y/N 全部输入Y,注意大写

3.4 启动

cd /usr/local/src/hadoop/hadoop-3.1.1 //进入目录

sbin/start-all.sh //启动命令

拓展:

sbin/start-all.sh 启动所有的Hadoop守护进程。包括NameNode、 Secondary NameNode、DataNode、ResourceManager、NodeManager

sbin/stop-all.sh 停止所有的Hadoop守护进程。包括NameNode、 Secondary NameNode、DataNode、ResourceManager、NodeManage

进入浏览器输入:

服务器的ip:50070

服务器的ip:8088即可查看

疑难杂症总结

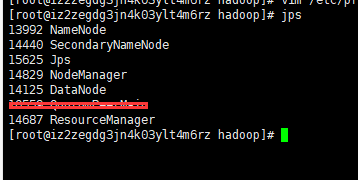

1.判断进程是否开启

jps

自己判断缺了那个,如果是按照上面流程执行的话,请检查配置路径是否正确,其他自行百度

2.判断端口有没有开

netstat -ntlp

判断端口有没有开放,端口的后缀是不是0.0.0.0的原因总结

1.上文中讲的host映射配置错误

2.端口没有开放

3.阿里服务器的端口没有设置出入站规则

4.防火墙有没有关

3.多次格式化HDFS?

每次格式化的时候清空 hdfs文件存储的目录:如果按照上文的配置,请看图

清空这个目录下的文件,然后重新格式化

8087

8087

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?