卷积神经网络基础知识点总结

最新推荐文章于 2022-07-08 10:29:37 发布

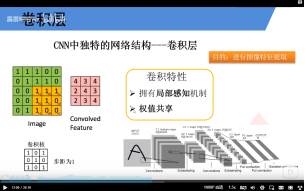

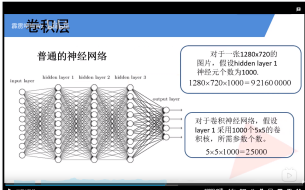

本文总结了卷积神经网络的基础知识,包括卷积层的局部感知和权值共享特性,激活函数如ReLU的使用注意事项,以及池化层的作用。在反向传播中讨论了误差计算和权重更新,指出在训练过程中可能遇到的问题如样本噪声和局部最优解,并介绍了SGD、Momentum和RMSProp等优化器来改进学习过程。

本文总结了卷积神经网络的基础知识,包括卷积层的局部感知和权值共享特性,激活函数如ReLU的使用注意事项,以及池化层的作用。在反向传播中讨论了误差计算和权重更新,指出在训练过程中可能遇到的问题如样本噪声和局部最优解,并介绍了SGD、Momentum和RMSProp等优化器来改进学习过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

11万+

11万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?