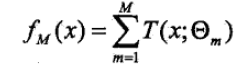

提升树实际采用加法模型(即基函数的线性组合)与前向分步算法,以决策树为基函数的提升方法(提升树,boosting tree)。对于分类问题决策树是二叉分类树,对于回归问题决策树是二叉回归树。提升树模型可以表示为决策树的加法模型:

GBDT(梯度提升树)是集成学习Boosting家族的一员,但是却和传统的Adaboost有很大的不同。GBDT中的树是回归树(不是分类树),GBDT用来做回归预测,调整后也可以用于分类。

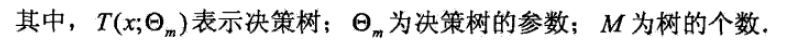

1. 前向分步算法

2. 负梯度拟合

总结起来,GBDT 回归算法如下:

3. 损失函数

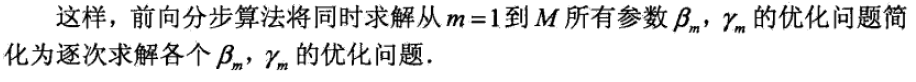

对于分类算法,GBDT的损失函数一般有对数损失函数和指数损失函数两种:

-

指数损失函数的表达式为:

-

对数损失函数,分为二元分类和多元分类两种

对于回归算法,GBDT常用损失函数有如下4种::

4. 回归二分类,多分类

GBDT中的树是回归树(不是分类树),GBDT用来做回归预测,调整后也可以用于分类。

5. 正则化

6. 优缺点

7.sklearn参数应用场景

8. 参考链接

https://www.cnblogs.com/pinard/p/6140514.html

https://www.cnblogs.com/ModifyRong/p/7744987.html

李航的统计学习方法

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?