这篇文章是做image caption的,模型的创新点在于引入“hard”attention和“soft”attention对视觉区域进行不同的注意。模型结构跟【多模态】《Visual7W: Grounded Question Answering in Images》论文阅读笔记相似,区别在于对注意力机制的设置上。

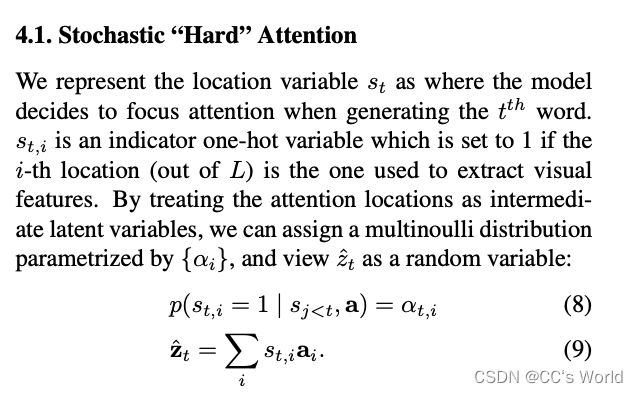

“hard” attention:

s

t

s_t

st代表模型在生成第 t 个词时focus的位置变量, 当第 i 个location(总共L个)用来作为视觉特征时,

s

t

,

i

=

1

s_{t,i}=1

st,i=1,否则为0

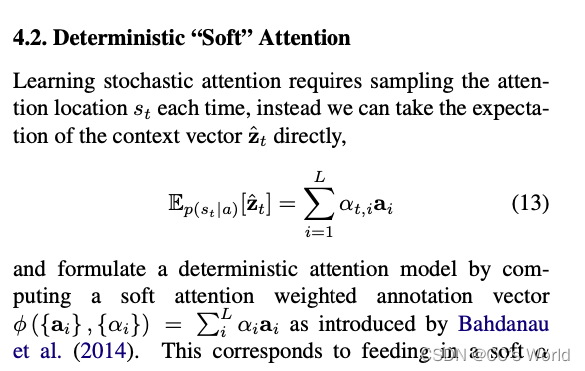

“soft” attention:

484

484

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?