如何快速地将MongoDB中的数据导入Hive

最近我们有些MongoDB业务库的数据需要导入至Hive中,以前我是用的Kettle进行离线抽取GreenPlum,但是现在我们的数仓整体迁至Hive+Impala,导致使用kettle无法使用,使用sparkSQL又有点麻烦,需要部署jar之类的,由于我们之前就使用过WaterDrop工具将GP[GreenPlum4]中的数据导入CK[ClickHouse],然后我们就看下WaterDrop的官方文档,也支持 MongoDB数据的读取和 Hdfs文件的写入,这样的话我们就可以写成一个shell脚本,通过sparkSQL来操控ETL过程

准备环境

WaterDrop:1.x #毕竟1.x比较稳定,2.x虽然是支持Flink,但是功能点比较少

MongoDB:* #版本不介绍了,毕竟咱也不知道,能查出数就行

Hdfs:3.* #CDH6.1版本的

Hive:2.* #CDH6.1版本的

hive表已经创建完成,并且是以 , 号分割开来的

waterdrop服务器安装hdfs、hive客户端

编写脚本-WaterDrop.conf

vim MongoDBToTasksHive.conf

spark {

spark.app.name = "MongoDB70tasksToHive" #Spark运行job名称

spark.ui.port = 13000 #Spark端口号

}

input{

mongodb {

#mongodb://username:password@localhost:port/databases

readconfig.uri="mongodb://username:password@mongodb_localhost:port/databases" #MongoDB链接地址

readconfig.database="qez" #等同于关系型数据databases

readconfig.collection="tasks" #等同于关系型数据table

readconfig.password="qez123" #MongoDB数据库密码(我知道上面已经配置了,但是在这里不配置的话,会报错,这是我们走过的坑,重点记一下)

readconfig.spark.mongodb.input.partitioner = "MongoPaginateBySizePartitioner" #用于对数据进行分区的分区程序的类名(其实我也不是很明白)

#spark.mongodb.input.partitioner:用于对数据进行分区的分区程序的类名

#默认使用:MongoDefaultPartitioner,其他值有:

#MongoSamplePartitioner:使用集合的平均文档大小和随机抽样来确定集合的合适分区。

#MongoShardedPartitioner:根据数据块对集合进行分区。需要对config数据库的读访问权限。

#MongoSplitVectorPartitioner:使用splitVector独立命令或主数据库上的命令来确定数据库的分区。需要特权才能运行splitVector命令

#MongoPaginateByCountPartitioner:创建特定数量的分区。需要查询每个分区。

#MongoPaginateBySizePartitioner:根据数据大小创建分区。需要查询每个分区。

result_table_name = "tasks" #读取表的别名

}

}

filter{

sql{

#SparkSQL

sql="select shopId,regexp_replace(reason,'\\\\n|\\\\\t|\\\\\r|,|','') reason from tasks where createat >= date_sub(date_format(current_date,'yyyy-MM-dd'),30)"

}

}

output{

hdfs {

path = "hdfs://hdfs_localhost:port/tmp/hive/ods/tasks/data" #写入路径

serializer = "csv" #输出格式

}

# 测试打印

# stdout {

# limit = 1 #打印一行

# serializer = "json" #打印格式

# }

}

hdfs ==> hive

这里我们使用的hive -e load data inpath url into table databases_table;

vim MongoDb2Hive.sh

#!/bin/bash

#传入hive数据库层级名称 databases_name;

databases_name=$1

#传入hive数据库表 table_name

table_name=$2;

#databases_table_name

databases_table=$databases_name"."$table_name

#job_name ⇒ waterdrop.conf配置文件名称或者路径

job_name=$3;

echo $databases_name $table_name $job_name $databases_table

# mkdir file hdfs 在hdfs上创建存储上传文件路径

mkdirHdfsFile=`hdfs dfs -mkdir -p /tmp/hive/$databases_name/$table_name`

#echo $mkdirHdfsFile

# start waterdrop shell 调用刚才写好的waterdrop.conf文件 @WATERDROP_HOME为waterdrop 安装路径

@WATERDROP_HOME/bin/start-waterdrop.sh --master yarn --deploy-mode cluster --config @WATERDROP_HOME/jobs/$job_name

# 调用hive -e 清空hive目标表

truncate_table=`hive -e "truncate table ${databases_table} ;"`

echo $truncate_table

# start hive shell

#获取HDFS文件存放路径

outdir=/tmp/hive/$databases_name/$table_name/data/

files=`hdfs dfs -ls $outdir | awk -F " " '{print $8}'`

for name in $files

do

#截取文件名称

filename=`echo $name | awk -F '/' '{print $7}'`

if [ $filename != "_SUCCESS" ];then

echo $filename $name

#执行Hive -e load data 命令

hive -e "load data inpath '${name}' into table ${databases_table};"

fi

done

# 删除hdfs文件路径 rm hdfs hdfs

deleteHdfsFile=`hdfs dfs -rm -r -f /tmp/hive/$databases_name/$table_name`

echo $deleteHdfsFile

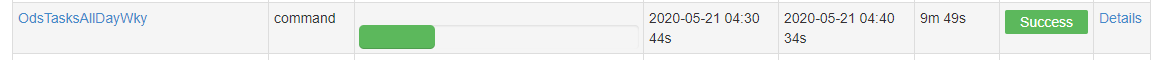

调用shell并加之Azkaban进行任务调度

#OdsTasksAllDayWky.job

type=command

command=sh @AZKABAN_HOME/jobs/MongoDb2Hive.sh ods tasks MongoDBToTasksHive.conf

dependencies=GreenPlumToHiveStart

1915

1915

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?