目录

传到Kafka之前需要先在Kafka创建符合题意的Kafka topic

前言

本题来源于2022 年全国职业院校技能大赛(高职组)“大数据技术与应用”赛项(电商)- 实时数据采集

题目:

提示:以下是本篇文章正文内容,下面案例可供参考()

一、读题分析

涉及组件:Maxwell

涉及知识点:

- Maxwell的基本使用

- MySQL日志存储的方式

二、处理过程

默认配置无需配置Maxwell,了解Maxwell

Maxwell是一个开源的MySQL数据变更捕获工具,可以将MySQL数据库的变更记录作为JSON格式的消息流发送到不同的消息队列系统(如Kafka)或写入文件。它使用MySQL的binlog机制获取变更并解析成易于使用的JSON消息。Maxwell的最大优点是实时推送信息,秒级别同步MySQL的变化,减少业务流执行延迟,同时帮助用户减少数据库的压力、减少MySQL数据库的锁,整体提高MySQL的性能。除此之外,Maxwell还能处理许多复杂的情况,包括DDL事件(表结构更改)和特殊情况(例如常见的UPDATE)等,通过配置和一些可定制性,可以灵活地适配不同的应用场景。对于需要在MySQL数据库中获取实时变更的应用,Maxwell提供了一个简单而灵活的解决方案。

传到Kafka之前需要先在Kafka创建符合题意的Kafka topic

bin/kafka-topics.sh --create --bootstrap-server bigdata1:9092 --replication-factor 1 --partitions 4 --topic ods_mall_data

--partitions 4创建分区数为4 --replication-factor 1 生成副本数量1

进入到Maxwell的目录

bin/maxwell --user='root' --password='123456' --host='bigdata1' --producer=kafka --kafka.bootstrap.servers=bigdata1:9092 --kafka_topic=ods_mall_data

--user 和 --password 指的是MySQL的用户名和密码

--host 监听的主机名

--producer 指定生产者,这里是Kafka

--kafka.bootstrap.servers 如果服务是在zookeeper,则改成zookeeper地址

--kafka_topic 上传到Kafka的指定主题

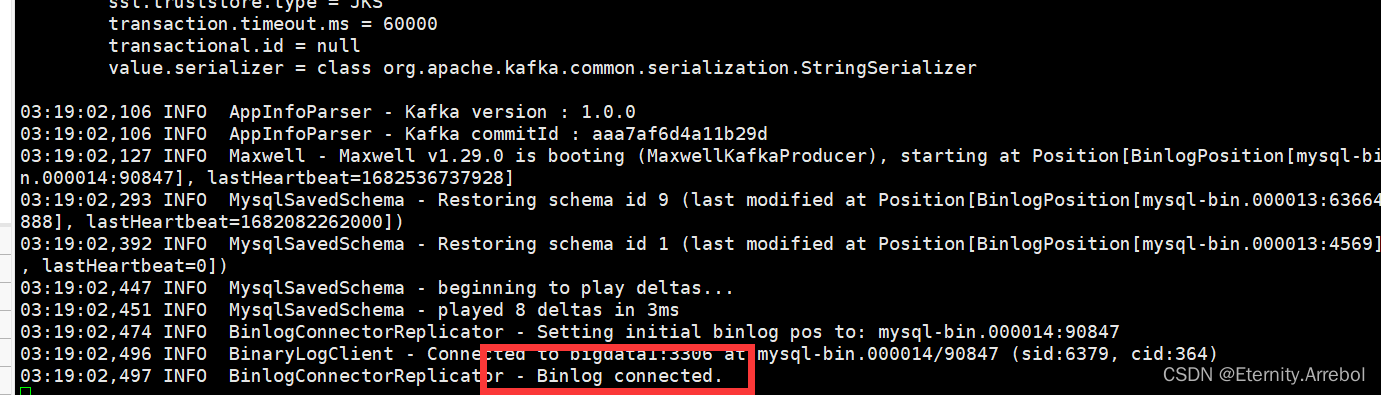

启动Maxwell,显示binlog连接成功就说明没问题

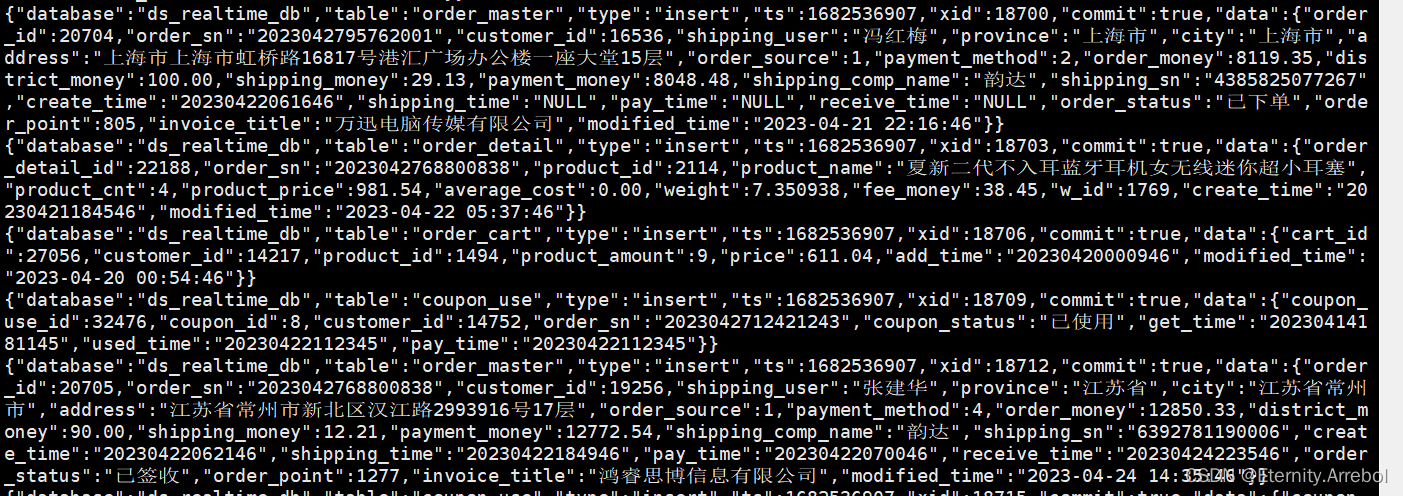

在Kafka消费topic,查看是否上传成功

三、重难点分析

没有难点,主要是Maxwell语句的配置,需要注意到Kafka的地址和连接问题

注意:Maxwell不能读取查询select的日志,只能对数据库和表的增删改进行记录,只记录改变了MySQL数据库结构的语句。

总结

没有可以总结的。

Maxwell是如何监控到数据的?以下来自网络:

Maxwell读取MySQL的binlog数据并将其转换为易于读取和处理的JSON格式。具体地,它通过连接到MySQL实例的MySQL Slave复制进程来读取binlog数据流,并解析每个事务的事件,生成一个包含当前事件的JSON对象,并将其输出到目标输出源(例如Kafka)。其具体工作流程如下: 1. 它连接到MySQL Database,并将Replication Client连接到MySQL Slave复制进程来获取binlog数据流。 2. 接收到变更数据后,它会把binlog数据反序列化并生成JSON格式的数据,并将其提交到输出源(例如Kafka)。 3. 它使用类似于CDC(Change Data Capture)的方式来监控数据库进行变更的情况,并捕获到变更后的数据情况。 4. 它使用一些内部机制来保证不漏掉任何变更,包括重试失败的事务等。 总之,通过读取MySQL的binlog数据流并将其转换为JSON格式,Maxwell可以及时捕获和处理MySQL数据库中的变更,使其易于读取和处理,并可输出到不同的输出源中。在大数据分析和数据同步场景中,这种机制可以大大简化数据的采集和处理,并实现实时的数据同步。

原创作品如需引用请标明出处

1722

1722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?