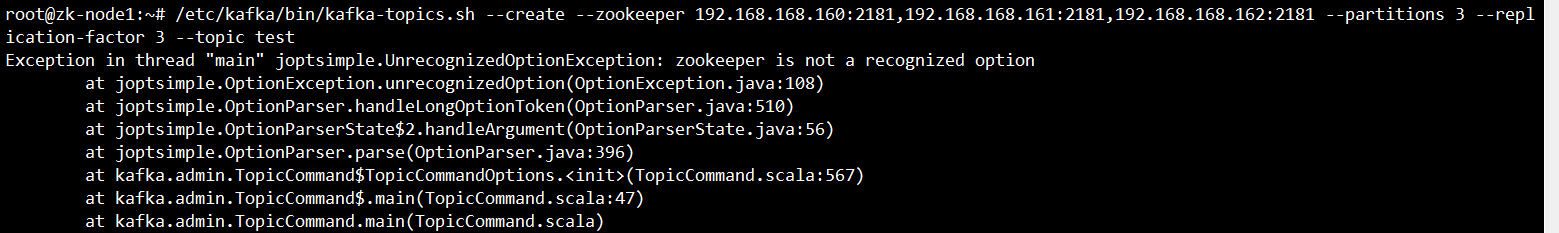

kafka创建topic报错解决思路之一

原创

于 2025-08-03 13:49:57 发布

·

373 阅读

2

·

2

·

·

4

4

·

4

4

2

·

2

·

CC 4.0 BY-SA版权

版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

4434

4434

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?