1. hue与HDFS集成

- 1)修改所有节点hadoop的core-site.xml配置文件,添加如下内容

<property>

<name>hadoop.proxyuser.hue.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.hue.groups</name>

<value>*</value>

</property>

-

2)修改hue.ini配置文件

fs_defaultfs=hdfs://ns

webhdfs_url=http://bigdata-pro01.kfk.com:50070/webhdfs/v1

hadoop_hdfs_home=/opt/modules/hadoop-2.5.0

hadoop_bin=/opt/modules/hadoop-2.5.0/bin

hadoop_conf_dir=/opt/modules/hadoop-2.5.0/etc/hadoop

hadoop_bin和hadoop_conf_dir需要自己定义

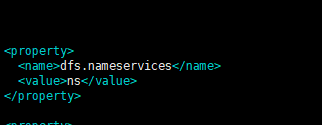

fs_defaultfs=hdfs://ns中的ns来源于hdfs-site.xml中的dfs.nameservice

-

3)重新启动hue

/opt/modules/hue-3.9.0-cdh5.5.0/build/env/bin/supervisor

2. hue与yarn集成

-

1)修改hue.ini配置文件

resourcemanager_host=rs

resourcemanager_port=8032

submit_to=true

resourcemanager_api_url=http://bigdata-pro01.kfk.com:8088

proxy_api_url=http://bigdata-pro01.kfk.com:8088

history_server_api_url=http://bigdata-pro01.kfk.com:19888

bigdata-pro01.kfk.com换成自己的主机名(没有做地址映射就换成ip)

-

2)重新启动hue

/opt/modules/hue-3.9.0-cdh5.5.0/build/env/bin/supervisor

3.Hue与Hive集成

-

1)修改hue.ini配置文件

hive_server_host=bigdata-pro03.kfk.com

hive_server_port=10000

hive_conf_dir=/opt/modules/hive-0.13.1-bin/conf -

2)重新启动hue

/opt/modules/hue-3.9.0-cdh5.5.0/build/env/bin/supervisor

4.Hue与mysql集成

-

1)修改hue.ini配置文件

nice_name=“My SQL DB”

name=metastore

engine=mysql

host=bigdata-pro01.kfk.com

port=3306

user=root

password=123456 -

2)重新启动hue

/opt/modules/hue-3.9.0-cdh5.5.0/build/env/bin/supervisor

5.Hue与HBase集成

-

1)修改hue.ini配置文件

hbase_clusters=(Cluster|bigdata-pro01.kfk.com:9090)

hbase_conf_dir=/opt/modules/hbase-0.98.6-cdh5.3.0/conf -

2)HBase中启动thrift服务

bin/hbase-daemon.sh start thrift

6.Hue使用注意事项

-

1)hive 启动使用后台启动

nohup bin/hiveserver2 &

355

355

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?