树模型

- 决策树:从根节点开始一步步走到叶子节点(决策)

- 所有的数据都会落到叶子节点,既可以做分类也可以做回归

如何切分特征(选择节点)

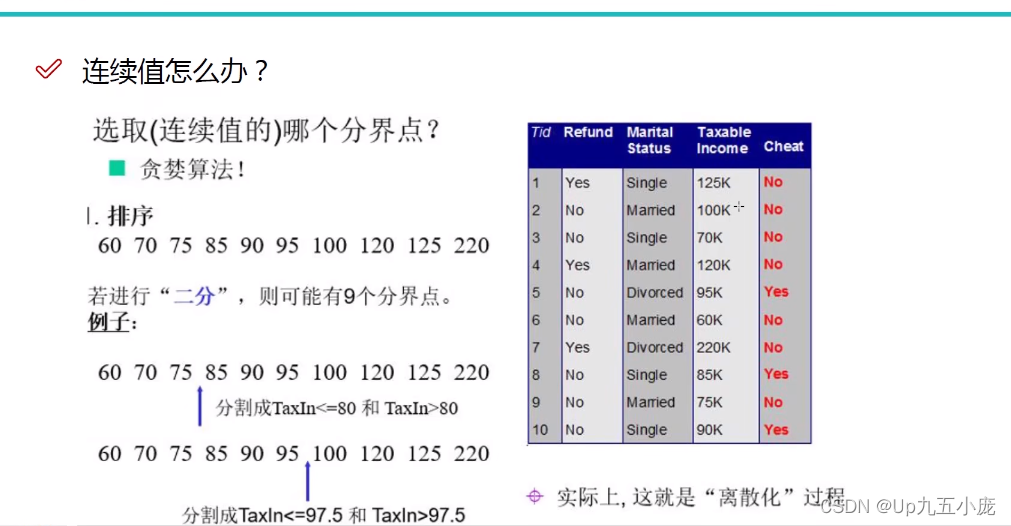

- 问题:根节点的选择该用那个特征?如何进行切分?

- 目标:通过一种衡量标准,来计算通过不同特征进行分支选择后的分类情况,找出来最好的那个当成根节点,以此类推。

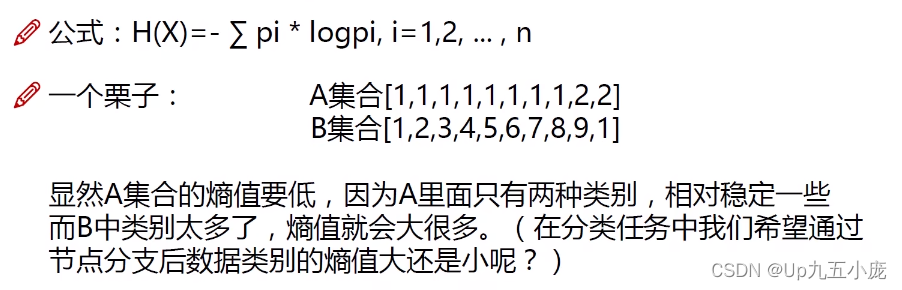

衡量标准-熵

- 熵:熵是随机变量不确定性的度量(解释:说白了就是物体内部的混乱程度,比如杂货市场里面什么都有,那肯定混乱,专卖店只卖一个牌子的那就稳定多了)

信息增益

-

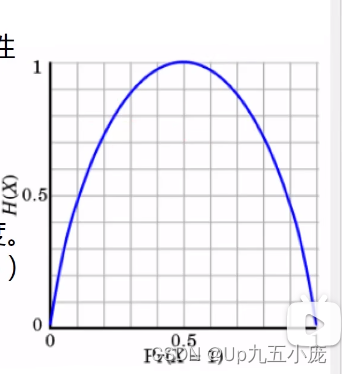

熵:不确定性越大,得到的熵值也就越大

当p=0或p=1时,H§=0,随机变量完全没有不确定性

当p=0.5时,H§=1,此时随机变量的不确定性最大 -

如何决策一个节点的选择呢?

-

信息增益:表示特征X使得类Y的不确定性减少的程度。(分类后的专一性,希望分类后的结果是同类在一起)

决策树构造实例

决策树剪枝策略

- 为什么要剪枝:决策树过拟合风险很大,理论上可以完全分得开数据(想象一下,如果树足够庞大,每个叶子节点不就一个数据了嘛)

- 剪枝策略:预剪枝,后剪枝

- 预剪枝:边建立决策树边进行剪枝的操作(更实用)

- 后剪枝:当建立完决策树后来进行剪枝操作

- 预剪枝:限制深度,叶子节点个数 叶子节点样本数,信息增益量等

- 后剪枝:通过一定的衡量标准

2592

2592

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?