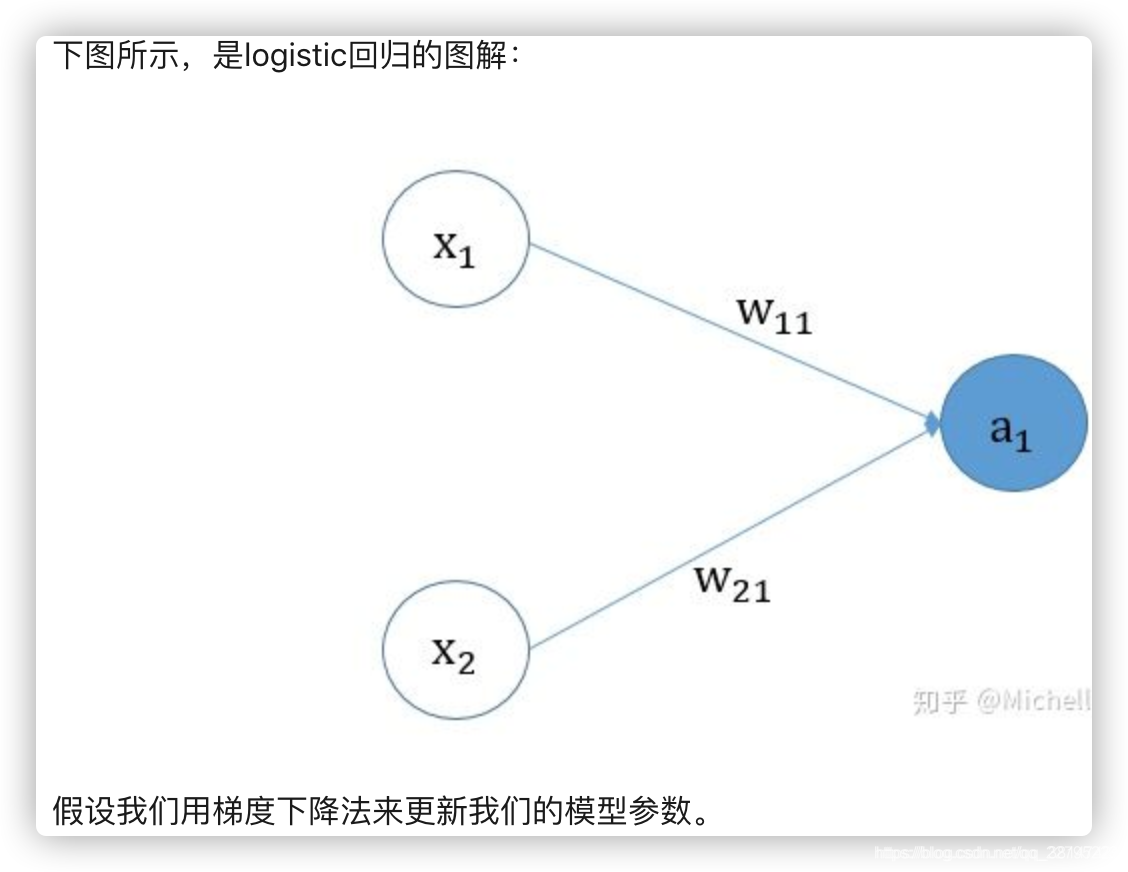

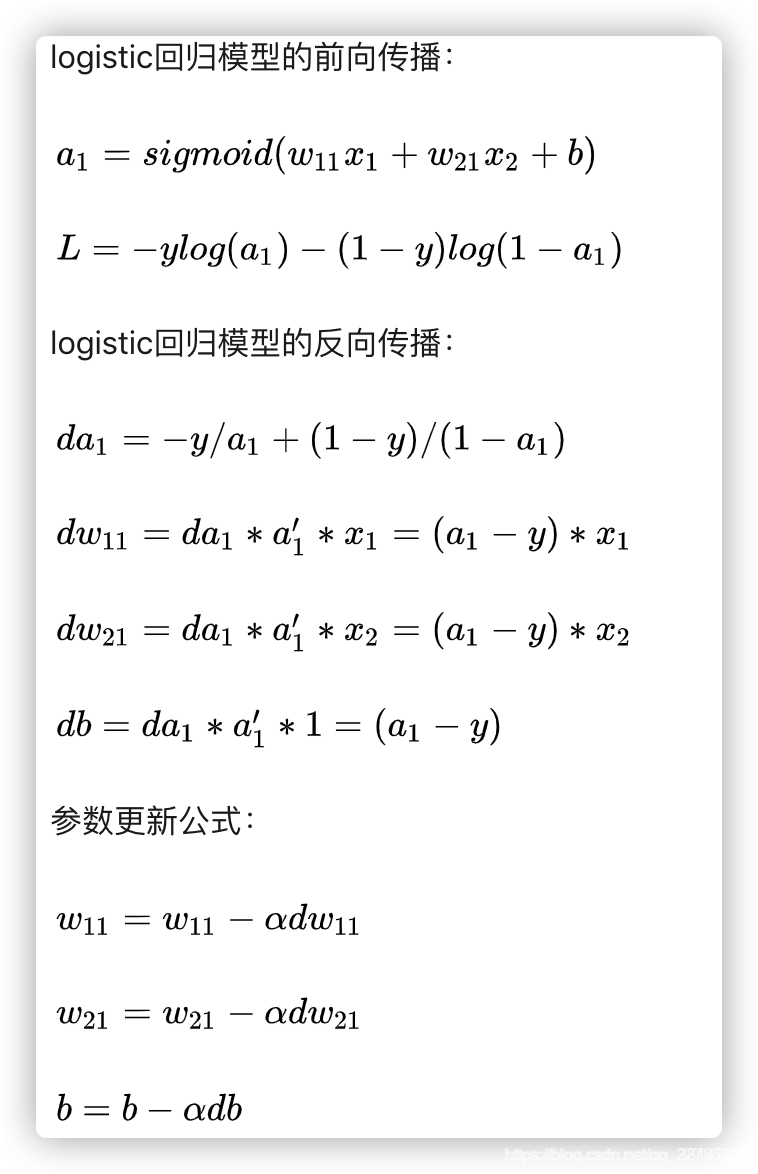

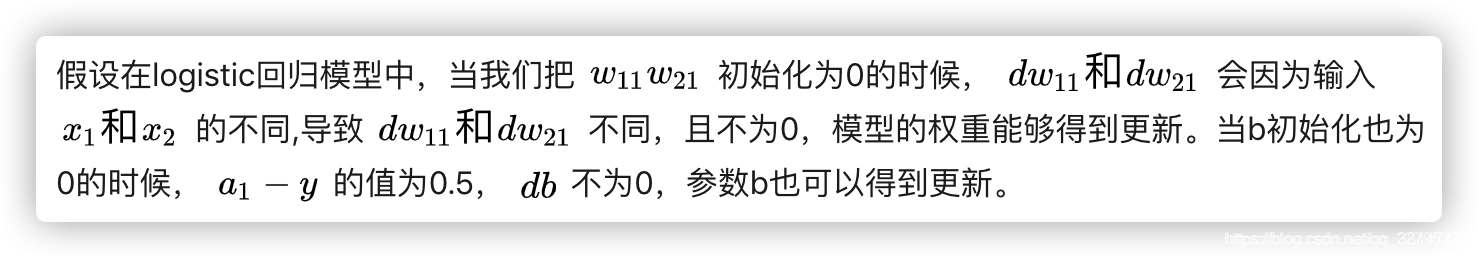

1、逻辑回归中,初始化权重全部为0,是ok的吗?

- 可以的。

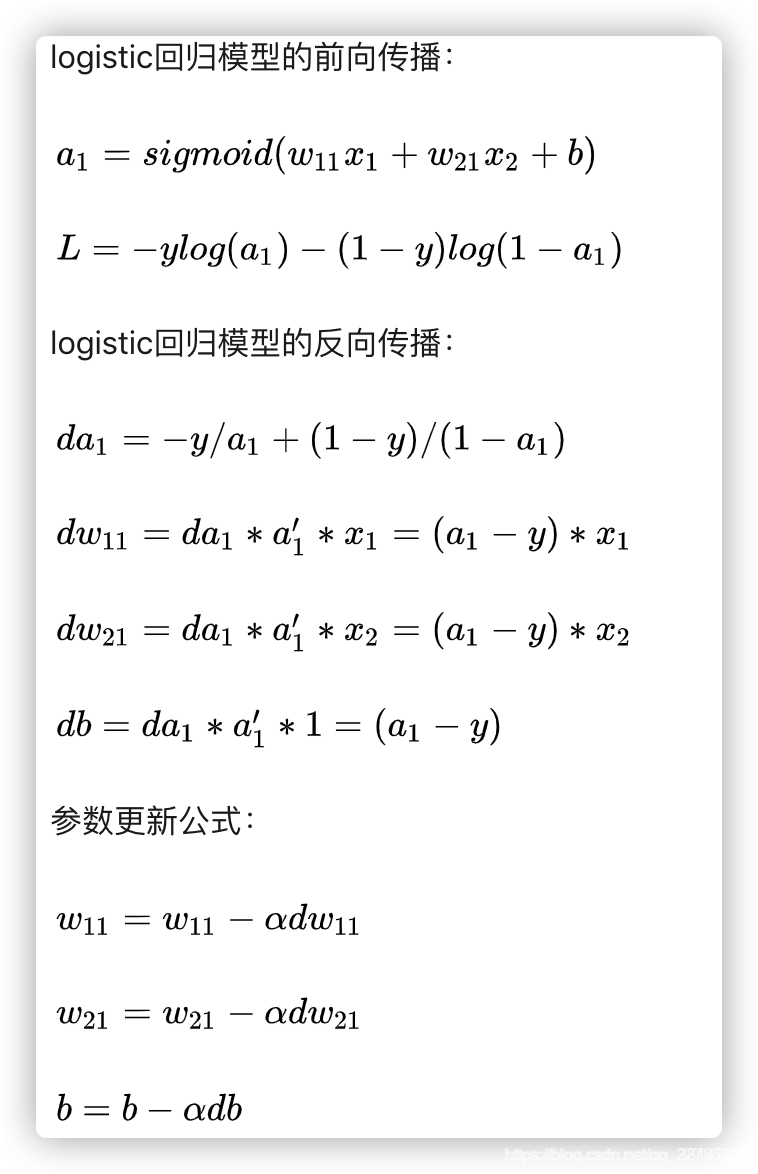

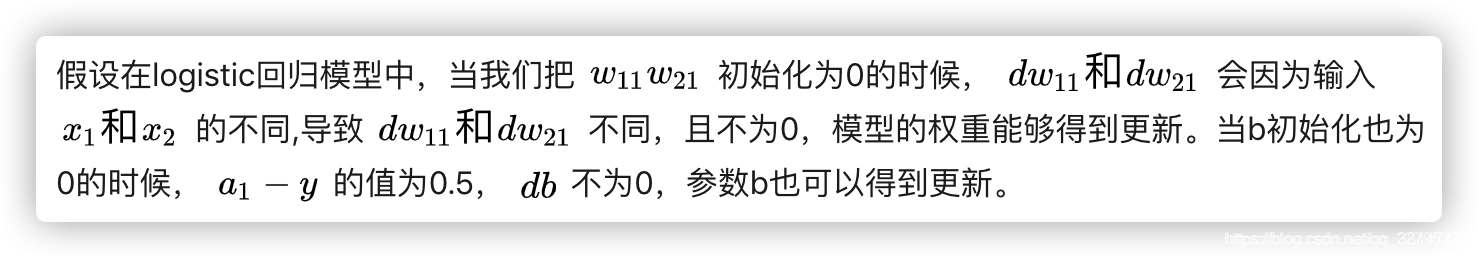

- 逻辑回归反向传播的时候,由于交叉熵损失函数以及sigmoid的配合,使得梯度求导后跟w和b参数本身没有关系,主要依赖于x。因此逻辑回归中权重初始化为0是ok的。

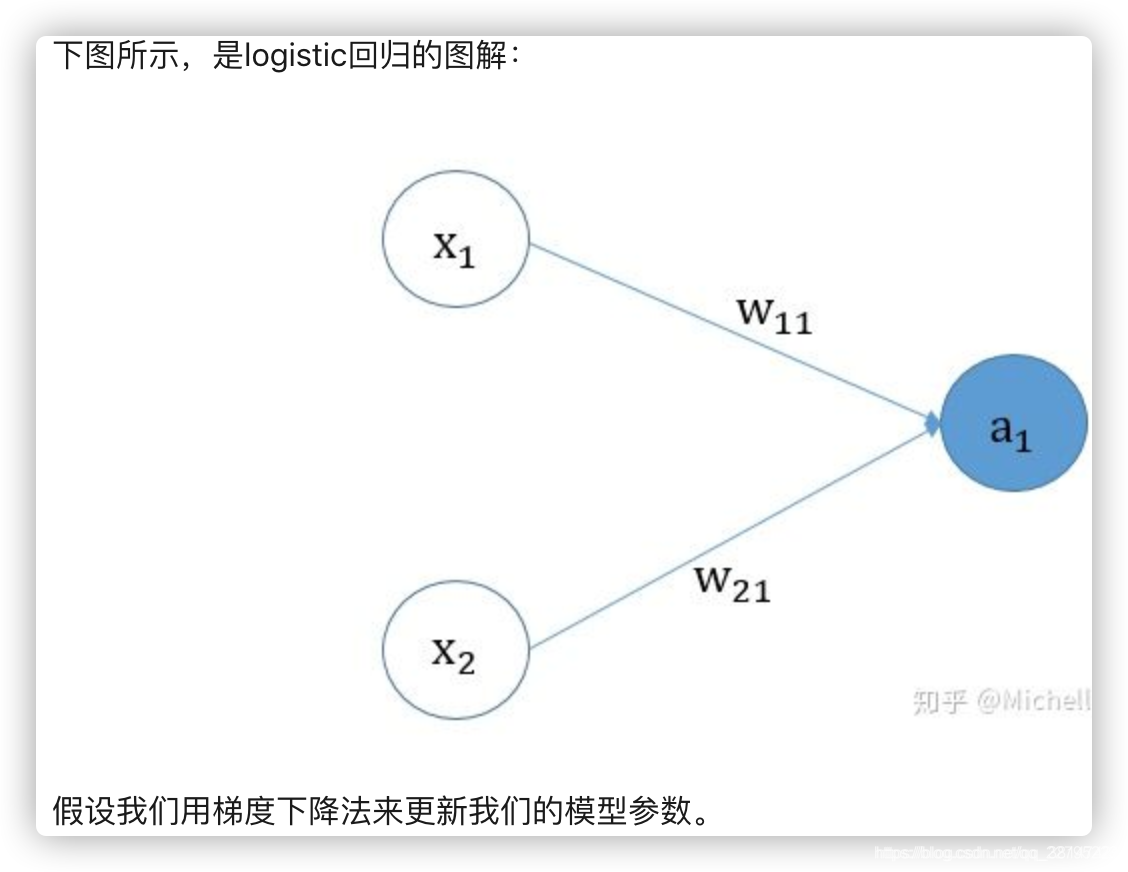

2、普通神经网络中权重初始化可以全部为0吗?

- 不可以。

- 总结一下:在神经网络中,如果将权值初始化为 0 ,或者其他统一的常量,会导致后面的激活单元具有相同的值,所有的单元相同意味着它们都在计算同一特征,网络变得跟只有一个隐含层节点一样,这使得神经网络失去了学习不同特征的能力!

1、逻辑回归中,初始化权重全部为0,是ok的吗?

2、普通神经网络中权重初始化可以全部为0吗?

3363

3363

3316

3316

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?