欠拟合、过拟合

欠拟合:

刚开始训练时是欠拟合,训练集loss大,验证集loss也大

解决:

① 增加输入特征项

② 增加网络参数

③ 减少正则化参数

过拟合:

拟合的太好,噪声也能拟合上,模型缺乏泛化,表现为训练集loss小,验证集loss大

解决:

① 数据清洗

② 增大训练集

③ 采用正则化

④ 增大正则化参数

正则化:

正则化在损失函数中引入模型复杂指标,即:给W加权值,弱化训练

loss = loss(y 与 y_) + REGULARIZER * loss(w)

正则化的选择:

L1正则化:

会使参数变为0,该方法可以通过稀疏参数,减少参数的数量,降低复杂度

【补充计算过程】

L2正则化:

会使参数接近0,不等于0,该方法可以通过减少参数数值,降低复杂度

【补充计算过程】

示例:

with tf.GradientTape() as tape:

h1 = tf.matmul(x_train, w1) + b1

h1 = tf.nn.relu(h1)

y = tf.matmul(h1,w2) + b2

loss_mse = tf.reduce_mean(tf.square(y_train-y))

loss_regularization = []

loss_regularization.append(tf.nn.l2_loss(w1))

loss_regularization.append(tf.nn.l2_loss(w2))

loss_regularization = tf.reduce_sum(loss_regularization)

losss = loss_mse + loss_regularization

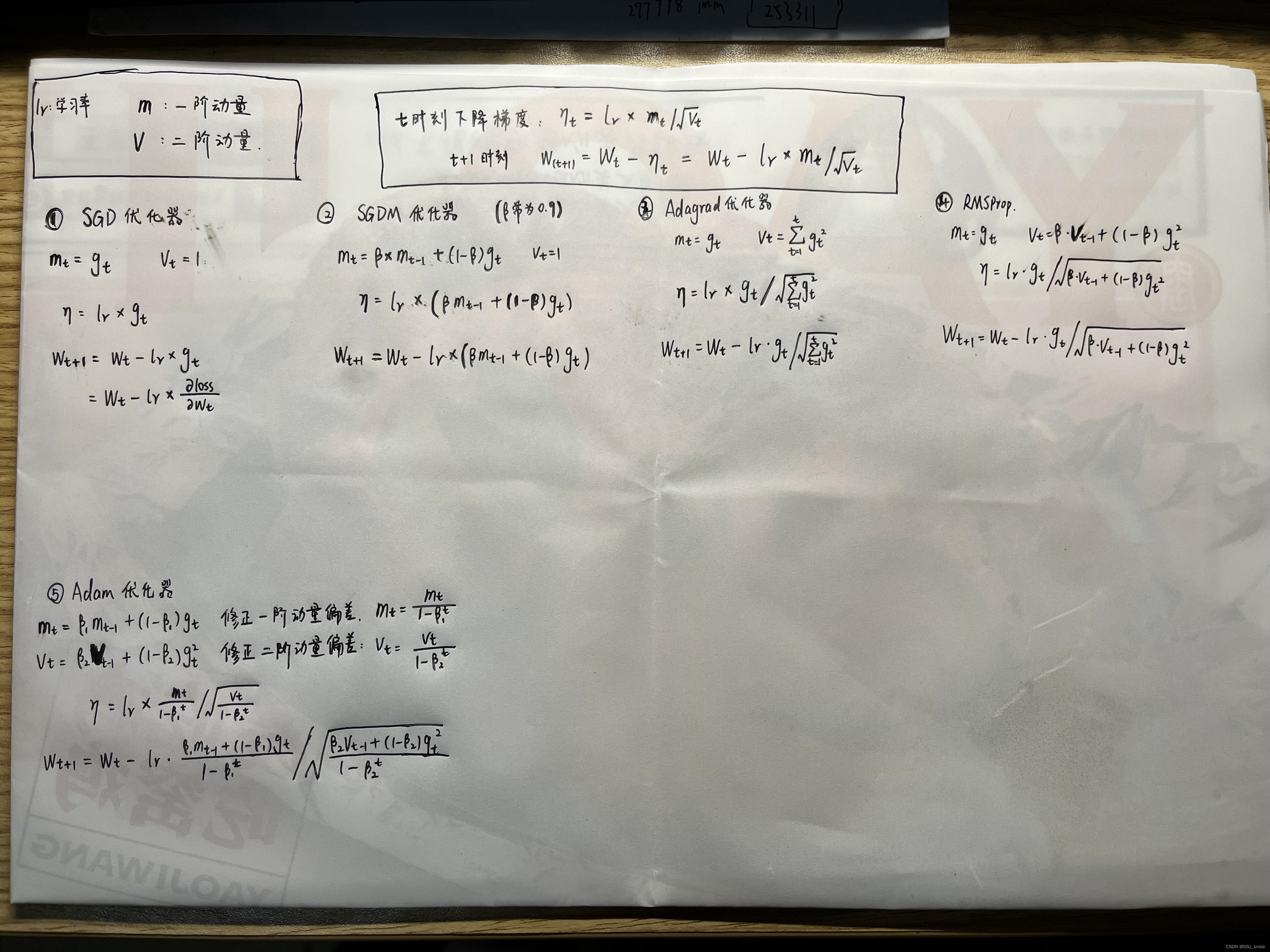

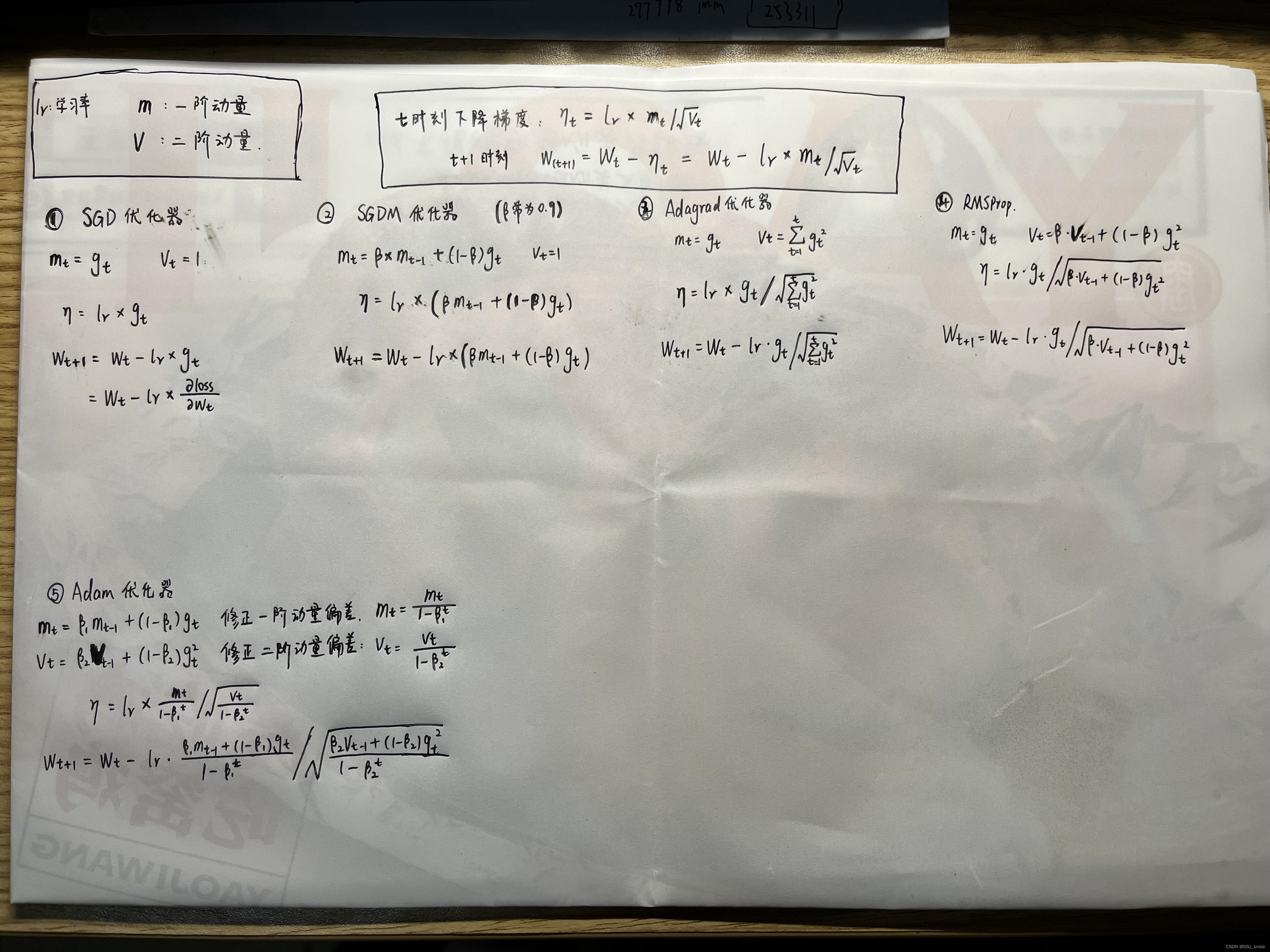

神经网络优化器:

1、计算t时刻损失函数关于当前参数的梯度:g(t) = Зloss / ЗW(t)

2、计算ts时刻一阶动量m(t)和二阶动量V(t)

一阶动量:与梯度相关的函数

二阶动量:与梯度的平方相关的函数

3、计算t时刻下降梯度:η = lr * m(t) / sqrt(v(t))

4、计算t+1时刻参数:w(t+1) = w(t) - η(t) = w(t) - lr * m(t) / sqrt(v(t))

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?