证明了传统图增强方法对GCN谱图卷积的影响:

结论:

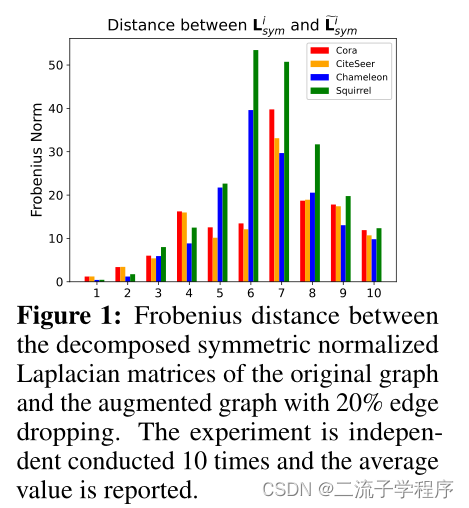

1. 证明edge adding, edge dropping and graph diffusion的图增强方法会影响图的中高频信息。

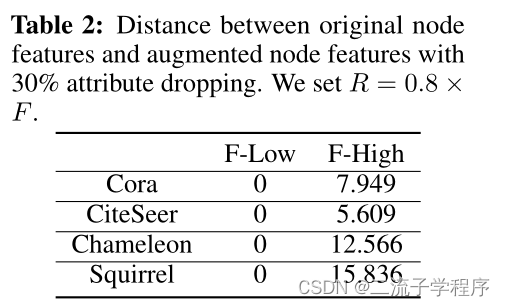

2. 证明attribute masking 会影响图的高频信息。

(具体证明看文献)

对于异质图,高频分量所携带的信息对下游分类性能更有效。如文献[20,21]所示(看原文)。以最大化互信息为目标(Maximize mutual information)学习后的嵌入[10]鼓励只捕获不变信息(低频信息)。虽然现有的图增强算法促进了GCL在传统(同质)基准上的成功,但当高频信息至关重要时(异质图),它们会导致次优表示。

另外提出一个假设:对于一个节点i,标签为yi,其邻居的标签从分布P (yi)中独立抽样。

证明一个引理:所有具有相同标签的聚合节点特征,无论是否同质性,都具有相同的嵌入。

(懒得看了,有兴趣自己看)

好了一堆狗屁证明之后,开始介绍模型。

1. 两层GCN加一层MLP.

(注:异质图也当同质图来使。Ma el al.[46]表明,根据我们的假设1,GCN足以捕获异亲性图中的信息。)

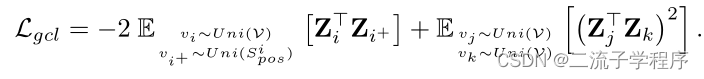

2. 损失函数:

Z表示节点嵌入。

每次迭代时采样b个节点形成种子节点集S;及其周围的T -hop邻居组成节点池P。对于每个种子节点vi∈S,选取节点池中相似性最高的top-K个节点为其正集,表示为Sipos = {vi, v1i, v2i,…vKpos i}。

负采样以及什么叫做最相似的top-K节点没找到。这么重要的东西居然不说清楚!这可事关如何训练的问题,代码我也没找到(有找到的可以评论告诉我)

结论:AF-GCL在8个同质图基准中有4个优于最先进的GCL算法,并在剩下的4个数据集上实现了具有竞争力的性能。此外,AF-GCL是第一个同时适用于同质图和异质图的算法。

1116

1116

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?