一.HDFS概念

1.1概念

HDFS,它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS的设计适合一次写入,多次读出的场景,且不支持文件的修改。适合用来做数据分析,并不适合用来做网盘应用。

1.2 组成

- HDFS集群包括,NameNode和DataNode以及Secondary Namenode。

- NameNode负责管理整个文件系统的元数据,以及每一个路径(文件)所对应的数据块信息。

- DataNode 负责管理用户的文件数据块,每一个数据块都可以在多个datanode上存储多个副本。

- Secondary NameNode用来监控HDFS状态的辅助后台程序,每隔一段时间获取HDFS元数据的快照。

1.3 HDFS 文件块大小

- HDFS中的文件在物理上是分块存储(block),块的大小可以通过配置参数(dfs.blocksize)来规定,默认大小在hadoop2.x版本中是128M,老版本中是64M

- HDFS中的文件在物理上是分块存储(block),块的大小可以通过配置参数( dfs.blocksize)来规定,默认大小在hadoop2.x版本中是128M,老版本中是64M

- 如果寻址时间约为10ms,而传输速率为100MB/s,为了使寻址时间仅占传输时间的1%,我们要将块大小设置约为100MB。默认的块大小实际为64MB,但是很多情况下HDFS使用128MB的块设置。

- 块的大小:10ms100100M/s = 100M

二 .HFDS命令行操作

-

基本语法

bin/hadoop fs 具体命令 -

参数大全 bin/hadoop fs

[-appendToFile <localsrc> ... <dst>] [-cat [-ignoreCrc] <src> ...] [-checksum <src> ...] [-chgrp [-R] GROUP PATH...] [-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...] [-chown [-R] [OWNER][:[GROUP]] PATH...] [-copyFromLocal [-f] [-p] <localsrc> ... <dst>] [-copyToLocal [-p] [-ignoreCrc] [-crc] <src> ... <localdst>] [-count [-q] <path> ...] [-cp [-f] [-p] <src> ... <dst>] [-createSnapshot <snapshotDir> [<snapshotName>]] [-deleteSnapshot <snapshotDir> <snapshotName>] [-df [-h] [<path> ...]] [-du [-s] [-h] <path> ...] [-expunge] [-get [-p] [-ignoreCrc] [-crc] <src> ... <localdst>] [-getfacl [-R] <path>] [-getmerge [-nl] <src> <localdst>] [-help [cmd ...]] [-ls [-d] [-h] [-R] [<path> ...]] [-mkdir [-p] <path> ...] [-moveFromLocal <localsrc> ... <dst>] [-moveToLocal <src> <localdst>] [-mv <src> ... <dst>] [-put [-f] [-p] <localsrc> ... <dst>] [-renameSnapshot <snapshotDir> <oldName> <newName>] [-rm [-f] [-r|-R] [-skipTrash] <src> ...] [-rmdir [--ignore-fail-on-non-empty] <dir> ...] [-setfacl [-R] [{-b|-k} {-m|-x <acl_spec>} <path>]|[--set <acl_spec> <path>]] [-setrep [-R] [-w] <rep> <path> ...] [-stat [format] <path> ...] [-tail [-f] <file>] [-test -[defsz] <path>] [-text [-ignoreCrc] <src> ...] [-touchz <path> ...] [-usage [cmd ...]] -

常用命令实操

(1)-help:输出这个命令参数 bin/hdfs dfs -help rm (2)-ls: 显示目录信息 hadoop fs -ls / (3)-mkdir:在hdfs上创建目录 hadoop fs -mkdir -p /aaa/bbb/cc/dd (4)-moveFromLocal从本地剪切粘贴到hdfs hadoop fs - moveFromLocal /home/hadoop/a.txt /aaa/bbb/cc/dd (5)-moveToLocal:从hdfs剪切粘贴到本地 hadoop fs - moveToLocal /aaa/bbb/cc/dd /home/hadoop/a.txt (6)--appendToFile :追加一个文件到已经存在的文件末尾 hadoop fs -appendToFile ./hello.txt /hello.txt (7)-cat :显示文件内容 (8)-tail:显示一个文件的末尾 hadoop fs -tail /weblog/access_log.1 (9)-text:以字符形式打印一个文件的内容 hadoop fs -text /weblog/access_log.1 (10)-chgrp 、-chmod、-chown:linux文件系统中的用法一样,修改文件所属权限 hadoop fs -chmod 666 /hello.txt hadoop fs -chown someuser:somegrp /hello.txt (11)-copyFromLocal:从本地文件系统中拷贝文件到hdfs路径去 hadoop fs -copyFromLocal ./jdk.tar.gz /aaa/ (12)-copyToLocal:从hdfs拷贝到本地 hadoop fs -copyToLocal /aaa/jdk.tar.gz (13)-cp :从hdfs的一个路径拷贝到hdfs的另一个路径 hadoop fs -cp /aaa/jdk.tar.gz /bbb/jdk.tar.gz.2 (14)-mv:在hdfs目录中移动文件 hadoop fs -mv /aaa/jdk.tar.gz / (15)-get:等同于copyToLocal,就是从hdfs下载文件到本地 hadoop fs -get /aaa/jdk.tar.gz (16)-getmerge :合并下载多个文件,比如hdfs的目录 /aaa/下有多个文件:log.1, log.2,log.3,... hadoop fs -getmerge /aaa/log.* ./log.sum (17)-put:等同于copyFromLocal hadoop fs -put /aaa/jdk.tar.gz /bbb/jdk.tar.gz.2 (18)-rm:删除文件或文件夹 hadoop fs -rm -r /aaa/bbb/ (19)-rmdir:删除空目录 hadoop fs -rmdir /aaa/bbb/ccc (20)-df :统计文件系统的可用空间信息 hadoop fs -df -h / (21)-du统计文件夹的大小信息 hadoop fs -du -s -h /aaa/* (22)-count:统计一个指定目录下的文件节点数量 hadoop fs -count /aaa/ (23)-setrep:设置hdfs中文件的副本数量 hadoop fs -setrep 3 /aaa/jdk.tar.gz 这里设置的副本数只是记录在namenode的元数据中,是否真的会有这么多副本, 还得看datanode的数量。因为目前只有3台设备,最多也就3个副本, 只有节点数的增加到10台时,副本数才能达到10。

三. HDFS客户端操作

3.1 eclipse环境准备

3.1.1 jar包准备

- 解压hadoop-2.7.2.tar.gz到非中文目录

- 进入share文件夹,查找所有jar包,并把jar包拷贝到_lib文件夹下

- 在全部jar包中查找.source.jar,并剪切到_source文件夹。

- 在全部jar包中查找tests.jar,并剪切到_test文件夹。

3.1.2 eclipse准备

-

配置HADOOP_HOME环境变量

-

采用hadoop编译后的bin 、lib两个文件夹(如果不生效,重新启动eclipse)

-

创建第一个java工程

public class HdfsClientDemo1 { public static void main(String[] args) throws Exception { // 1 获取文件系统 Configuration configuration = new Configuration(); // 配置在集群上运行 configuration.set("fs.defaultFS", "hdfs://hadoop102:9000"); FileSystem fileSystem = FileSystem.get(configuration); // 直接配置访问集群的路径和访问集群的用户名称 // FileSystem fileSystem = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu"); // 2 把本地文件上传到文件系统中 fileSystem.copyFromLocalFile(new Path("f:/hello.txt"), new Path("/hello1.copy.txt")); // 3 关闭资源 fileSystem.close(); System.out.println("over"); } } -

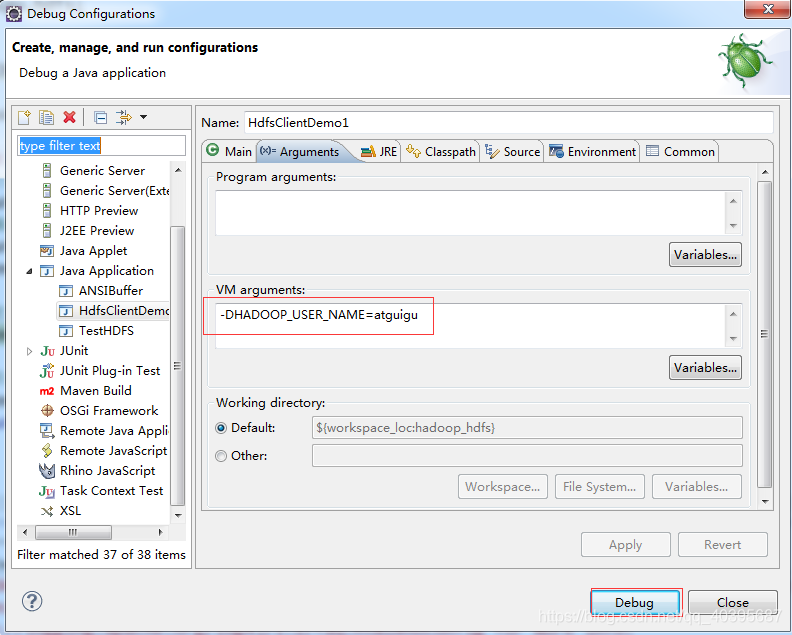

执行程序

运行时需要配置用户名称

客户端去操作hdfs时,是有一个用户身份的。默认情况下,hdfs客户端api会从jvm中获取一个参数来作为自己的用户身份:-DHADOOP_USER_NAME=atguigu,atguigu为用户名称。

3.2 通过API操作HDFS

3.2.1 HDFS获取文件系统

@Test

public void initHDFS() throws Exception{

// 1 创建配置信息对象

// new Configuration();的时候,它就会去加载jar包中的hdfs-default.xml

// 然后再加载classpath下的hdfs-site.xml

Configuration configuration = new Configuration();

// 2 设置参数

// 参数优先级: 1、客户端代码中设置的值 2、classpath下的用户自定义配置文件 3、然后是服务器的默认配置

// configuration.set("fs.defaultFS", "hdfs://hadoop102:9000");

configuration.set("dfs.replication", "3");

// 3 获取文件系统

FileSystem fs = FileSystem.get(configuration);

// 4 打印文件系统

System.out.println(fs.toString());

}

3.2.2 HDFS文件上传

@Test

public void putFileToHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// 2 创建要上传文件所在的本地路径

Path src = new Path("e:/hello.txt");

// 3 创建要上传到hdfs的目标路径

Path dst = new Path("hdfs://hadoop102:9000/user/atguigu/hello.txt");

// 4 拷贝文件

fs.copyFromLocalFile(src, dst);

fs.close();

}

3.2.3 HDFS文件下载

@Test

public void getFileFromHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// fs.copyToLocalFile(new Path("hdfs://hadoop102:9000/user/atguigu/hello.txt"),

new Path("d:/hello.txt"));

// boolean delSrc 指是否将原文件删除

// Path src 指要下载的文件路径

// Path dst 指将文件下载到的路径

// boolean useRawLocalFileSystem 是否开启文件效验

// 2 下载文件

fs.copyToLocalFile(false, new Path("hdfs://hadoop102:9000/user/atguigu/hello.txt"),

new Path("e:/hellocopy.txt"), true);

fs.close();

}

3.2.4 HDFS目录创建

@Test

public void mkdirAtHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

//2 创建目录

fs.mkdirs(new Path("hdfs://hadoop102:9000/user/atguigu/output"));

}

3.2.5 HDFS文件夹删除

@Test

public void deleteAtHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

//2 删除文件夹 ,如果是非空文件夹,参数2必须给值true

fs.delete(new Path("hdfs://hadoop102:9000/user/atguigu/output"), true);

}

3.2.6 HDFS文件名更改

@Test

public void renameAtHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

//2 重命名文件或文件夹

fs.rename(new Path("hdfs://hadoop102:9000/user/atguigu/hello.txt"),

new Path("hdfs://hadoop102:9000/user/atguigu/hellonihao.txt"));

}

3.2.7 HDFS文件详情查看

@Test

public void readListFiles() throws Exception {

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// 思考:为什么返回迭代器,而不是List之类的容器

RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(new Path("/"), true);

while (listFiles.hasNext()) {

LocatedFileStatus fileStatus = listFiles.next();

System.out.println(fileStatus.getPath().getName());

System.out.println(fileStatus.getBlockSize());

System.out.println(fileStatus.getPermission());

System.out.println(fileStatus.getLen());

BlockLocation[] blockLocations = fileStatus.getBlockLocations();

for (BlockLocation bl : blockLocations) {

System.out.println("block-offset:" + bl.getOffset());

String[] hosts = bl.getHosts();

for (String host : hosts) {

System.out.println(host);

}

}

System.out.println("--------------李冰冰的分割线--------------");

}

}

3.2.8 HDFS文件夹查看

@Test

public void findAtHDFS() throws Exception, IllegalArgumentException, IOException{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// 2 获取查询路径下的文件状态信息

FileStatus[] listStatus = fs.listStatus(new Path("/"));

// 3 遍历所有文件状态

for (FileStatus status : listStatus) {

if (status.isFile()) {

System.out.println("f--" + status.getPath().getName());

} else {

System.out.println("d--" + status.getPath().getName());

}

}

}

3.3 通过IO流操作HDFS

3.3.1 HDFS文件上传

@Test

public void putFileToHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// 2 创建输入流

FileInputStream inStream = new FileInputStream(new File("e:/hello.txt"));

// 3 获取输出路径

String putFileName = "hdfs://hadoop102:9000/user/atguigu/hello1.txt";

Path writePath = new Path(putFileName);

// 4 创建输出流

FSDataOutputStream outStream = fs.create(writePath);

// 5 流对接

try{

IOUtils.copyBytes(inStream, outStream, 4096, false);

}catch(Exception e){

e.printStackTrace();

}finally{

IOUtils.closeStream(inStream);

IOUtils.closeStream(outStream);

}

}

3.3.2 HDFS文件下载

@Test

public void getFileToHDFS() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"),configuration, "atguigu");

// 2 获取读取文件路径

String filename = "hdfs://hadoop102:9000/user/atguigu/hello1.txt";

// 3 创建读取path

Path readPath = new Path(filename);

// 4 创建输入流

FSDataInputStream inStream = fs.open(readPath);

// 5 流对接输出到控制台

try{

IOUtils.copyBytes(inStream, System.out, 4096, false);

}catch(Exception e){

e.printStackTrace();

}finally{

IOUtils.closeStream(inStream);

}

}

3.3.3 定位文件读取

下载第一块

@Test

// 定位下载第一块内容

public void readFileSeek1() throws Exception {

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"), configuration, "atguigu");

// 2 获取输入流路径

Path path = new Path("hdfs://hadoop102:9000/user/atguigu/tmp/hadoop-2.7.2.tar.gz");

// 3 打开输入流

FSDataInputStream fis = fs.open(path);

// 4 创建输出流

FileOutputStream fos = new FileOutputStream("e:/hadoop-2.7.2.tar.gz.part1");

// 5 流对接

byte[] buf = new byte[1024];

for (int i = 0; i < 128 * 1024; i++) {

fis.read(buf);

fos.write(buf);

}

// 6 关闭流

IOUtils.closeStream(fis);

IOUtils.closeStream(fos);

}

下载第二块

@Test

// 定位下载第二块内容

public void readFileSeek2() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:9000"), configuration, "atguigu");

// 2 获取输入流路径

Path path = new Path("hdfs://hadoop102:9000/user/atguigu/tmp/hadoop-2.7.2.tar.gz");

// 3 打开输入流

FSDataInputStream fis = fs.open(path);

// 4 创建输出流

FileOutputStream fos = new FileOutputStream("e:/hadoop-2.7.2.tar.gz.part2");

// 5 定位偏移量(第二块的首位)

fis.seek(1024 * 1024 * 128);

// 6 流对接

IOUtils.copyBytes(fis, fos, 1024);

// 7 关闭流

IOUtils.closeStream(fis);

IOUtils.closeStream(fos);

}

合并文件

在window命令窗口中执行

type hadoop-2.7.2.tar.gz.part2 >> hadoop-2.7.2.tar.gz.part1

四. HDFS的数据流

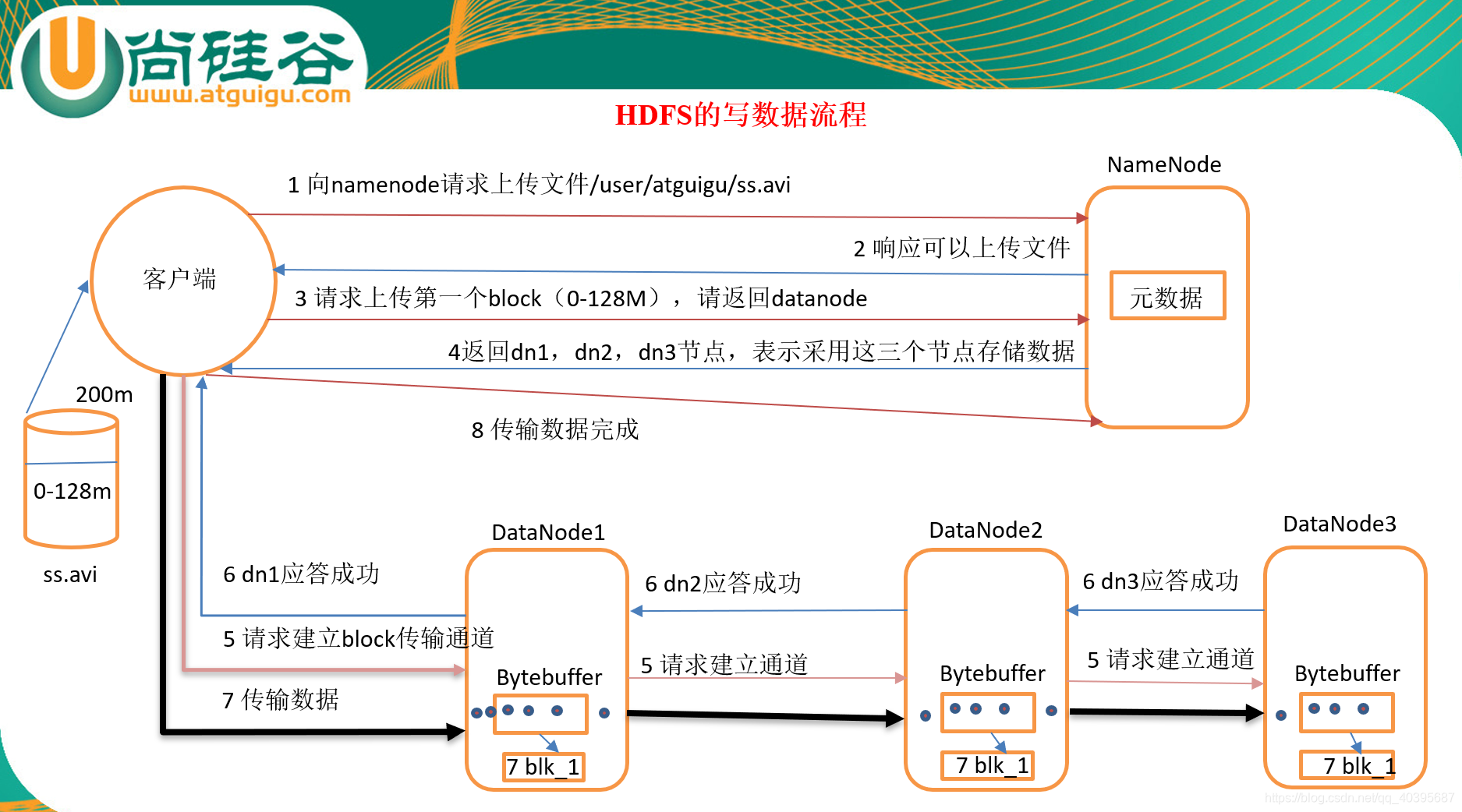

4.1 HDFS写数据流程

4.1.1 剖析文件写入

- 客户端向namenode请求上传文件,namenode检查目标文件是否已存在,父目录是否存在。

- namenode返回是否可以上传。

- 客户端请求第一个 block上传到哪几个datanode服务器上。

- namenode返回3个datanode节点,分别为dn1、dn2、dn3

- 客户端请求dn1上传数据,dn1收到请求会继续调用dn2,然后dn2调用dn3,将这个通信管道建立完成

- dn1、dn2、dn3逐级应答客户端。

- 客户端开始往dn1上传第一个block(先从磁盘读取数据放到一个本地内存缓存),以packet为单位,dn1收到一个packet就会传给dn2,dn2传给dn3;dn1每传一个packet会放入一个应答队列等待应答

- 当一个block传输完成之后,客户端再次请求namenode上传第二个block的服务器。(重复执行3-7步)

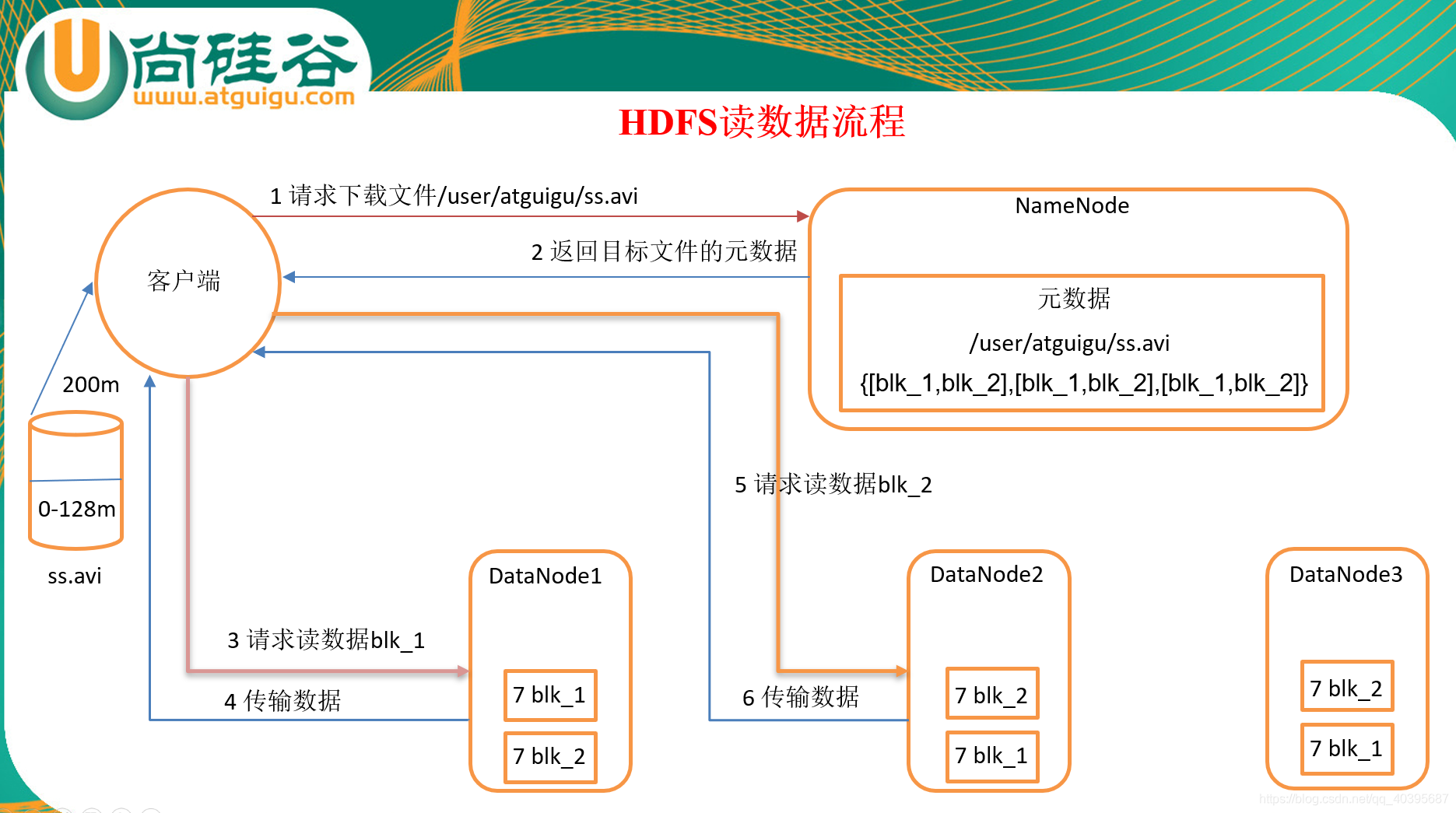

4.2 HDFS读数据流程

- 客户端向namenode请求下载文件,namenode通过查询元数据,找到文件块所在的datanode地址。

- 挑选一台datanode(就近原则,然后随机)服务器,请求读取数据。

- datanode开始传输数据给客户端(从磁盘里面读取数据放入流,以packet为单位来做校验)。

- 客户端以packet为单位接收,先在本地缓存,然后写入目标文件。

4.3 一致性模型

debug调试如下代码

@Test

public void writeFile() throws Exception{

// 1 创建配置信息对象

Configuration configuration = new Configuration();

fs = FileSystem.get(configuration);

// 2 创建文件输出流

Path path = new Path("hdfs://hadoop102:9000/user/atguigu/hello.txt");

FSDataOutputStream fos = fs.create(path);

// 3 写数据

fos.write("hello".getBytes());

// 4 一致性刷新

fos.hflush();

fos.close();

}

写入数据时,如果希望数据被其他client立即可见,调用如下方法FsDataOutputStream. hflush ();

//清理客户端缓冲区数据,被其他client立即可见

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?