一、安装

- 创建虚拟环境:python -m venv env/abspider

- 安装scrapy及相关依赖:pip install -r requirements.txt

# 依赖及版本(请自行选择)

scrapy==2.11.0

lxml==5.0.0

pyOpenSSL==23.3.0二、使用

- 进入项目文件夹:cd /path/to/projects

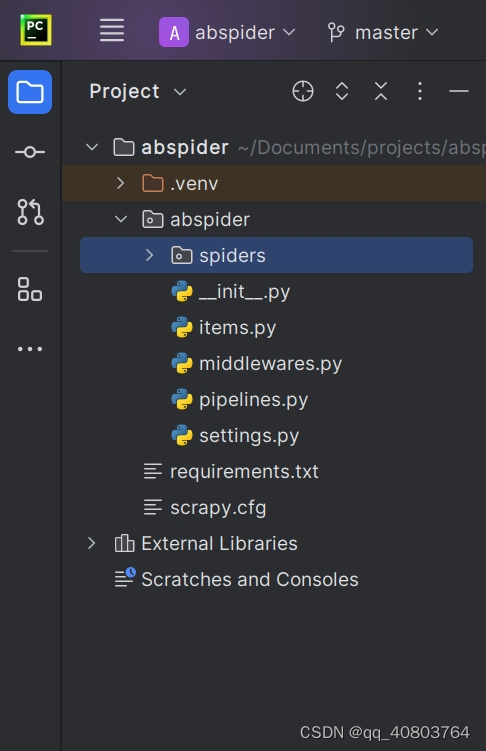

- 创建scrapy项目:scrapy startproject abspider,生成以下目录及文件

- 开始爬虫:scrapy crawl spider

- 爬虫结果输出为一个CSV文件:scrapy crawl spider -o output.csv

- 打印及输出爬虫结果,可用于调整爬虫规则:scrapy shell http://www.baidu.com

- 打开浏览器查看爬取的网站:scrapy view http://www.baidu.com

- 打开命令行帮助:scrapy -h

三、项目结构及配置

- spiders:爬虫的请求及响应处理,多页面爬取时在此添加多个URL

- items:爬虫的数据结构

- pipelines:清洗、验证及存储数据

- middlewares:介于爬虫的请求与响应之间的处理,例如设置代理、修改header等

- settings:项目配置

# 修改请求头,防止被目标服务器阻止

USER_AGENT = "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36"

# False即不遵循robots协议,爬取该网站不允许的URL,否则可能会无法爬取数据

ROBOTSTXT_OBEY = False四、遇到的问题

1、缺少module'lzma'(由于我使用的是Python3.11,旧版本可能没有这个问题)

解决方法:

- 安装依赖:apt install xz-devel;pip install backports.lzma

- 修改文件:/path/python311/lib/python3.11/lzma.py

# 找到旧代码

from ._lzma import *

from ._lzma import _encode_filter_properties, _decode_filter_properties

# 改为新代码

try:

from ._lzma import *

from ._lzma import _encode_filter_properties, _decode_filter_properties

except ImportError:

from backports.lzma import *

from backports.lzma import _encode_filter_properties, _decode_filter_properties

59万+

59万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?