1.MNIST是keras中一个关于手写识别的数据集,其中有6万张训练图像与1万张测试图像。

keras中共有七个内置数据集,

注:CIFAR10与CIFAR100分别为分类数为10和分类数100的两个图片数据集。

【除内置数据库外,UCI中还有较多免费资料库】

2.引入数据集

from keras.datasets import mnist

(train_datas,train_labels),(test_datas,test_labels)=mnist.load_data()

train_images.shape #形状为一三维张量:(60000,28,28),即6万张28*28的图片

len(train_labels) #label为一向量,维度与图片个数对应,为600003.架构神经网络(Sequential类型)

from keras import models

from keras import layers

# models是文件名,Sequential对应其中的一个类,这里是实例化一个对象

network = models.Sequential()

#网络第一层需要给输入的向量形状,后续则无需再给,全连接网络需要将输入的图片拉直成一个向量输入,所谓拉直就是将图片按行排列成一列向量。

network.add(layers.Dense(512,activation = 'relu',input_shape = (28*28,)))

#使用softmax分类

network.add(layers.Dense(10,activation = 'softmax'))

4.查看网络

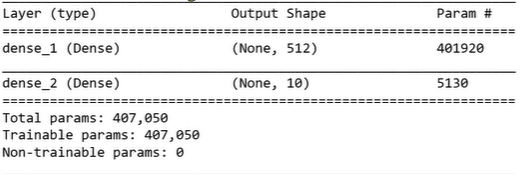

network.summary()

我们需要估计的参数有407050个,第一层需要估计一个784*512=401408个参数的矩阵,又需要加上一个512维的偏移向量,一共需要401408+512=401920个参数,第二层需要估计一个512*10=5120个参数的矩阵加上10维的偏移向量,共5130个参数,两层共需401920+5130=407050个参数。

5.编译网络

network.compile(optimizer = 'rmsprop', loss = 'categorical_crossentropy', metrics=['accuracy'])optimizer指明使用何种优化梯度下降的方法,keras支持的有:SGD(随机梯度下降),RMSprop(本质上是weighted sum版的RMS),Adagrad(考虑不同梯度参数以往更新的RMS),Adam(考虑动量)等等

loss指明何种损失,用于衡量估计误差,多分类任务常使用交叉熵。

metrics用于我们观察模型的好坏,这里使用分类正确率作为标准。

6.数据预处理

我们希望我们输入向量的值维持在0左右,常见的方法有压缩到0和1之间,或是将其变为常态分布,这里我们采取第一种方法,将图片的每一个值除以255,然后使用reshape将其拉平,除以255后会出现小数,所以将其类别转为float型。

train_images = train_images.reshape((60000,28*28)) # 注意reshape要的输入是个元组

train_images = train_images.astype('float32')/255

test_images = test_images.reshape((10000,28*28))

test_images = test_images.astype('float32')/255将类别数字组成的向量转化为one-hot向量组成的矩阵

from keras.utils import to_categorical

train_labels = to_categorical(train_labels)

test_labels = to_categorical(test_labels)

7.训练网络

采用batch大小为128,5轮来训练。

network.fit(train_images,train_labels,epoches=5,batch_size=128)batch_size 代表神经网络根据多少数据进行一次迭代(iteration:包含一次正向传播,反向传播)

一次epoch表示所有数据跑完,一次epoch需要经过的iteration(更新次数)为所有数据数/batch_size,最终我们更新了epoches*每次epoches更新的iteration数。

8.衡量测试资料

这里越过验证集调参的过程,直接对测试集进行衡量好坏。

test_loss, test_acc = network.evaluate(test_images, test_labels)

623

623

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?