部件级多特征融合珍稀鸟类稀疏识别

基本信息

博客贡献人

燕青

作者

陈秀梅

标签

rare bird recognition, component detection, sparse representation, feature fusion, bird classification

摘要

针对珍稀鸟类数据量较少与鸟类识别训练集数据量需求大的矛盾,考虑到鸟类图像目标在头部和身体等关键区域的几何复杂性,区别于传统处理方式以完整鸟类图像为待处理对象,本文:

- 部件检测:采用基于选择性搜索的部件检测方法,并融合多部件信息

- 特征提取:采用特征融合,并选择颜色、全局及局部梯度特征作为融合特征

- 分类器:采用稀疏表示进行分类,将待分类样本进行稀疏表示并进行稀疏求解,最终得到分类

问题定义

- 鸟类图像的精细分类识别问题的难点:

- 类内差异大:相同种类的鸟差异性可能较高,一些具有区分性的信息往往存在一些特定的部位,而因为拍摄的鸟类图像中鸟类姿态的变化,可能会导致具有区分性的信息的丢失。

- 类间差异小:不同类别的鸟类间可能高度相似,在一些部位可能拥有相同的特征信息。

- 背景噪声:鸟类图像的光照、背景都会对识别结果产生影响。

考虑到鸟类图像的具有区分性信息的特征往往存在于一些细微部位这一特点,研究发现获得鸟类具有区分性的精确部件信息对鸟类图像分类的准确率提高有着决定性的作用。

-

特征提取的两种方式:人工设计特征和CNN自动提取

-

本文人工设计颜色、全局、局部梯度三种特征并进行融合

-

特征融合:在鸟类部件信息特征提取的过程中,需要对每一个部件和整个图片提取能够区分子类的有效信息,而这些有效信息不能仅仅通过一种特征的提取方式来显示出来,因此,本方法将多种特征融合进而来表征每一张图像。

特征的融合方法主要是像素级、特征级以及决策级的融合

借鉴人脸识别是使用特征级的融合方法进行特征融合的,而鸟类图像识别和人脸识别同属于图像的精细分类问题,因此本研究特征融合的方法也选用特征级融合的方法。

-

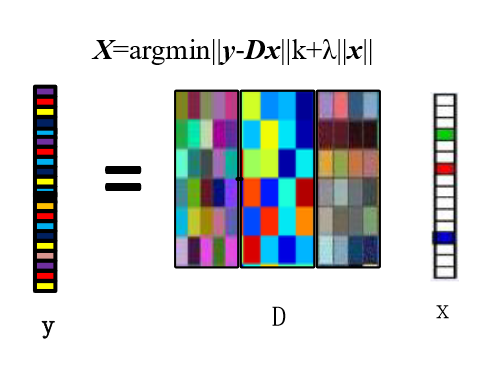

稀疏表示分类算法:根据压缩感知理论,如果某一信号在变换域内是可压缩的或者稀疏的,那么就可以用一个与变换基不相关的字典矩阵将高维度的信号映射到一个低维度的空间上,然后通过求解一个最优化问题就可以从这些投影中以较高的概率重构出原来的高维度信号,体现在分类领域中即为得出待分类样本的分类。

Y = D X Y=DX Y=DX

Y Y Y 为测试样本特征向量, D D D 为训练出的稀疏字典, X X X 为需要求解的稀疏向量。信号稀疏分解思想:如果想将一个待分类样本使用训练样本进行线性表示,但是如果训练样本中的样本数量巨大,可以选用相关性最强的原子(即一个训练样本)进行表示,使得与测试样本相关性较弱的项的系数为零,即在使得测试样本在训练样本下表示的系数是稀疏的。

稀疏表示具有两个阶段:

-

字典构造:将训练集中的鸟类图像进行了部件检测处理后,逐个部件进行特征的提取,每一类鸟类的特征组成一个特征矩阵,所有的测试鸟类图片的特征矩阵所构成的大矩阵就是进行稀疏求解的字典。

-

稀疏求解:将测试图片获取部件信息后,提取特征得到一个列向量,通过稀疏求解算法求得测试图片特征向量在训练图片特征字典下的稀疏表示。

特征求解的过程中,假设每个待分类测试鸟类图像特征向量为列向量 Y Y Y , Y Y Y投影到稀疏字典 D D D上的向量为列向量 X X X,那么用 D D D 和 X X X 对 Y Y Y 重建的过程就是: Y = D × X Y=D \times X Y=D×X。其中 X X X和 Y Y Y的行数以及 D D D的列数均等于训练样本的个数, D D D的第 i i i列为第 i i i个样本的向量表示。 X X X的第 i i i个分量可看作第 i i i个训练样本在表示 Y Y Y时所占的权重。因此稀疏编码的过程就是已知测试样本特征向量 Y Y Y 和训练样本字典 D D D,求稀疏表示 X X X 的过程。

优点:对图像存在拍摄角度多变、信息丢失等问题具有较强的鲁棒性和抗干扰性,同时也解决了其他算法选择特征困难的问题。

本文将每一张训练图像部件级多特征融合后的向量作为原子,各个类别分别构成了一个类字典,所有训练图像的各个子类字典构成了训练图像的特征矩阵作为稀疏识别的字典;利用贪婪迭代、凸松弛两类算法获取测试样本特征向量在训练字典下的稀疏表示系数,根据稀疏表示系数的性质最终判决的得出待分类图像的类别,这样稀疏表示分类器就已构建完成。

-

方法

方法架构图

本文的分类流程包括三个步骤,其一是鸟类部件信息的获取,其二是部件信息的获取,其三是基于稀疏编码的分类识别。鸟类图像部件信息的获取,选择性搜索的算法;关于部件特征的表征选择颜色、全局与局部特征融合的方式;稀疏识别部分是将训练图像作为稀疏编码的字典,进而求解测试图像在训练字典下的稀疏系数,并根据稀疏系数的性质来判别待分类鸟类图像。

方法描述

选择性搜索 - 部件检测

选择性搜索的策略是,因为遍历之前不知道目标框尺度的大小,于是在遍历过程中就尽可能遍历所有的尺度。有别于暴力穷举,该算法在遍历过程中首先得到小尺度的区域,然后一次次合并得到大尺度区域。整体步骤如下:

-

首先初始化原始区域,使用基于图的图像分割方法,也就是将图像分割成很多很多的小块。

-

接下来进行的是计算每两个相邻的区域的相似度,得到相似度后合并最相似的两块,直到最终只剩下一块完整的图片。

-

最后对每个分割出的区域进行排序。

具体步骤为:

-

使用基于图形的分割技术获取原始分割区域 R = r 1 , r 2 , . . . , r n R={r_1,r_2,...,r_n} R=r1,r2,...,rn ; 将相似度集进行初始化使得集合 S = ∅ S = \emptyset S=∅

-

依次计算两两相邻区域之间的相似度,并将计算得出的相似度添加到相似度集合 S S S 中。其中,计算两相邻区域的相似度过程中,分别使用了颜色、尺寸、纹理以及交叠相似度。使用的公式如下:

S ( r i , r j ) = a 1 S c o l o r ( r i , r j ) + a 2 S t e x t u r e ( r i , r j ) + a 3 S s i z e ( r i , r j ) + a 4 S f u l l ( r i , r j ) S(r_i,r_j)=a_1S_{color}(r_i,r_j)+a_2S_{texture}(r_i,r_j)+a_3S_{size}(r_i,r_j)+a_4S_{full}(r_i,r_j) S(ri,rj)=a1Scolor(ri,rj)+a2Stexture(ri,rj)+a3Ssize(ri,rj)+a4Sfull(ri,rj)

R R R代表初始区域, S c o l o r ( r i , r j ) S_{color}(r_i,r_j) Scolor(ri,rj)为颜色相似度, S t e x t u r e ( r i , r j ) S_{texture}(r_i,r_j) Stexture(ri,rj)为纹理相似度, S s i z e ( r i , r j ) S_{size}(r_i,r_j) Ssize(ri,rj)为尺寸相似度, S f u l l ( r i , r j ) S_{full}(r_i,r_j) Sfull(ri,rj)为交叠相似度, S ( r i , r j ) S(r_i,r_j) S(ri,rj)为最终相似度。每进行一步合并处理都是根据相似度集合 S S S 中两两相邻的区域的相似度最大值,找出最为相似的 两个区域 r i r_i ri 和 r j r_j rj,将这两个区域合并成为一个新的区域 r t r_t rt ,并 在相似度集合中将其他区域与 原先 r i r_i ri 或者 r j r_j rj 计算得出的相似度都删去,然后计算新增区域 r t r_t rt 与其相邻区域(这些相邻区域 就是原先与 r i r_i ri 和j r j r_j rj 相邻的区域)的相似度,并将这些相似度的值添加的到相似度集合 S S S 中, 同时将新区域 r t r_t rt 添加到区域集合 R R R 中。重复上述步骤,直至相似度集合 S S S 为空时,区域集合 R R R 中区域即为部件信息目标框。

该方法获得的鸟类图像部件的效果图如下:

特征融合 - 特征表示

根据进行融合的图像所具有的抽象程度,通常将图像融合分为像素级融合、特征级融合以及决策级融合三个层次。根据鸟类细粒度识别特点,本文采用特征级融合。

特征级融合:首先需要对图像进行特征提取(被提取特征可以包括图形中目标的形状、轮廓边缘等信息,也可以是图像的纹理、角度、方向梯度等信息),在此基础上对所提取的特征进行操作。相比于像素级融合,特征级融合对图像的信息进行了压缩,大大减少了工作量,节省了工作时间,提高了处理的实时性。

目前常用的特征级图像融合的方法主要有:加权平均法、贝叶斯估计法、聚类分析方法等。

图像识别中提取的特征主要有全局和局部两种特征。

全局特征可以较为全面的描述一幅图像的整体轮廓,而局部特征重点描述的则是图像局部形状、光照条件等因素。全局特征和局部特征各自具有不同的优势和不足,因为底层特征分类效果比较差,特征对图像的描述能力直接影响图像分类的精度,所以,本文利用将图像的全局特征和局部特征进行融合的方法,用融合之后的特征来表示一幅图像,以此来达到提高分类准确性的目的。

本文选取的特征分别为RGB特征、GIST特征 (Generalized Search Tree, 通用搜索树) 、PHOG特征(Pyramid Histogram of Oriented Gradients, 分层梯度方向直方图) 。

RGB 特征

在 RGB 颜色空间模型下,可以利用下面公式将一副数字数字图像中的像素颜色信息进行精确表达:

C

=

R

×

25

6

0

+

G

×

25

6

1

+

B

×

25

6

2

C=R\times256^0+G\times256^1+B\times256^2

C=R×2560+G×2561+B×2562

数字图像中任意一个像素的颜色信息用公式中的

C

C

C 表示。

反过来,作为上述公式的逆运算,要想在已知一幅图像上某一像素点的颜色信息后将图像 的三个特征信息分量进行分解,可以利用如下公式:

{

B

=

[

C

25

6

2

]

G

=

[

C

−

B

×

25

6

2

256

]

R

=

C

−

B

×

25

6

2

−

G

×

256

\begin{cases} B=[\frac{C}{256^2}]\\ G=[\frac{C-B\times256^2}{256}]\\ R= C-B\times256^2-G\times256 \end{cases}

⎩

⎨

⎧B=[2562C]G=[256C−B×2562]R=C−B×2562−G×256

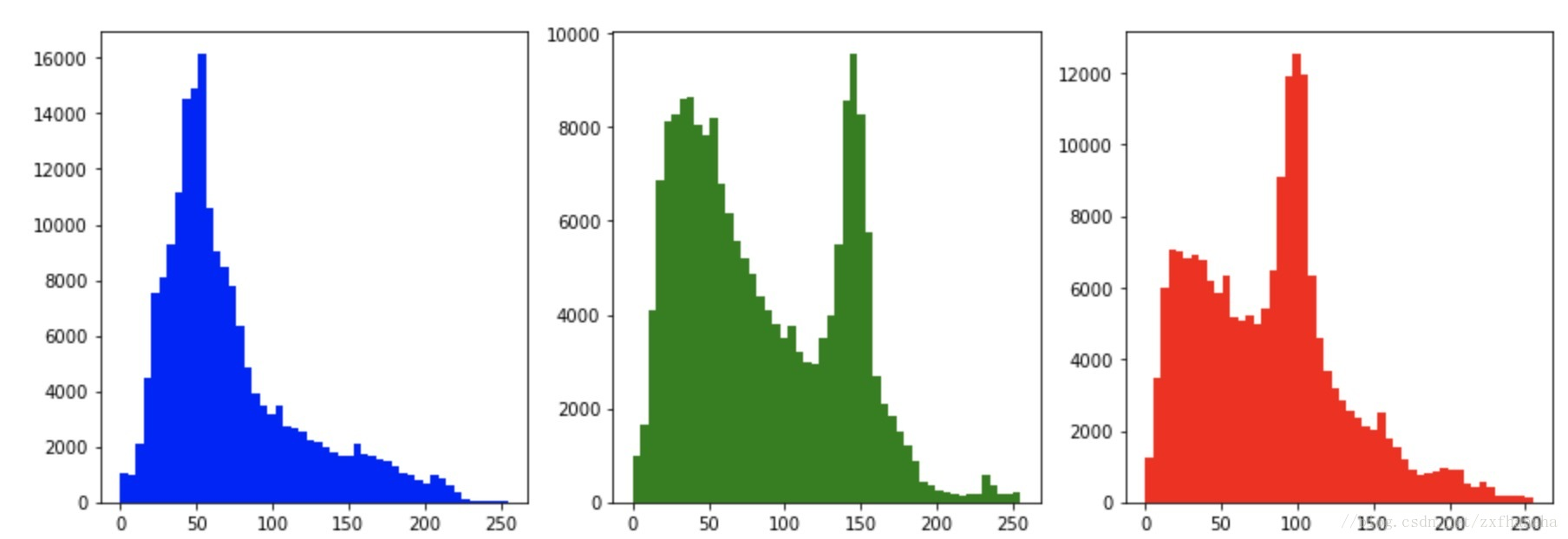

式中[*]表示取整的操作。下图是一张彩色图像经过 RGB 分解后的效果。

本文使用的颜色特征的表示方式是 Swain 和 Ballard 提出的使用颜色直方图,该方式的思想是通过统计落在每个颜色灰度值上的像素数量就可以得到颜色直方图。具体计算公式如下:

H

(

m

)

=

n

m

N

,

(

m

=

0

,

1

,

.

.

.

,

255

)

H(m)=\frac{n_m}{N},(m=0,1,...,255)

H(m)=Nnm,(m=0,1,...,255)

n

m

n_m

nm 是落在颜色灰度值

m

m

m 上的像素个数,

N

N

N 是图像中像素总个数。

3颜色通道即可得到3幅颜色直方图:

图. RGB三颜色通道直方图(未归一化)

GIST 特征

图像的 GIST 特征能够反映图像的上下文信息,是一种全局特征,在实际的应用中 GIST 特征使用 Gabor 滤波器将图像进行滤波,这里的滤波器是不同方向、不同尺度的滤波器组,接着将滤波后得到的图像划分为网络,在每个网络内部取内部平均值,最后将滤波后得到的所有图像的每个网络均值通过级联进行组合起来,图像的轮廓信息就得到了。

二维的 Gabor 函数可以通过一维 Gabor 函数扩展而来,通过调整参数二维 Gabor 函数又可以构造出 Gabor 滤波器组。表达式为:

g

(

x

,

y

)

=

1

2

π

σ

x

σ

y

e

x

p

[

−

(

x

2

σ

x

2

+

y

2

σ

y

2

)

]

×

c

o

s

(

2

π

f

0

x

+

φ

)

g(x,y)=\frac{1}{2\pi\sigma_x\sigma_y}exp[-(\frac{x^2}{\sigma^2_x}+\frac{y^2}{\sigma^2_y})]\times cos(2\pi f_0x+\varphi)

g(x,y)=2πσxσy1exp[−(σx2x2+σy2y2)]×cos(2πf0x+φ)

式中:

x

x

x 代表图像的横坐标;

y

y

y 代表图像的纵坐标轴;

f

0

f_0

f0为滤波器频率;

σ

x

\sigma_x

σx和

σ

y

\sigma_y

σy 分别为沿着

x

x

x 和

y

y

y 方向的高斯分布的方差。参数

φ

\varphi

φ 是该余弦谐波因子的相位差,二维 Gabor 函数的实质为余弦函数对二维高斯函数的调制。

鸟类图像的 Gist 特征提取步骤如下:

- (a) 使用在不同尺度、方向上的共 n c n_c nc 个Gabor 滤波器,在原图上进行卷积,得到尺寸与输入图像一致 的 n c n_c nc 个特征图。

- (b) 把每个特征图划分成 k × k k\times k k×k 个区域,计算每个区域内的均值。

- (c) n c n_c nc 个特征图,共得到 k × k × n c k\times k \times n_c k×k×nc 维的GIST特征。

PHOG 特征

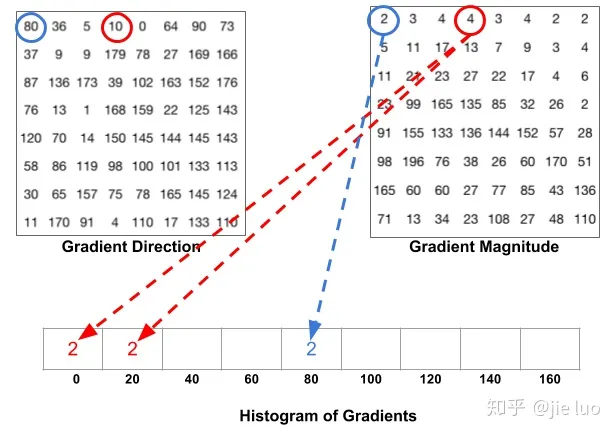

HOG 特征的主要思想是:在一幅图像中,某一像素点的梯度强度与方向可以很好地描述某个局部目标的形状。下图为HOG 特征的提取过程:

-

图像归一化:改变图像的局部阴影面积, 从而降低光照变化带来的影响

-

梯度求解:求解每个像素点的梯度强度和梯度方向。

x , y x,y x,y 方向梯度强度分量计算公式如下:

G x ( x , y ) = H ( x + 1 , y ) − H ( x − 1 , y ) G_x(x,y)=H(x+1,y)-H(x-1,y) Gx(x,y)=H(x+1,y)−H(x−1,y)G y ( x , y ) = H ( x , y + 1 ) − H ( x , y − 1 ) G_y(x,y)=H(x,y+1)-H(x,y-1) Gy(x,y)=H(x,y+1)−H(x,y−1)

其中, G x ( x , y ) G_x(x,y) Gx(x,y) 表示输入图像中点 ( x , y ) (x,y) (x,y) 处的水平方向梯度, G y ( x , y ) G_y(x,y) Gy(x,y) 表示输入图像中点 ( x , y ) (x,y) (x,y) 处的竖直方向梯度, H ( x , y ) H(x,y) H(x,y) 表示输入图像中点 ( x , y ) (x,y) (x,y) 处的像素值。该点处梯度强度 G ( x , y ) G(x,y) G(x,y) 与梯度方向 α ( x , y ) \alpha (x,y) α(x,y) 可以由以下公式算出:

G ( x , y ) = G x ( x , y ) 2 + G y ( x , y ) 2 G(x,y)=\sqrt{G_x(x,y)^2+G_y(x,y)^2} G(x,y)=Gx(x,y)2+Gy(x,y)2α ( x , y ) = a r c t a n ( G y ( x , y ) G x ( x , y ) ) \alpha(x,y)=arctan(\frac{G_y(x,y)}{G_x(x,y)}) α(x,y)=arctan(Gx(x,y)Gy(x,y))

-

图像分块,块内分为大小相等的cell(下图为8*8的cell),每个cell内投票得直方图:计算出每个像素点的梯度强度和方向。将0~180度分成9个bins,分别是0,20,40…160。然后统计每一个像素点所在的bin,进行投票。

图. 梯度方向直方图

图. 绿色框为cell,蓝色框为block

- 块内归一化。

- 级联每块的向量,得到图像HOG特征向量。

分层梯度方向直方图(PHOG)是在 HOG 算法提出的,因此 HOG 算法是 PHOG 算法的核心部分。A. Bosch 等提出采用局部形状和空间来描述一副图像的方法,通过梯度方向直方图即 HOG 特征得到可以得到一副图像的局部形状,通过多分辨率尺度划分则可以获取空间分布信息。PHOG 特征则可以通过将图像各个分辨率的图像子区域级联起来得到。PHOG 特征特征可以有效的区分通用目标主要是因为这一特征能够反映图像的局部形状和空间分布的差异。

PHOG 特征实现步骤为如下:

- (a) 将图像分割成一个个小的连通的区域;

- (b) 分别采集连通区域中各个像素点的梯度或者边缘的方向直方图;

- (c) 将这些直方图拼接起来就构成该目标区域的 HOG 特征描述;

- (d) 将各层尺度图提取的 HOG 特征进行拼接,就得到整个图像的 PHOG 特征

特征融合

提取了多种特征之后,为了充分体现不同的特征提取算法对鸟类图像的表征能力,接下来的工作就是进行特征的融合。算法采用特征级融合,特征级的融合包括串联融合方法和并联融合方法。假设三个特征空间 A A A、 B B B、 C C C 中分别有三个特征向量, α ∈ A , β ∈ B , λ ∈ C \alpha \in A, \beta \in B, \lambda \in C α∈A,β∈B,λ∈C 。

串联方式的特征融合的方法就是将

α

\alpha

α、

β

\beta

β、

λ

\lambda

λ 串联成一个特征向量,公式为:

η

=

{

α

β

λ

}

\eta=\left\{ \begin{matrix} \alpha\\ \beta \\ \lambda \end{matrix} \right\}

η=⎩

⎨

⎧αβλ⎭

⎬

⎫

并联融合的方法是将

α

\alpha

α、

β

\beta

β、

λ

\lambda

λ 三个特征合分别赋予一定的权重系数,复合成一个特征向量

η

=

α

+

i

β

+

j

λ

\eta=\alpha+i\beta+j\lambda

η=α+iβ+jλ ,其中

i

,

j

i, j

i,j 都是虚数单位,如果

α

\alpha

α、

β

\beta

β、

λ

\lambda

λ 维度不一致时,低维度的特征需要进行补零操作再进行并联融合。

本文使用的方法是串联融合,得到的特征维数是三种特征维数的总和。

稀疏表示 - 分类器

根据稀疏表示的模型可以假设每一类鸟中每张鸟类图像提取的特征是一个一维列向量,则每一类鸟类训练图像的特征向量就组成了一个特征矩阵 D b i r d i = [ d i , 1 , d i , 2 , . . . , d i , n i ] ∈ R m ∗ n i D^i_{bird}=[d_{i,1},d_{i,2},...,d_{i,n_i}] \in R^{m*n_i} Dbirdi=[di,1,di,2,...,di,ni]∈Rm∗ni , D b i r d i D^i_{bird} Dbirdi 是第 i i i 类鸟类的训练样本特征矩阵,则 D = [ D b i r d 1 , D b i r d , . . . , D b i r d i 2 ] ∈ R m ∗ n D=[D^1_{bird},D^2_{bird,...,D^i_{bird}}]\in R^{m*n} D=[Dbird1,Dbird,...,Dbirdi2]∈Rm∗n 就是由 i i i 类训练鸟类样本的特征组成的稀疏字典,且该字典是过完备的,即 m < n m<n m<n。

测试鸟类图像的特征向量可以用一维列向量 y y y 表示,那么各个向量之间的关系可以表示为形如 D x = y Dx=y Dx=y 的等式,因为未知数的数量多于等式数量,所以该式具有无穷多解,但是如果在等式中加入正则项约束,则可以解出该等式的一个稀疏解。通过加入正则项约束求解得出的这种稀疏解的物理意义是可以将信号有限地分解成几个信号的线性组合,其中对应的组合系数是稀疏的,也就是说系数向量中大多数元素为 0 0 0 。

x

x

x 可以由

D

D

D 中的少量原子线性组合而成,稀疏表示系数可以由如下方程求解:

x

=

a

r

g

m

i

n

∥

x

∥

0

s

u

b

j

e

c

t

t

o

D

x

=

y

x=argmin\lVert x \rVert_0 \quad subject\enspace to \enspace Dx=y

x=argmin∥x∥0subjecttoDx=y

其中

∥

∗

∥

0

\lVert * \rVert_0

∥∗∥0 是一个

l

0

l_0

l0 范数,它的主要作用是对向量中非零元素进行统计,即该最优化问题为求解一个最稀疏的稀疏表示向量。

本文中,稀疏表示系数由如下具体方程求解:

x

=

a

r

g

m

i

n

∥

y

−

D

x

∥

+

λ

∥

x

∥

x=arg min\lVert y-Dx \rVert+\lambda\lVert x\rVert

x=argmin∥y−Dx∥+λ∥x∥

其中,

y

y

y 为观测数据,也就是测试图片的特征向量;

D

D

D 为字典,本文将每一类的训练图片的特征向量组成一个小的特征矩阵,然后将所有类别的特征矩阵构成一个大的矩阵作为字典,字典的具体构造流程见下图所示;

x

x

x 为待估稀疏向量,也就是稀疏表示系数向量,

λ

\lambda

λ 为正则参数。

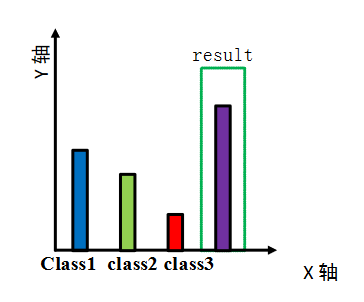

下图中各数据 s i z e size size: $ y:(feature_len,\enspace 1)$, D : ( f e a t u r e _ l e n , t r a i n _ l e n ) D:(feature\_len, \enspace train\_len) D:(feature_len,train_len), x : ( t r a i n _ l e n , 1 ) x:(train\_len,\enspace 1) x:(train_len,1)

图. 特征向量运算过程

得到的字典的表示形式为:

D

=

[

D

b

i

r

d

1

,

D

b

i

r

d

2

,

.

.

.

,

D

b

i

r

d

k

]

=

{

[

l

1

,

1

,

l

1

,

2

,

.

.

.

,

l

1

,

n

]

,

[

l

2

,

1

,

l

2

,

2

,

.

.

.

,

l

2

,

n

]

,

.

.

.

,

[

l

k

,

1

,

l

k

,

2

,

.

.

.

,

l

k

,

n

]

}

∈

R

k

×

n

\begin{align*} D &= [D^1_{bird},D^2_{bird},...,D^k_{bird}] \\ &= \{[l_{1,1},l_{1,2},...,l_{1,n}],[l_{2,1},l_{2,2},...,l_{2,n}],...,[l_{k,1},l_{k,2},...,l_{k,n}]\}\in R^{k\times n} \end{align*}

D=[Dbird1,Dbird2,...,Dbirdk]={[l1,1,l1,2,...,l1,n],[l2,1,l2,2,...,l2,n],...,[lk,1,lk,2,...,lk,n]}∈Rk×n

图. 字典构造流程

D b i r d 1 D^1_{bird} Dbird1 ~ D b i r d k D^k_{bird} Dbirdk 对应 k k k 类。在得到鸟类训练样本特征向量组成的字典后,就可以开始第二个阶段稀疏求解。算法本质上是求 l 1 l_1 l1 范数最优化的问题, l 1 l_1 l1 范数是 l 0 l_0 l0 范数的最优凸近似, 而 l 0 l_0 l0 范数比较难优化求解(NP 难问题),但是 l 1 l_1 l1 比 l 0 l_0 l0 范数要容易优化求解。

求得稀疏系数之后,测试样本可以由下面公式表示:

y

=

x

i

,

1

l

i

,

1

+

x

i

,

2

l

i

,

2

+

.

.

.

+

x

i

,

n

l

i

,

n

x

i

,

j

∈

R

,

j

=

1

,

2

,

.

.

.

,

n

i

y=x_{i,1}l_{i,1}+x_{i,2}l_{i,2}+...+x_{i,n}l_{i,n} \quad x_{i,j}\in R,j=1,2,...,n_i

y=xi,1li,1+xi,2li,2+...+xi,nli,nxi,j∈R,j=1,2,...,ni

由该公式可以看出,鸟类图像测试样本的特征向量可以由多个训练样本的特征向量进行线性组合表示,而其它类的训练样本特征向量对重构该测试样本特征向量的表示系数为0,从而将一般信号的分类问题转化为了测试样本在训练样本特征字典下的

l

1

l_1

l1 范数的求解问题。这种稀疏解的可以实现将输入鸟类测试图片的特征向量有效地分解成几个鸟类训练图片特征向量的线性组合,其中对应的组合系数是稀疏的。

换句话说,稀疏表示的求解过程其实就是求解测试图像特征在训练图像字典下的稀疏表示的过程,即已知 Y Y Y 和 D D D ,求 x x x 的过程。在求得稀疏表示系数的基础之上,根据已知的稀疏系数的性质,就可以获得测试样本的类别。

分类流程为:首先对稀疏向量进行类内求和,再进行类间比较,得分最高的类别即为预测类别。

图. 分类投票

模型整体识别过程如下图:

图. 整体识别流程

图. 整体识别流程

实验

实验设置

数据集

-

CUB-200

该数据集是由加州理工学院在2010年提出的细粒度数据集,也是目前细粒度分类识别研究的基准图像数据集。

该数据集共有11788张鸟类图像,包含200类鸟类子类,其中训练数据集有5994张图像,测试集有5794张图像,每张图像均提供了图像类标记信息,图像中鸟的bounding box,鸟的关键part信息,以及鸟类的属性信息。

实验设计

为了验证本研究在细粒度鸟类识别领域所做的工作相比传统算法确有提升,分别在部件检测、特征融合、稀疏求解算法的每个方面设置2组对照实验,比较不同方法下对CUB数据集的识别准确率,详细设计见下文“实验结果及分析”。

实验结果及分析

实验1:为了验证多部件进行特征融合对鸟类图像精细分类识别结果的必要性和有效性,对比单一部件特征与多部件特征信息融合对识别结果的影响。对比结果如下图所示:

由上图可以看出,将三种部件信息融合在一起的识别率相比单一部件的识别率有所提高,这是因为单一部件信息无法完整的描述图片的所有信息。将多个部件信息融合可以更好的表征图片信息,同时,这样做可以最大限度的避免背景噪声对识别结果的影响。

实验2:为了避免一种特征对上述结论的特殊性,分别按照部件提取 GIST 和 PHOG 特征,并将两种特征分别进行部件信息融合。识别准确率如下图所示:

从实验1、实验2结果可以看出,单一部件的识别准确率与融合了三个部件的识别准确率相比,三种特征表现出的都是融合后的准确率有了一定的提升。故得出结论,单一特征难以较全面的表达鸟类图像中具有区分性的信息,需要进行特征融合。

实验3:为了验证特征融合的作用,在与实验 1、实验 2 其他设置相同的情况下针对单一部件分别将三种特征、两两融合后的融合特征、三种特征融合后的特征的识别结果进行进行比较。识别结果如下图所示:

由上图实验结果可知,与单一特征的识别准确率相比,融合后的识别准确率高于单一特征的识别准确率。融合三种特征的准确率比单一特征和两两融合后的准确率都高,由此可以得出,融合后特征的识别准确率优于单一特征的识别准确率。

实验4:为了验证上述结论在鸟类其他部件以及多部件融合后的正确性,在其他设置与实验3 都相同的情况下,本研究又分别进行了身体、目标框以及三部分融合后的特征的识别实验。识别结果如下图所示:

通过上图实验结果可知,本研究中部件获取以及特征融合对提高识别结果起到了积极作用。 多部件相较单一部件在识别准确率方面具有较为明显的优势;使用多种特征进行融合来表征图片各个部件的信息比单一特征识别准确率更高。

实验5:为了确定两类稀疏求解算法对鸟类图像识别的作用,本方法首先从两类算法中分别选择一种进行对比,该组对比实验使用的特征分别是部件融合后的两两融合特征以及三种特征融合后的特征。实验结果对比如下:

从上图可以看出,使用相同的特征进行识别,属于凸松弛算法的 BP 算法的识别准确率高于贪婪算法中的 MP 算法。这主要是因为 BP 算法采用的是分解的方法,使得最终得到的稀疏向量的 l 1 l_1 l1 范数最小,因此 BP 算法的效果更优。

实验6:为了验证上述分析的正确性,在保持实验 5 其他基本设置不变的情况下,选用了另外两种稀疏求解方法。实验结果对比如下:

从上图可以看出,对于两大类稀疏求解算法,单从识别准确率方面考虑,凸松弛算法的两种代表算法 BP 算法、LASSO 算法效果优于贪婪算法的代表算法 MP 算法以及 OMP 算法,但是凸松弛算法中的 BP 算法时间复杂度时间复杂度大,其简化算法 LASSO 算法时间复杂度相对较低,因为本研究选用 LASSO 作为稀疏求解的最优算法。但是如果要求更低的时间复杂度,则选用贪婪迭代算法中的 OMP 算法作为稀疏求解算法。

相关知识链接

下载

数据集下载:CUB-200-2011

基础知识

选择性搜索:选择性搜索算法(Selective Search)超详解

GIST:GIST特征提取

HOG:HOG特征

PHOG:PHOG特征

特征融合:特征融合的分类和方法

稀疏表示:稀疏表示(Sparse representation)原理理解

基准实验涉及的论文

Mallat S G, Zhang Z. Matching Pursuits with Time-Frequency Dictionaries[J]. IEEE Transactions on Signal Processing, 1993, 41(12): 3397-3415.

Needell D, Vershynin R. Signal Recovery from Incomplete and Inaccurate Measurements via Regularized Ort hogonal Matching Pursuit[J]. IEEE Journal of Selected Topics in Signal Processing, 2010, 4(2): 310-316.

Pati Y,Rezaiifar R.and Krishnaprasad P.Orthogonal Matching Pursuit: Recursive Function Approximation with Applications to Wavelet Decomposition [C]. 1993 Conference Record of The Twenty-Seventh Asilomar Conference on Signals, Systems and Computers, pp. 40-44, 1993.

Donoho D L, Tsaig Y, Drori I. Sparse Solution of Underdetermined Linear Equations by Stagewise Orthogoonal Matching Pursuit[R]. Technical Report, 2006.

方法组件涉及的论文

Salvador Cervantes Alvarez ,Raul Pinto Elias .Selective Search Method for Object Localization and Detection using Wavelets and Hierarchical Segmentations IEEE Latin America Transactions 2013:11:5:1265-1272

Uijlings J R, Sande K E, Gevers T, et al. Selective search for object recognition[J]. International Journal of Computer Vision, 2013, 104(2): 154-171

陈淑娴.刘建明基于部位特征和全局特征的物体细粒度识别 计算机与现代化 2017 年 10 月

秦姣华,谢备,向旭宇.融合多特征的图像检索算法[J].电讯技术,2017,57(9):1023-1029.[QIN Jiaohua, XIE Bei,XIANG Xuyu,etal.An image retrieval algorithm based on multi-feature fusion [J].Telecommunication Engineering,2017,57( 9) : 1023-1029.

Wagner A, Wright J, Ganesh A, Zhou ZH, Mobahi H, Ma Y. Toward a practical face recognition system: Roust alignment and illumination by sparse representation. IEEE Trans. on Pattern Analysis and Machine Intelllligence, 2012,34(2):372386. [doi: 10. 1109/TPAMI.2011.112]Boyd, Vandenberghe, Faybusovich. Convex Optimization[J]. IEEE Transactions on Automatic Control, 2006, 51(11):1859-1859.

占新. 基于字典学习与稀疏模型的 SAR 图像压缩技术研究[D].中国科学技术,2015.

相关工作涉及的论文

Berg T, Belhumeur P N. POOF: Part-based one-vs.-one features for finegrained categorization, face verification, and attribute estimation. In: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Portland, USA: IEEE, 2013. 955−962

Dai J F, Li Y, He K M, et al. R-FCN: object detection via region-based fully convolutional networks[OL]. [20 17-07-10]. https://arxiv.org/abs/1605.06409

Lin T Y, RoyChowdhury A, Maji S. Bilinear CNN models for fine-grained visual recognition. In: Proceedings of the 15th IEEE International Conference on Computer Vision. Santiago, Chile: IEEE, 2015.1449-1457.

Zhang N, Donahue J, Girshick R, et al. Part-based R-CNN for fine-grained category detection [M]// ComputerVision ECCV 2014. Springer International Publishing, 2014: 834-849.

Branson S, Van Horn G, Belongie S, Perona P. Bird species categorization using pose normalized deep convolutional nets [Online], available:https://arxiv.org/abs/1406.2952, Jun 11, 2014

Xiao T, Xu Y, Yang K, Zhang J, Peng Y, Zhang Z. The application of two-level attention models in deep convolutional neural network for finegrained image classification. In: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Boston, USA: IEEE, 2015. 842-850

Huang S L, Xu Z, Tao D C, et al. Part-stacked CNN for fine-grained visual categorization[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Los Alamitos: IEEE Computer Society Press, 2016: 1173-1182

后续研究涉及的论文

–

总结

亮点

- 采用特征融合,并选择颜色、全局及局部梯度特征作为融合特征,有效提升分类准确率。

- 采用稀疏表示进行分类,对图像存在拍摄角度多变、信息丢失等问题具有较强的鲁棒性和抗干扰性,同时也解决了其他算法选择特征困难的问题。

[不足]

-

使用SS进行部件检测,速度慢

-

人工设计特征过程较为复杂,设计出的特征效果不一定好

-

对于训练样本较多的大数据集,稀疏字典占用空间较大

[启发]

- 在细粒度鸟类识别领域,一般步骤为首先进行部件检测或姿态的对齐; 然后对部件信息进行特征提取;最后是分类器的选择,选用最合适的分类器进行鸟类图像精细分类。故可以从这三个步骤入手,在每个步骤中使用已有模型,达到提升识别准确率的效果。

BibTex

@thesis{chenBuJianJiDuoTeZhengRongHeZhenXiNiaoLeiXiShuShiBie2019,

type = {硕士学位论文},

title = {部件级多特征融合珍稀鸟类稀疏识别},

author = {陈秀梅},

date = {2019},

institution = {{南京邮电大学}},

doi = {10.27251/d.cnki.gnjdc.2019.000687},

url = {https://kns.cnki.net/KCMS/detail/detail.aspx?dbcode=CMFD&dbname=CMFD202001&filename=1019691213.nh&v=},

urldate = {2022-12-06},

editora = {刘佶鑫},

editoratype = {collaborator},

langid = {zh-CN},

keywords = {bird classification,component detection,feature fusion,rare bird recognition,sparse representation,特征融合,珍稀鸟类识别,稀疏表示,部件检测,鸟类分类},

}

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?