RKNN Toolkit2 是由瑞芯微电子 (Rockchip) 开发的一套用于深度学习模型优化和推理的工具。它主要面向在瑞芯微SoC上进行AI应用开发,但也可以用于PC平台进行模型的转换、量化、推理等操作。它支持将多种深度学习框架的模型(如Caffe, TensorFlow, PyTorch等)转换为RKNN格式。

创建虚拟环境

使用miniconda或者Anaconda创建一个虚拟环境,其中miniconda 是 Anaconda 的轻量版。为了减少内存,我们采用miniconda进行开发。

下载链接:

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh安装miniconda,执行以下命令

./Miniconda3-latest-Linux-x86_64.sh然后回车,一直往下滑动看完 license,最后输入 yes 后,继续按下回车, 然后进入安装,安装完成后输入 yes 初始化 anaconda3。

创建虚拟环境,执行以下命令

conda create -n Toolkit2 python=3.8.12 //创建一个名为Toolkit2 的虚拟环境,Python的版本为3.8.12

conda activate Toolkit2 //进入虚拟环境

conda env list //查看虚拟环境列表

conda deactivate //退出虚拟环境Toolkit2的安装

安装依赖

sudo apt update

sudo apt-get install python3-dev python3-pip python3.8-venv gcc

sudo apt-get install libxslt1-dev zlib1g-dev libglib2.0 libsm6 \libgl1-mesa-glx libprotobuf-dev gcc安装 RKNN-Toolkit2

mkdir project-Toolkit2 && cd project-Toolkit2拉取RKNN-Toolkit2

git clone https://gitee.com/LubanCat/lubancat_ai_manual_code.git

cd lubancat_ai_manual_code/dev_env/rknn_toolkit2配置pip源

pip3 config set global.index-url https://mirror.baidu.com/pypi/simple进入到 lubancat_ai_manual_code/dev_env/rknn_toolkit2/doc目录,安装依赖库

pip3 install numpy

pip3 install -r requirements_cp38-1.5.0.txt建议在安装需求之前,sudo vim requirements_cp38-1.5.0.txt,numpy==1.19.5注释掉,否则可能导致依赖安装shibai

安装 rknn_toolkit2

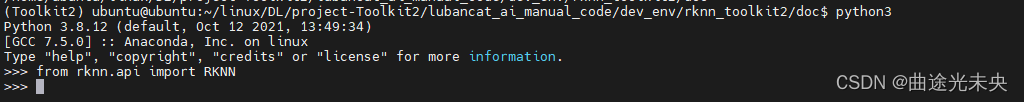

pip3 install rknn_toolkit2-1.5.0+1fa95b5c-cp38-cp38-linux_x86_64.whl检查是否安装成功

输入 quit() 或者使用快捷键 Ctrl+D 退出

本文介绍了RKNNToolkit2,由瑞芯微电子开发的深度学习模型优化和推理工具,支持多种框架模型转换,并详细指导了如何在Linux环境下创建虚拟环境、安装依赖及工具包。

本文介绍了RKNNToolkit2,由瑞芯微电子开发的深度学习模型优化和推理工具,支持多种框架模型转换,并详细指导了如何在Linux环境下创建虚拟环境、安装依赖及工具包。

1343

1343

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?