Hdp组件版本

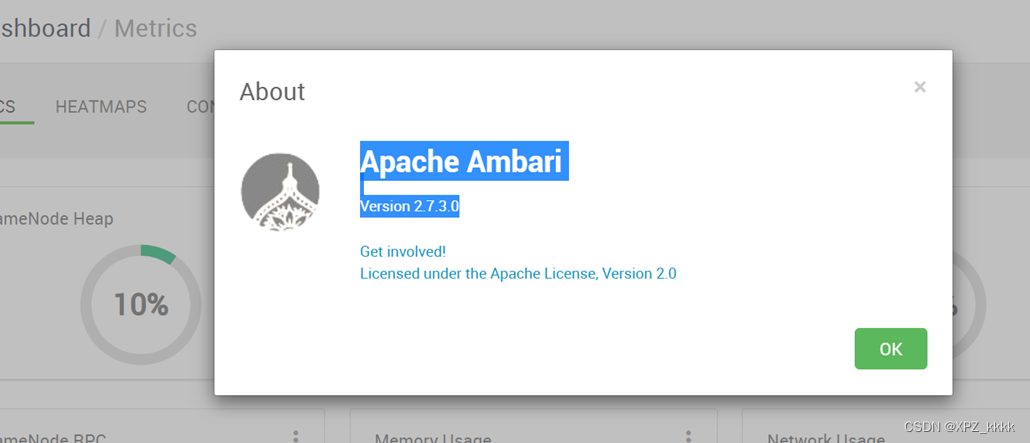

Ambari

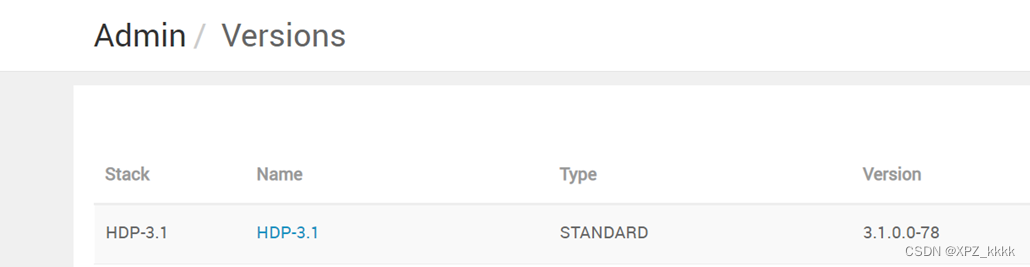

Hdp

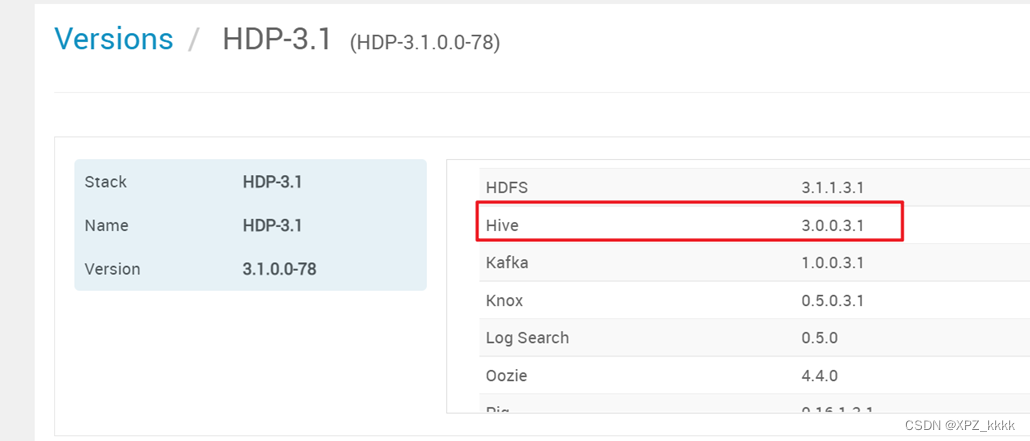

Hive

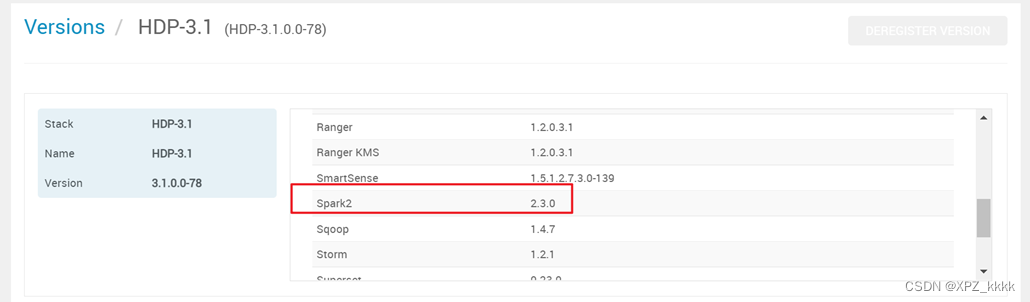

Spark

前置条件

Hdp、Spark、Hive 在安装OK后

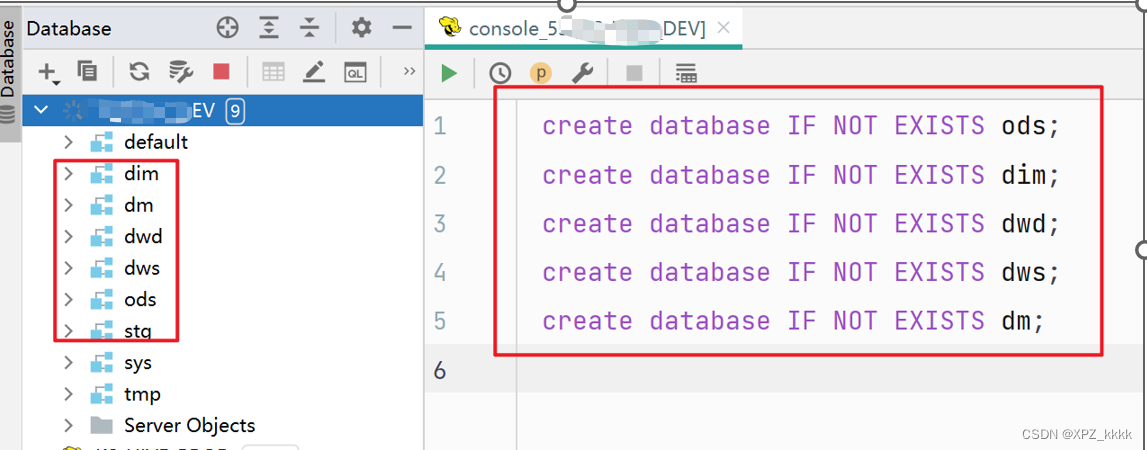

1. Hive各层的库要建好

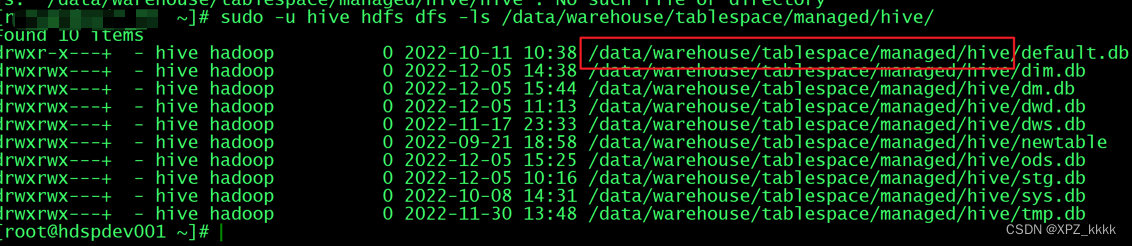

Hive各层要建好后,才会在Hdfs生成相关各层的目录,后面配置Spark访问Hive的目录,要保证这个目录存在

包装xx/managed/hive目录存在

Hdp Spark集成Hive配置

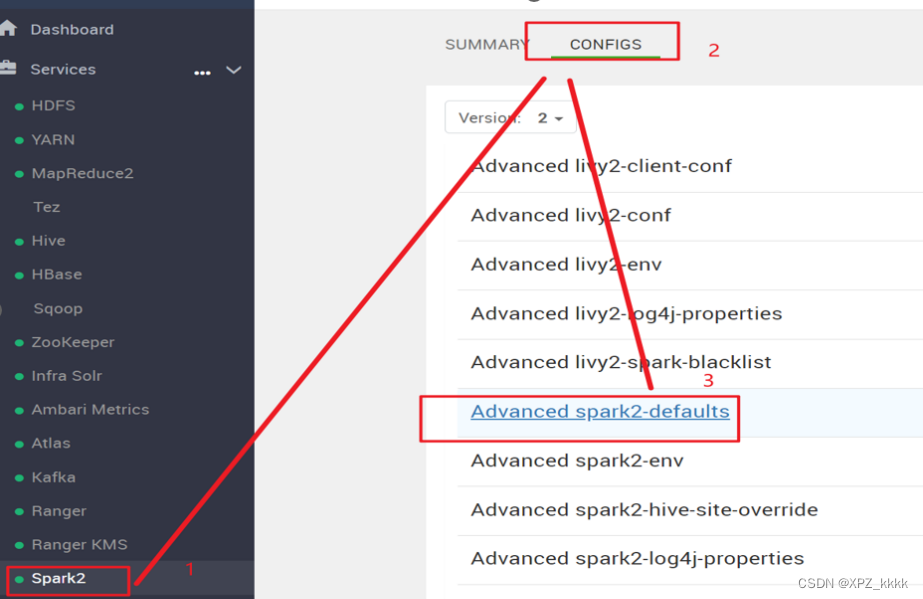

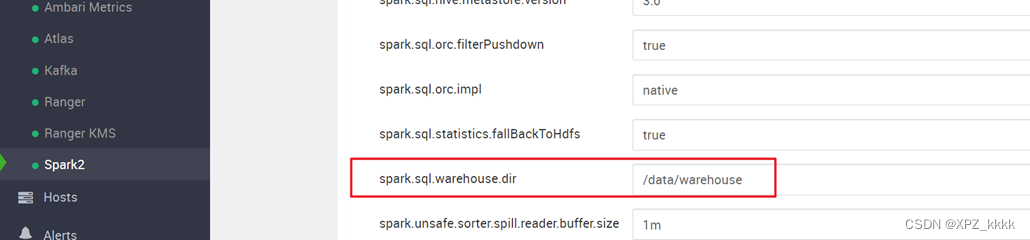

1.修改spark配置: Advanced spark2-defaults

spark.sql.warehouse.dir 值/apps/spark/warehouse 改为hive数据存储hdfs位置:/user/hive/warehouse(根据自己环境设置), 上面的目录

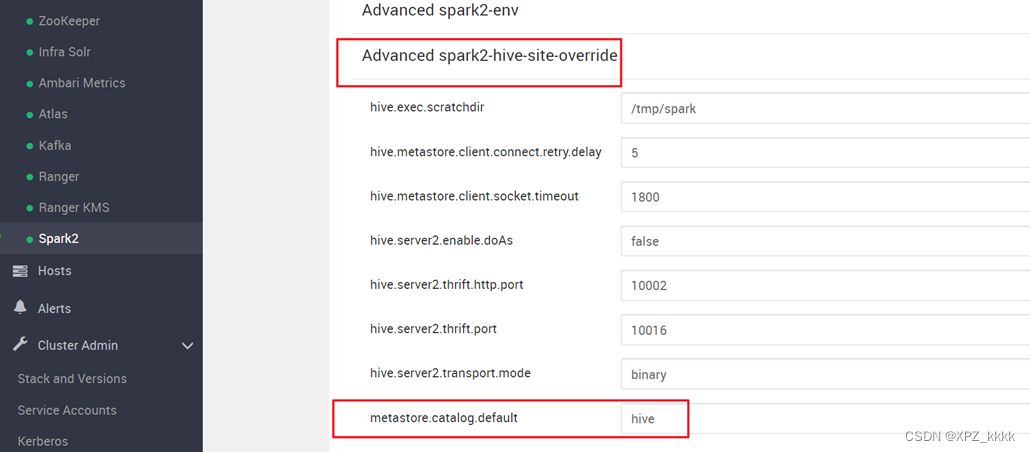

2.修改spark配置: Advanced spark2-hive-site-overrid

metastore.catalog.default 值 spark 改为 hive

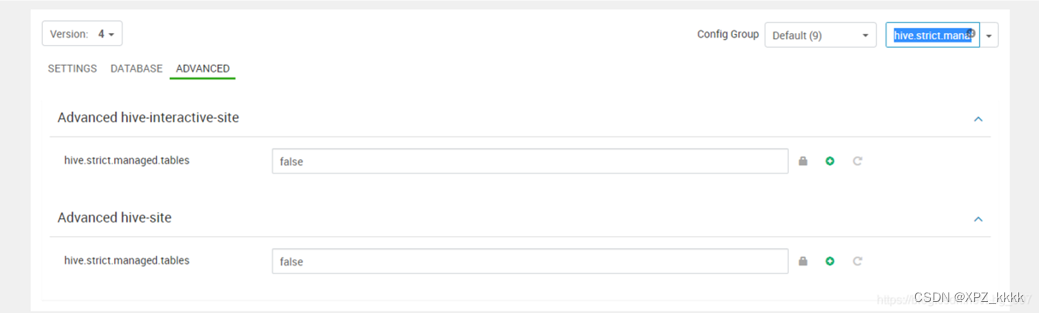

3. 修改hive配置: 到hive组件修改配置

hive.strict.managed.tables 的 true 改为 false (修改2个,

Advanced hive-interactive-site

, Advanced hive-site

)

4. 通过Ambari重启 hive和spark即可

进入Spark安装目录,sbin 目录,运行spark提供的客户端试试

cd xx/sparkxxxx/sbin

sudo -u hive sh spark-sql.sh

show databases;

show tables;

select * from ods.test

577

577

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?