关于GDBT和XGBoost的思考(回归树、分类树、XGBoost、XGBoost例题链接)

1、回归树:根据负梯度(残差)得到回归树,标签f_0x,f_1x…f_nx用于去计算负梯度,f_nx等于什么呢,等于f_n-1x+lr*c,c怎么计算呢,是通过我们设计的回归树的每个叶子节点的损失函数最小得到的,c_0=f_0x=argmin_c(L(yi-c)),只有初始f_0x和计算负梯度的时候才用到原始标签y,其余时候算损失最小都是按照当棵树里面的残差标签值来计算。

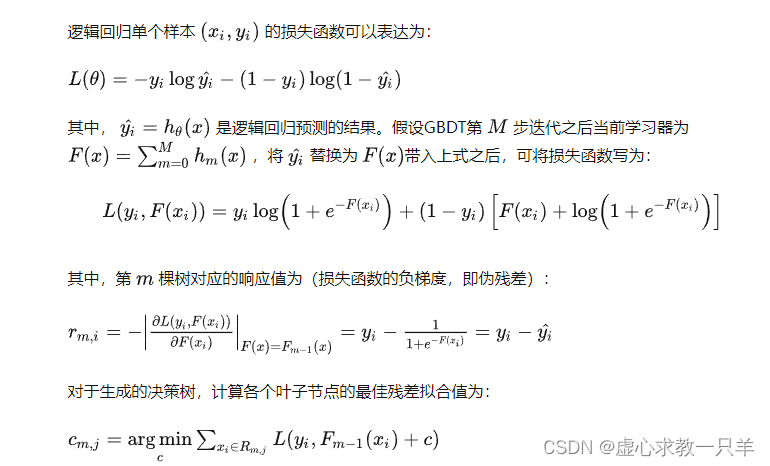

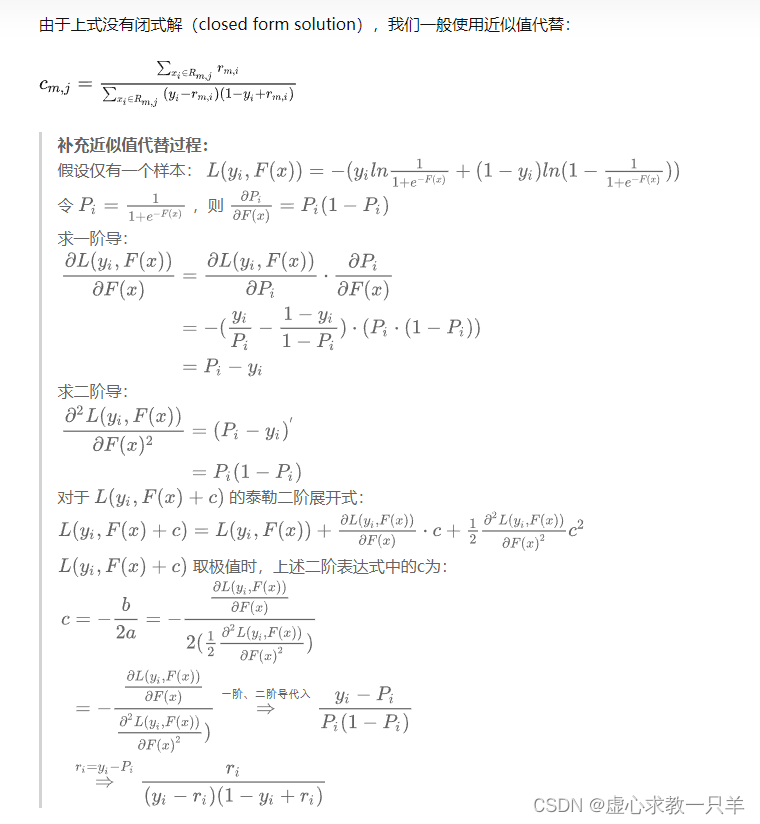

2、分类树:关于二分类的交叉熵损失函数,求最小值进行叶子节点的标签值更新的时候,因为没有闭式解,所以一般采用近似值替代,见图片,同时针对F(x)进行不断迭代残差更新的时候,是去构建的回归树(损失函数使用平方损失),因为交叉熵损失函数中,把logistic表示的概率p带入,不就变成了关于连续性变量F(x)的回归问题了吗,整体gdbt/xgboost构建完成后我们得到的连续值,直接带入logistic得到概率值即可。

3、

585

585

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?