在D2HC-RMVSNet.里提出了一种新的深度图过滤方法,可以有效提高点云融合的质量。

1.初衷

通常,MVS算法采用如下方法过滤:在至少三个视图中,像素重投影误差小于τ1,深度重投影误差小于τ2,其中τ1=1,τ2=0.01是预定义的。固定的参数不同的场景不具有鲁棒性。例如,在两个视图中具有高度可靠一致性的深度值将被过滤,并且固定数量的有效视图也会丢失视图中的信息。此外,使用固定的τ1和τ2可能无法过滤不同场景中足够多的不匹配像素。

2.方法

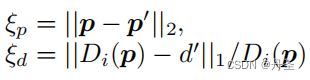

1)首先还是重投影,设参考视角在像素点为p(x,y)的深度图取值为Di (p ),根据参数矩阵和Di(p )计算其世界坐标。然后向源视角j投影,之后归一化齐次坐标得到像素坐标pj,再根据pj在深度图的取值Dj(pj)进行反投影,得到参考视角的齐次坐标,由齐次坐标得到重投影深度d’和重投影像素坐标p’,重投影误差以下式计算。这一步和之前的方法一样。

2)动态一致性检查

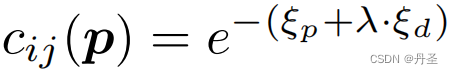

为了量化两个不同视图之间的深度匹配一致性,通过考虑所有视图之间的动态匹配一致性,提出了动态匹配一致性。不同视图中的动态匹配一致性定义为:

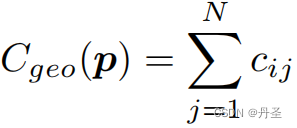

其中λ用于度量两种重投影误差的权重。通过聚合所有相邻视图的匹配一致性,获得全局动态多视图几何一致性Cgeo(p),如下所示:

用Cgeo(p)<τ过滤掉异常值。

提出一种新的深度图过滤方法,通过动态一致性检查来提高点云融合质量。该方法克服了传统MVS算法中固定参数的局限性,能够更准确地过滤不匹配像素。

提出一种新的深度图过滤方法,通过动态一致性检查来提高点云融合质量。该方法克服了传统MVS算法中固定参数的局限性,能够更准确地过滤不匹配像素。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?