狂神说——ES核心概念理解

一、ES核心概念

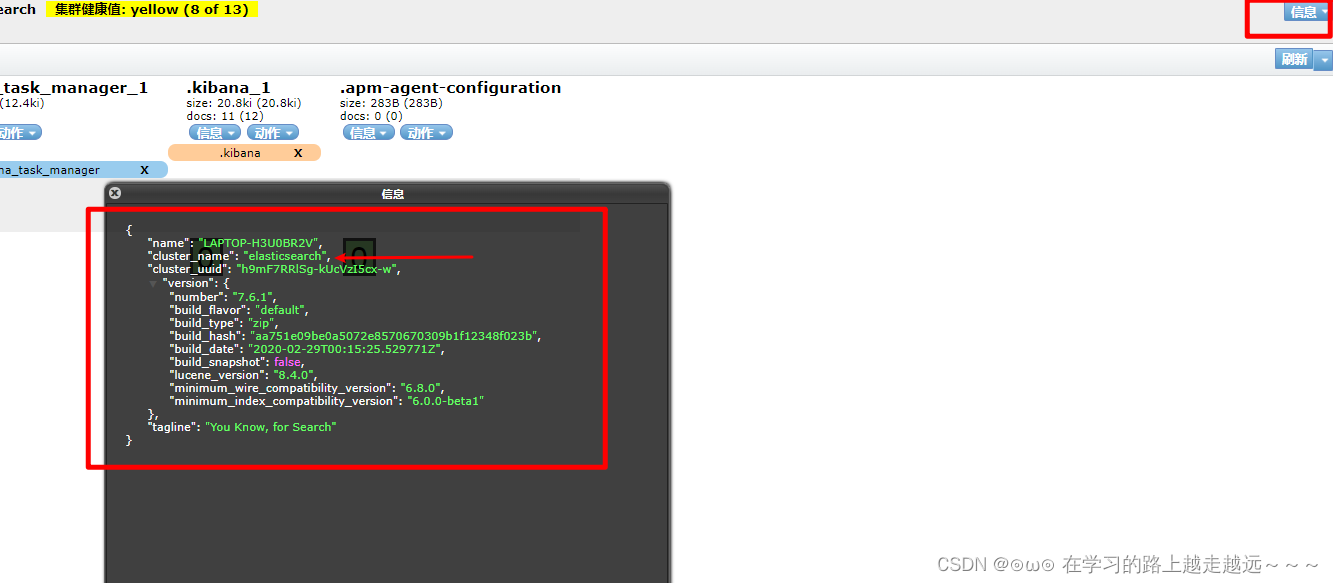

在前面的学习中,我们已经掌握了es是什么,同时也把es的服务已经安装启动,那么es是如何去存储数据,数据结构是什么,又是如何实现搜索的呢?我们先来聊聊lasticsearch的相关概念吧!

集群、节点、索引、类型、文档、分片、映射是什么?

elasticsearch是面向文档,关系行数据库和elasticsearch客观的对比!

| Relational DB(关系型数据库) | Elasticsearch |

|---|---|

| 数据库(database) | Elasticsearch |

| 表(tables) | types |

| 行(rows) | documents |

| 字段(columns) | fields |

elasticsearch(集群)中可以包含多个索引(数据库),每个索引中可以包含多个类型(表),每个类型下又包含多个文档(行),每个文档中包含多个字段(列)。

- 物理设计

elasticsearch在后台把每个索引划分成多个分片,每分分片可以在集群中的不同服务器间迁移。(创建一个索引就是一个集群,默认集群名称为elsaticsearch) - 逻辑设计

一个索引类型中,包含多个文档,比如说文档1、文档2。当我们索引一篇文档时,可以通过这样的一个顺序找到它:索引》类型》文档ID,通过这个组合我们就能索引到某个具体的文档。注意:ID不必是整数,实际上它是个字符串。

二、文档(表)

之前说elasticsearch是面向文档的,那么就意味着索引和搜索数据的最小单位是文档,elasticsearch中,文档有几个重要属性:

- 自我包含,一篇文档同时包含字段和对应的值,也就是同时包含

key:value! - 可以是

层次型的,一个文档中包含自文档,复杂的逻辑实体就是这么来的! - 灵活的结构,

文档不依赖预先定义的模式,我们知道关系型数据库中,要提前定义字段才能使用,在elasticsearch中,对于字段是非常灵活的,有时候,我们可以忽略该字段,或者动态的添加一个新的字段。

尽管我们可以随意的新增或者忽略某个字段,但是,每个字段的类型非常重要,比如一个年龄字段类型,可以是字符串也可以是整型。因为elasticsearch会保存字段和类型之间的映射及其他的设置。这种映射具体到每个映射的每种类型,这也是为什么在elasticsearch中,类型有时候也称为映射类型。

三、类型(数据的类型)

类型是文档的逻辑容器,就像关系型数据库一样,表格是行的容器。类型中对于字段的定义称为映射,比如name映射为字符串类型。我们说文档是无模式的,它们不需要拥有映射中所定义的所有字段,比如新增一个字段,那么elasticsearch是怎么做的呢?elasticsearch会自动的将字段加入映射,但是这个字段的不确定它是什么类型,elasticsearch就开始猜,如果这个值是18,那么elasticsearch会认为它是整型。但是elasticsearch也能猜不对,所以最安全的方式就是提前定义所需要的映射,这点跟关系型数据库殊途同归了,先定义好字段,然后再使用,别整什么差错。

四、索引(数据库)

索引是映射类型的容器,elasticsearch中的索引是一个非常大的文档集合。索引存储了映射类型的字段和其他设置。然后它们被存储到了各个分片上了。我们来研究下分片是如何工作的。

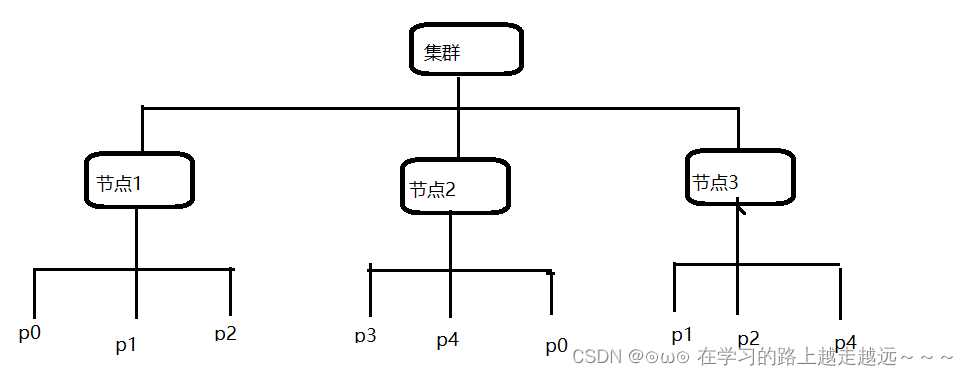

- 物理设计:节点和分片 如何工作

一个集群至少有一个节点,而一个节点就是一个elasticsearch进程,节点可以有多个索引默认的,如果你创建索引,那么索引将会有5个分片(primary shard又称为主分片)构成的,每一个主分片有一个副本(replica shard,又称为复制分片)

上图是一个有3个节点的集群,可以看到主分片和对应的复制分片都不会在同一个几点内,这样有利于某个节点挂掉了,数据也不至于丢失。实际上,一个分片就是一个Lucene索引,一个包含倒排索引的文件目录,倒排索引的结构使得elasticsearch在不不扫描全部文档的情况下,就能告诉你哪些文档包含特定的关键字,不过,倒排索引是什么鬼?

五、倒排索引

elasticsearch使用的是一种称为倒排索引的结构,采用Lucene倒排作为底层。这种结构适用于快速的全文搜索,**一个索引由文档中所有不重复的列表构成,对于每一个词,都有一个包含它的文档列表。**例如,现在有两个文档,每个文档包含如下内容:

Study every day,good good up to forever #文档1包含的内容

To forever, study every day ,good good up #文档2包含的内容

为了创建倒排索引,我们首先要将每个文档拆分成独立的词(或称为词条或者tokens),然后创建一个包含所有不重复的词条的排序列表,然后列出每个词条出现在哪个文档:

| term | doc_1 | doc_2 |

|---|---|---|

| Study | √ | × |

| To | × | × |

| every | √ | √ |

| forever | √ | √ |

| day | √ | √ |

| study | × | √ |

| good | √ | √ |

| to | √ | × |

| up | √ | √ |

现在,我们试图搜索to forever,只需要查看包含每个词条的文档

| term | doc_1 | doc_2 |

|---|---|---|

| to | √ | × |

| forever | √ | √ |

| total | 2 | 1 |

两个文档都匹配,但是第一个文档比第二个文档匹配程度更高。如果没有别的条件,现在,这两个包含关键字的文档都将返回。再来看一个示例,比如我们通过博客标签来搜索博客文章。那么倒排索引列表就是这样一个结构:

| 博客文章(原始数据) | 索引列表(倒排索引) | ||

|---|---|---|---|

| 博客文章ID | 标签 | 标签 | 博客文章ID |

| 1 | python | python | 1,2,3 |

| 2 | python | linux | 3,4 |

| 3 | linux,python | ||

| 4 | linux | ||

如果要搜索还有python标签的文章,那相对于查找所有原始数据而言,查找倒排索引后的数据将会块的多。只需要查看标签这一栏,然后获取相关的文章ID即可。

六、elasticsearch的索引和Lucene的索引对比

在elasticsearch中,索引这个词频繁使用,这就是术语的使用。在elasticsearch中,索引被分为多个分片,每份分片是一个Lucene的索引。所以一个elasticsearch索引是由多个Lucene索引组成的。别问为什么,谁让elasticsearch使用Lucene作为底层呢,如无特指,说起索引都是指elasticsearch的索引。

七、IK分词器

- 什么是

IK分词器?

分词:即把一段中文或者别的划分成一个个的关键字,我们在搜索时候会把自己的信息进行分词,会把数据库中或者索引库中的数据进行分词,然后进行一个匹配操作,默认的中文分词是将每个字看成一个词,比如:“我爱狂神”会被分为“我”,“爱”,“狂”,“神”,这显然是不符合要求的,所以我们需要安装中文分词器IK来解决这个问题。

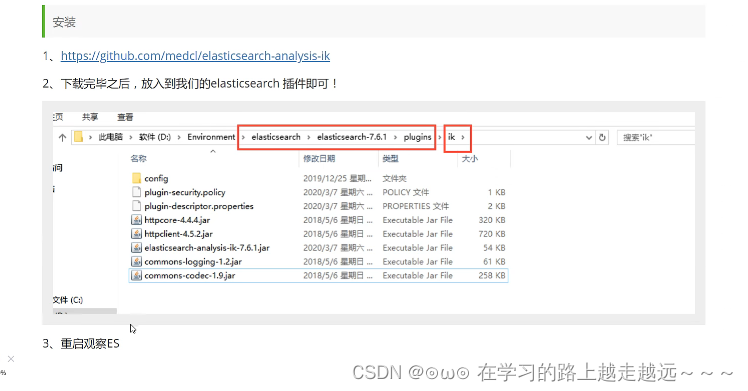

IK提供了两个分词算法:ik_smart和ik_max_word,其中ik_smart为最少切分,ik_max_word为最细粒度划分 - 安装

ik分词器,并将安装好的ik分词器放置在es目录下的plugins目录中

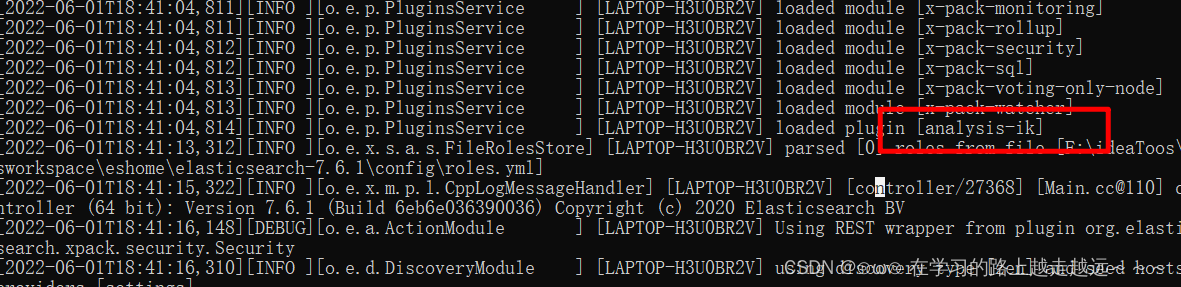

- 重启

ES

- 不用重启也可以通过

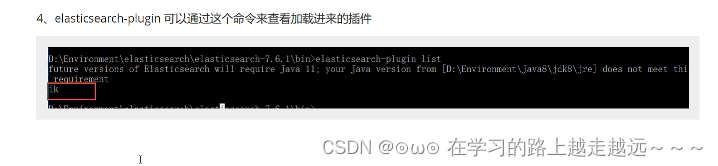

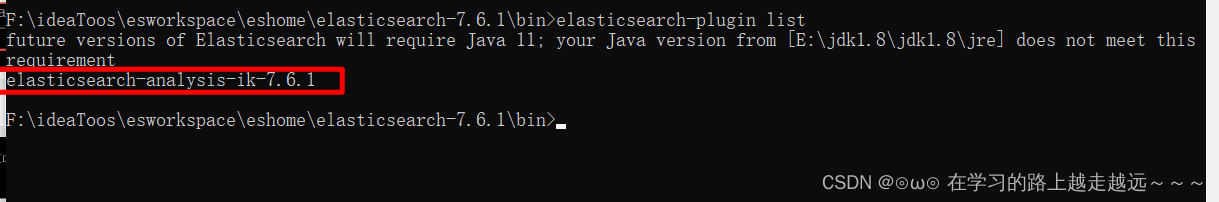

elasticsearch-plugin可以通过这个命令来查看加载进来的插件

- 插件版本尽量和

es版本一致

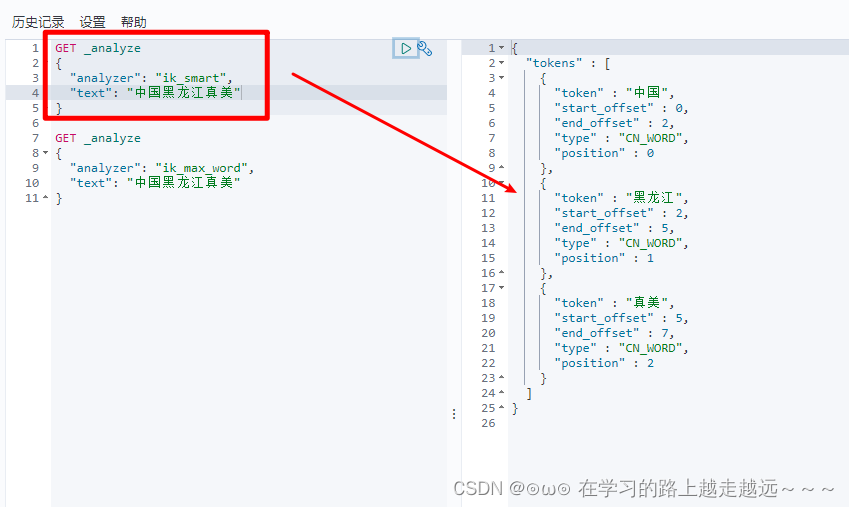

八、ik分词器测试

- 测试

ik_smart分词

- 测试

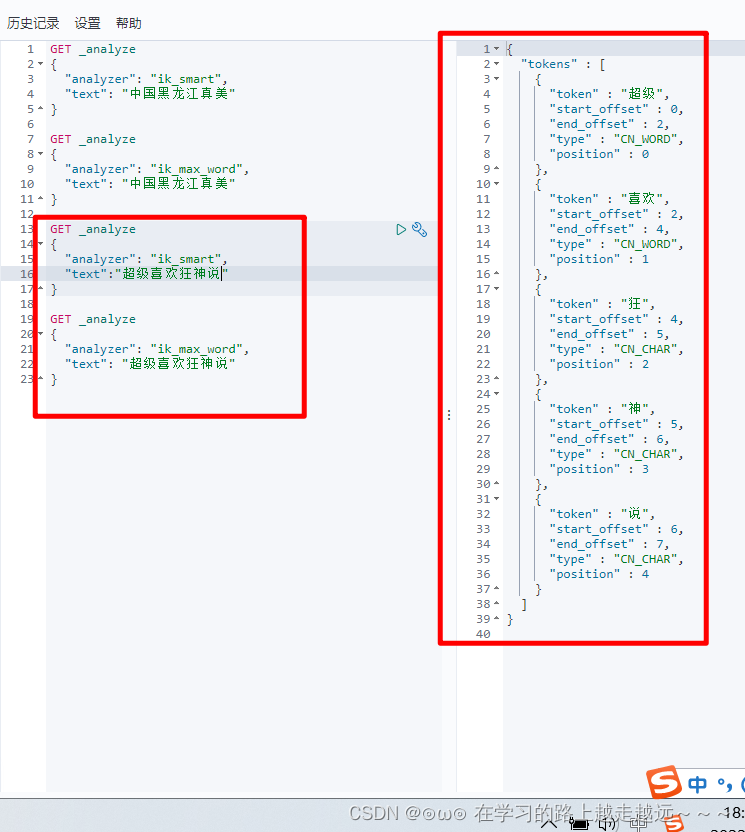

ik_max_word分词,最细力度划分,穷尽词库的可能

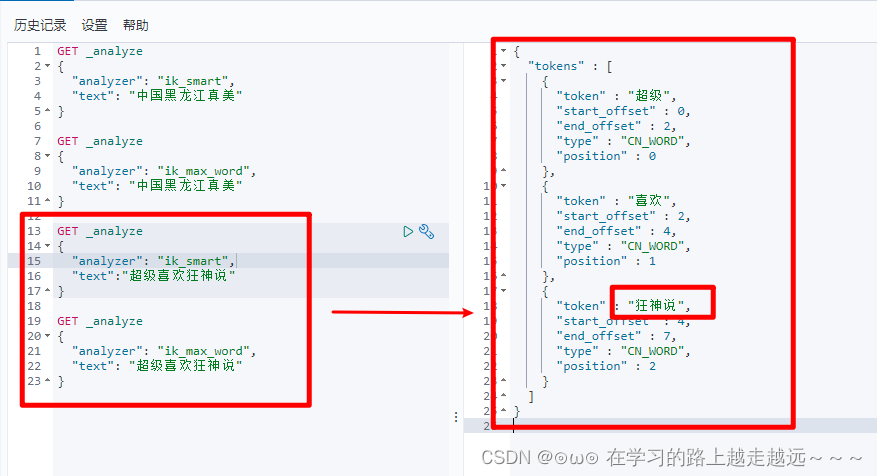

- 测试自定义分词

- 例如“狂神说” 没有被当成一个词语

- 在ik插件中

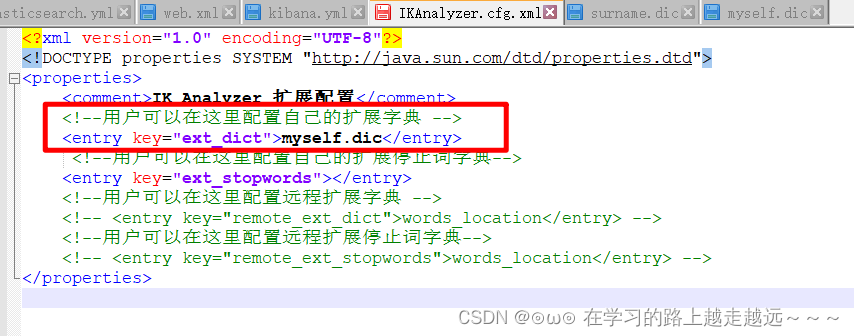

IKAnalyzer.cfg.xml中配置自定义的字典

后缀名称为dic都是一样文档

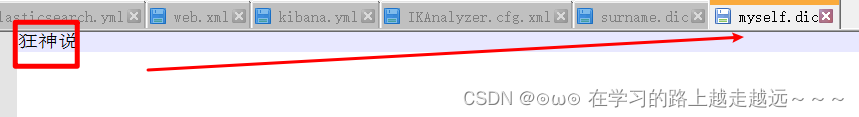

- 自定义分词词典中配置如下内容

- 词典在

ik插件中的config目录下

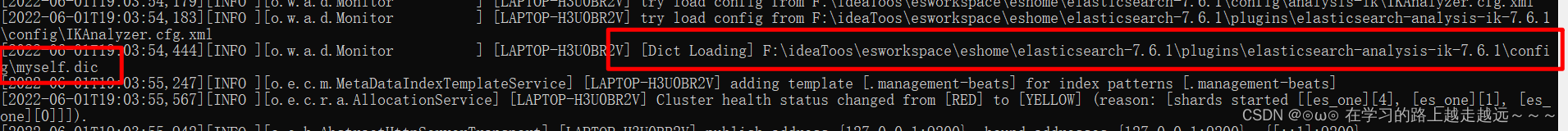

- 重启

ES,加载了自定义的myself.dic文件

- 测试“狂神说”,是否被当成一个完整的词汇

4590

4590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?