Hadoop运行模式

6)配置历史服务器

为了查看程序的历史运行情况,需要配置一下历史服务器。具体配置步骤如下:

1.配置mapred-site.xml

命令:vim mapred-site.xml

添加内容如下:

<!-- 历史服务器端地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop102:10020</value>

</property>

<!-- 历史服务器web端地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop102:19888</value>

</property>

2.分发配置

命令:xsync $HADOOP_HOME/etc/hadoop/mapred-site.xml

3.在hadoop102启动历史服务器

命令:mapred --daemon start historyserver

4.查看历史服务器是否启动

命令:jps

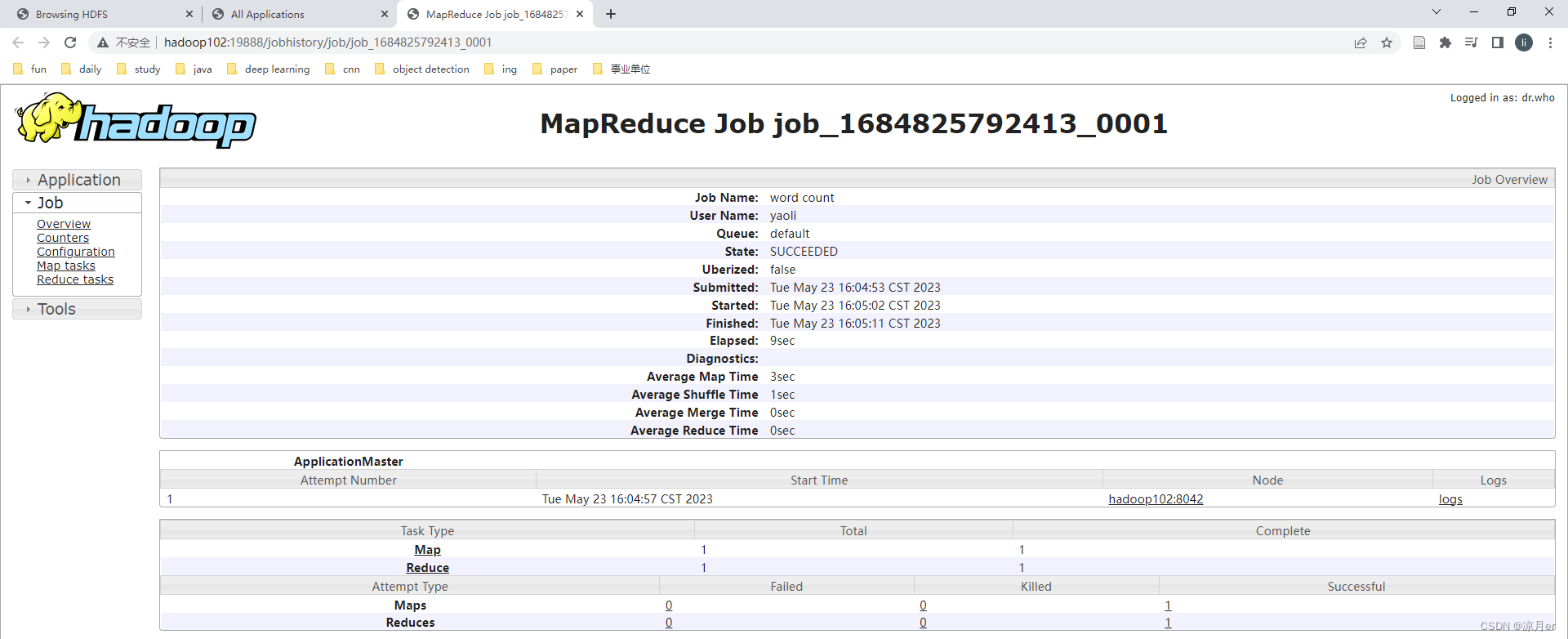

5.查看JobHistory

http://hadoop102:19888/jobhistory

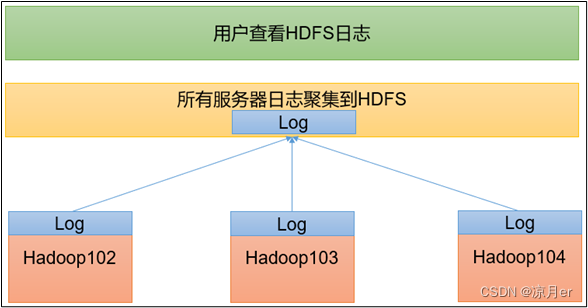

7)配置日志的聚集

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到HDFS系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动NodeManager 、ResourceManager和HistoryServer。

开启日志聚集功能具体步骤如下:

1.配置yarn-site.xml

命令:vim yarn-site.xml

增加如下配置:

<!-- 开启日志聚集功能 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 设置日志聚集服务器地址 -->

<property>

<name>yarn.log.server.url</name>

<value>http://hadoop102:19888/jobhistory/logs</value>

</property>

<!-- 设置日志保留时间为7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

2.分发配置

命令:xsync $HADOOP_HOME/etc/hadoop/yarn-site.xml

3.关闭NodeManager 、ResourceManager和HistoryServer

hadoop102主机上,命令:mapred --daemon stop historyserver

hadoop103主机上,命令:sbin/stop-yarn.sh

4.启动NodeManager 、ResourceManage和HistoryServer

hadoop102主机上,命令:mapred --daemon starthistoryserver

hadoop103主机上,命令:sbin/start-yarn.sh

5.执行WordCount程序

hadoop102主机上,命令:hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar wordcount /wcinput /wcoutput2

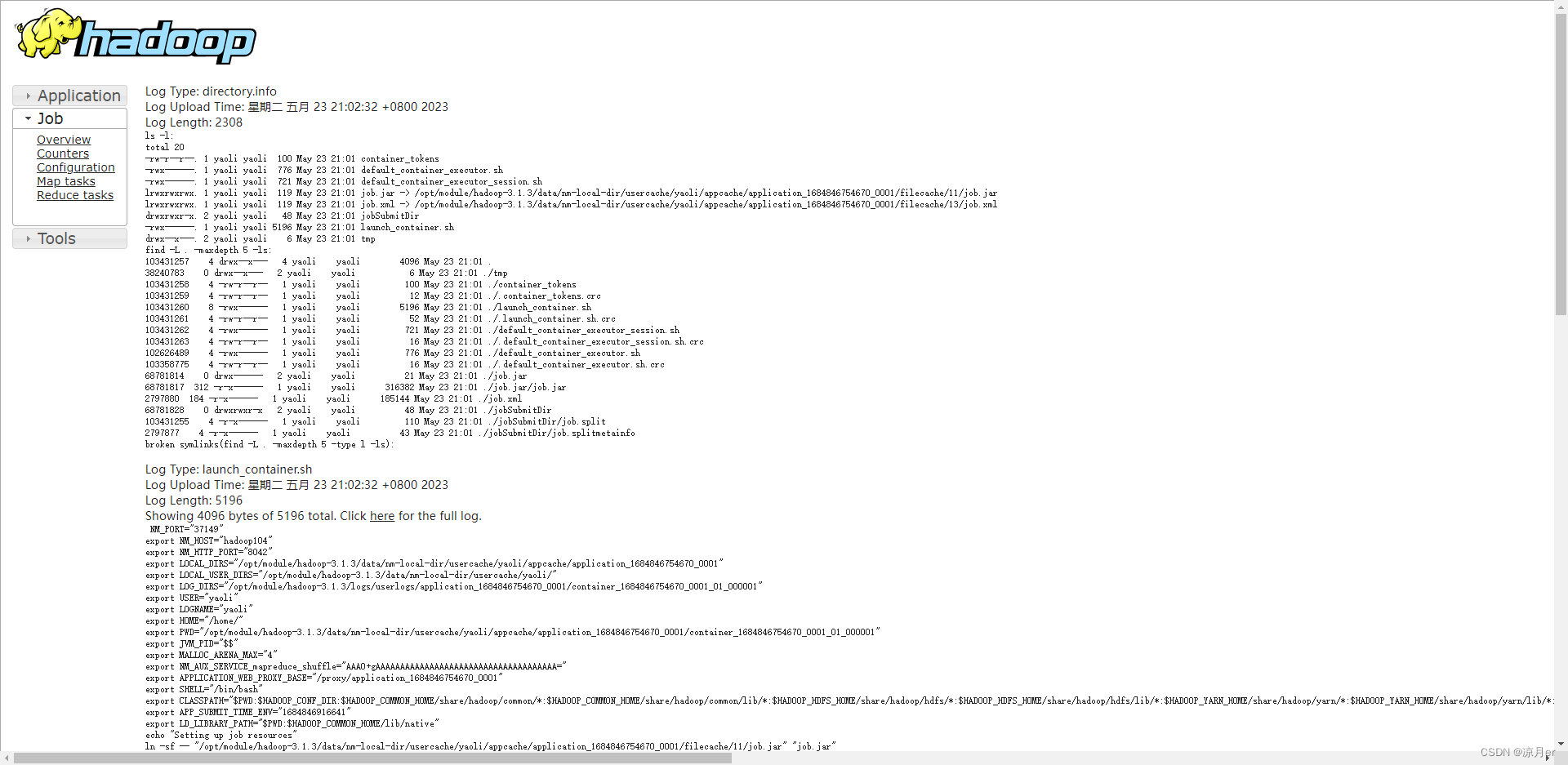

6.查看日志

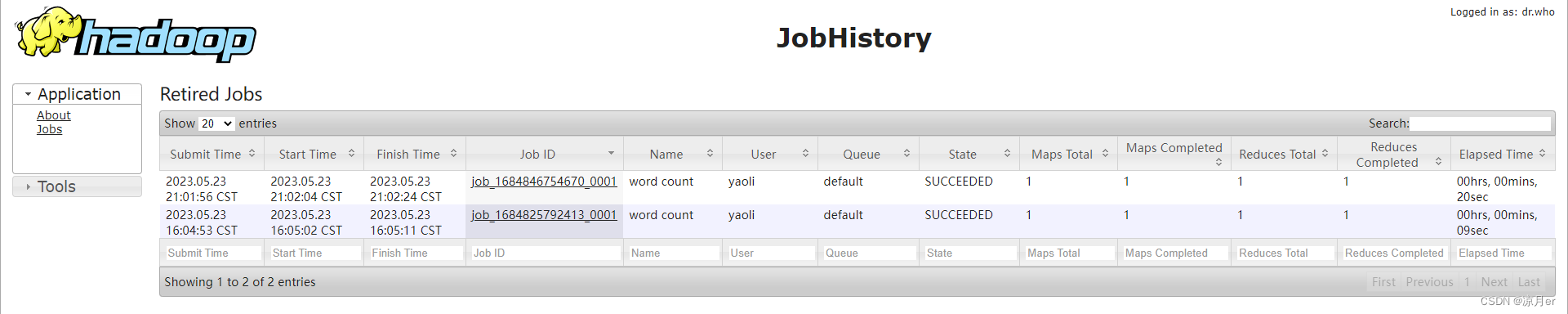

(1)历史服务器地址

http://hadoop102:19888/jobhistory

(2)历史任务列表

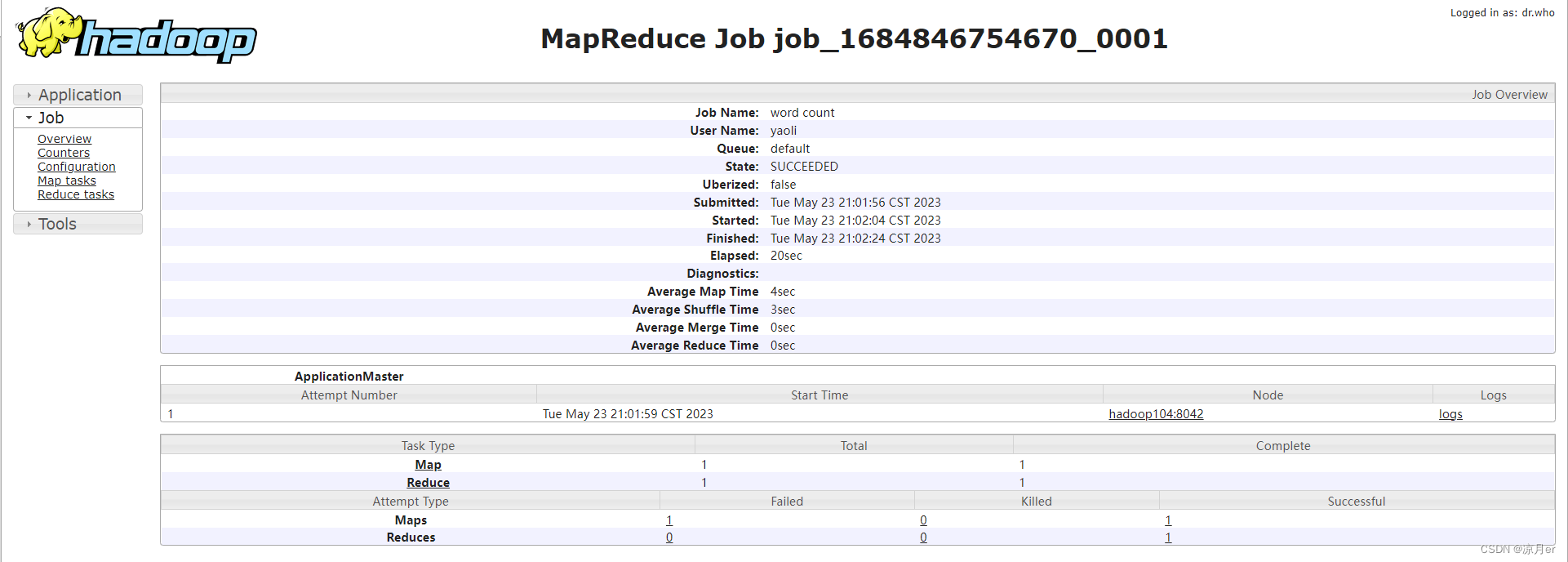

(3)查看任务运行日志

(4)运行日志详情

8)集群启动/停止方式总结

1.各个模块分开启动/停止(配置ssh是前提)常用

- 整体启动/停止HDFS

命令:start-dfs.sh/stop-dfs.sh - 整体启动/停止YARN

命令:start-yarn.sh/stop-yarn.sh

2.各个服务组件逐一启动/停止

- 分别启动/停止HDFS组件

命令:hdfs --daemon start/stop namenode/datanode/secondarynamenode - 启动/停止YARN

命令:yarn --daemon start/stop resourcemanager/nodemanager

9)编写Hadoop集群常用脚本

1.Hadoop集群启停脚本(包含HDFS,Yarn,Historyserver):myhadoop.sh

hadoop102主机上。命令:cd /home/yaoli/bin,vim myhadoop.sh

- 输入以下内容:

#!/bin/bash

if [ $# -lt 1 ]

then

echo "No Args Input..."

exit ;

fi

case $1 in

"start")

echo " =================== 启动 hadoop集群 ==================="

echo " --------------- 启动 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/start-dfs.sh"

echo " --------------- 启动 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/start-yarn.sh"

echo " --------------- 启动 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon start historyserver"

;;

"stop")

echo " =================== 关闭 hadoop集群 ==================="

echo " --------------- 关闭 historyserver ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/bin/mapred --daemon stop historyserver"

echo " --------------- 关闭 yarn ---------------"

ssh hadoop103 "/opt/module/hadoop-3.1.3/sbin/stop-yarn.sh"

echo " --------------- 关闭 hdfs ---------------"

ssh hadoop102 "/opt/module/hadoop-3.1.3/sbin/stop-dfs.sh"

;;

*)

echo "Input Args Error..."

;;

esac

- 保存后退出,然后赋予脚本执行权限

命令:chmod 777 myhadoop.sh

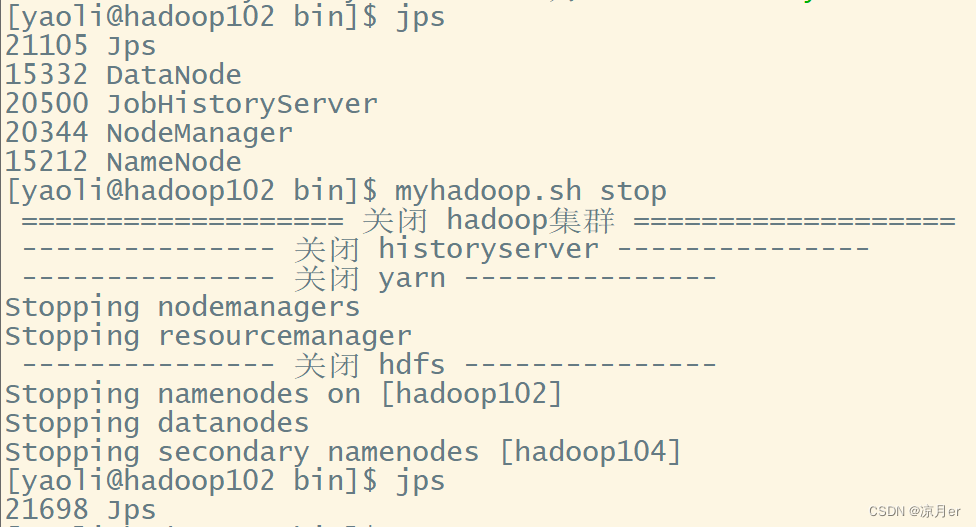

测试myhadoop.sh:

- 关闭:

- 开启

2.查看三台服务器Java进程脚本:jpsall

hadoop102主机上,命令:cd /home/yaoli/bin,vim jpsall

- 输入以下内容:

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

echo =============== $host ===============

ssh $host jps

done

- 保存后退出,然后赋予脚本执行权限

命令:chmod 777 jpsall

3.分发/home/yaoli/bin目录,保证自定义脚本在三台机器上都可以使用

hadoop102主机上的~目录,命令:xsync /home/atguigu/bin/

效果图:

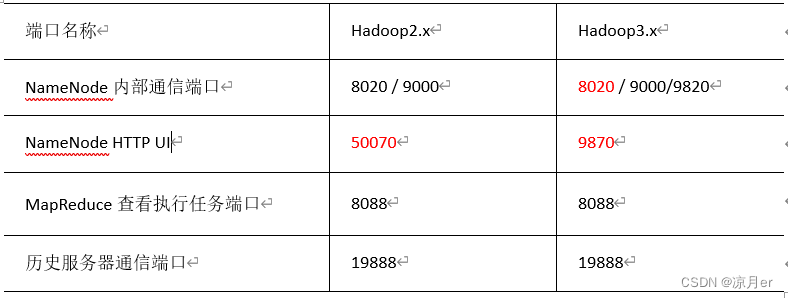

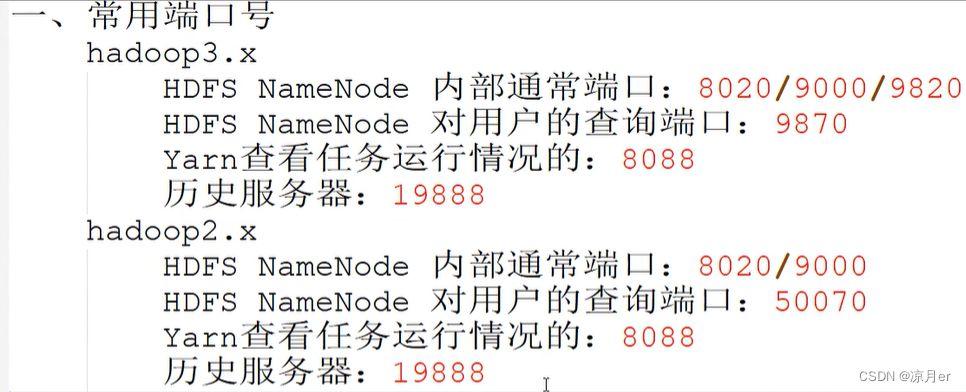

10)入门篇两道面试题

1.常见端口号说明

2.常用的配置文件

11)集群时间同步

如果服务器在公网环境(能连接外网),可以不采用集群时间同步,因为服务器会定期和公网时间进行校准;

如果服务器在内网环境,必须要配置集群时间同步,否则时间久了,会产生时间偏差,导致集群执行任务时间不同步。

12)常见错误及解决方案

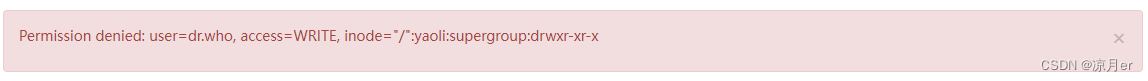

1、在HDFS网页界面删除不了文件

解决办法:修改core-site.xml

添加如下内容:

<!-- 配置HDFS网页登录使用的静态用户为yaoli -->

<property>

<name>hadoop.http.staticuser.user</name>

<value>yaoli</value>

</property>

修改后记得分发文件,并停止集群,开启集群

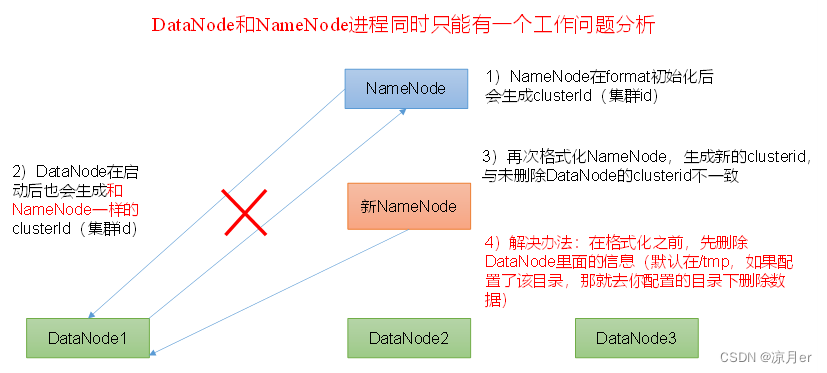

2、DataNode和NameNode进程同时只能工作一个。

3582

3582

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?