什么是最优化问题

通俗地说,就是求一个函数在可行域上的极值。

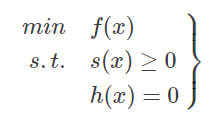

若函数无约束条件则称为无约束优化;若约束条件为等式则称为等式约束优化;若约束条件为不等式则称为不等式约束优化。

最优性条件

最优性条件即极值点满足的条件。

- 无约束问题最优性条件

一阶必要条件:一阶导数等于0

二阶必要条件:二阶导数大于等于零

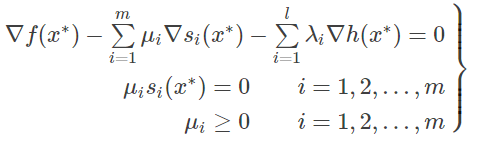

- 一般约束优化问题的最优性条件

无约束优化问题的算法框架

- step0 给定初始化参数及初始迭代点X0,置k=0;

- step1 若Xk满足终止准则,停止迭代,以Xk作为近似极小点;

- step2 确定下降方向dk;

- step3 确定步长因子ak,使得f(Xk+ak*dk)<f(Xk);

- step4 令Xk+1=Xk+ak*dk,k=k+1,转step1;

线搜索

在单变量的情况下可以采

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2186

2186

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?