1.准备工作

1.1 安装依赖

由于我使用的是Ubuntu所以就只粘贴Ubuntu系统的所需要的依赖,如果是其他系统,可以去官网查看所需依赖

Ubuntu

ant

gcc

g++

libffi-dev

libkrb5-dev

libmysqlclient-dev

libsasl2-dev

libsasl2-modules-gssapi-mit

libsqlite3-dev

libssl-dev

libtidy-0.99-0

libxml2-dev

libxslt-dev

make

libldap2-dev

python-dev

python-setuptools

libgmp3-dev

libz-dev

1.2 安装git和Maven

1.2.1 git

yum install git

1.2.2 安装Maven:从官网下载安装包

tar -zxvf 下载下来的包名

mv 解压缩文件名 maven

修改Maven目录下的conf/settings.xml文件,更改自己的数据文件夹

找到此行

<localRepository>/path/to/local/repo</localRepository>

更改为你自己想要存储的路径

<localRepository>/data/hue/maven</localRepository>

1.3 配置Maven环境变量

在~/.bashrc文件下加入下面俩行:填写自己下载的maven路径

export MAVEN_HOME=/usr/local/maven

export PATH=$PATH:$MAVEN_HOME/bin

退出后source 一下

source ~/.bashrc

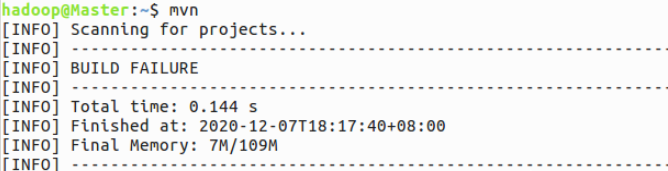

出现下面这个即安装成功

2.安装Hue

2.1 下载

使用此命令直接git下载Hue,大概几分钟就下好了,千万不能用

git clone https://github.com/cloudera/hue.git 这个下载,速度太慢,老是失败

git clone https://github.com.cnpmjs.org/cloudera/hue.git

2.2 编译

cd /hue

make apps

这期间会出现非常多的错误,缺少什么依赖,再装,哪个权限不够,直接赋予。看错误提示,时间非常长。

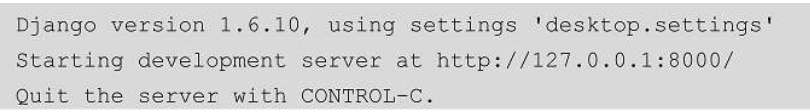

如果一切顺利,将会出现下面语句:

2.3 修改配置文件

2.3.1 修改desktop/conf/pseudo-distributed.ini

# Webserver

http_host=0.0.0.0

http_port=8888

3 配置Hue

3.1 配置HDFS

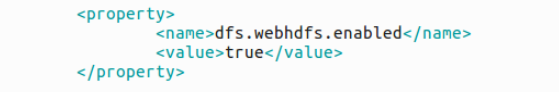

修改hdfs目录下的etc/hadoop/hdfs-site.xml文件

增加如下属性,用来打开webhadfs功能

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

修改hdfs目录下的etc/hadoop/core-site.xml文件

增加如下属性,用来代理hdfs的所有操作。

<property>

<name>hadoop.proxyuser.hadoop.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.hadoop.groups</name>

<value>*</value>

</property>

把这俩文件传给其他几个节点(如果是集群的话)

重启HDFS

stop-all.sh

start-all.sh

3.2 配置Hue

编辑desktop/conf/pseudo-distributed.ini

找到下面几条,并将其修改

可以使用vim 在进入界面输入 /名称查找 如 /fs_defaults,会自动定位

fs_defaults=hdfs://Master(此处是您的主机名):8020

webhdfs_url=http://Master(此处是您的主机名):50070/webhdfs/v1

hbase_clusters=(Cluster|Master(此处是您的主机名):9090)

3.3 配置HBase

进入到Hbase目录,执行

bin/hbase-daemon.sh start thrift

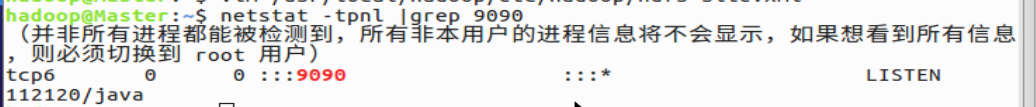

thrift会监听9090端口,在命令行执行下面命令,来查看9090端口是否使用

netstat -tpnl | grep 9090

启动HBase

启动Hue

4.使用Hue查看HBase

4.1 创建代理用户

进入网址:http://Master(此处是您的主机名):8888

第一次登陆就会创建一个管理员用户,随便创建一个进去。

在此处添加新用户,即刚刚hadoop配置文件里的hadoop用户

直接Add user 此用户。

4.2登陆查看数据

退出超级管理员,使用hadoop账号登陆。

点击HBase区域,即可查看HBase表内数据。

可以看到自己刚才建立的表和插入的数据

918

918

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?