概述

分类和关联性

回归

回归是通过输入一系列影响事物某一属性的其他事物属性,而输出的这个事物属性的值的问题

非监督学习

发现数据中的规律(密度估计)

类学习

类学习就是寻找一个涵盖所有正例而不包括任何负例的描述

类的识别器的输入就是事情的属性。

确定假设类即规定范围,找出影响的参数,进行预测,会存在经验误差。

泛化问题

VC维

vc维是独立于数据实例的概率分布。

使用矩形作为假设类。

只需要找到4个被散列的点

概率逼近正确学习

线性回归

单变量线性回归

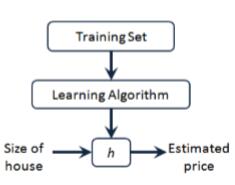

模型表示

? 代表训练集中实例的数量

? 代表特征/输入变量

? 代表目标变量/输出变量

(?,?) 代表训练集中的实例

(?(?),?(?)) 代表第? 个观察实例

ℎ 代表学习算法的解决方案或函数也称为假设(hypothesis)

一种可能的表达方式为:ℎ?(?) = ?0 + ?1?,因为只含有一个特征/输入变量,因此这样

的问题叫作单变量线性回归问题。

代价函数

代价函数*也被称作平方误差函数, ?(?0,?1) = 1/2?∑ (ℎ?(?(?)) − ?(?))^2 ? ?=1.

***建模误差***是我们选择的参数决定了我们得到的直线相对于我们的训练集的准确程度,模型所预测的

值与训练集中实际值之间的差距。

选择出可以使得建模误差的平方和能够最小的模型参数,即使得代价

函数最小。

梯度下降

***梯度下降***是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数

?(?0,?1) 的最小值。

开始时我们随机选择一个参数的组合(?0,?1,…,??),计算代价函数,然后寻找下一个能让代价函数值下降最多的参数组合。持续这么做,直到找到一个局部最小值。

批量梯度下降(batch gradient descent)算法的公式为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1026

1026

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?