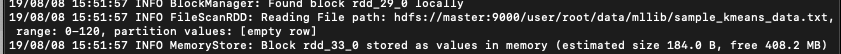

是在学习sparkml的时候,产生了 hadf上没有数据文件的错误,如下图:

发现错误之后,决定按照文件夹,上传文件到hdfs上。

- 打开hadoop 所在的文件目录

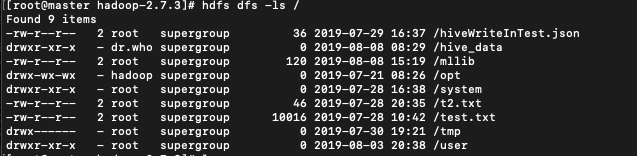

- 查看当前目录信息

hdfs dfs -ls /

运行后产生下面的效果:

3 在hdfs上创建新的文件夹

这里创建的为aaa

hdfs dfs -mkdir /aaa

4 在本地创建一个新的文件夹

这里创建的为aaa, 建在 hadoop的根目录下,采用下面的命令:

mkdir aaa

5 在本地文件夹里写入数据文件

在aaa里写入数据文件

vim sample_kmeans_data.txt

6 上传本地文件到hdfs

hadoop fs -put /opt/hadoop-2.7.3/aaa/sample_kmeans_data.txt /aaa

7 查看是否上传成功

hadoop fs -ls /aaa

出现如下所示的效果

此外,还可以在web界面的50070端口查看,如下图所示:

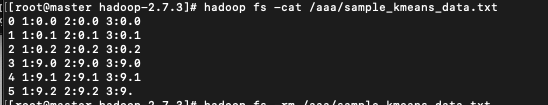

8 查看上传的文件内容

hadoop fs -cat /aaa/sample_kmeans_data.txt

出现如下所示的效果:

9 删除hdfs 文件

hadoop fs -rm /aaa/sample_kmeans_data.txt

10 复制hdfs 文件

从错误中看出,我要创建的文件夹是/user/root/data/mllib/

采用下面的命令:

hdfs dfs -mkdir -p /user/root/data/mllib/

创建成功之后,会显示出来的

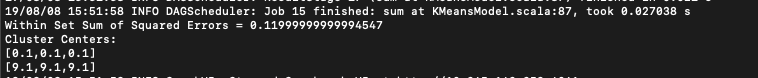

接着再把aaa里面的文件复制到mllib文件中,采用下面的命令:

hdfs dfs -cp /aaa/sample_kmeans_data.txt /user/root/data/mllib/

在web界面看到下面的显示情况:

到此成功,再进行运行,成功不报错。

更多hdfs命令可以查看博客:https://www.cnblogs.com/areyouready/p/9783687.html

6835

6835

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?