维生素C吃多了会上火-个人CSDN博文目录

cs224w(图机器学习)2021冬季课程学习笔记集合

目录

1.思维大纲

2.中文笔记

提取链接

提取码:6666

3.Node Embeddings

传统的图机器学是给定输入图形,提取节点,链接和图形级别功能,学习将特征映射到标签的模型(SVM,神经网络等)

传统图机器学习特征工程量巨大

Representation Learning:图表表示学习减轻了每一次需要进行特征工程的需要

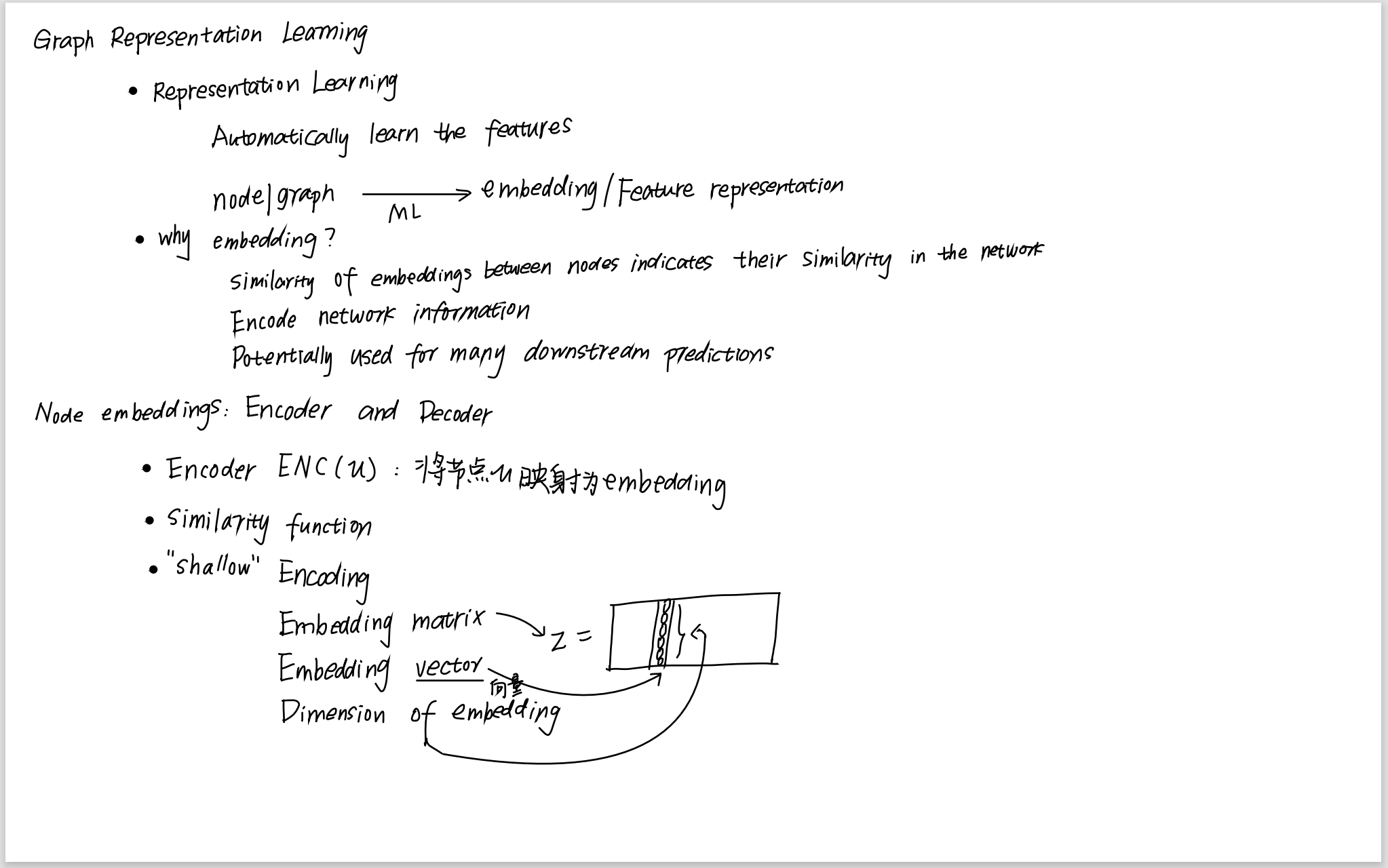

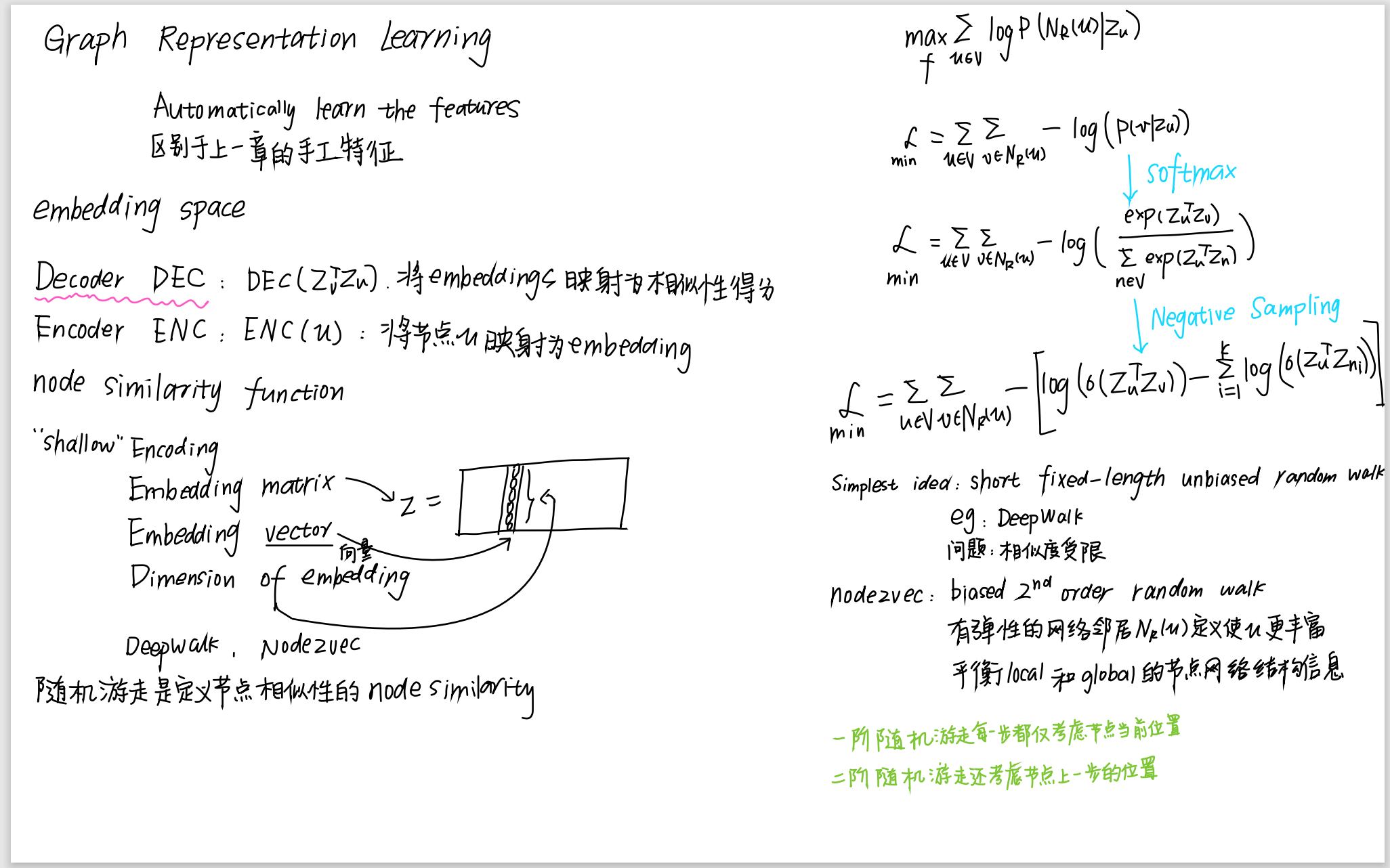

1.Representation Learning

目标:使用图机器学习进行有效的任务无关特征学习

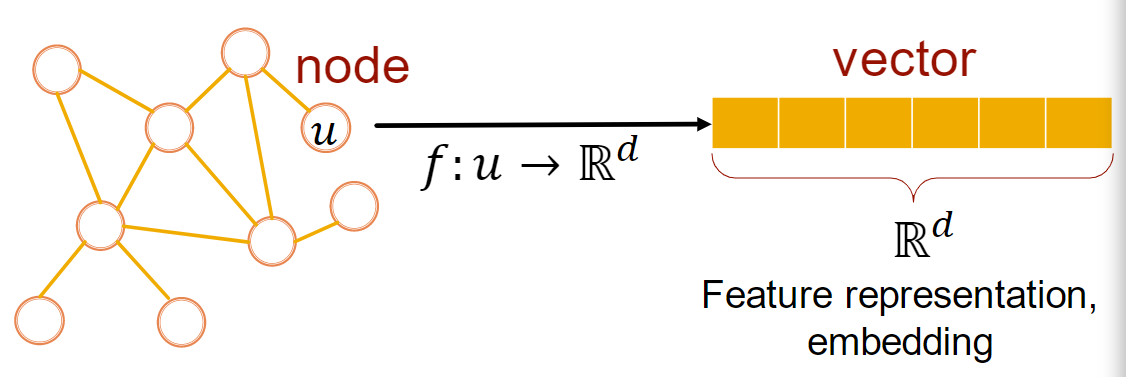

representation Learning AKA embedding:在节点级别上,对于图上的每个节点,学习如何将节点映射到d维空间并将其表示为长度为d的向量

为什么想到embedding?

- 节点之间嵌入的相似性表示它们在网络中的相似性

- 编码网络信息

- 用于许多下游预测

2.Node Embeddings: Encoder and Decoder

目标:

S

i

m

i

l

a

r

i

t

y

(

u

,

v

)

Similarity(u,v)

Similarity(u,v)

≈

\approx

≈

Z

Z

ZuT

Z

Z

Zv

Encoder:

将每个节点映射到低维向量

E

N

C

(

V

)

=

Z

ENC(V)=Z

ENC(V)=Zv

Similarity function:

矢量空间中的关系如何映射到原始网络中的关系

“Shallow" Encoding:

E

N

C

(

V

)

=

Z

ENC(V)=Z

ENC(V)=Zv

=

Z

⋅

V

=Z⋅V

=Z⋅V

Z

Z

Z每列是一个节点所对应的embedding向量。

V

V

V是一个其他元素都为0,对应节点位置的元素为1的向量

Summarize:

目标是直接估计节点的一组坐标,以便保留网络结构的某些方面

embedding与任务无关,没有使用节点的标签和特征,没有针对特定任务进行培训,但可以用于任何任务

2683

2683

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?